Combien de clics faut-il réellement pour capturer proprement une image AVD, la versionner dans une galerie, puis redéployer 10 hôtes sans erreur ? Si vous administrez Azure Virtual Desktop au quotidien, vous connaissez la réalité : le portail Azure fonctionne très bien… mais l’opérationnel est répétitif, chronophage, et parfois fragile. Image → Sysprep → Snapshot → Galerie → Version → Déploiement → Intégration au pool → Vérifications. Et on recommence !

Azure Virtual Desktop a énormément évolué ces dernières années. Builder, améliorations ARM/Bicep, automatisations natives… mais malgré tout, dans la vraie vie d’un admin ou d’un architecte, on cherche surtout à raccourcir la boucle opérationnelle.

C’est exactement là que WVDAdmin entre en jeu. Un outil communautaire, simple, direct, qui ne cherche pas à réinventer AVD, mais à compresser le quotidien.

Et pour vous guider plus facilement dans cet article très long, voici des liens rapides :

- FAQ

- Test de WVDAdmin

- Mon avis personnel

- Conclusion

Qu’est-ce que WVDAdmin ?

WVDAdmin est un outil graphique communautaire pour administrer Azure Virtual Desktop (anciennement Windows Virtual Desktop) via une application installée localement. WVDAdmin a été développé par Marcel Meurer et est disponible via son blog ITProCloud.

Qui est Marcel Meurer ?

Marcel Meurer est un expert allemand spécialisé dans Azure Virtual Desktop (AVD) et l’automatisation Azure. Il a reçu une double nomination en tant que Microsoft MVP, et il fait partie de ce prestigieux programme depuis plus de onze années.

Marcel Meurer est également le créateur de Hydra for Azure Virtual Desktop. Nous reviendrons sur Hydra for Azure Virtual Desktop dans un prochain article.

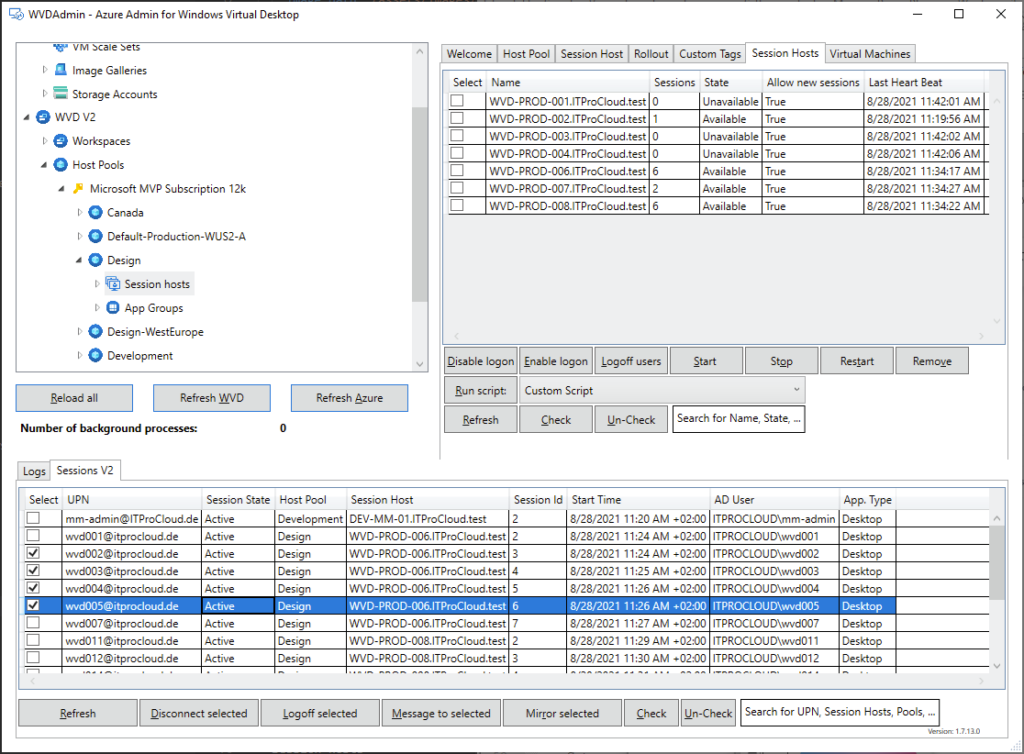

Que peut-on faire avec WVDAdmin ?

Une bonne manière de comprendre WVDAdmin est la suivante : il ne cherche pas à « remplacer Azure Virtual Desktop », mais à compresser la boucle opérationnelle (image → déploiement → exploitation → mise à jour) en moins de clics et dans une interface unique.

Basé sur sa documentation officielle, voici un résumé de ce que WVDAdmin peut faire pour vous.

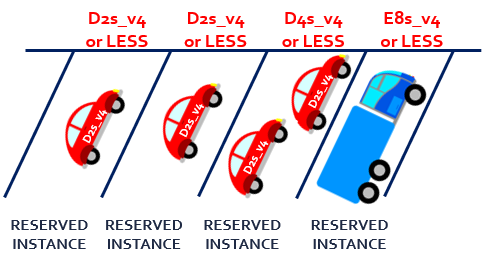

- Workflow d’image golden : création d’images à partir d’un « golden master » sans détruire la VM maître/modèle, avec gestion de Sysprep, des applications modernes et des opérations de nettoyage.

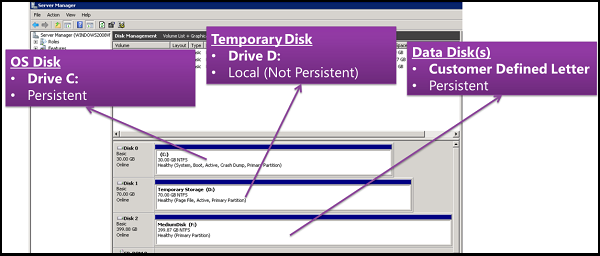

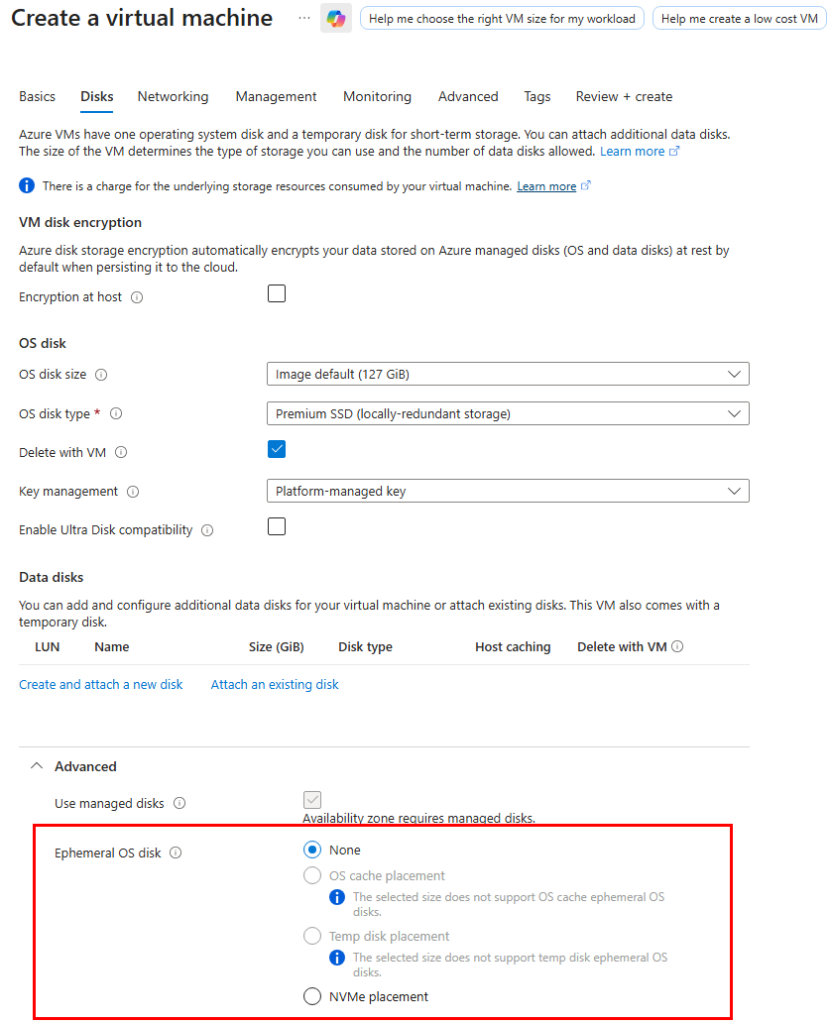

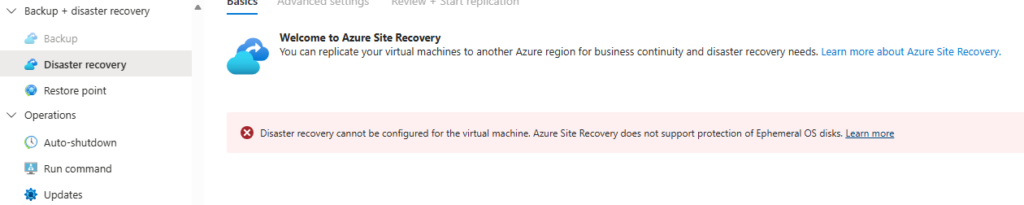

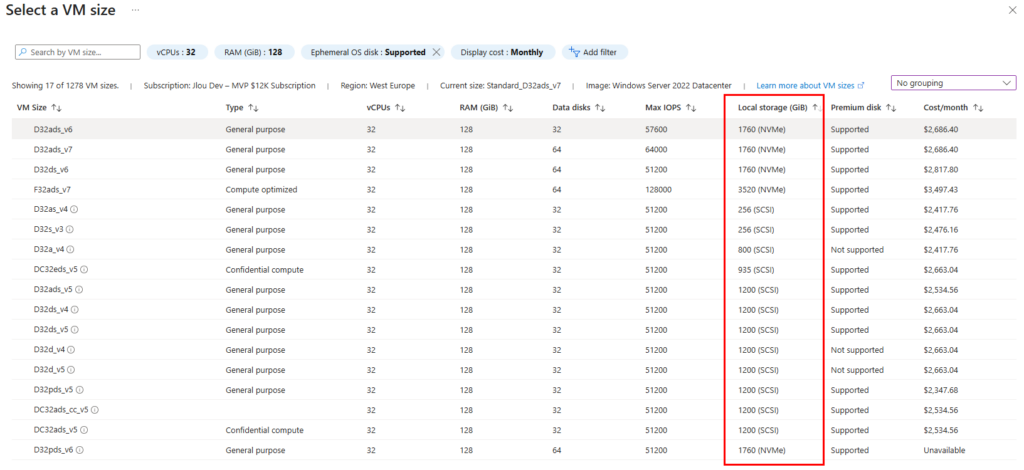

- Déploiement (rollout) : déploiement de plusieurs hôtes de session, choix des tailles de VM par déploiement, prise en charge des disques éphémères, et options telles que « AAD only / joint à MEM/Intune » (selon l’auteur).

- Opérations sur les ressources AVD : création, ajout et suppression de pools d’hôtes, groupes d’applications, espaces de travail et hôtes de session.

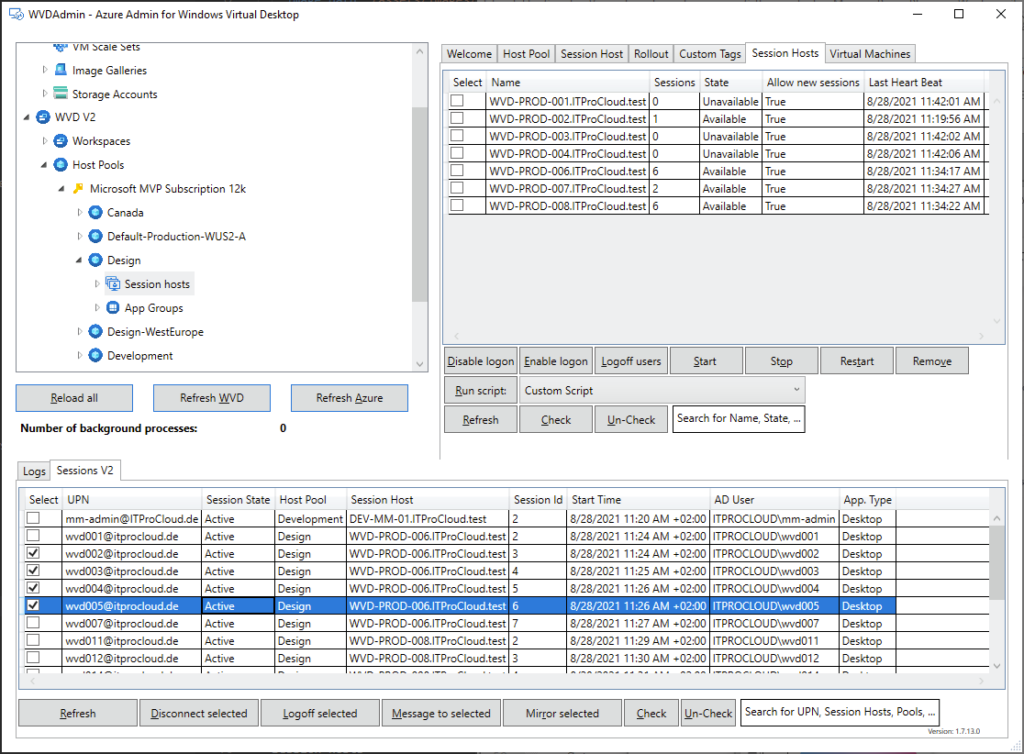

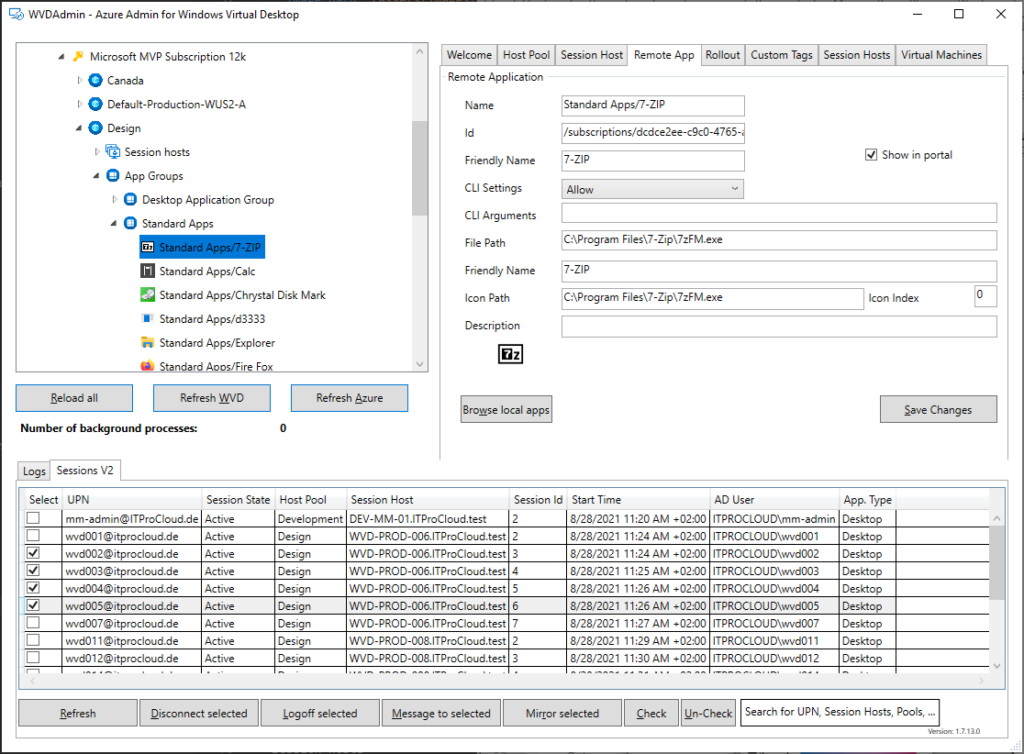

- Opérations sur les sessions : déconnexion, délogage, envoi de messages et shadowing.

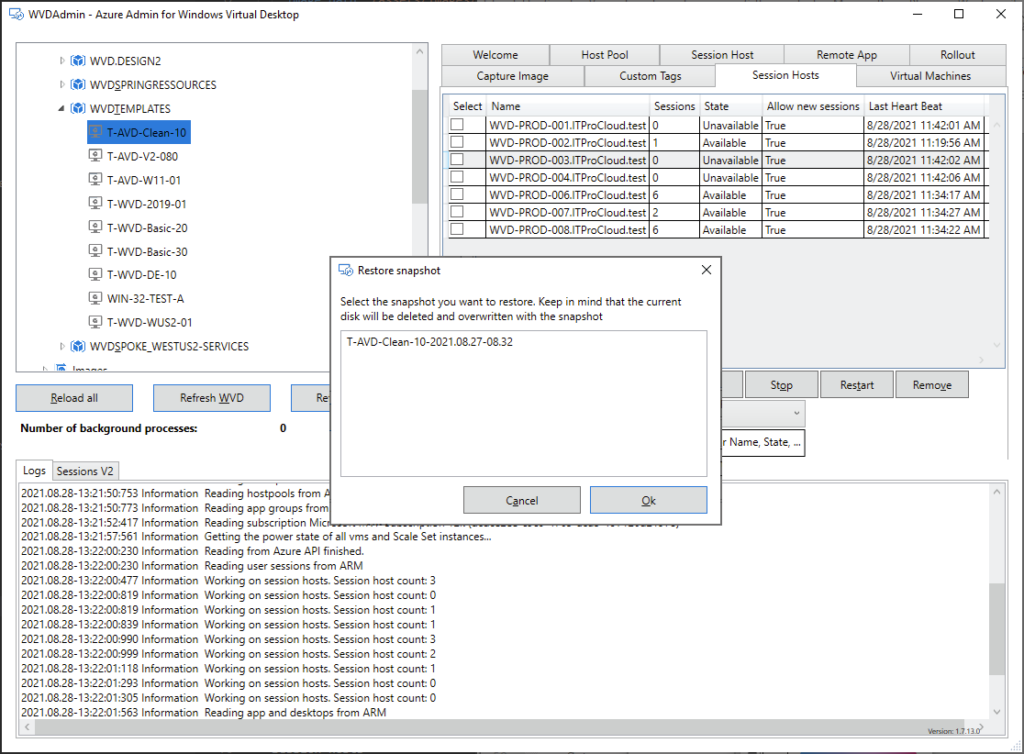

- Opérations générales sur les VM Azure : inventaire des VM sur plusieurs abonnements (via Azure Resource Graph, avec un délai signalé), exécution de scripts à distance, snapshots/restaurations, et même réduction de la taille des disques OS.

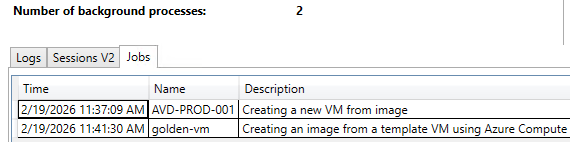

- Opérations en simultané : WVDAdmin supporte plusieurs tâches en simultané afin de gagner en efficacité.

WVDAdmin vs Hydra for AVD ?

WVDAdmin est à l’origine un outil communautaire gratuit pour Azure Virtual Desktop. WVDAdmin est intéressant lorsqu’on cherche une méthode rapide pour faire de l’imaging et du déploiement AVD. C’est une application Windows utilisée de manière interactive, donc sans automatisation planifiée.

Hydra en est une évolution plus avancée et orientée production (autoscaling, multi-tenant, orchestration plus poussée, etc.). Hydra apporte l’automatisation complète, l’optimisation des coûts, le monitoring via l’Hydra Agent, et supporte aussi des scénarios Azure Local.

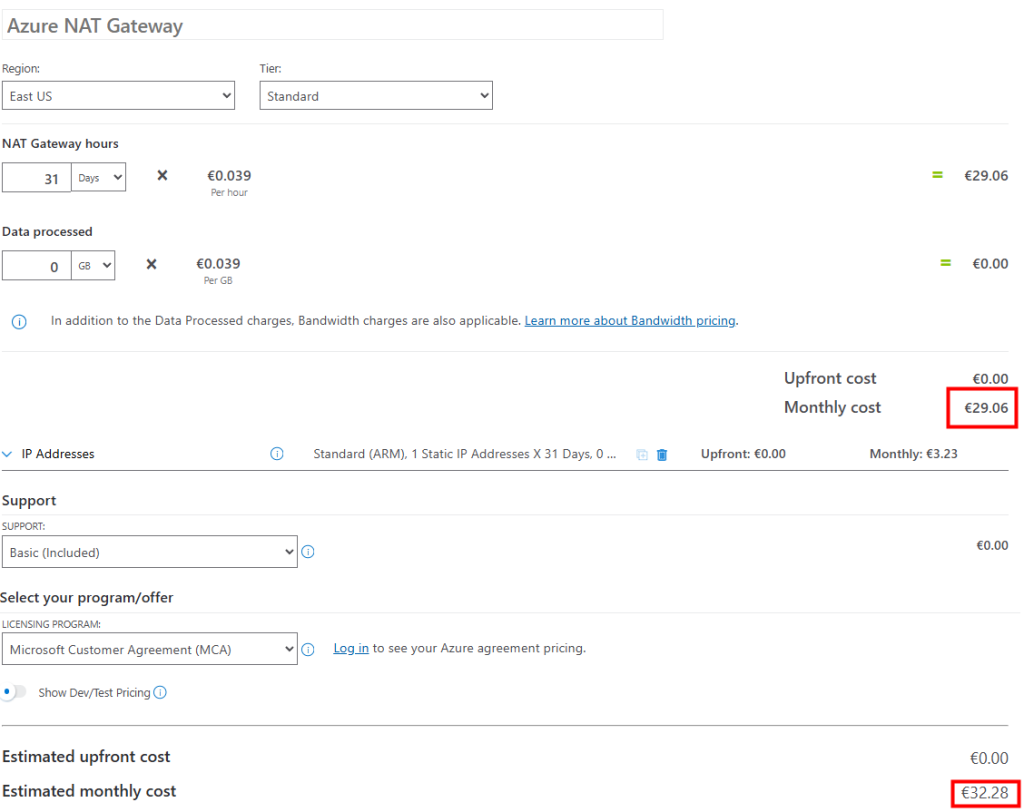

WVDAdmin est donc un choix pertinent si l’on veut éviter de déployer des ressources supplémentaires Azure comme celles nécessaires pour Hydra.

| Critère | WVDAdmin | Hydra |

|---|---|---|

| Type | Outil GUI local | Plateforme SaaS |

| Autoscaling | ❌ | ✅ |

| Multi-tenant | Limité | Oui |

| Coût | Gratuit | Payant |

| Infrastructure supplémentaire | Non | Oui |

Est-ce que WVDAdmin est toujours maintenu ?

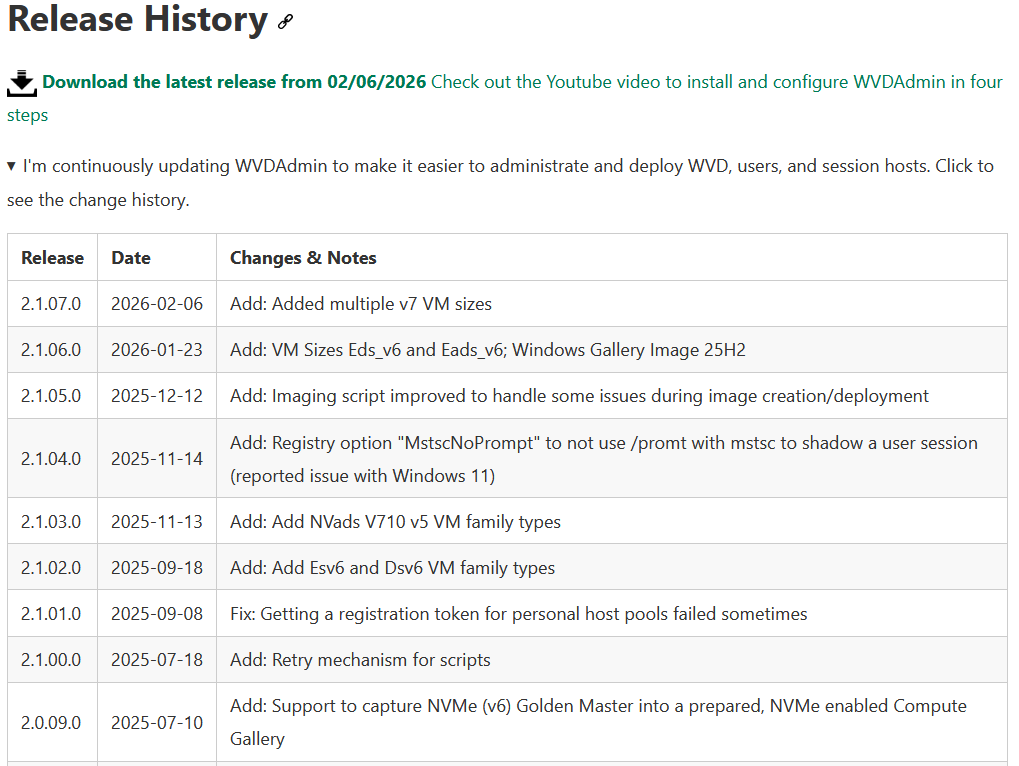

L’outil WVDAdmin existe maintenant depuis au moins 5 ans. WVDAdmin est toujours maintenu, mais n’est peut-être plus aussi activement développé comme avant (les efforts d’amélioration sont principalement concentrés sur Hydra).

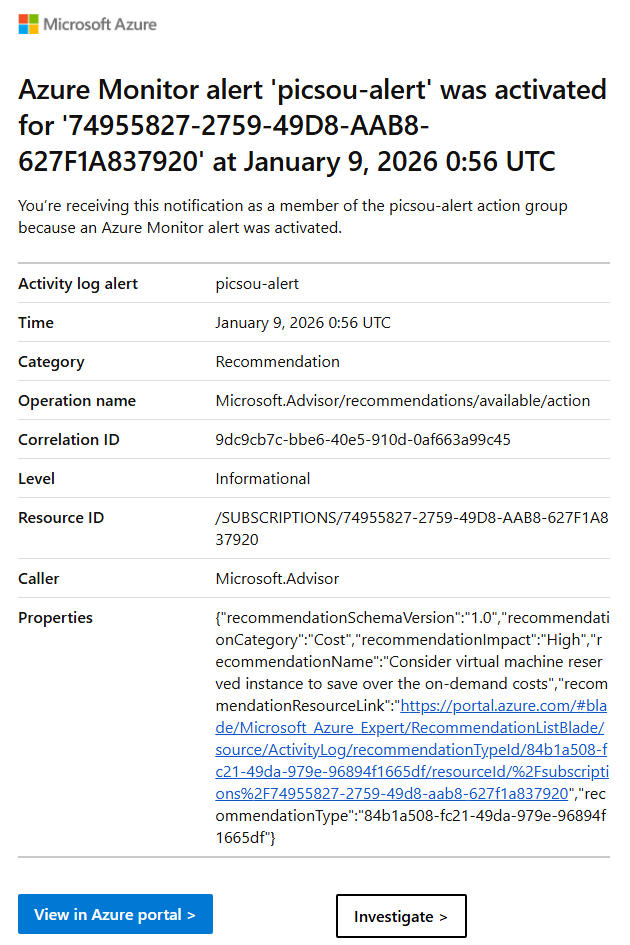

Il reçoit encore des mises à jour, principalement pour prendre en compte les nouveaux SKUs Azure, corriger des bugs ou assurer la compatibilité avec certains changements d’API :

Quoi qu’on en dise, plusieurs dernières releases de WVDAdmin sont sorties en 2026, avec une dernière version publiée le 06/02/2026 :

Combien coûte WVDAdmin ?

Là encore nous pouvons lui dire merci, car WVDAdmin un outil licence-free pour Azure Virtual Desktop, utilisable sans frais supplémentaires pour l’administration des ressources AVD via une application Windows.

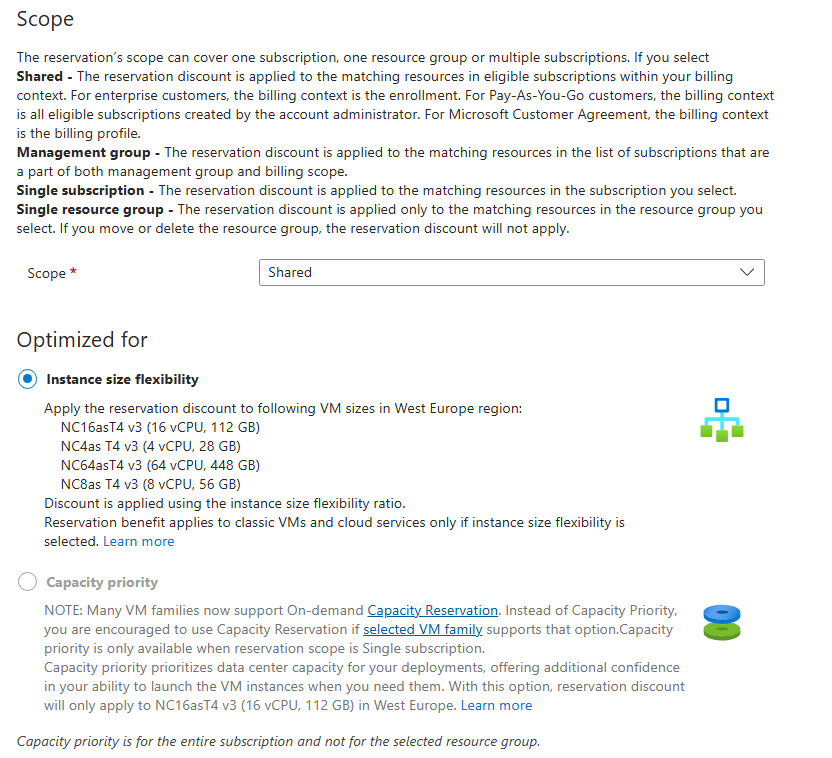

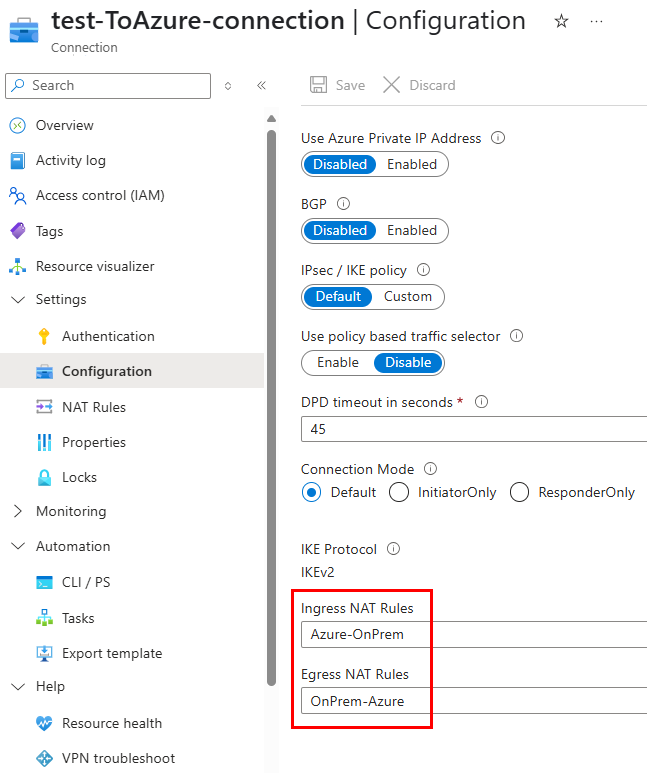

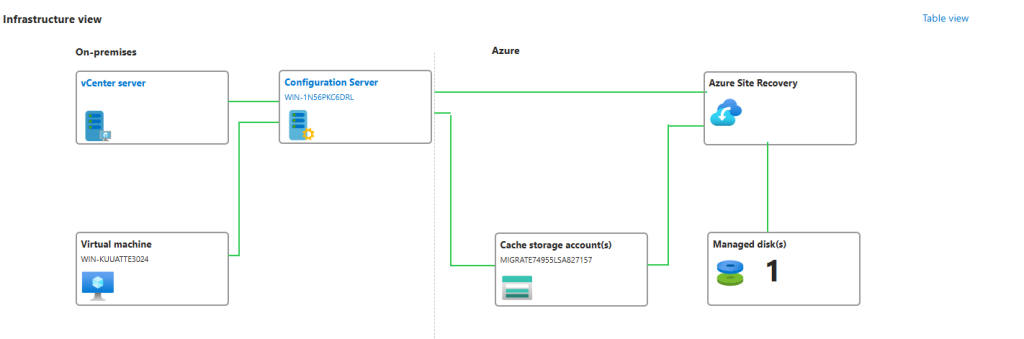

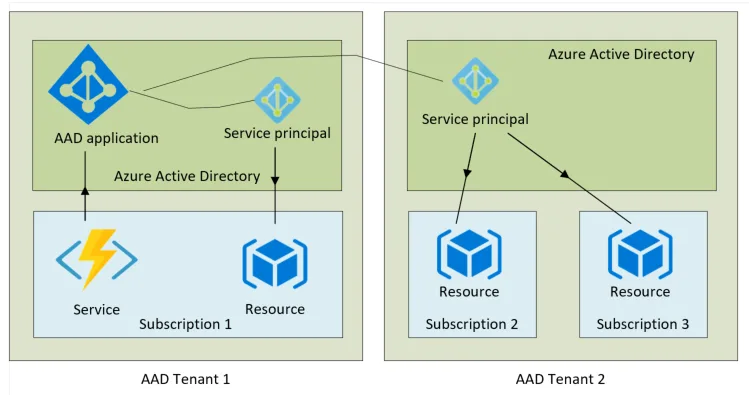

Comment WVD accède aux ressources du tenant ?

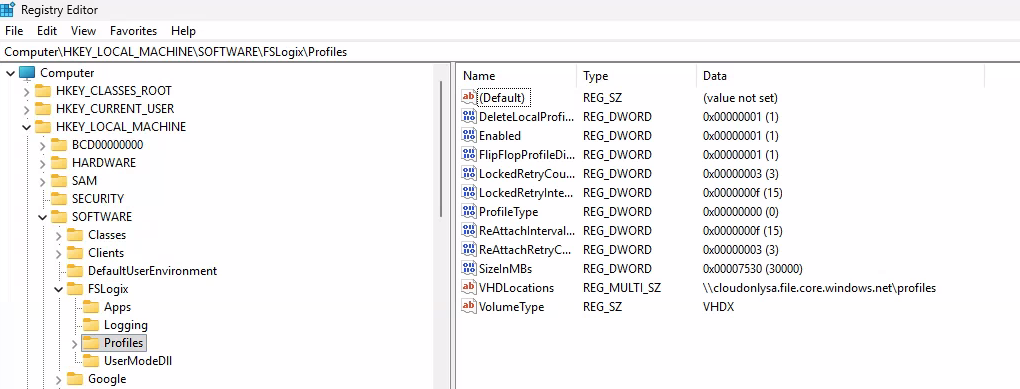

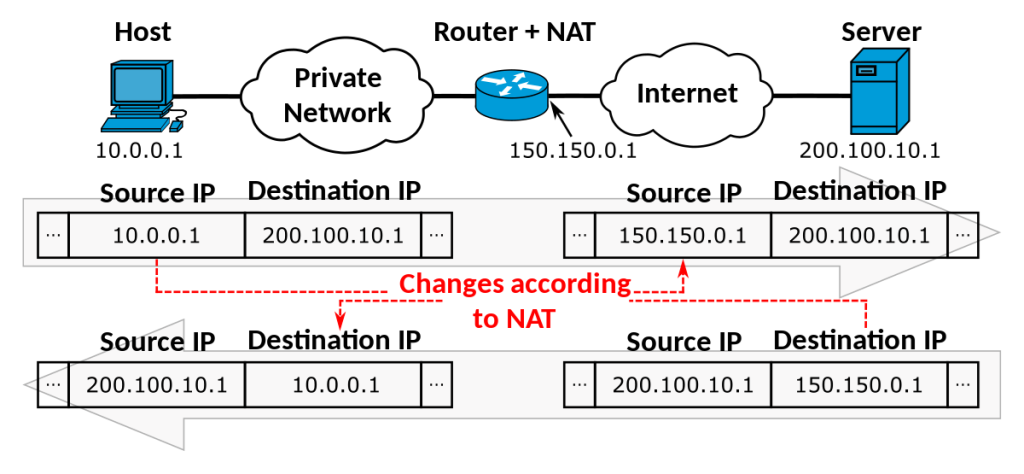

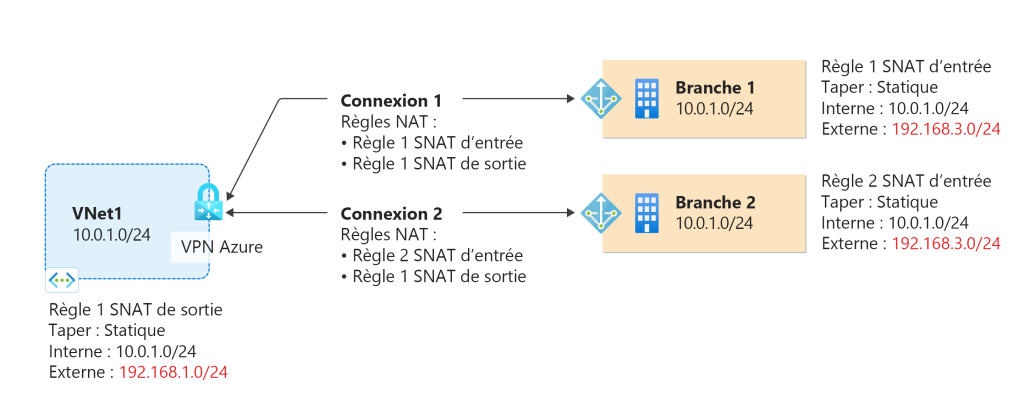

WVDAdmin accès aux ressources Azure par le biais d’un principal de service, protégé par un secret. Celui-ci dispose de permissions sur AVD et sur les ressources Azure. L

’objectif est notamment d’éviter toute confusion lorsque l’administrateur IT est un compte invité dans un tenant client et doit changer régulièrement de tenant.

Voici d’ailleurs un exemple de fonctionnement dans le cadre de plusieurs tenants :

Comment WVDInfra marche ?

Au travers de sa chaîne YouTube, Marcel a mis à disposition une playlist spécifiquement consacré à WVDInfra, de son installation à différentes qu’il peut faire sur votre environnement Azure Virtual Desktop :

Et enfin, comme toujours, je vous propose dans la suite de cet article d’effectuer ensemble un pas à pas pour couvrir l’installation de WVDInfra, sa mise en service, la capture d’une image Windows 11 custom et enfin la création d’une hôte dans un environnement AVD :

- Etape 0 – Rappel des prérequis

- Etape I – Installation de WVDInfra

- Etape II – Configuration Entra

- Etape III – Configuration Azure

- Etape IV – Test de capture d’une VM

- Etape V – Test de création d’un hôte

- Etape VI – Fonctionnalités annexes

- Mon avis personnel

- Conclusion

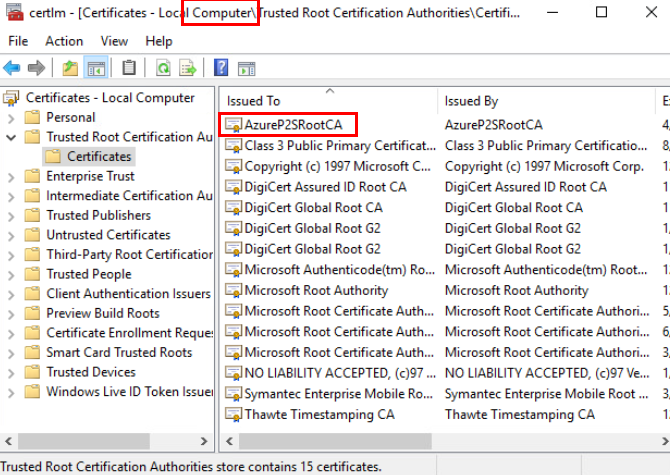

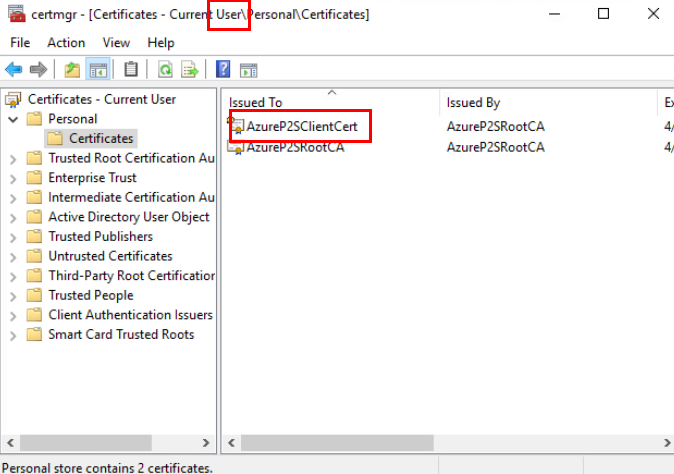

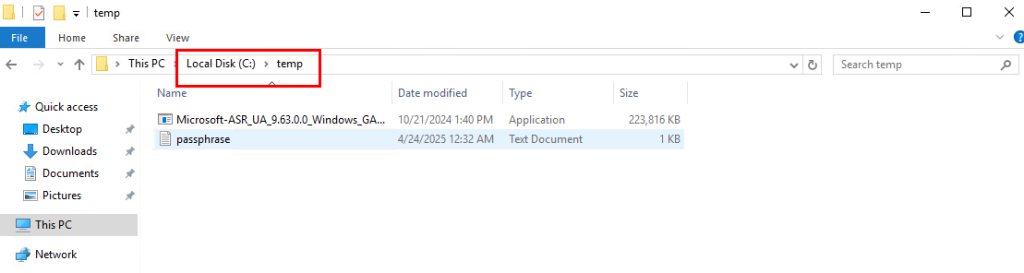

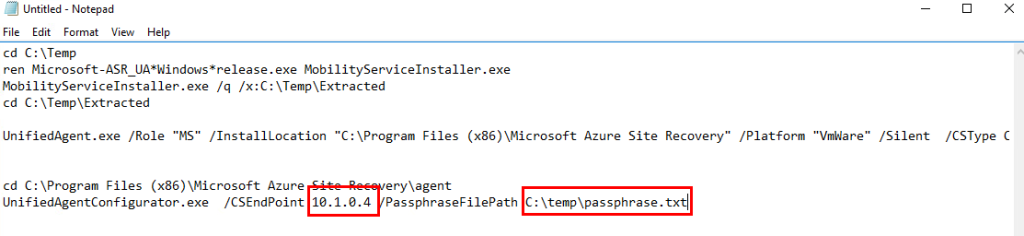

Etape 0 – Rappel des prérequis :

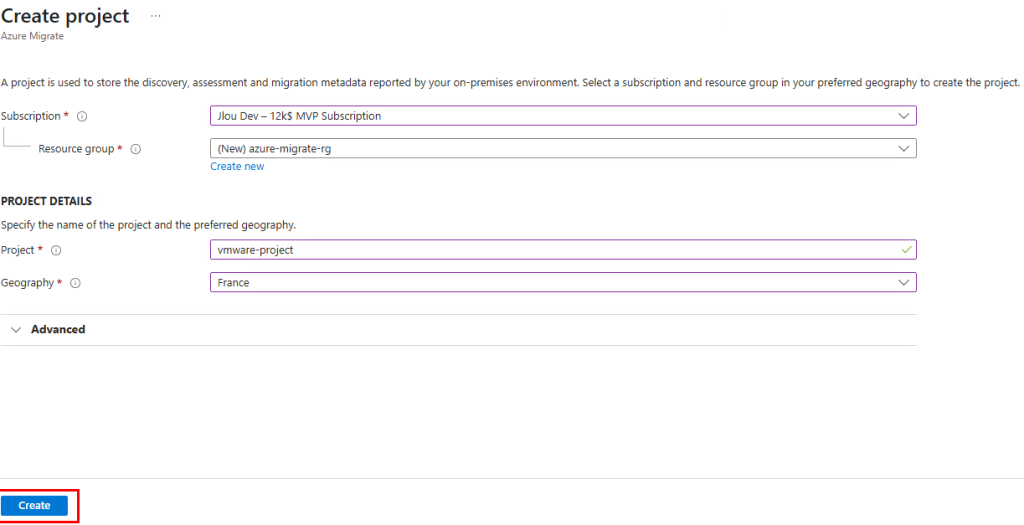

Pour réaliser ce test sur WVDInfra, il vous faudra disposer de :

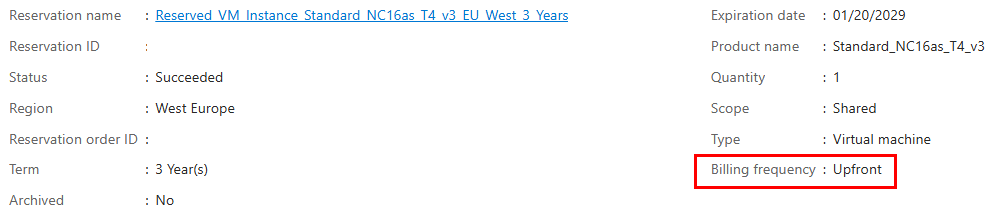

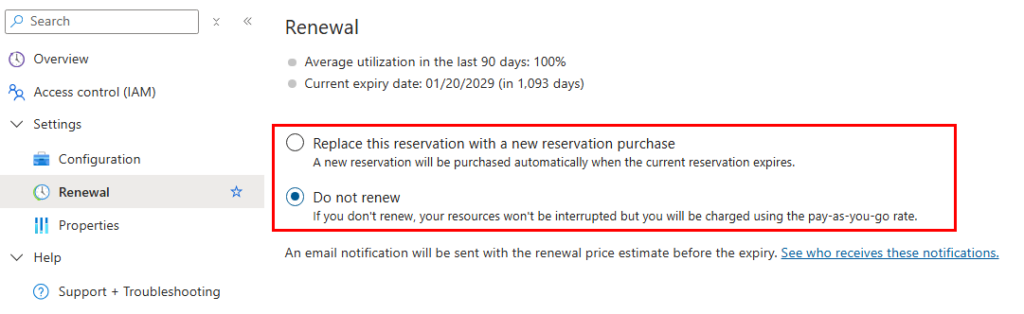

- Un abonnement Azure valide

- Un tenant Microsoft

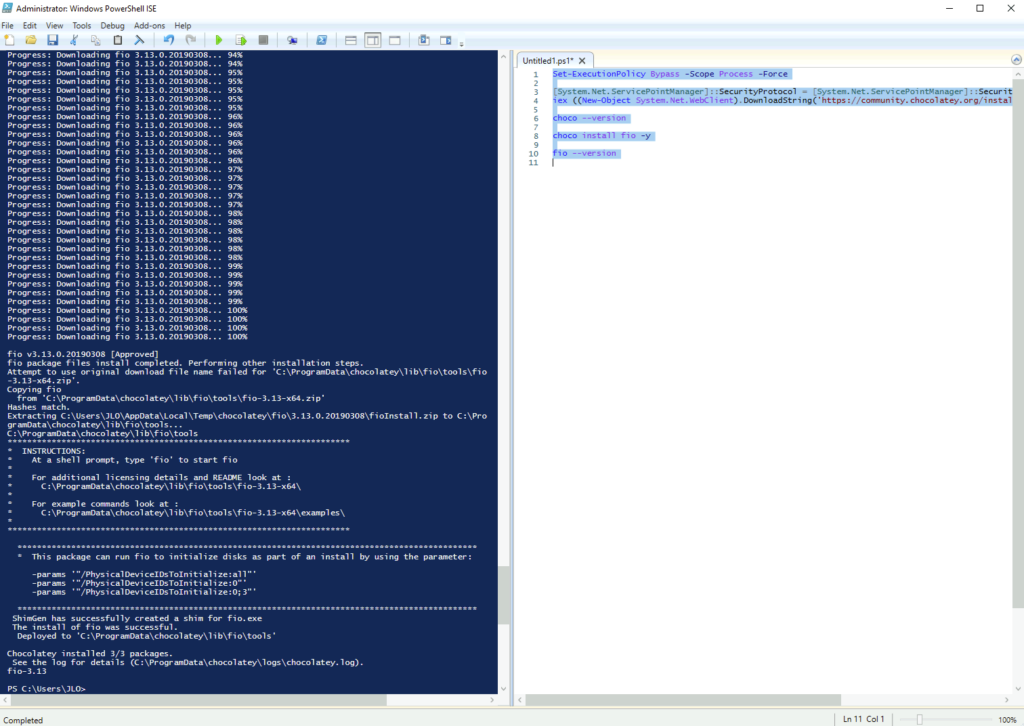

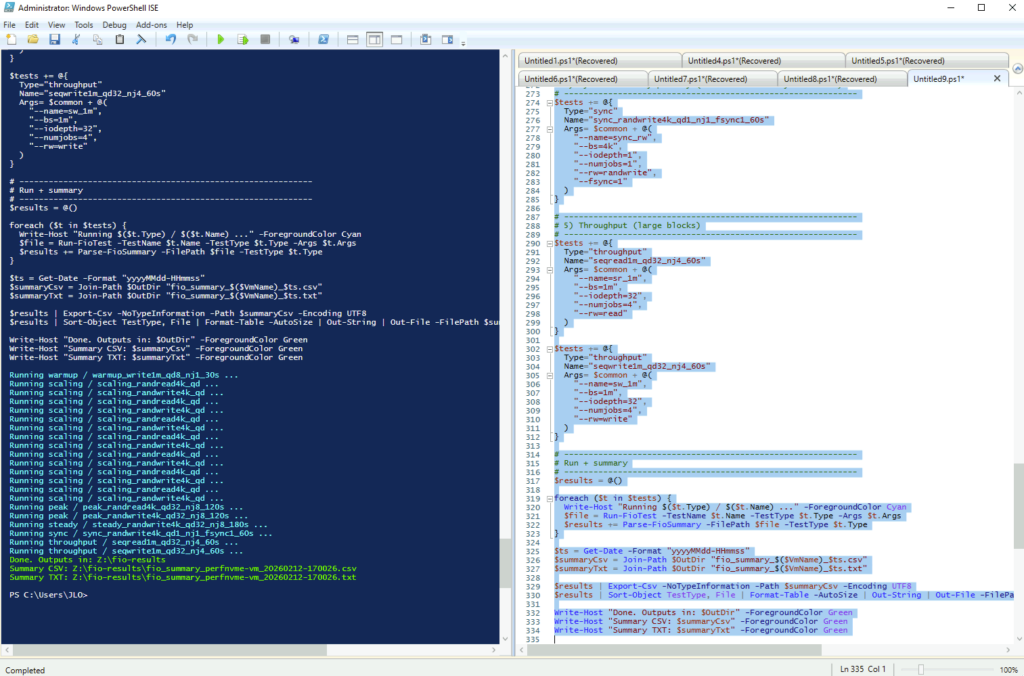

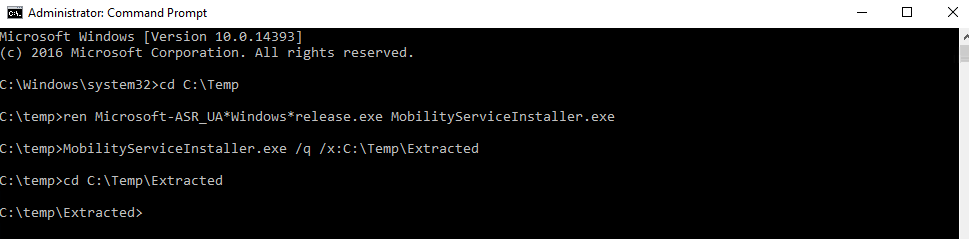

Commençons par l’installation de WVDInfra sur votre poste local.

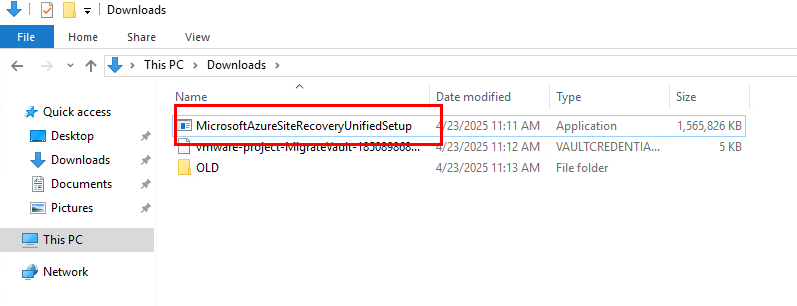

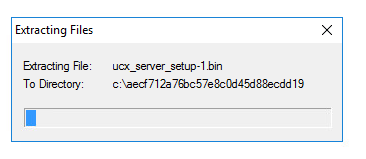

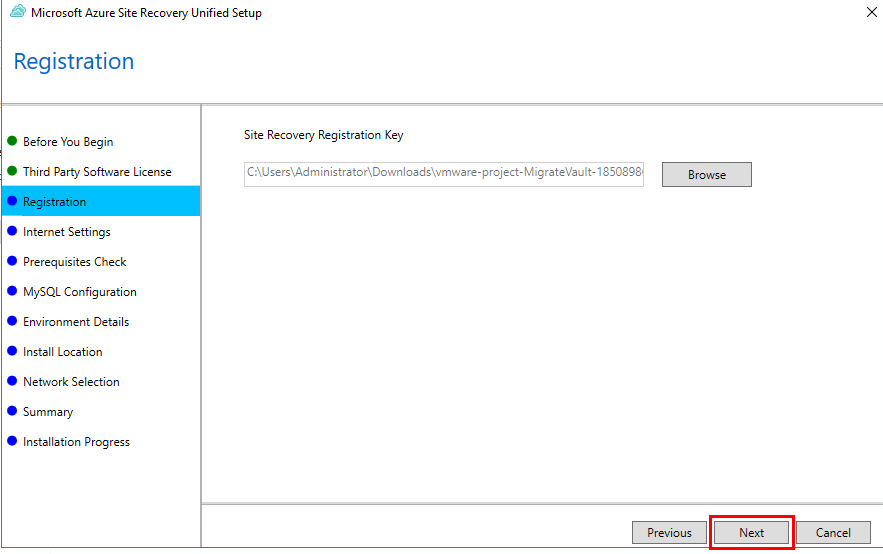

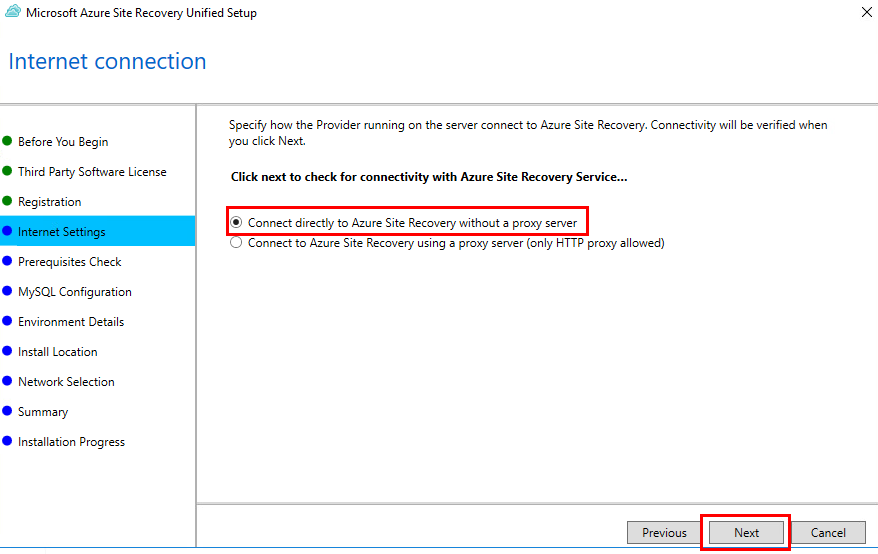

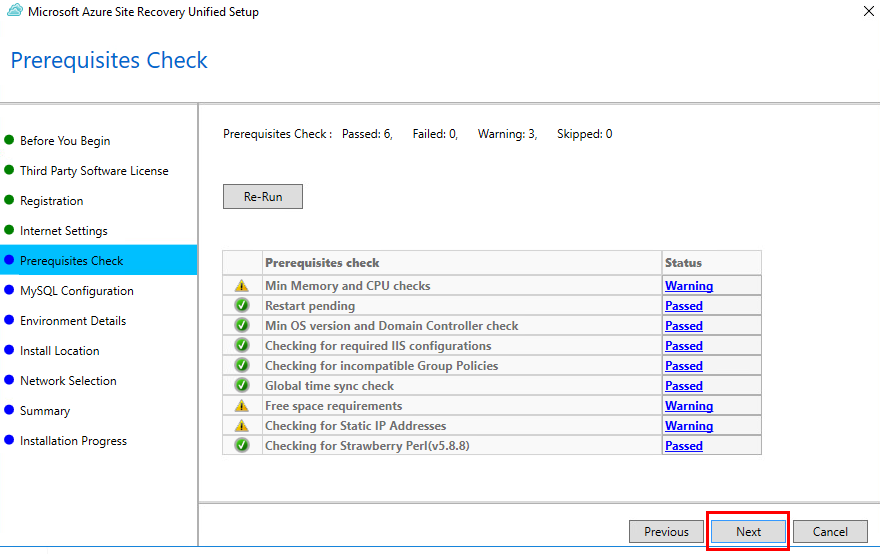

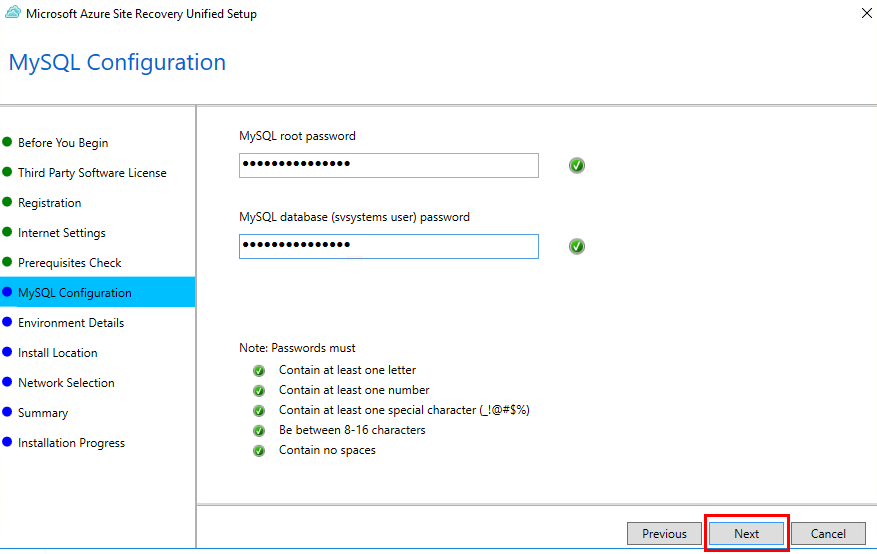

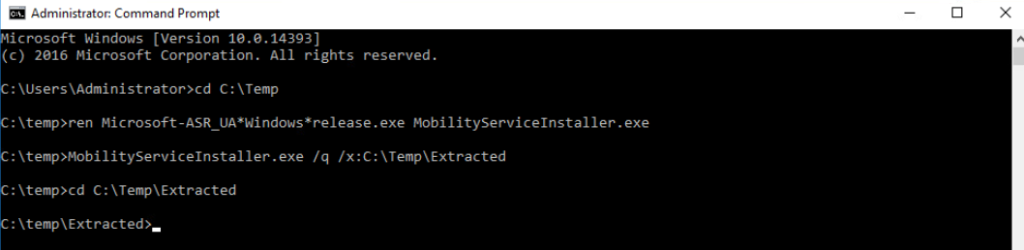

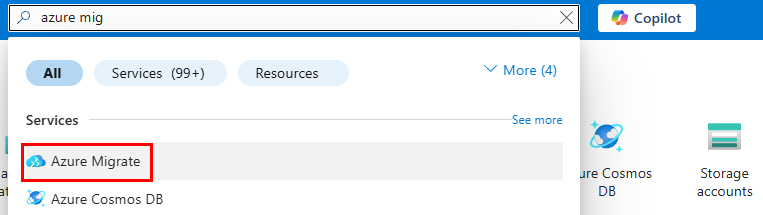

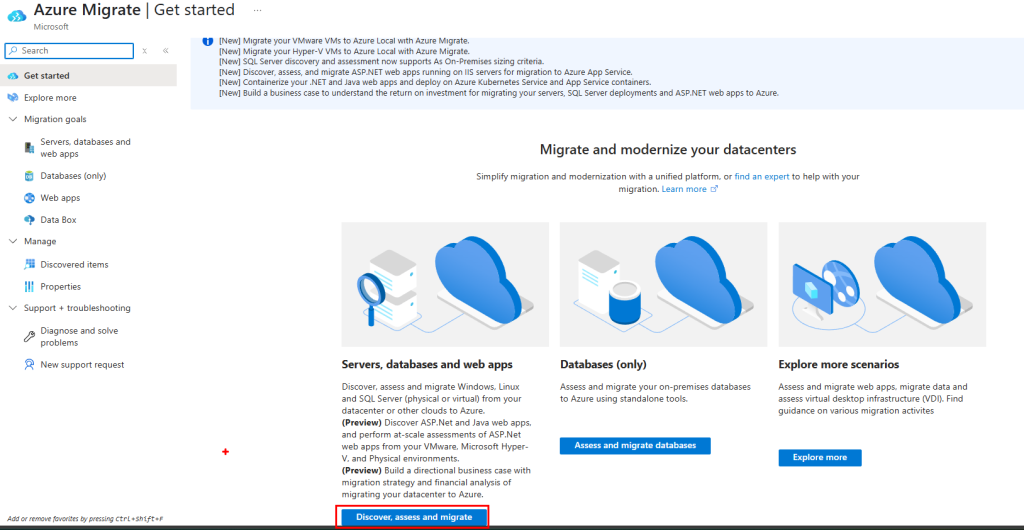

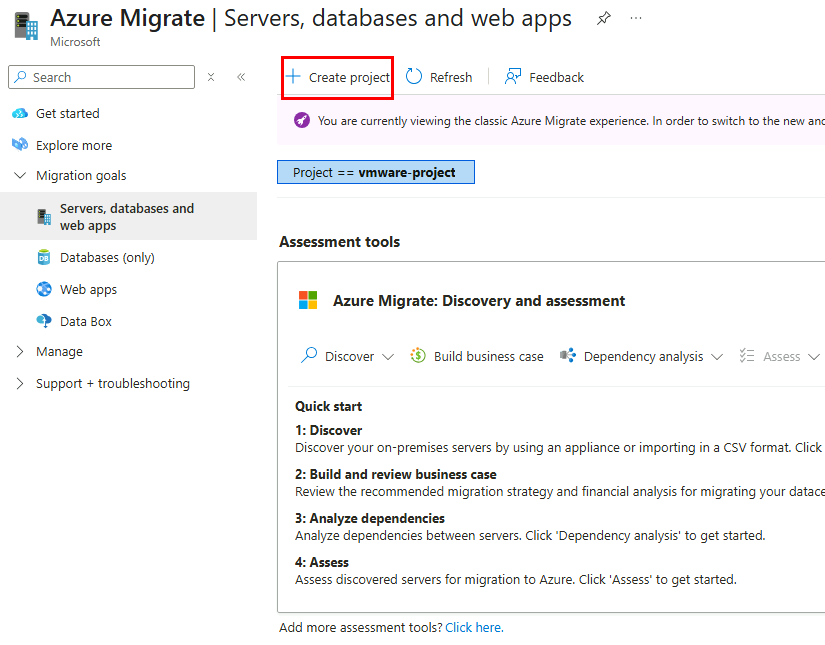

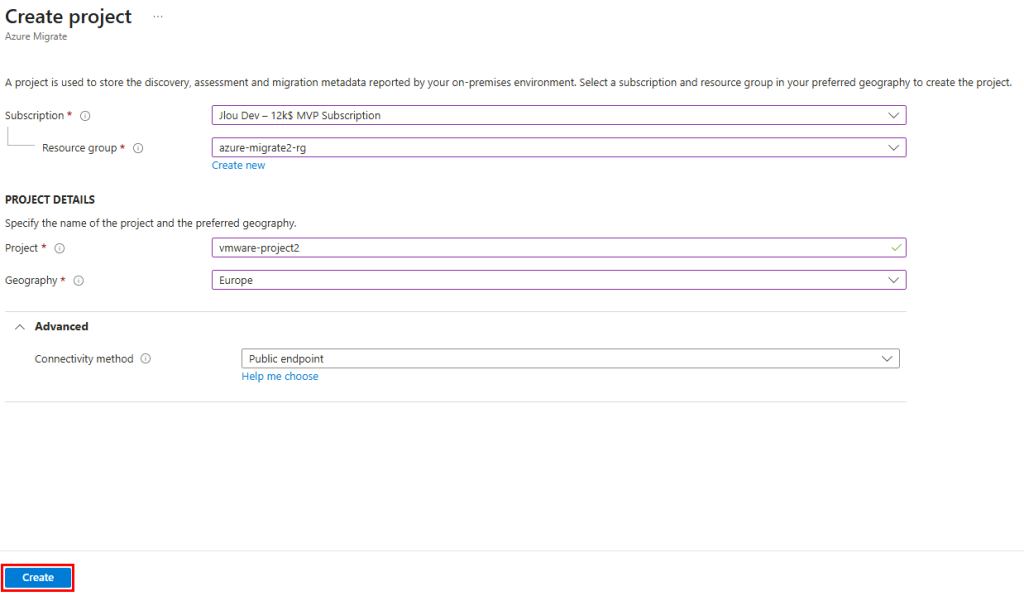

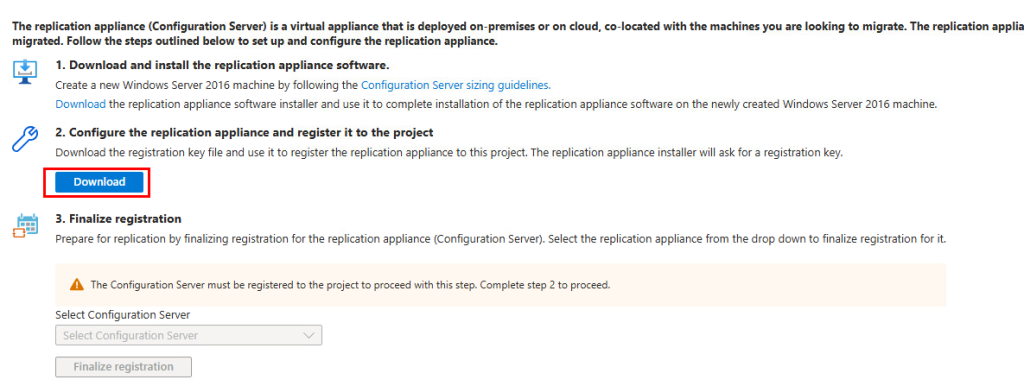

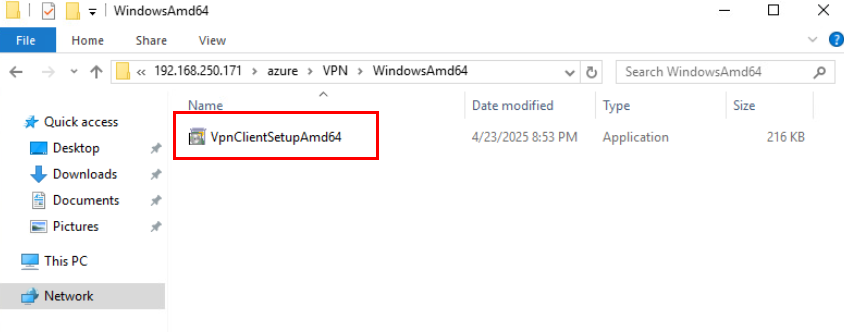

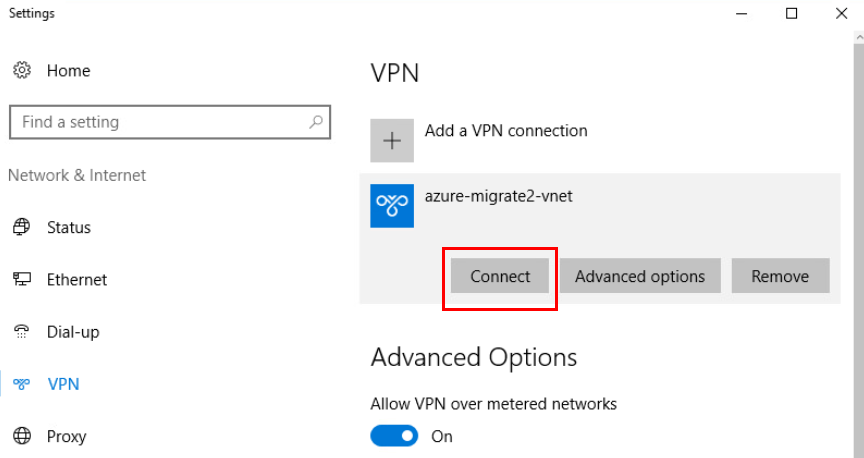

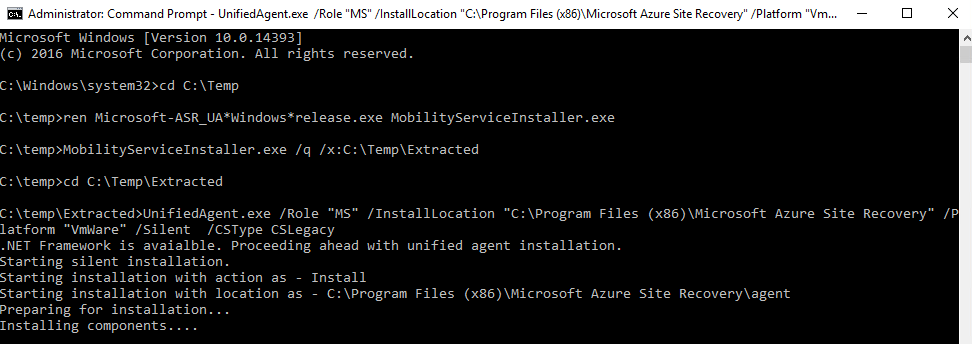

Etape I – Installation de WVDInfra :

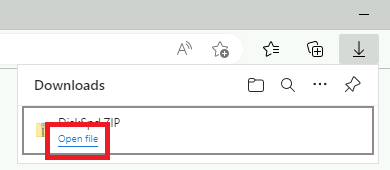

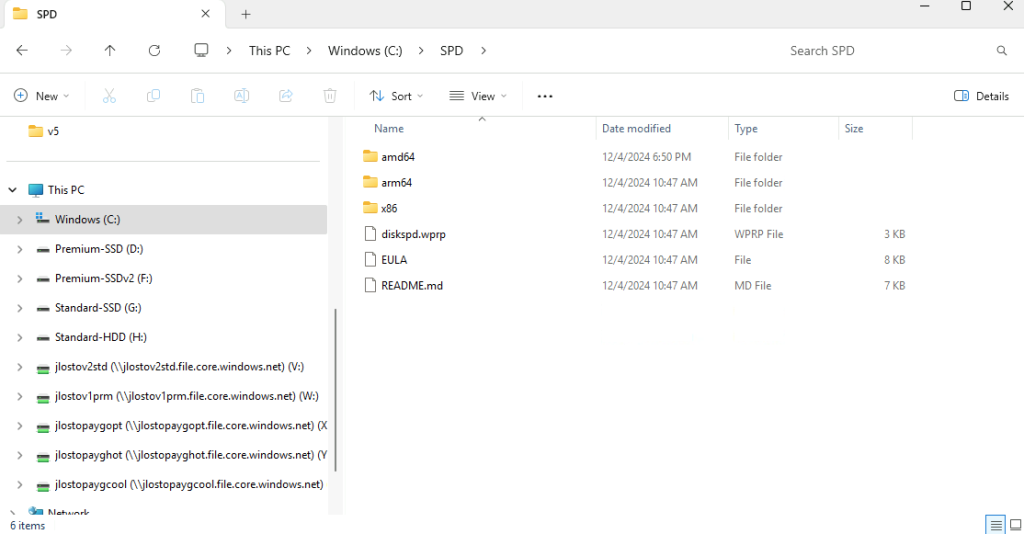

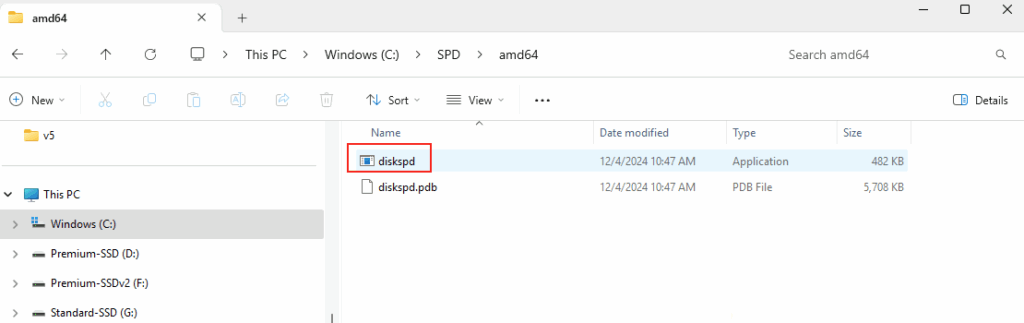

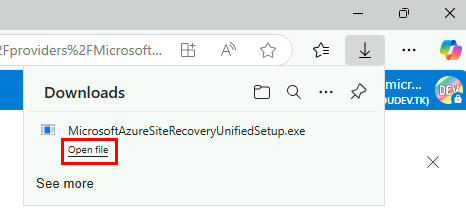

Utilisez la page officielle de WVDAdmin pour accéder au téléchargement :

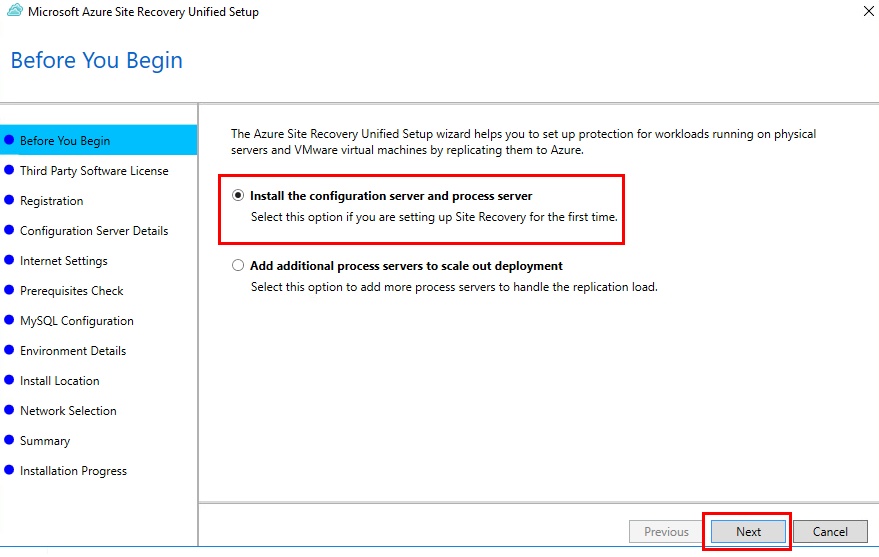

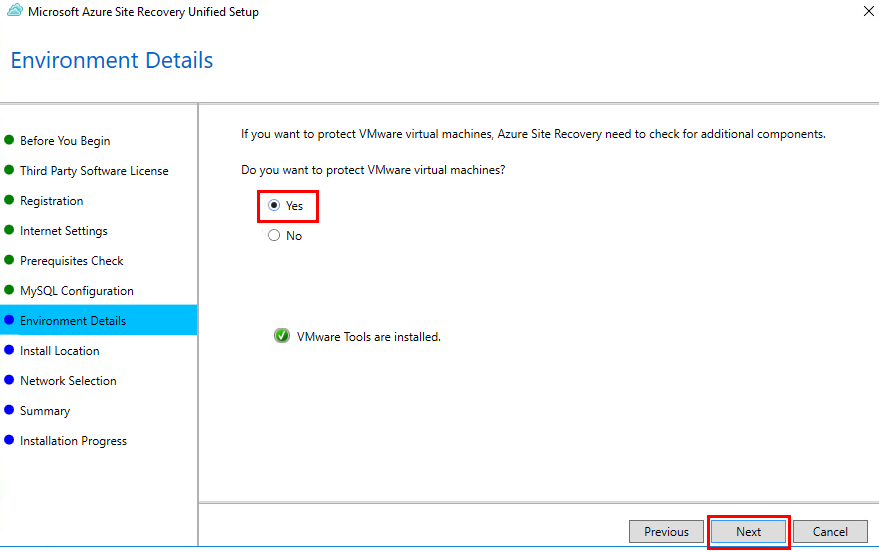

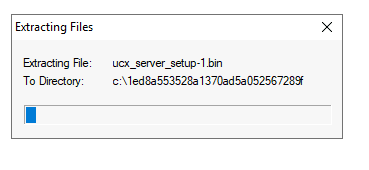

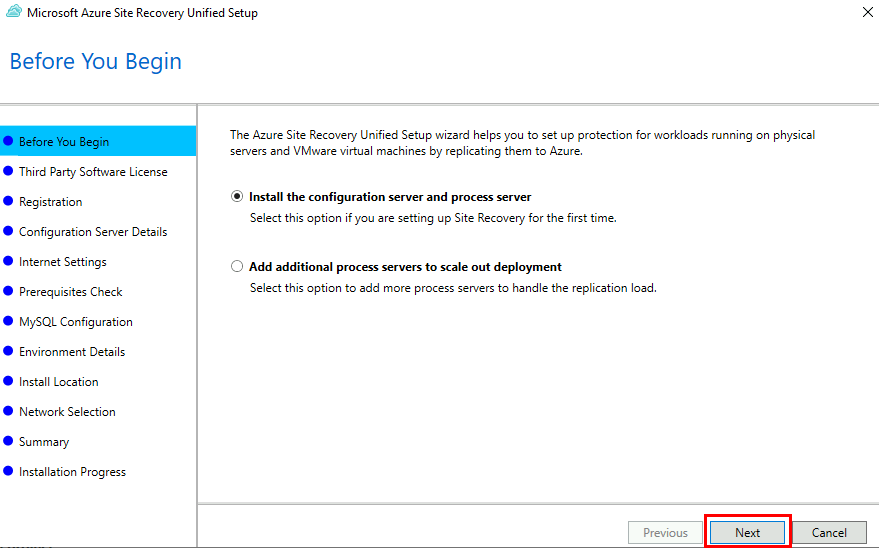

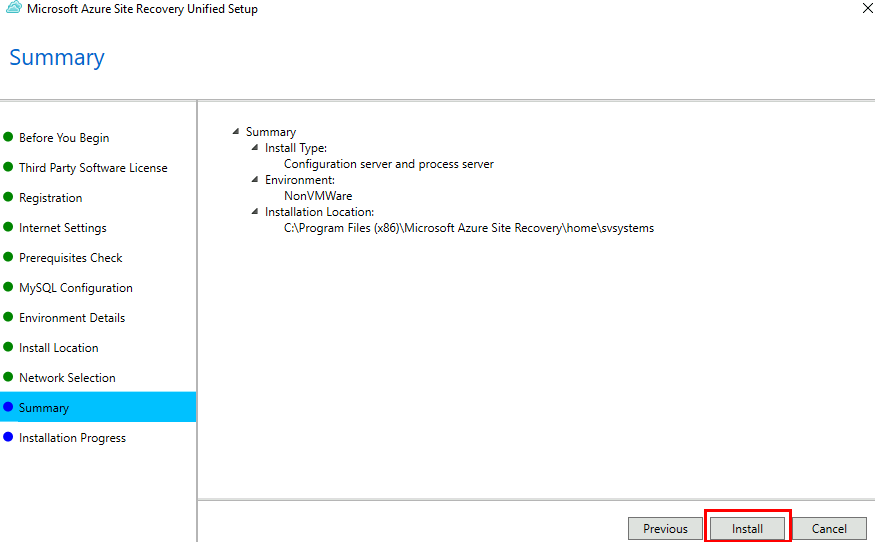

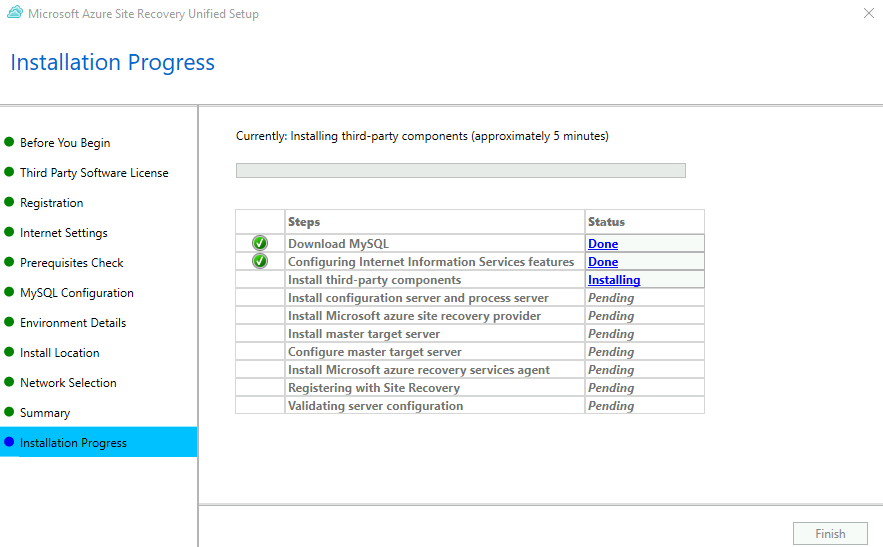

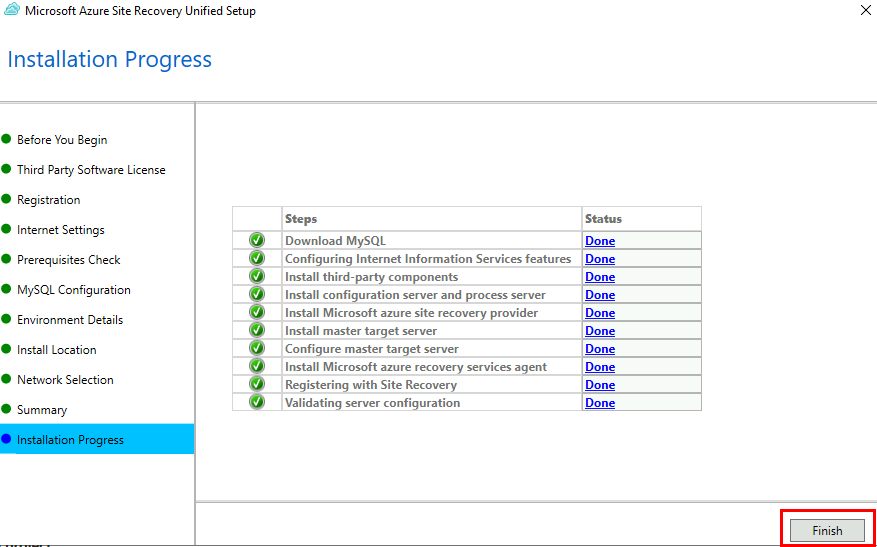

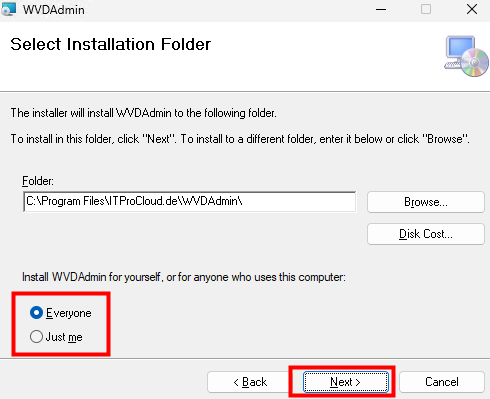

Lancez l’installation en spécifiant le contexte d’utilisation de celle-ci, puis cliquez sur Suivant :

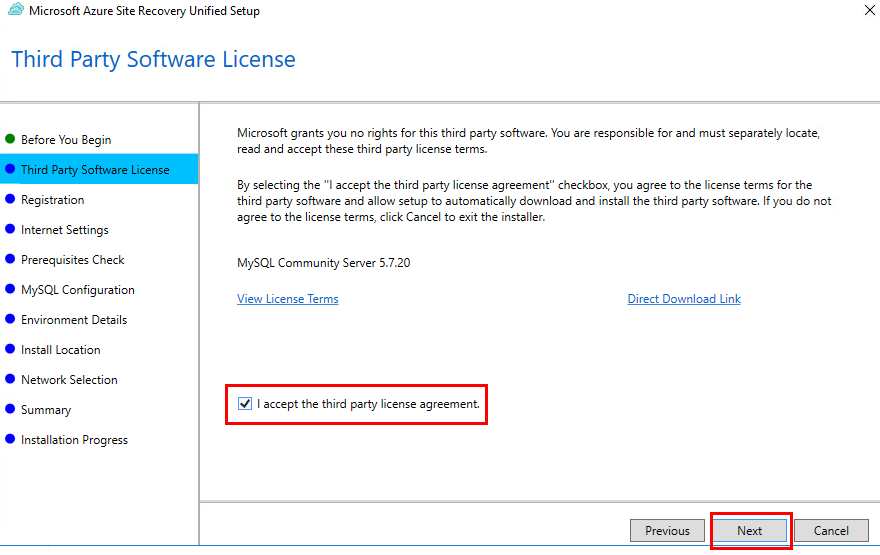

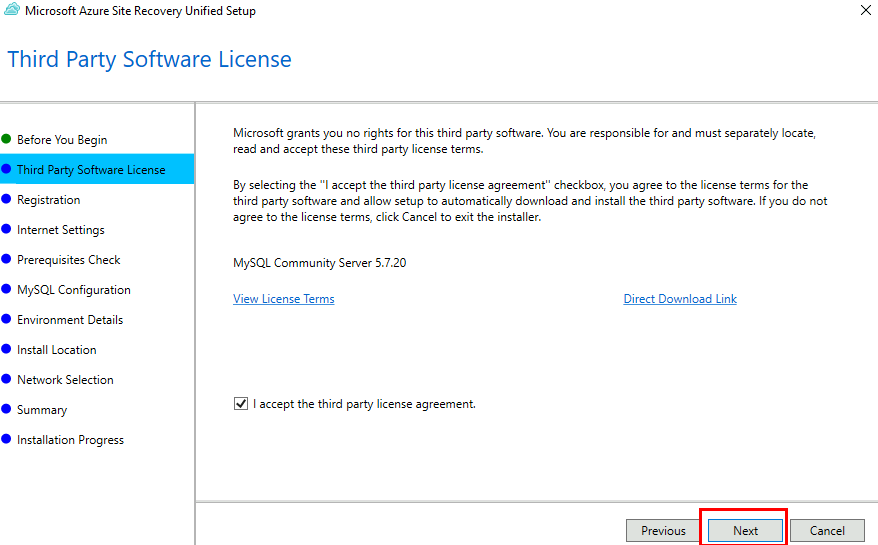

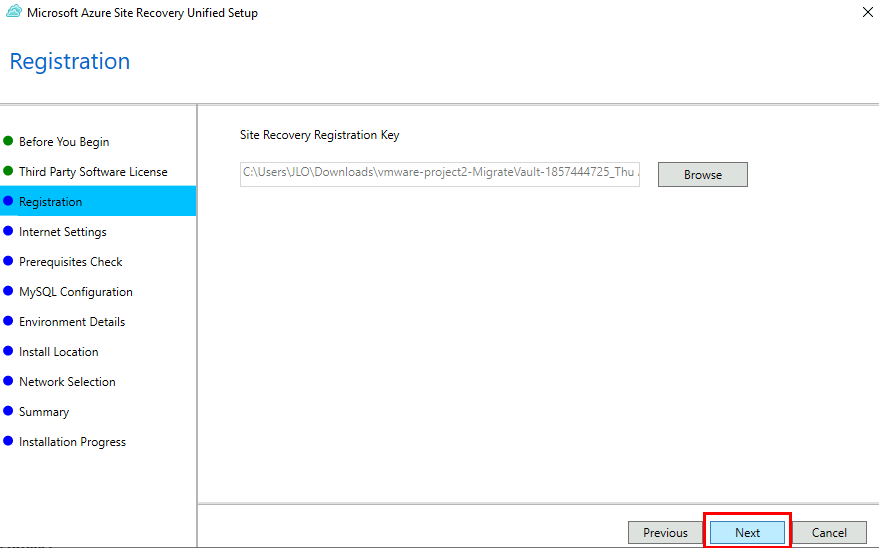

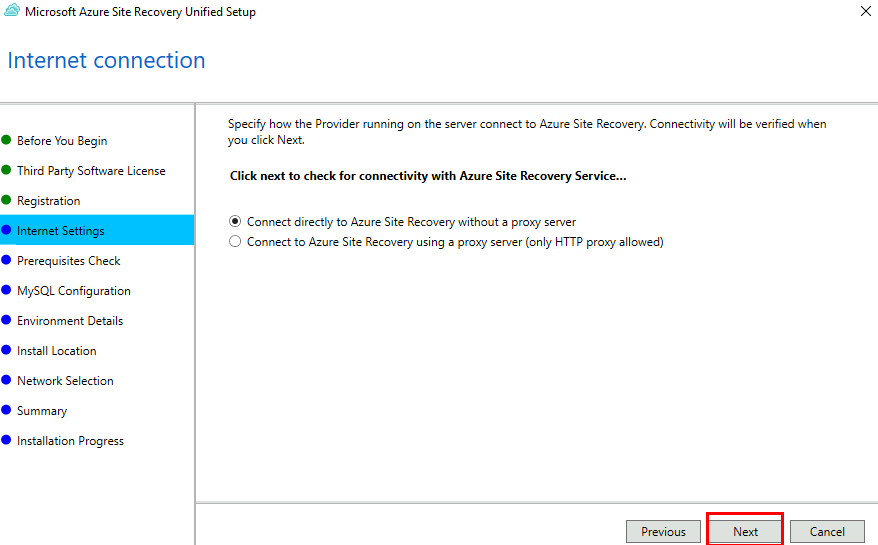

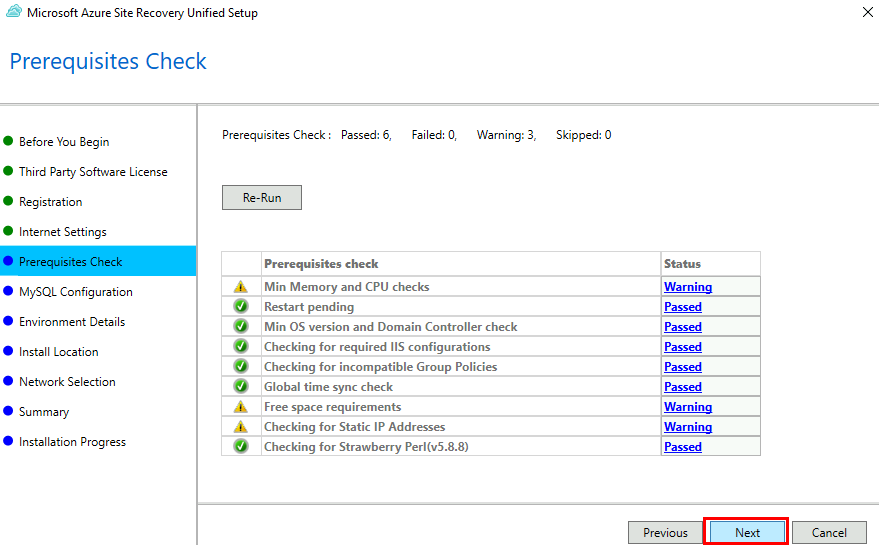

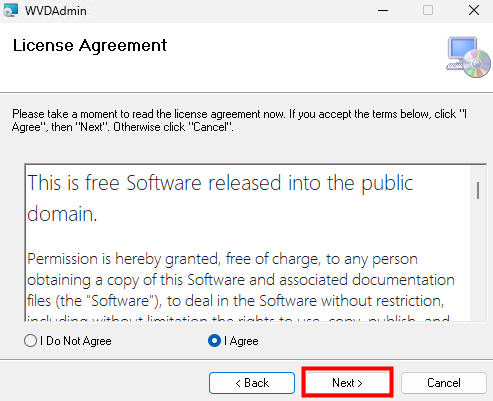

Acceptez les termes et conditions, puis cliquez sur Suivant :

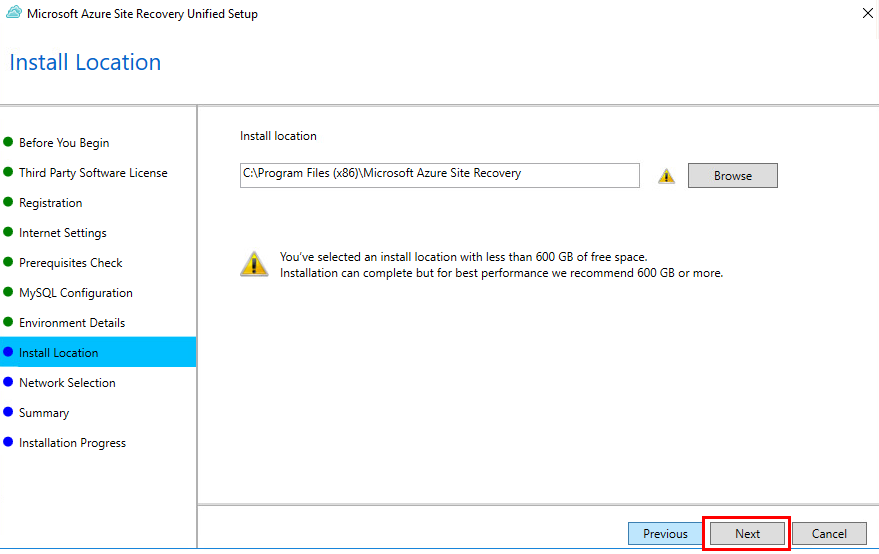

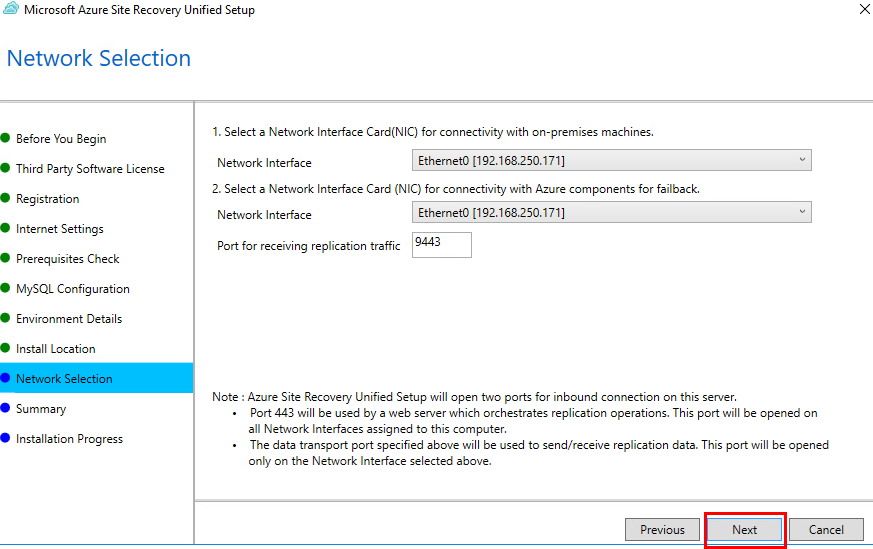

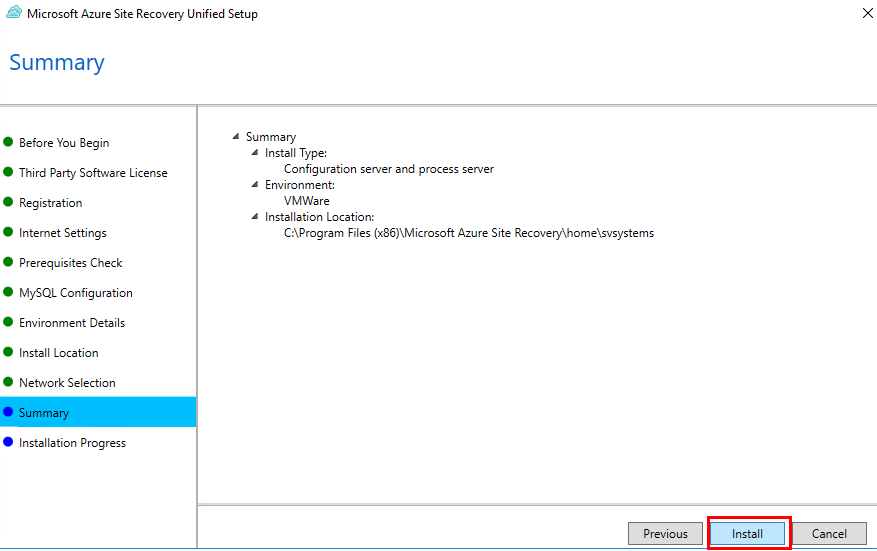

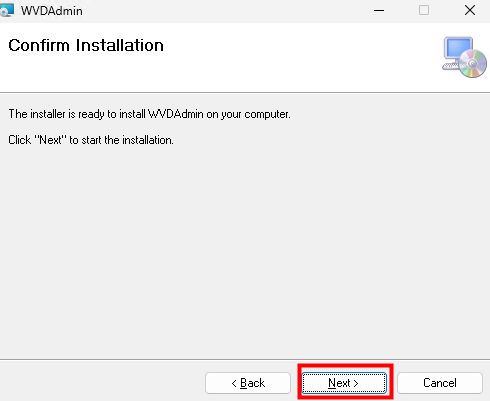

Cliquez sur Suivant pour démarrer l’installation :

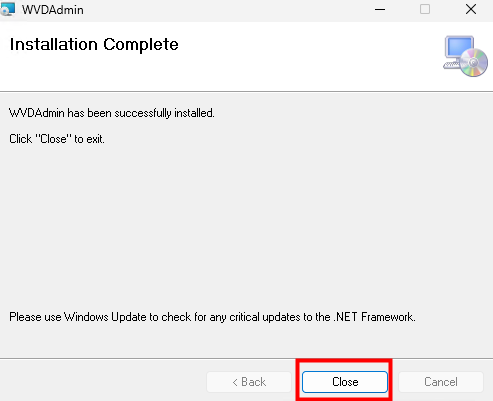

Une fois l’installation réussie, cliquez ici pour fermer :

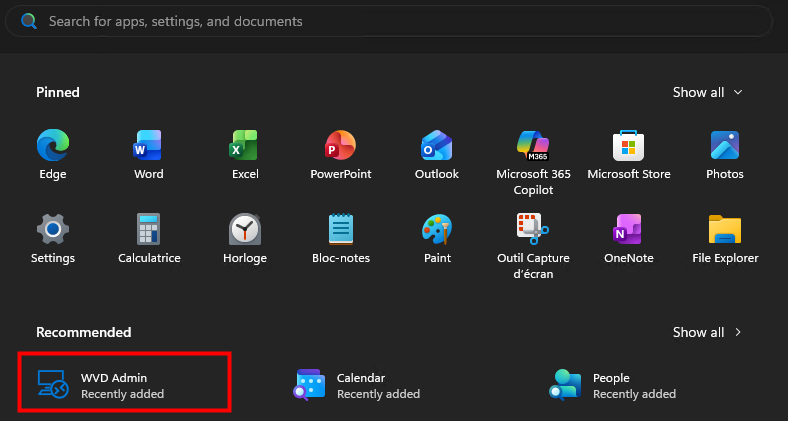

Cliquez sur WVDAdmin présent dans dans le menu Démarrer :

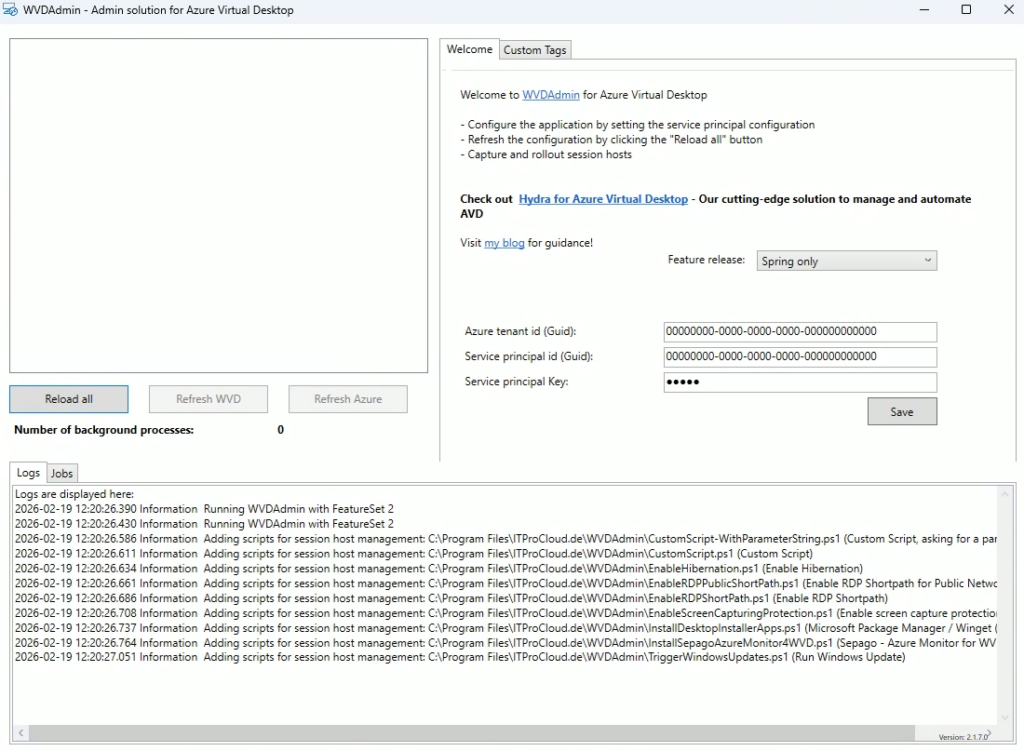

WVDAdmin se charge et n’affiche pour le moment aucune ressource ou information de l’environnement Azure :

Pour cela WVDInfra vous demande les informations suivantes sur l’onglet « Welcome » :

- l’ID de tenant

- le secret client

- l’ID client du principal de service

Mais avant d’aller plus loin, il est nécessaire de configurer ce nouveau principal de service sur votre tenant afin de donner à WVDInfra un moyen de s’y authentifier :

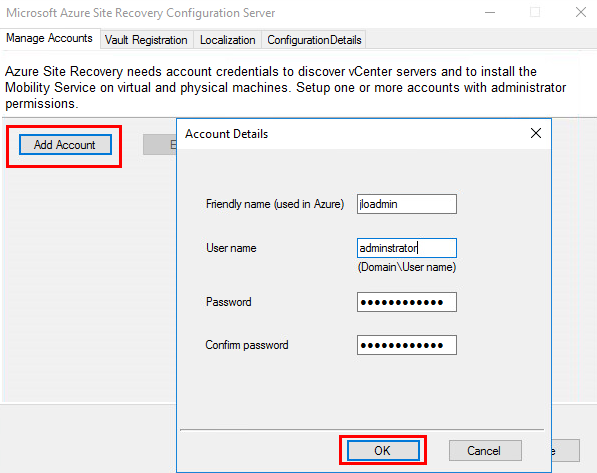

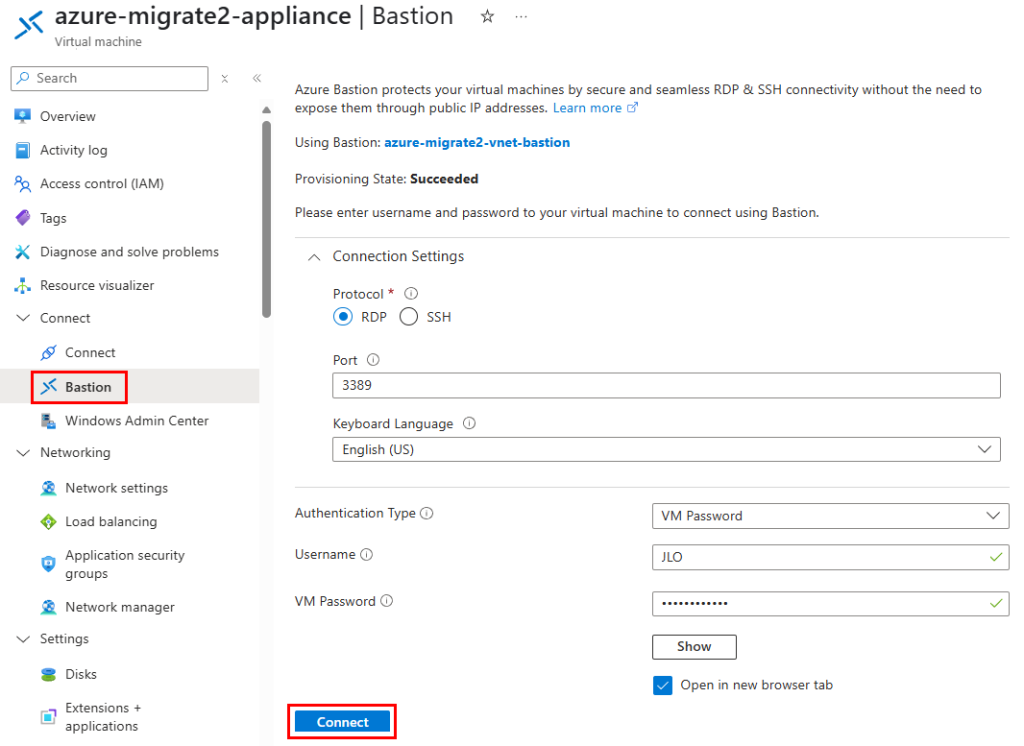

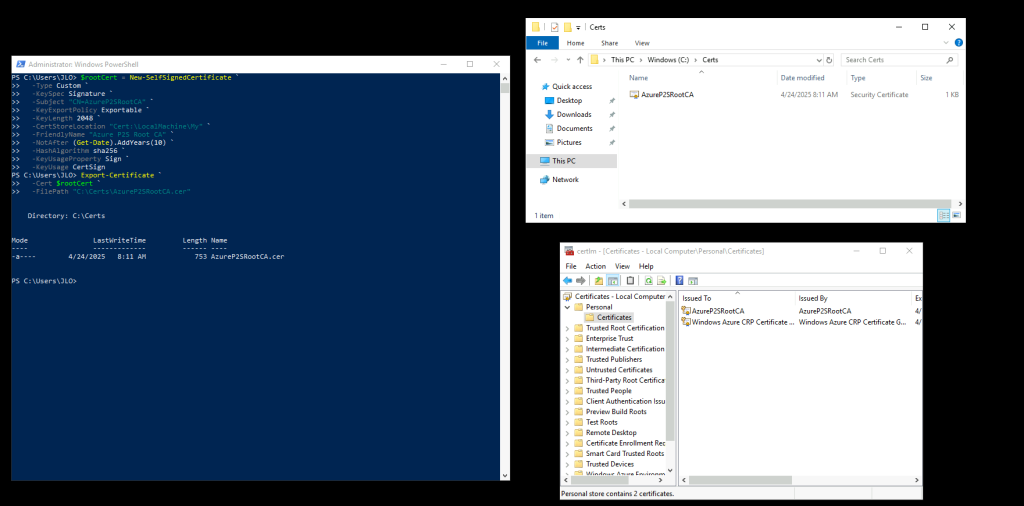

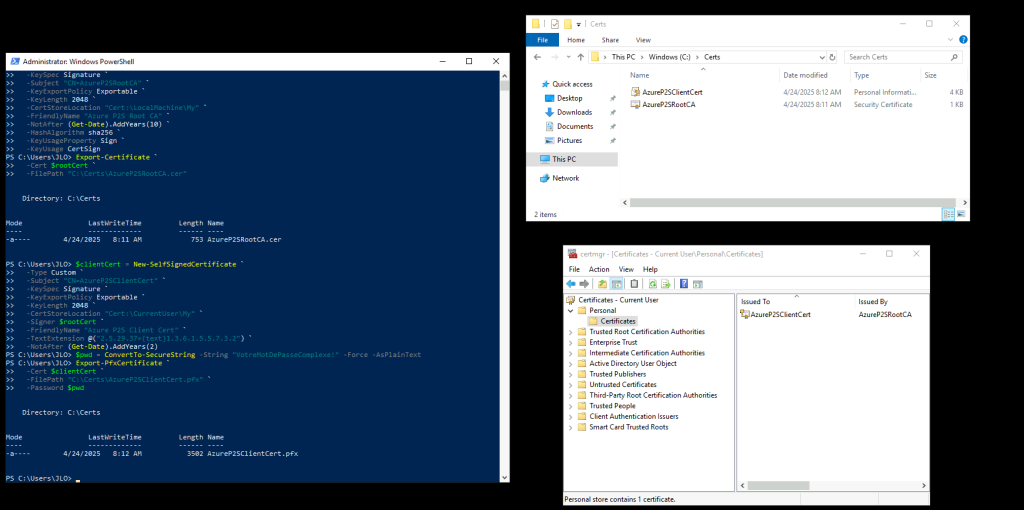

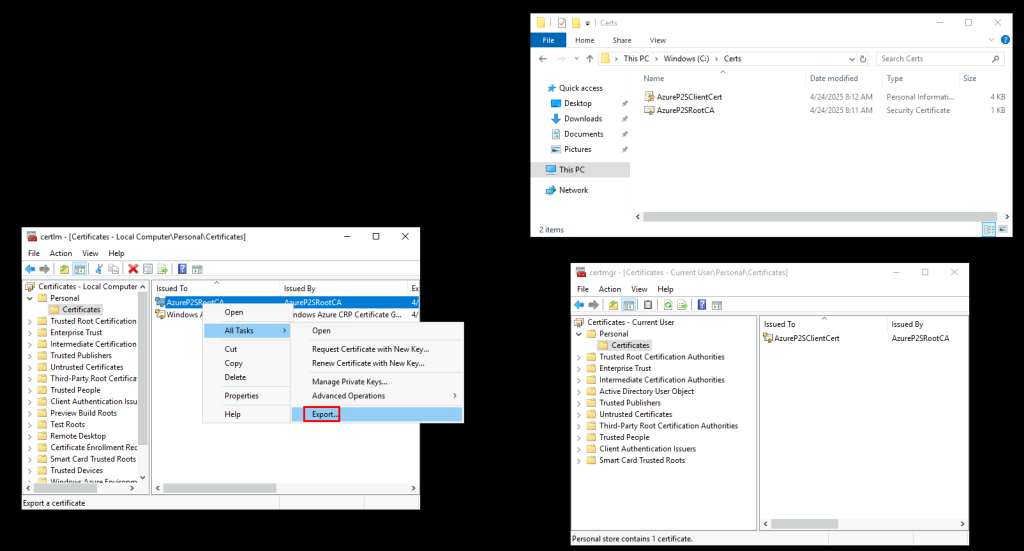

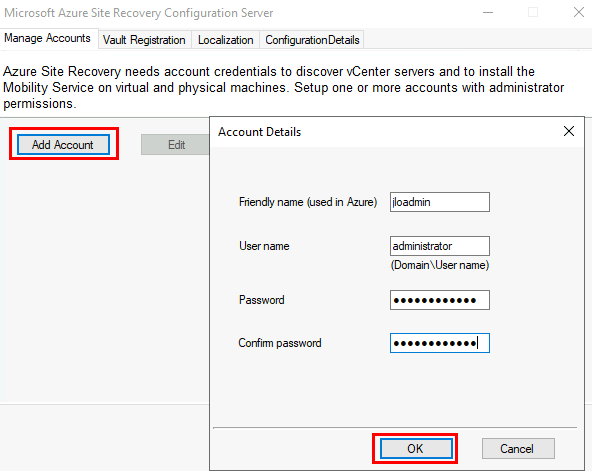

Etape II – Configuration Entra :

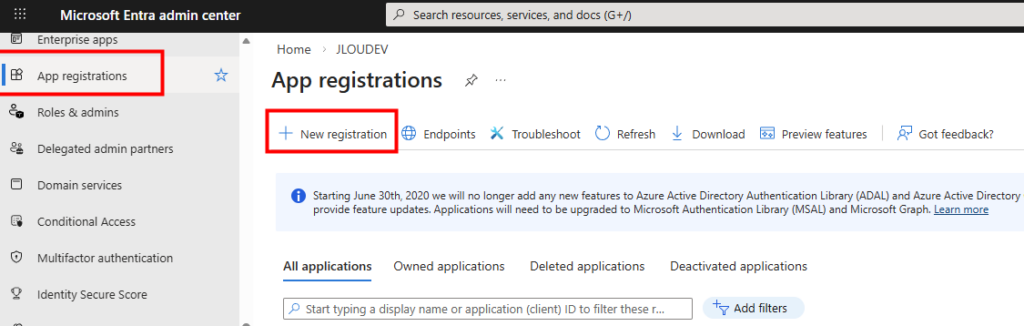

La création du principal de service via le centre d’administration Entra :

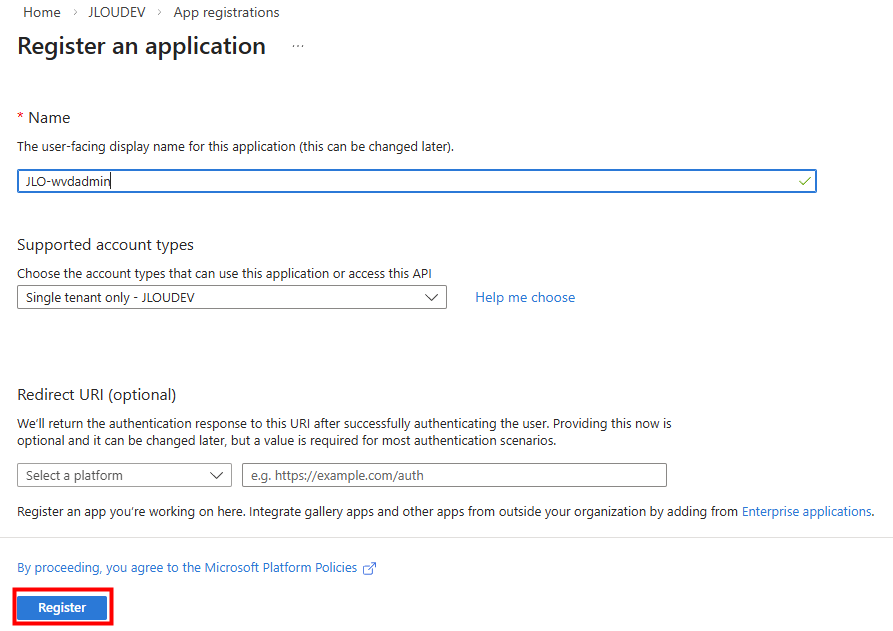

Nommez votre application, puis cliquez ici :

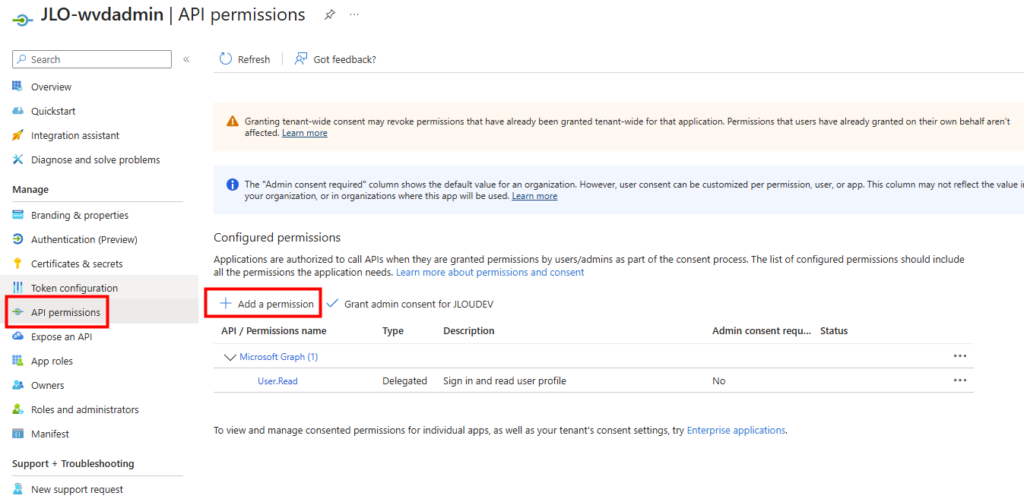

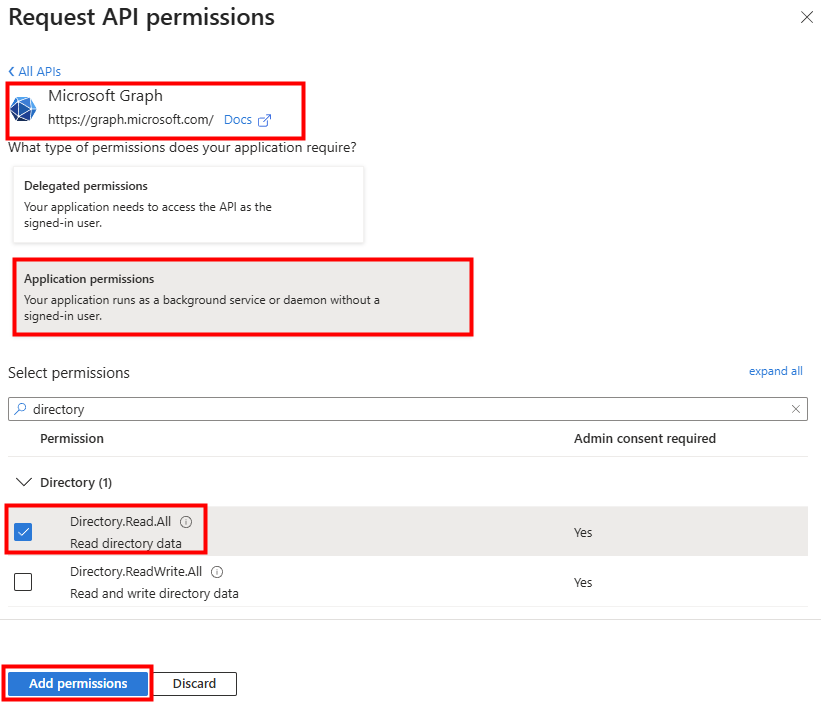

Pour permettre la résolution des utilisateurs et groupes, des permissions doivent être rajoutées :

Cherchez la permission suivante, puis cliquez sur Ajouter :

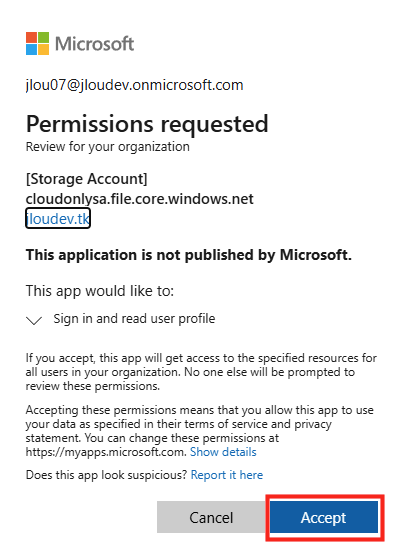

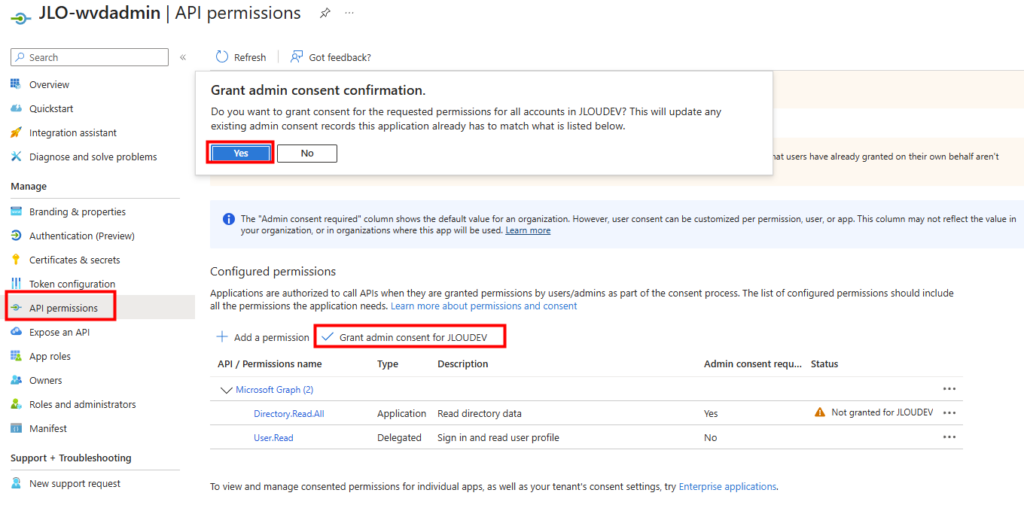

WVDInfra a besoin d’un consentement administration afin d’accorder les permissions demandées au nom de toute l’organisation :

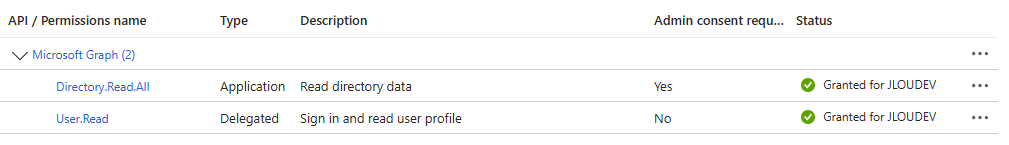

Vérifiez le changement de statut des permissions :

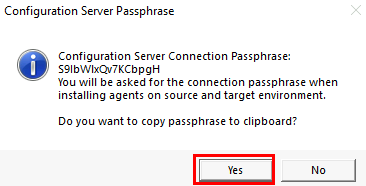

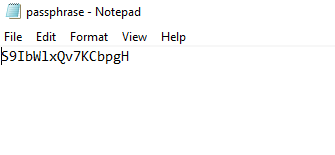

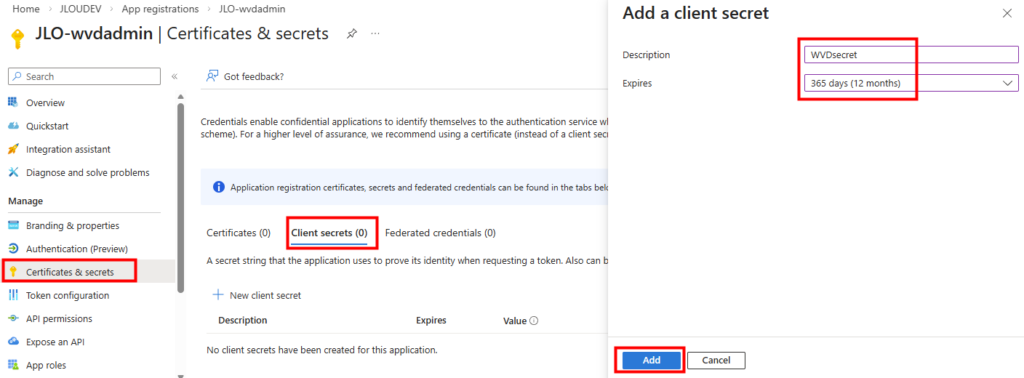

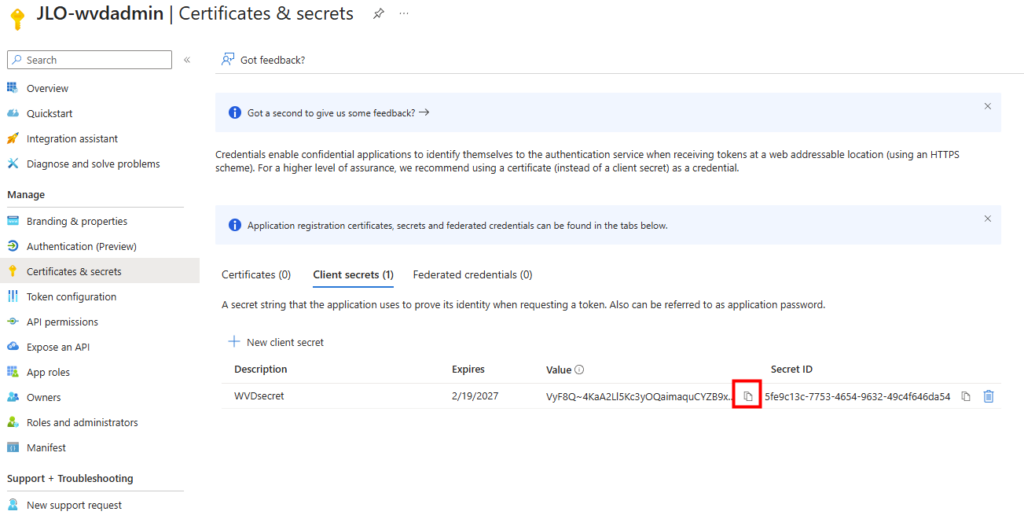

Le client secret est l’équivalent d’un mot de passe pour l’application. Il sert à authentifier l’application lorsqu’elle demande un token OAuth à Microsoft Entra ID. Ajoutez un secret à votre application WVDInfra :

Copiez la valeur de votre secret immédiatement lors de sa création, car il ne sera plus affiché par la suite :

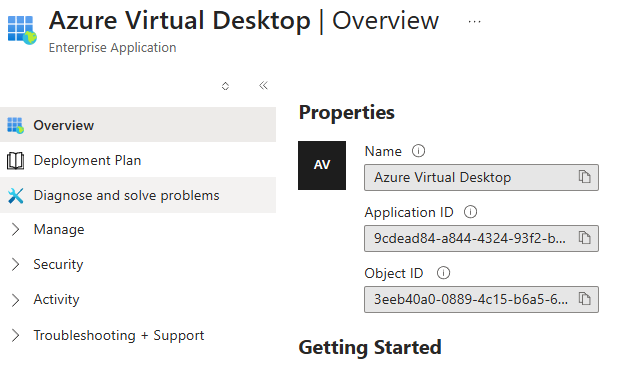

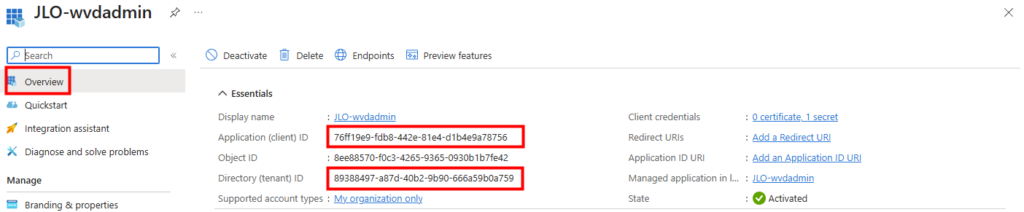

L’ID d’application (client) et l’ID du tenant doivent être conservés pour la suite :

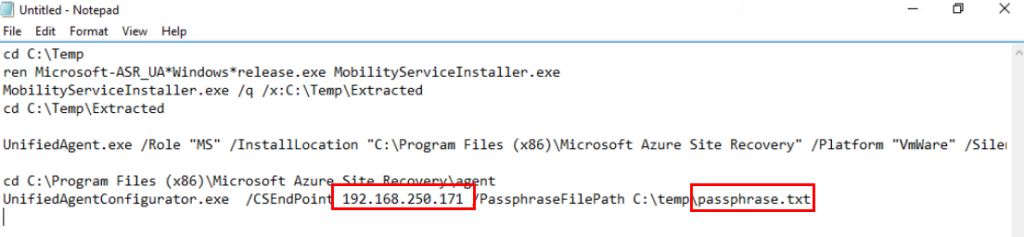

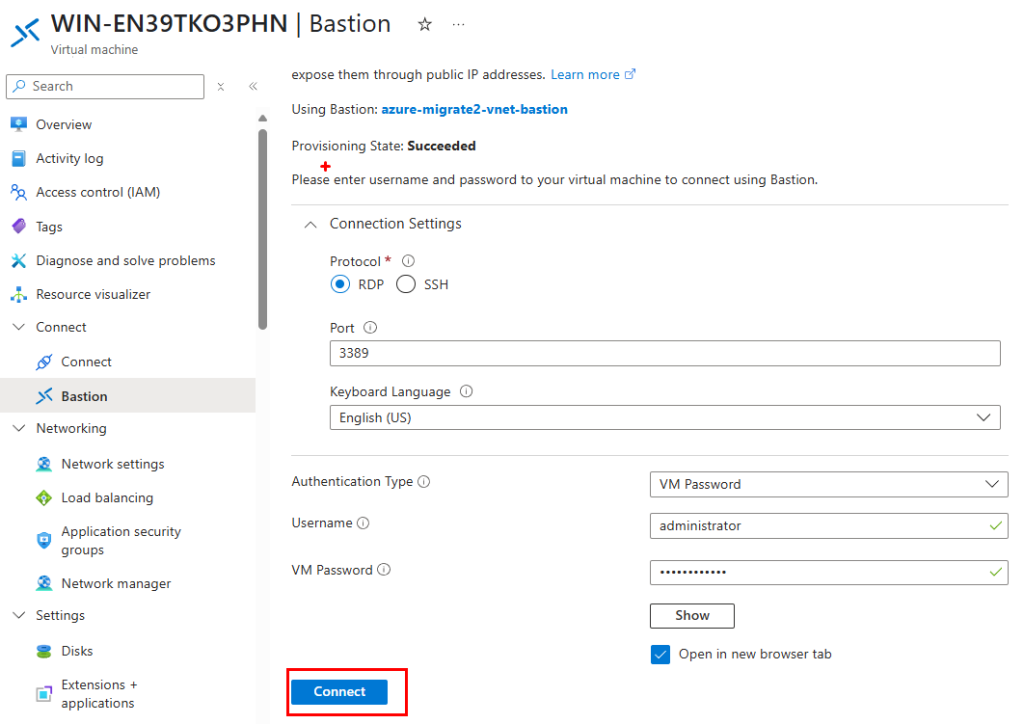

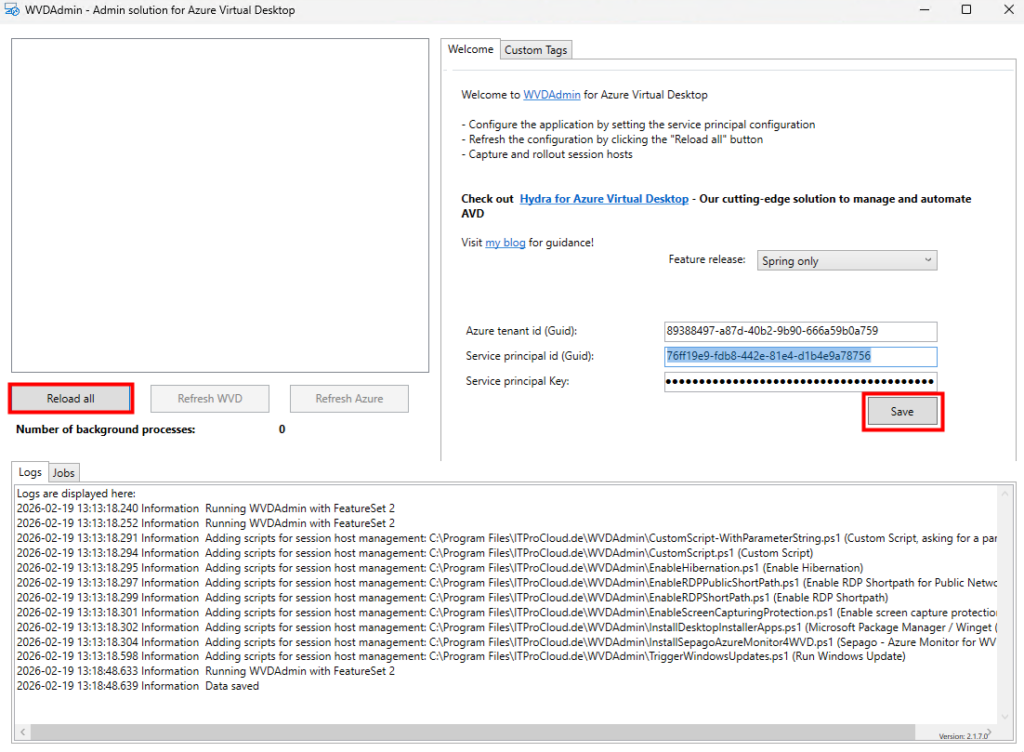

Collez ces trois valeurs dans l’interface de WVDInfra, sauvegardez, puis lancez un rechargement de l’inventaire :

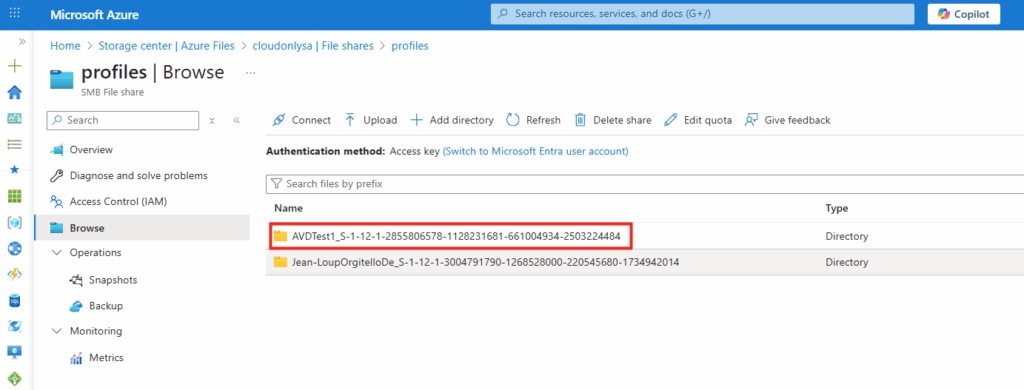

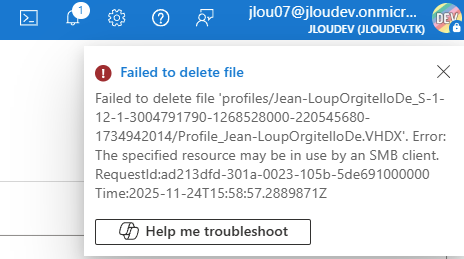

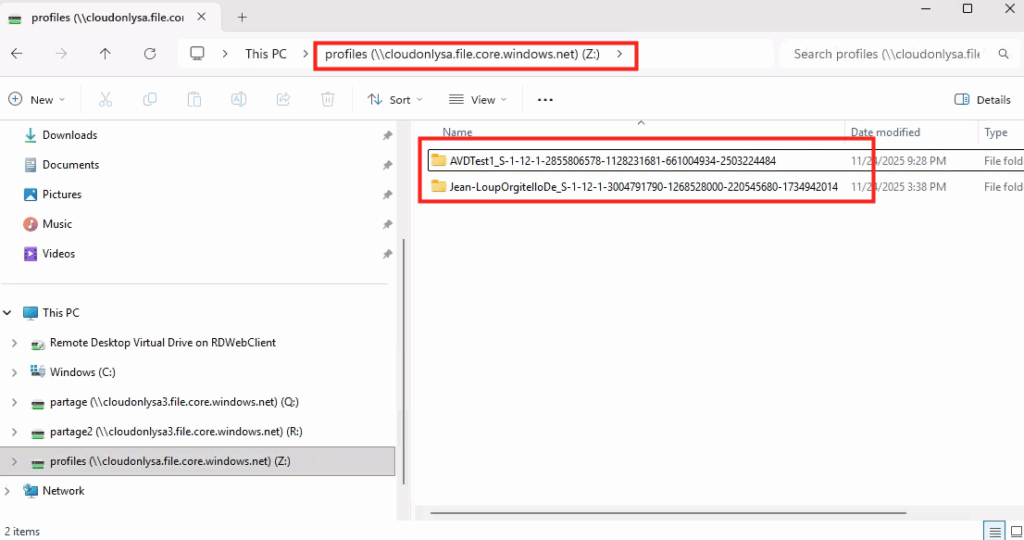

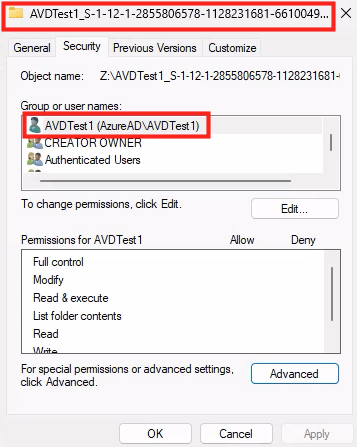

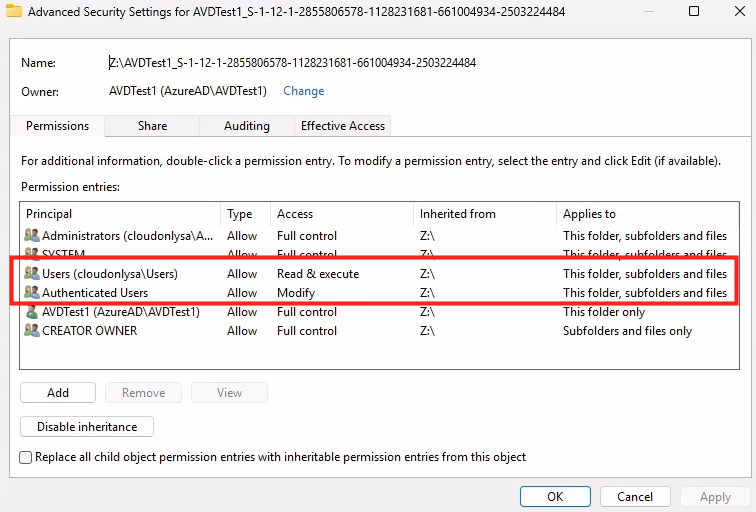

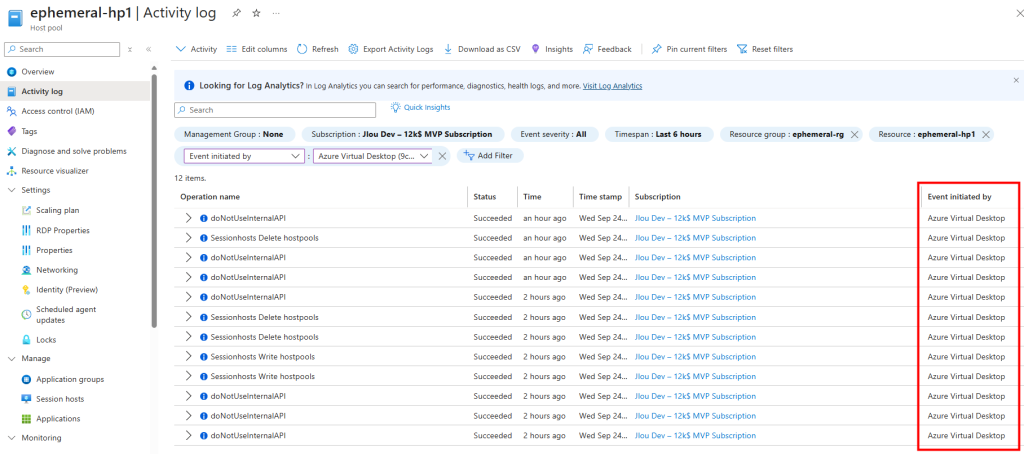

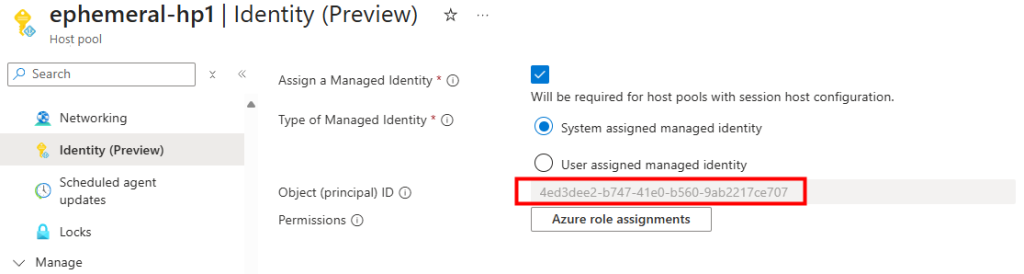

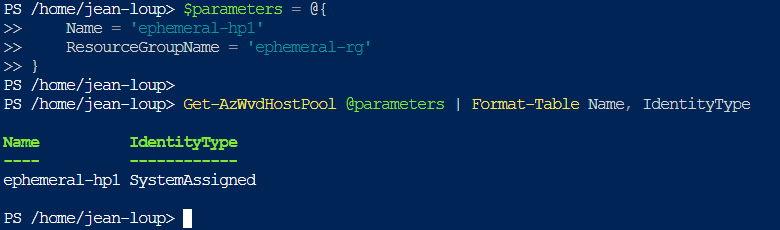

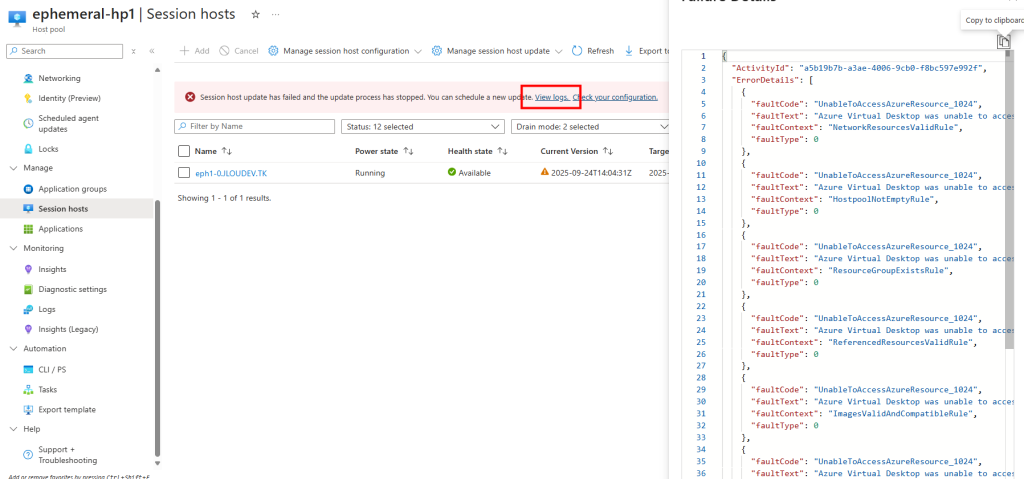

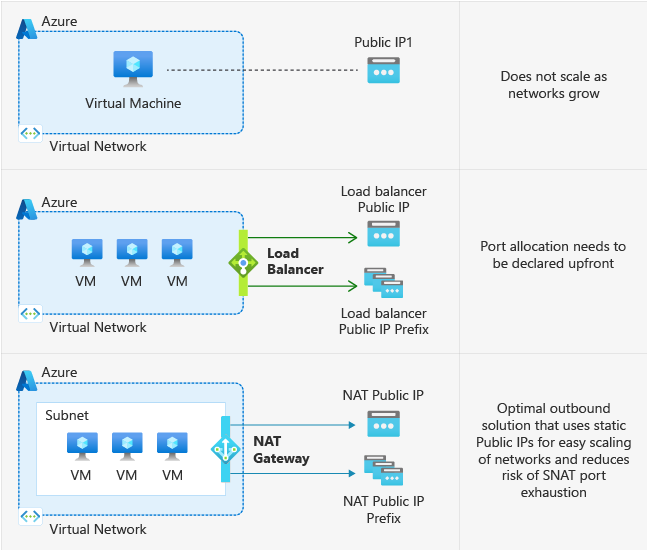

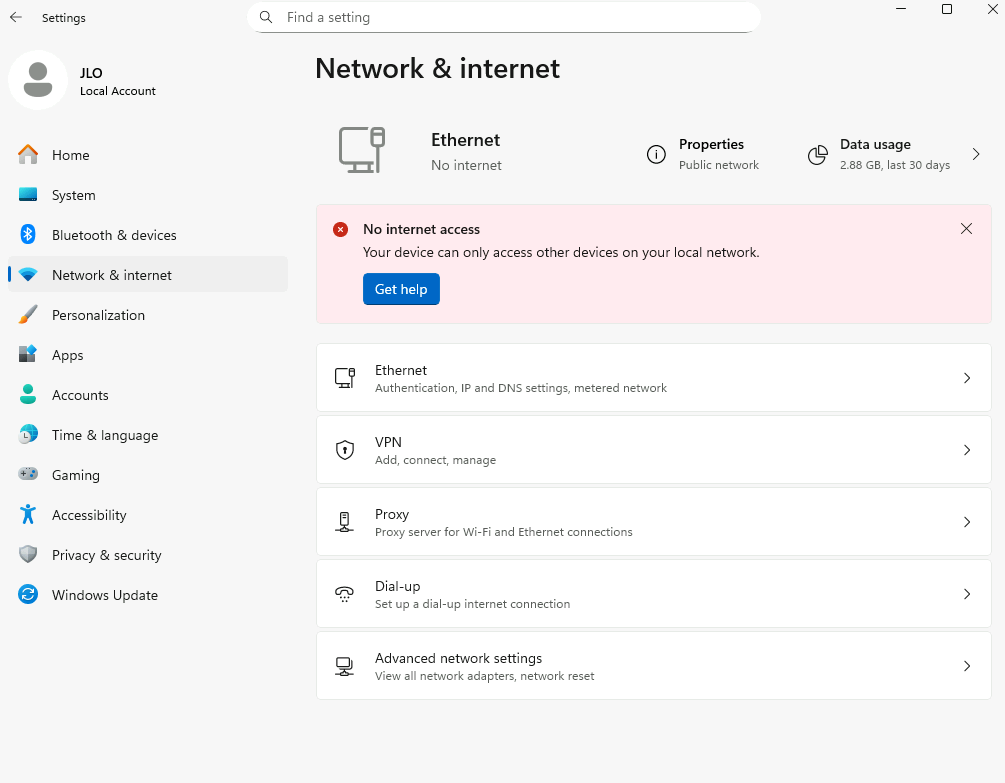

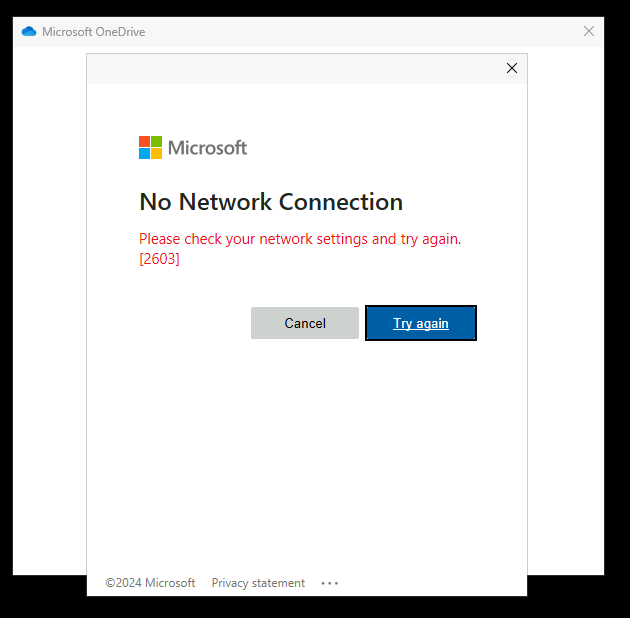

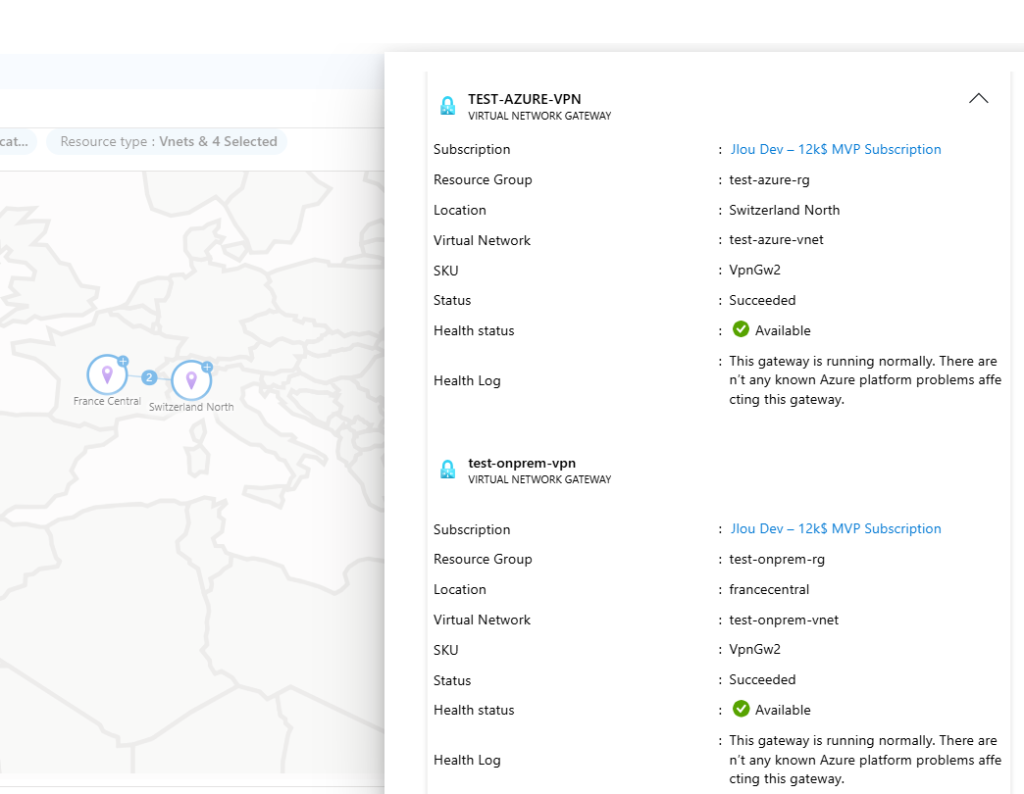

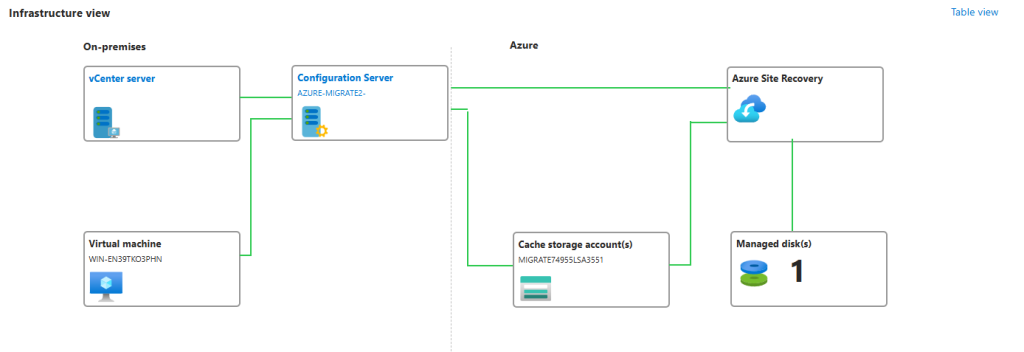

A ce stade, WVDInfra a bien accès au tenant mais pas encore au ressource Azure :

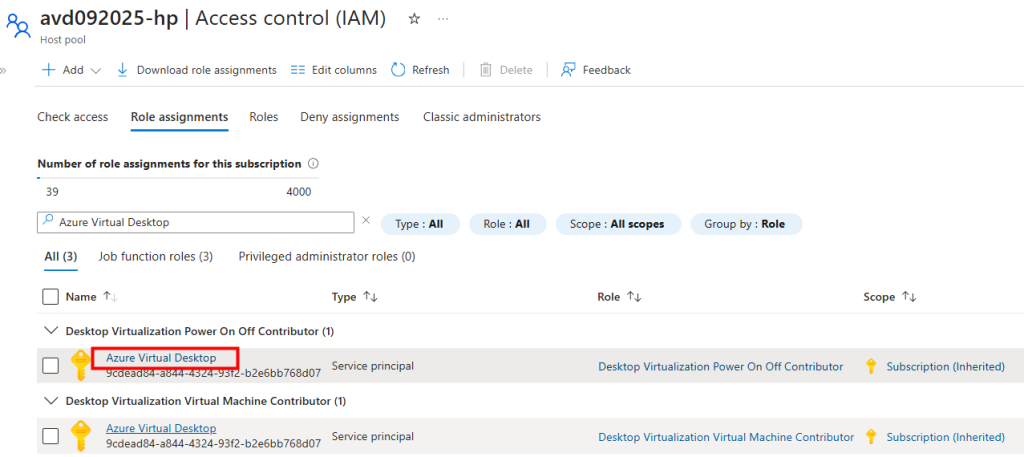

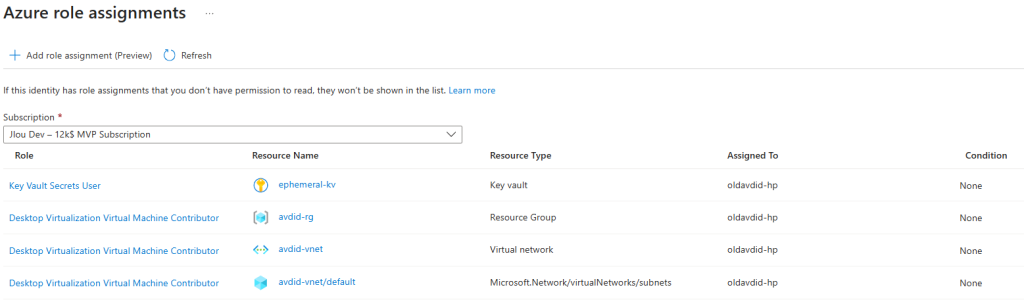

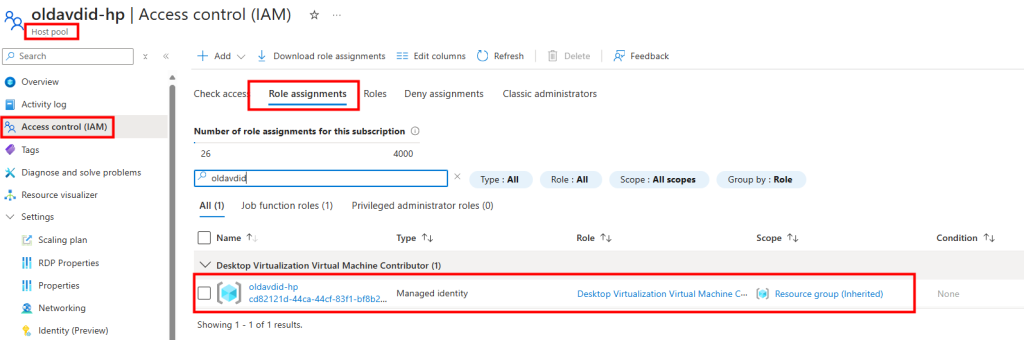

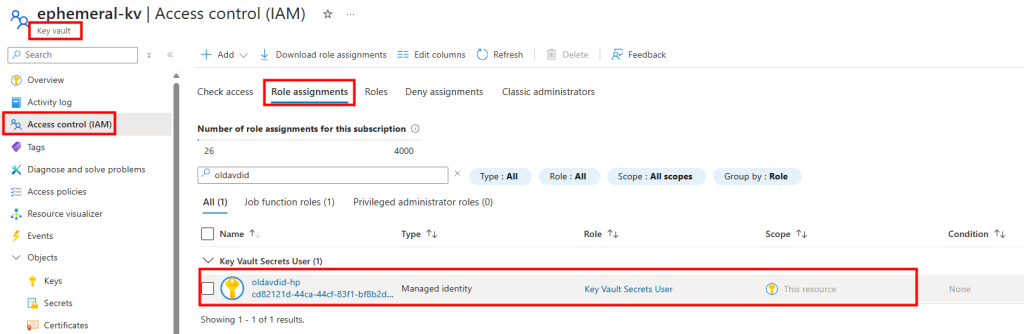

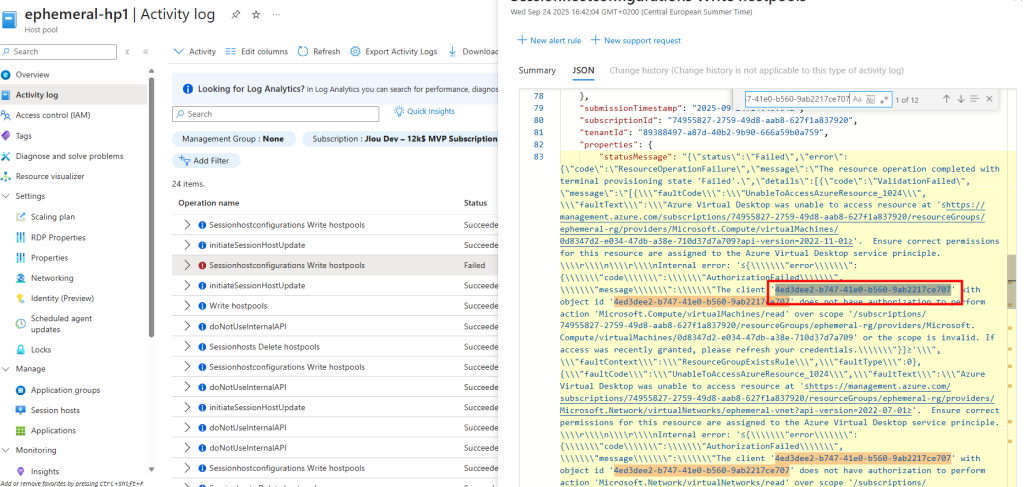

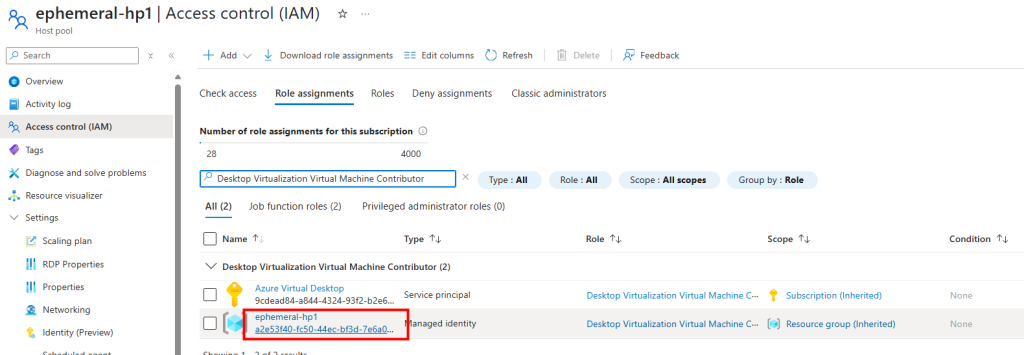

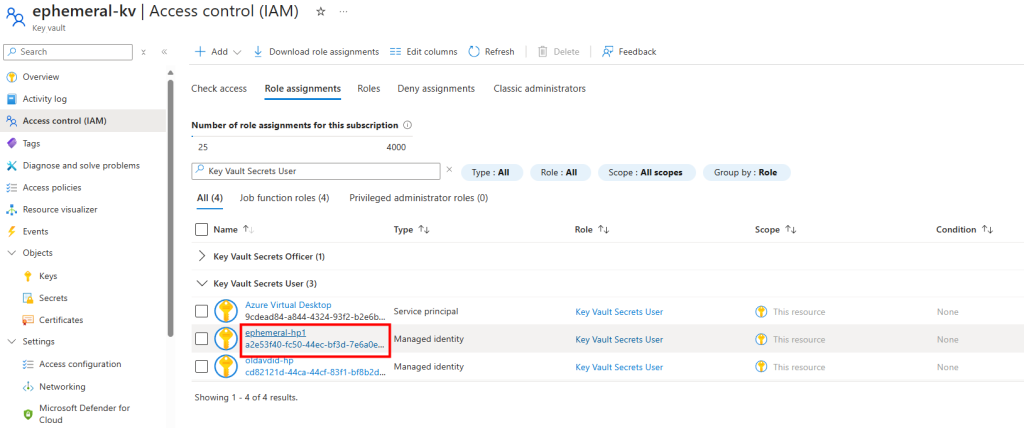

En l’état, l’application WVDInfra a le service principal, avec qui il peut s’authentifier avec son client ID et son secret, mais n’a par défaut aucun droit sur les ressources Azure. Il peut demander un token, mais ce token ne lui permet rien tant qu’on ne lui attribue pas un rôle RBAC.

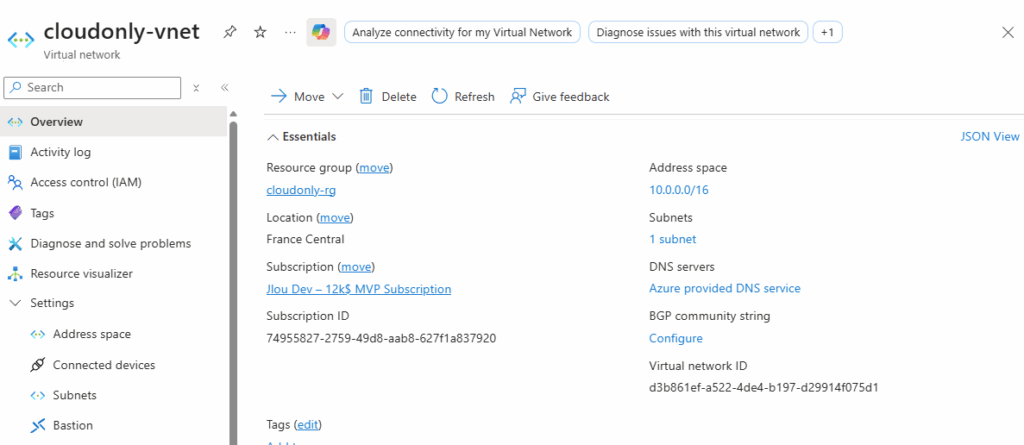

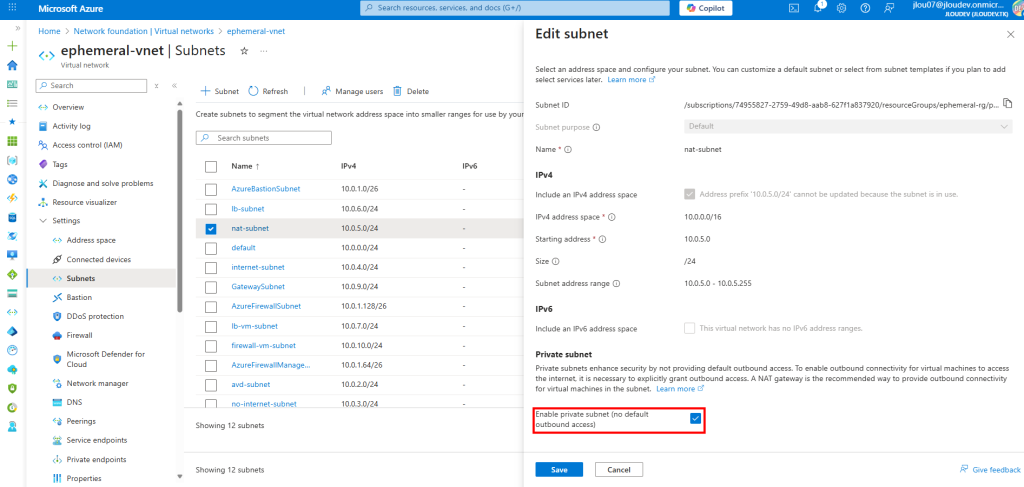

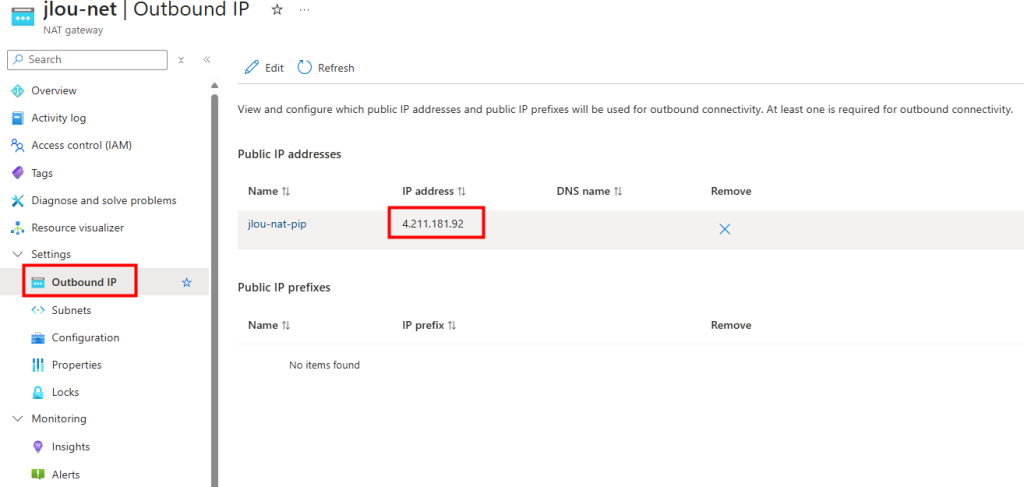

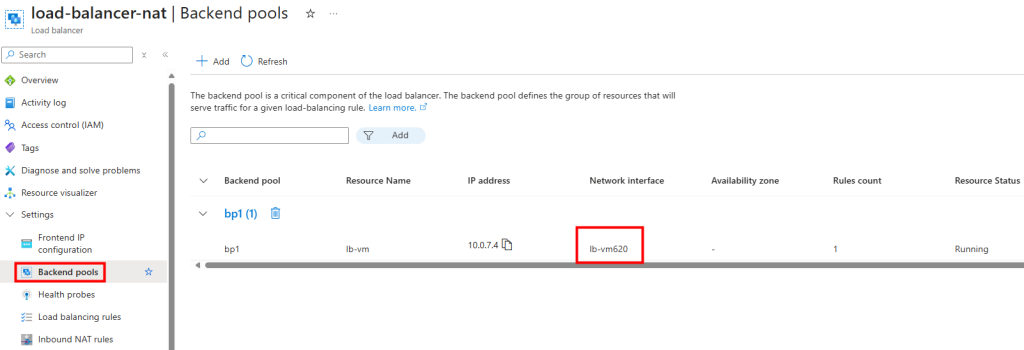

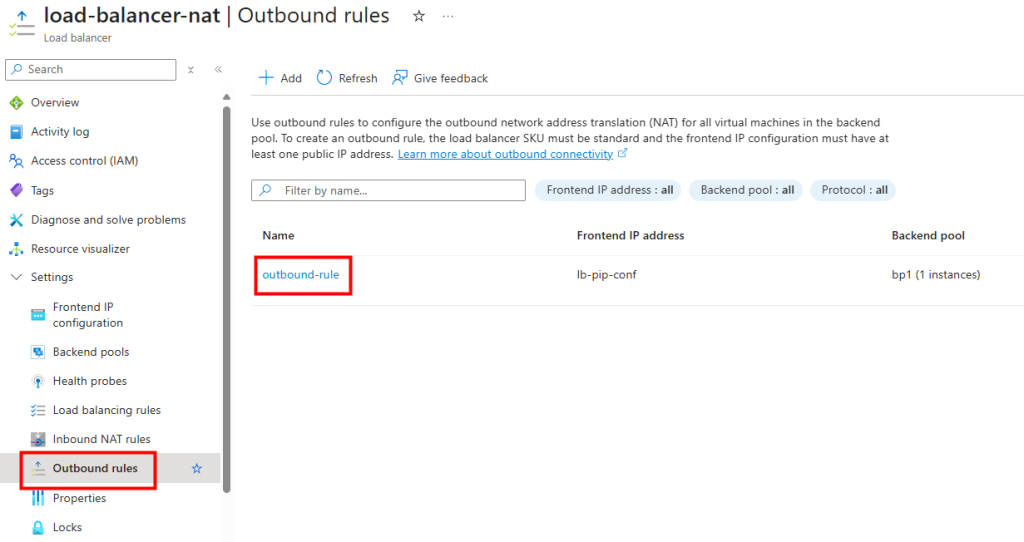

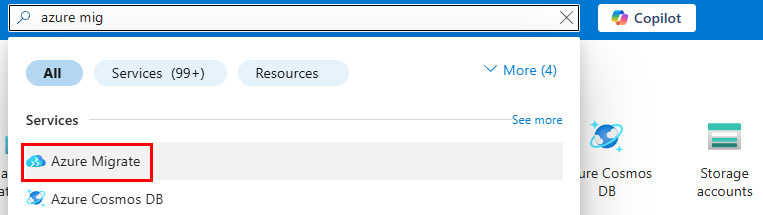

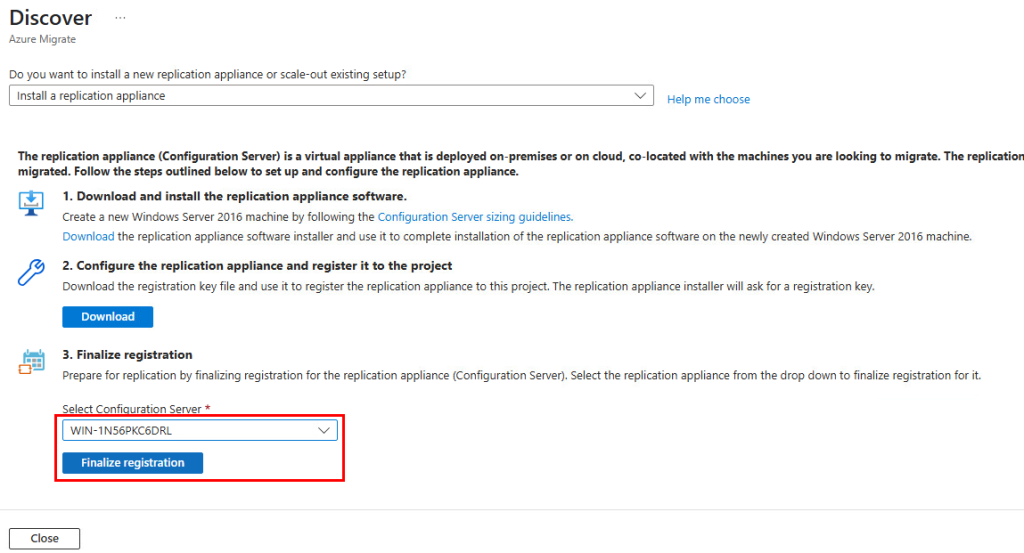

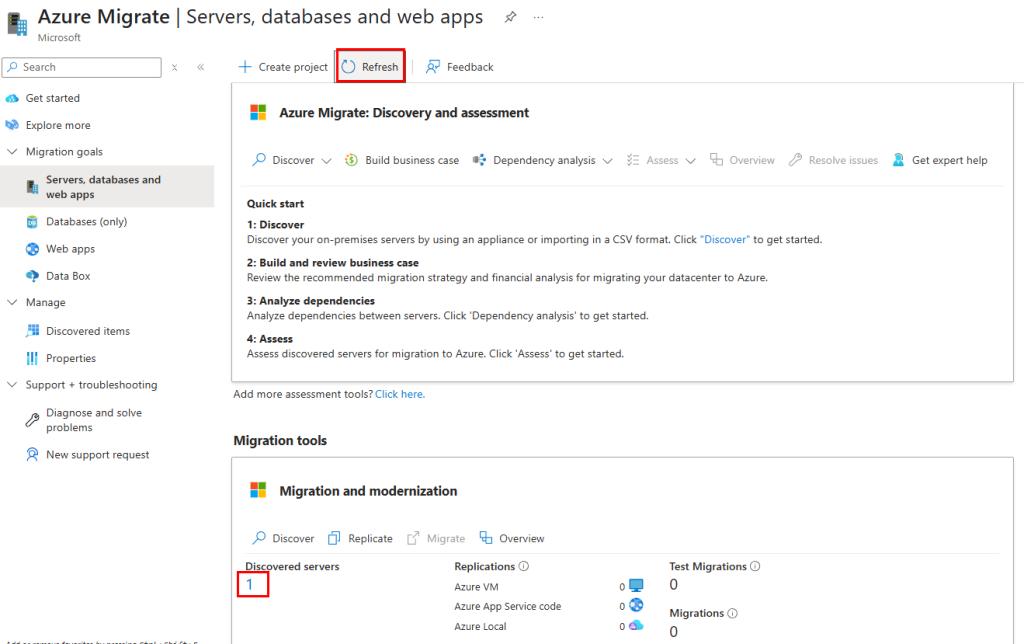

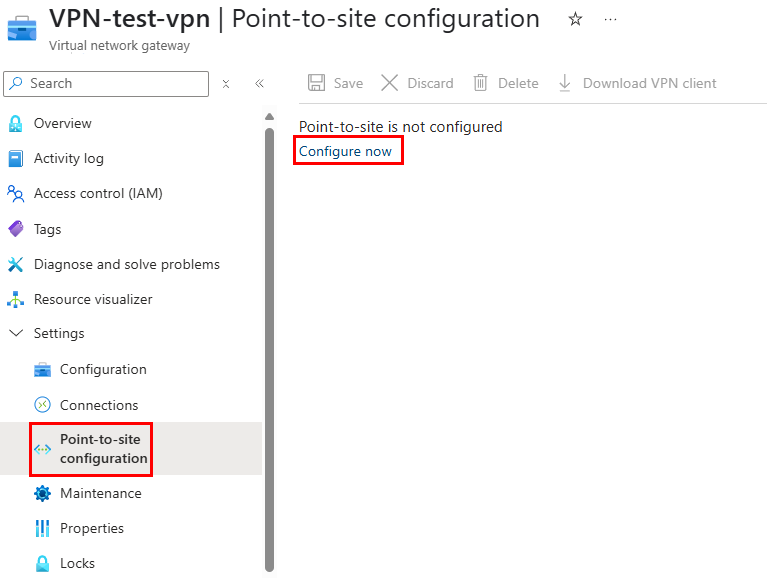

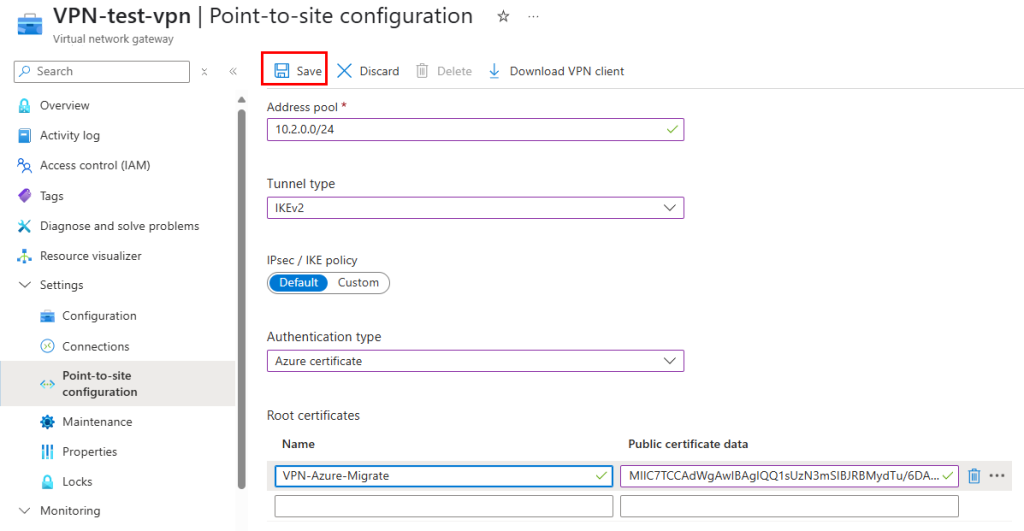

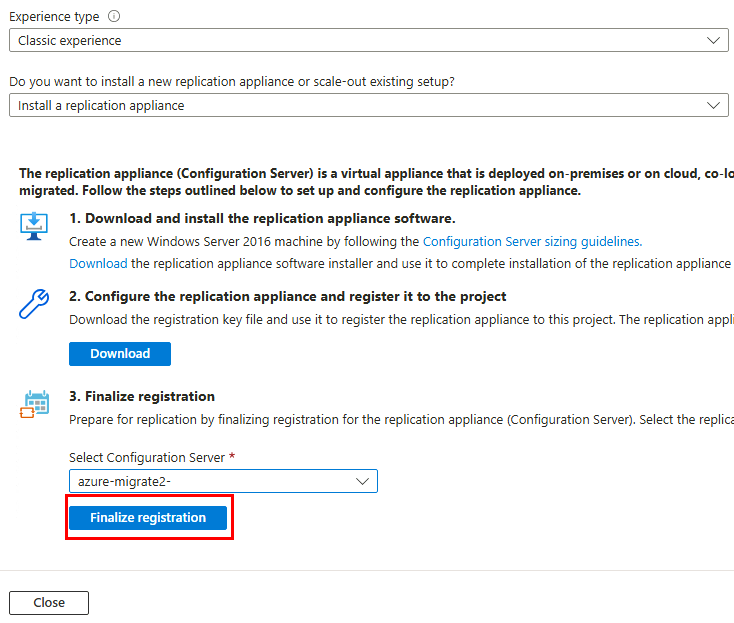

Etape III – Configuration Azure :

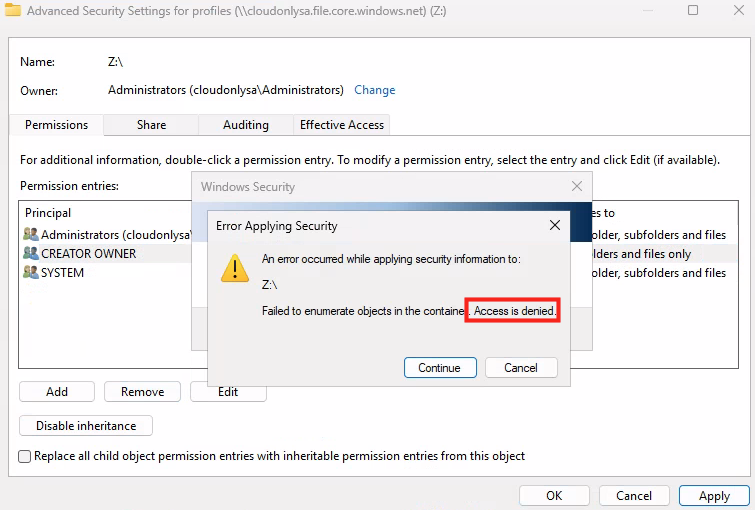

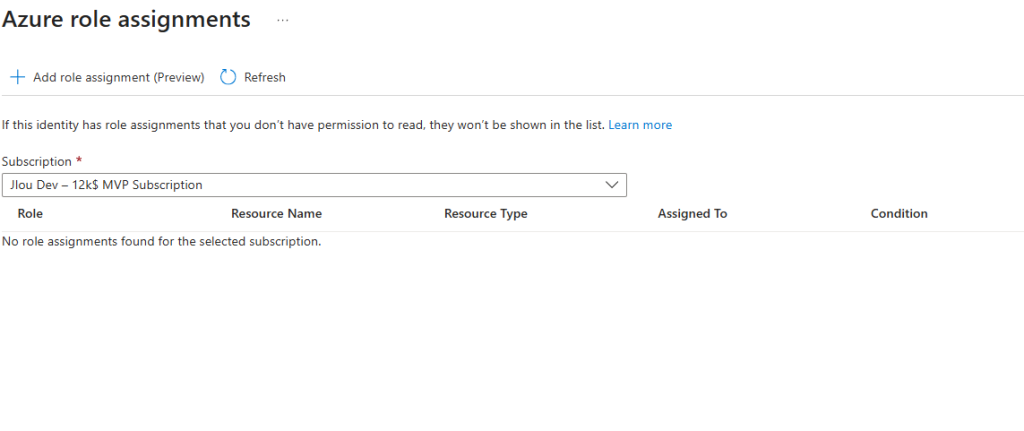

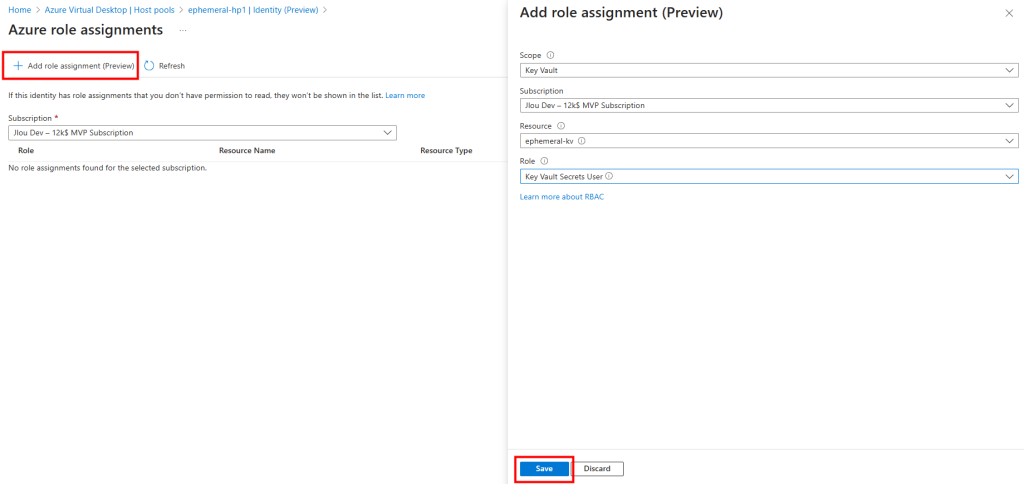

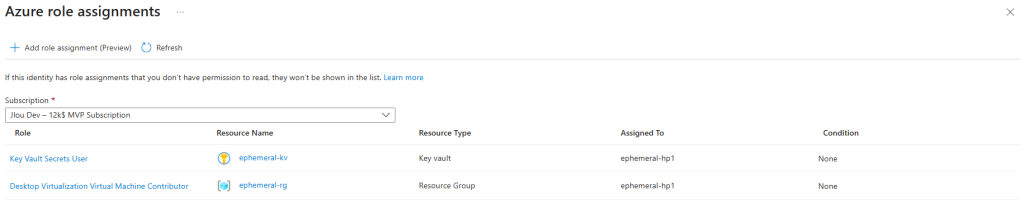

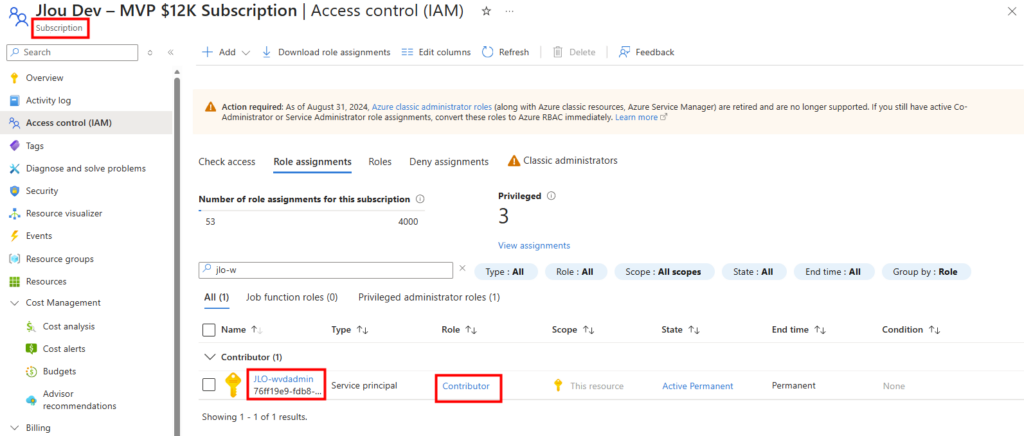

WVD infra doit modifier des ressources Azure. Et attribuer un rôle RBAC au service principal WVDInfra revient à dire : “Cette application a le droit de faire telle action, sur tel périmètre.”

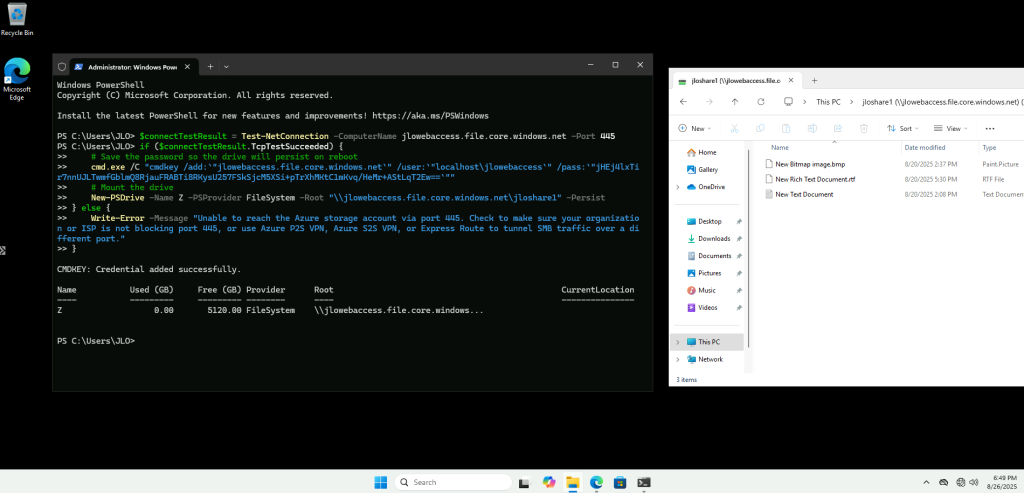

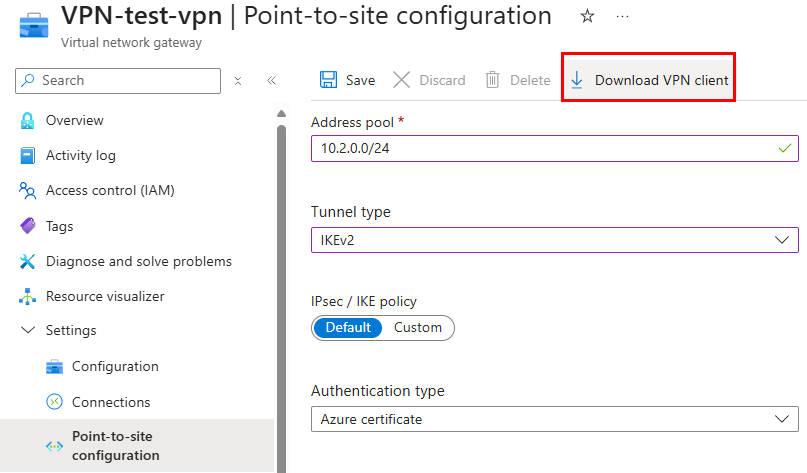

Pour cela, configurez avec le rôle RBAC de Contributeur sur l’application WVDInfra :

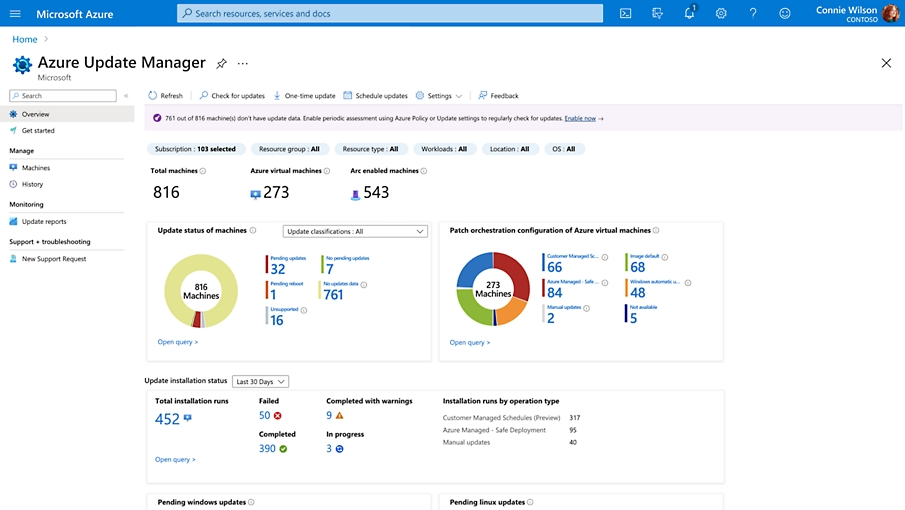

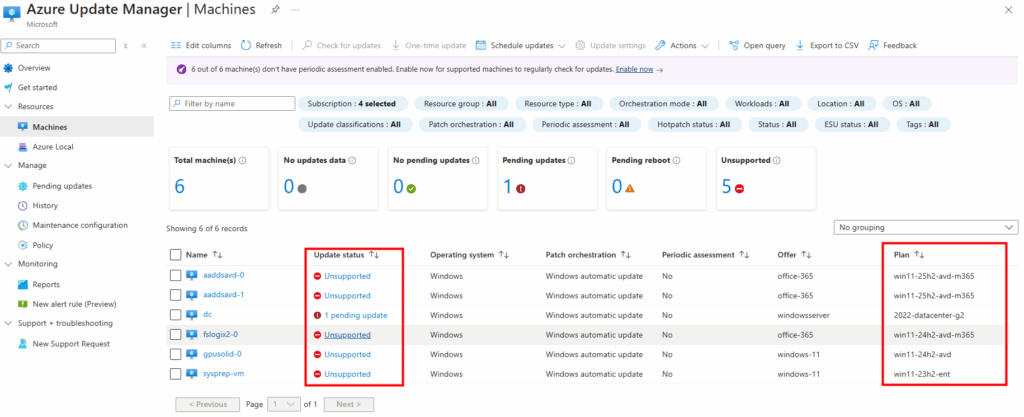

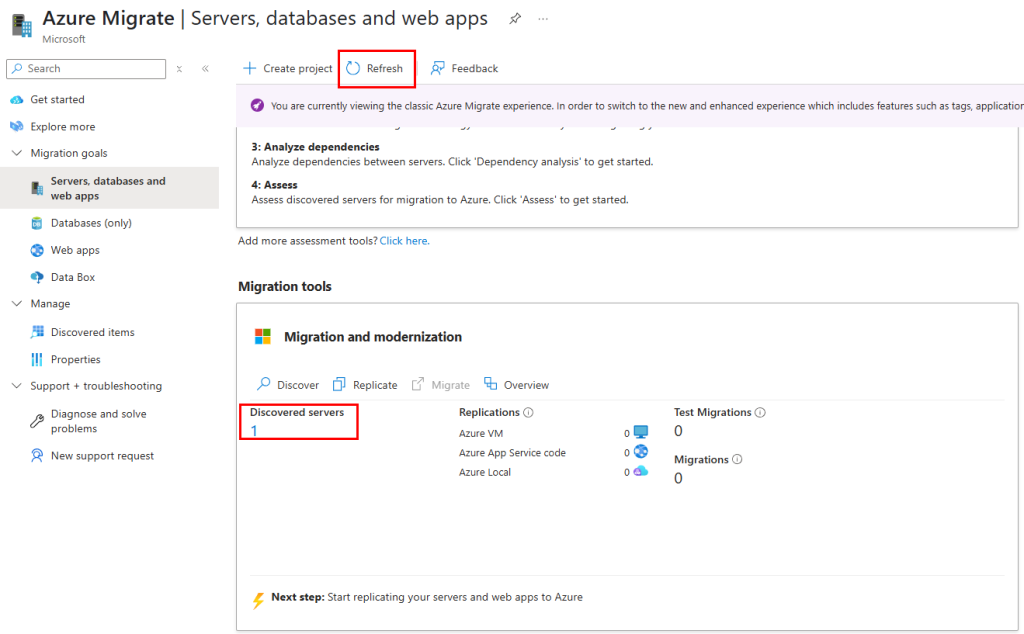

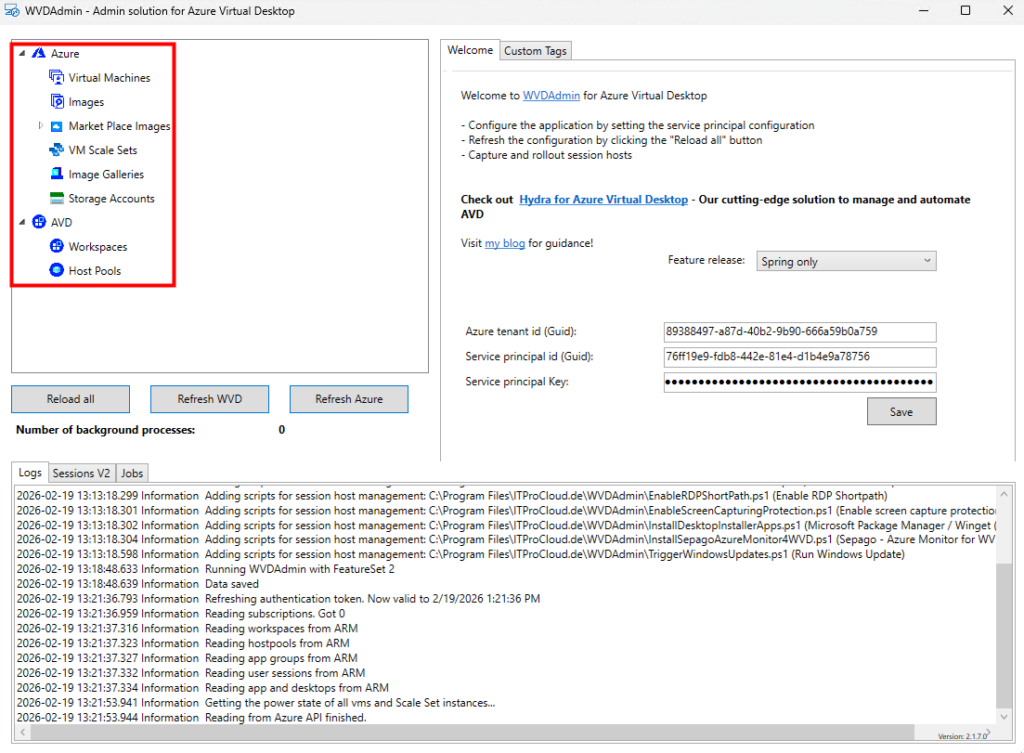

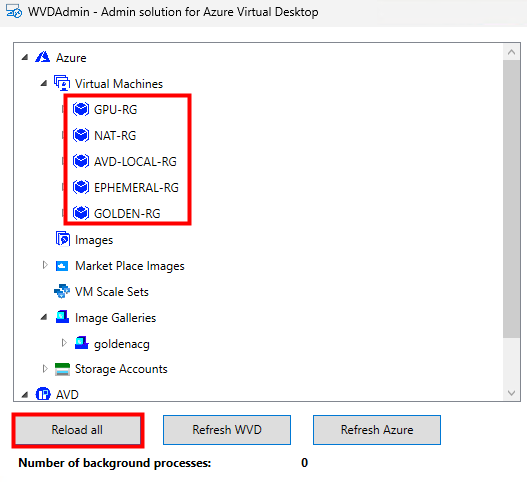

Sur WVDInfra, relancez un rechargement afin de voir apparaître l’inventaire des groupes de ressources et des VMs :

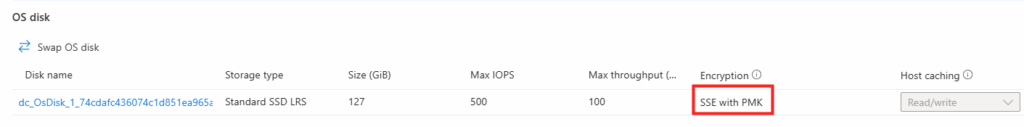

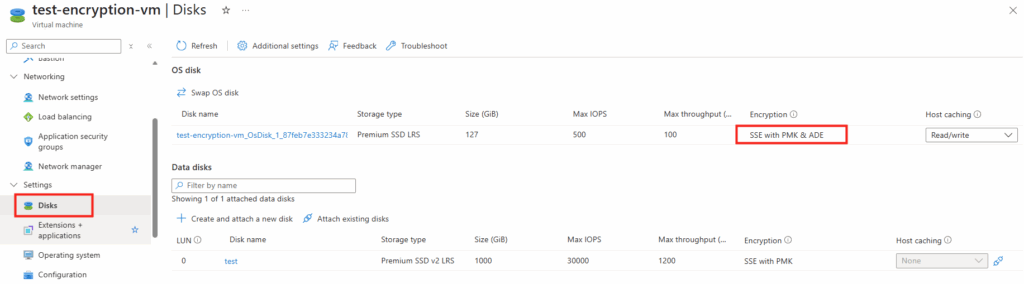

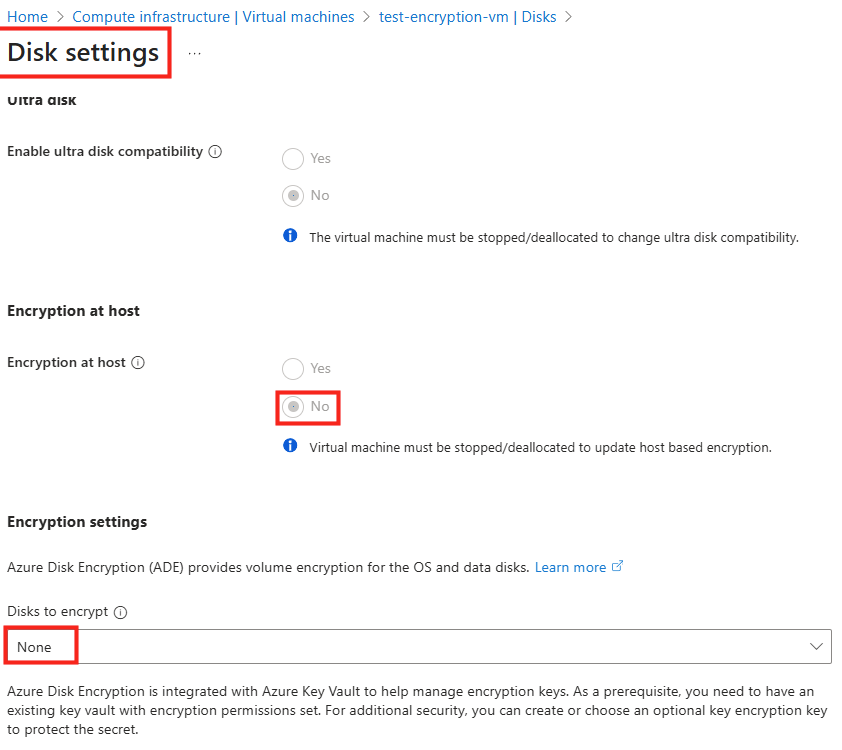

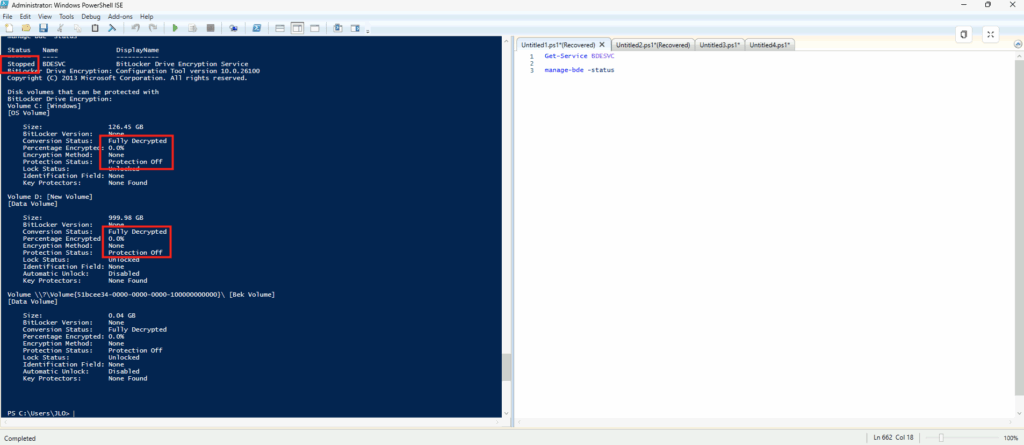

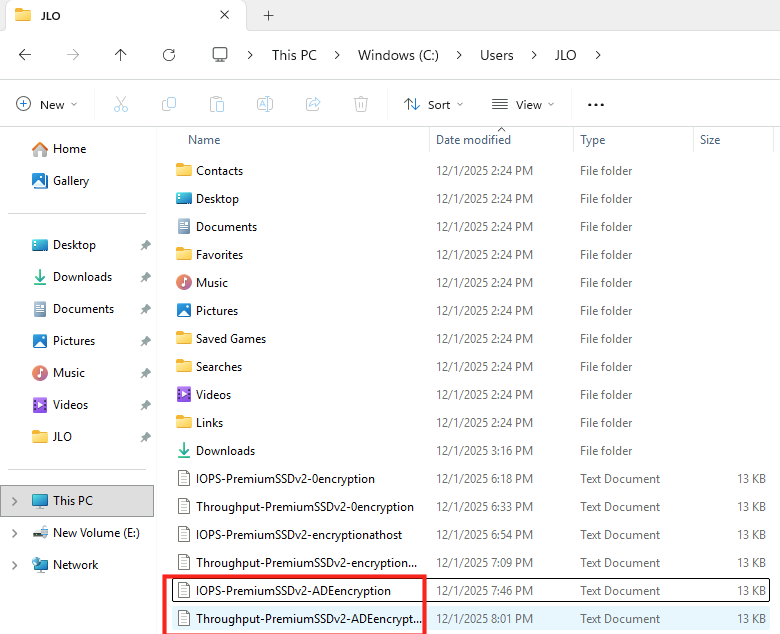

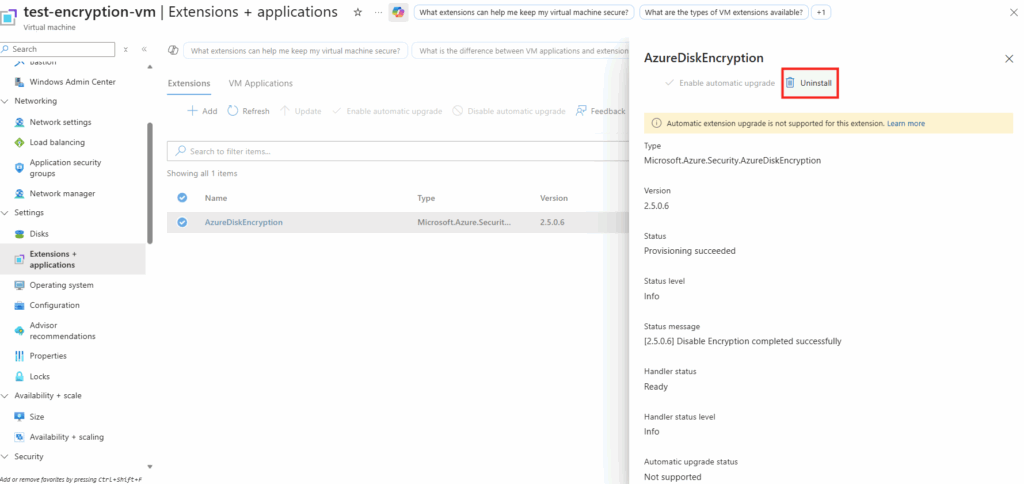

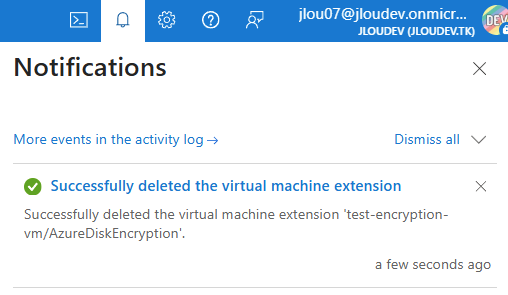

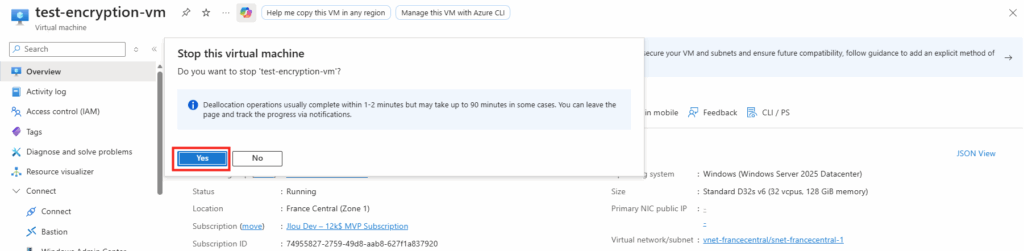

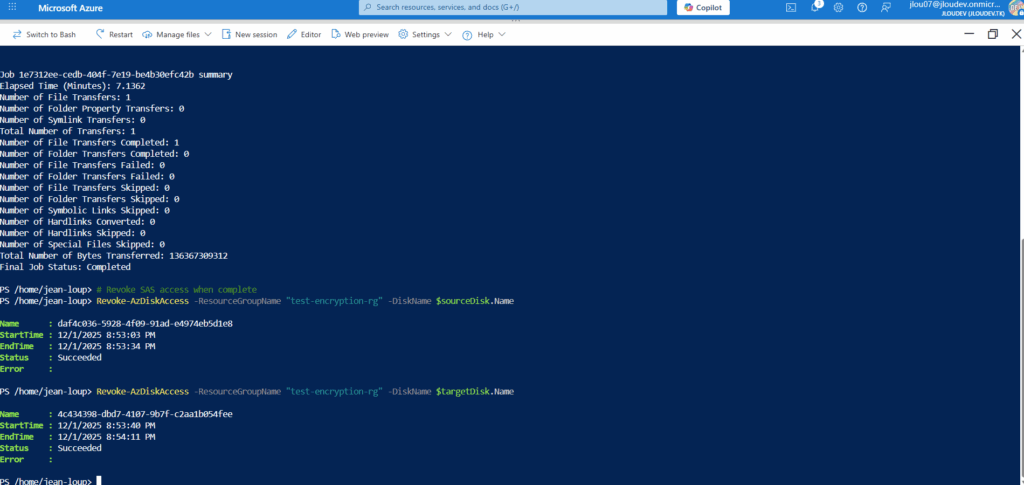

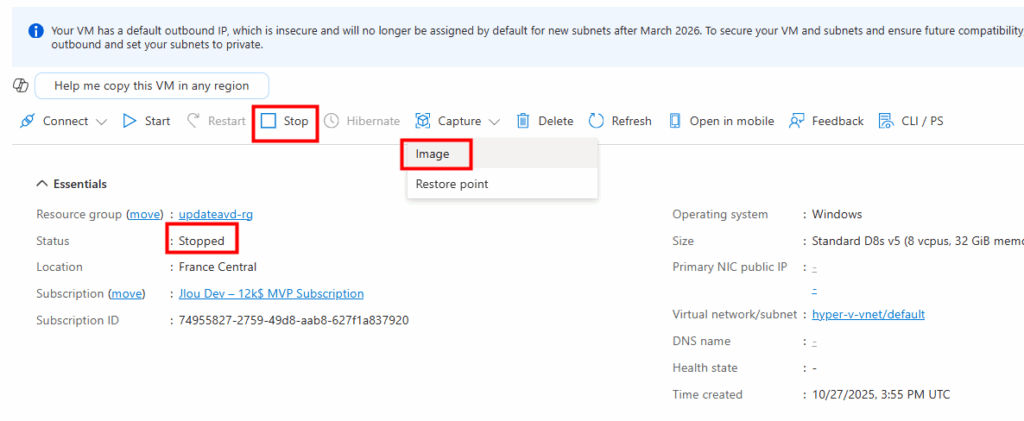

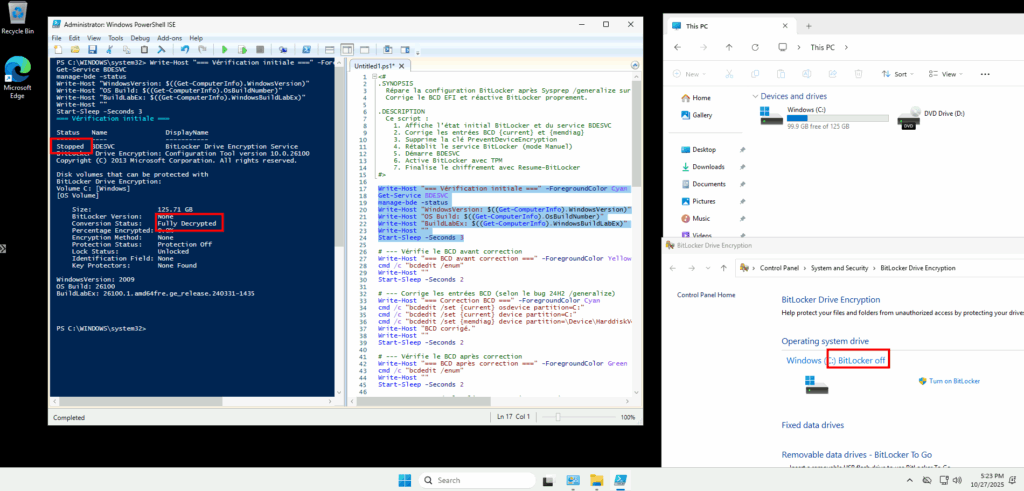

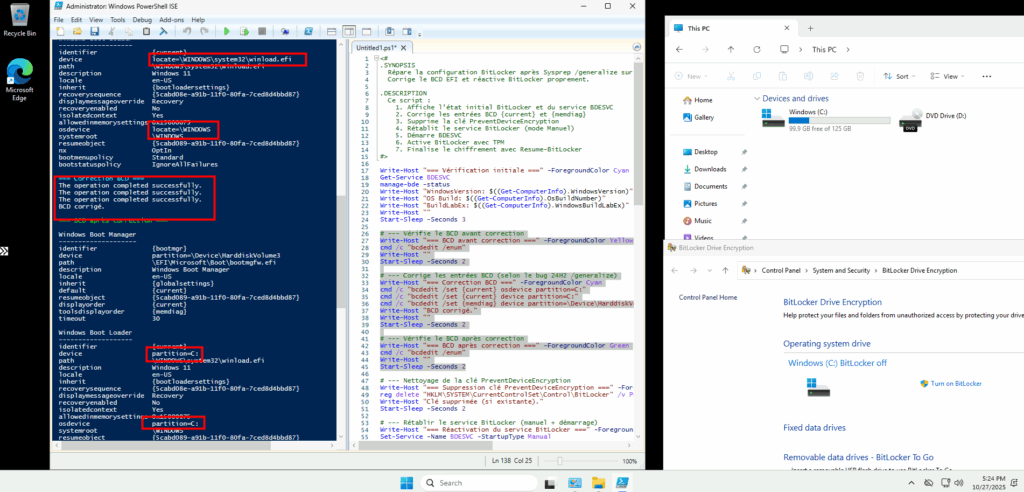

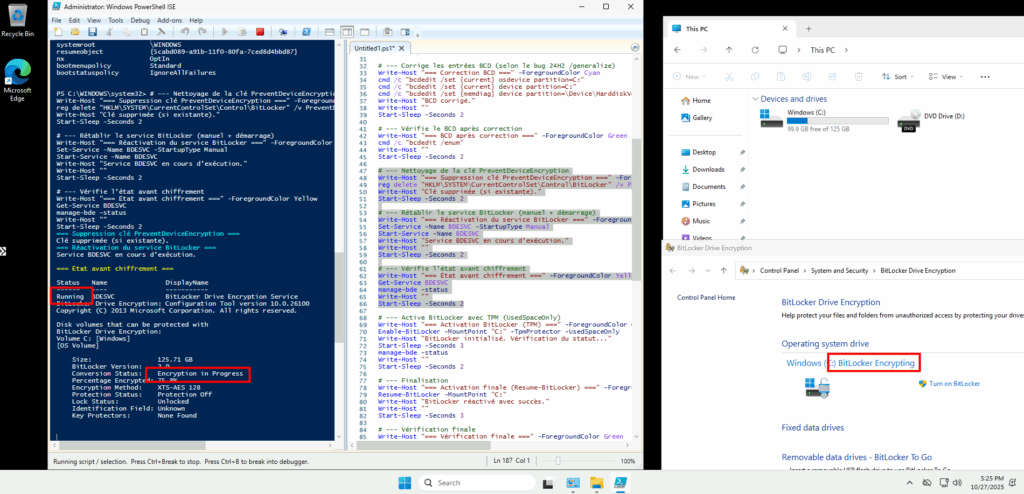

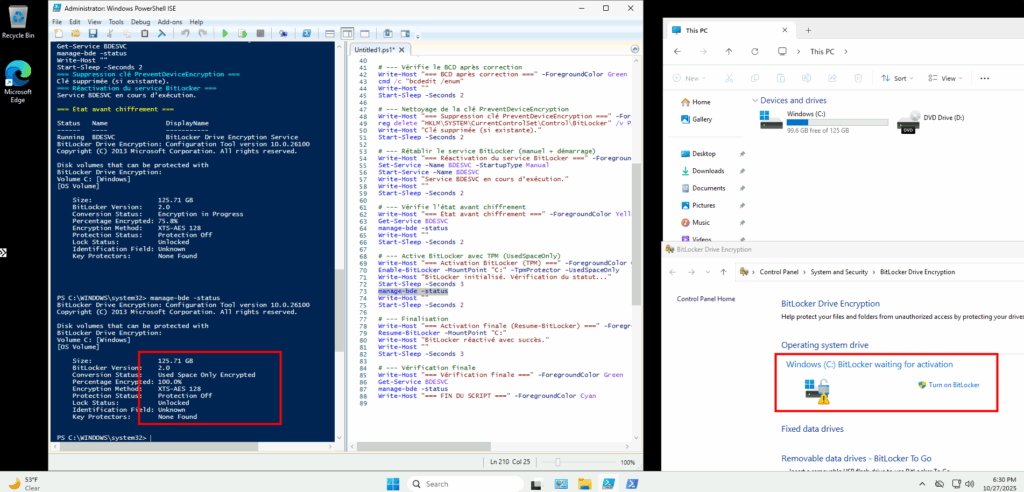

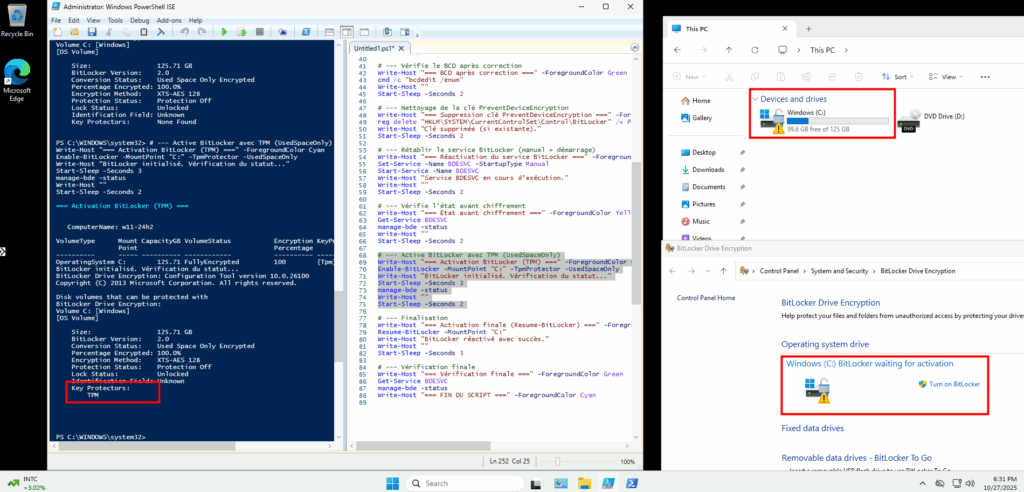

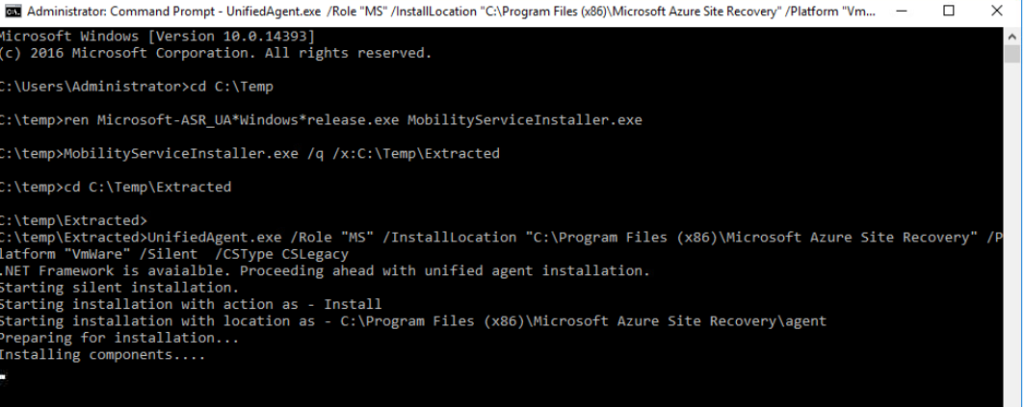

Etape IV – Test de capture d’une VM :

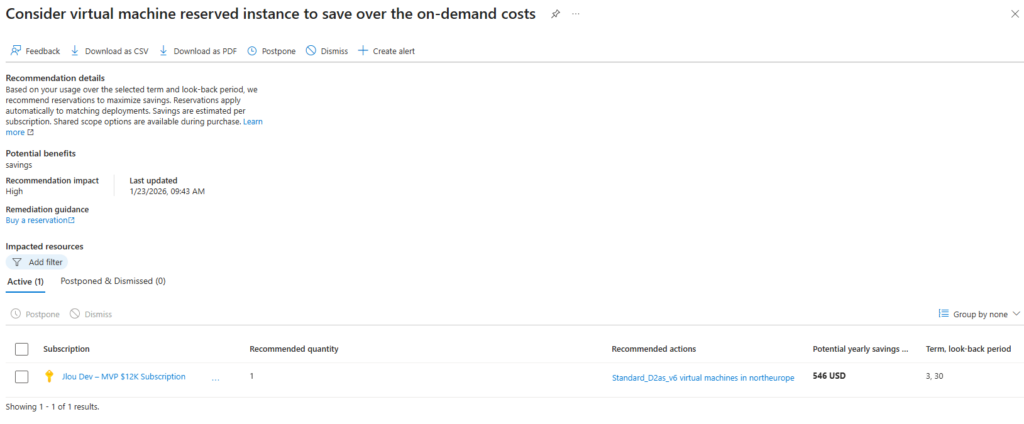

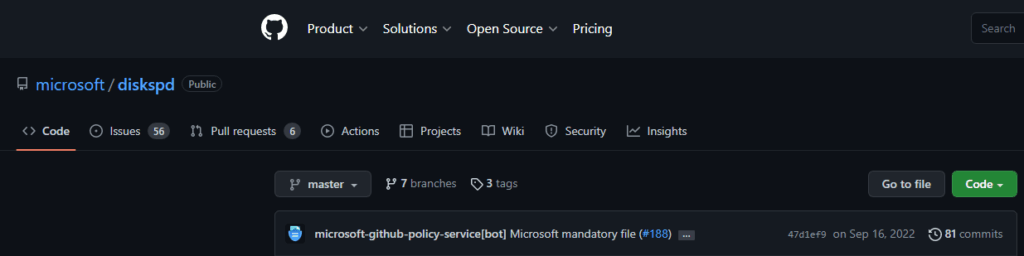

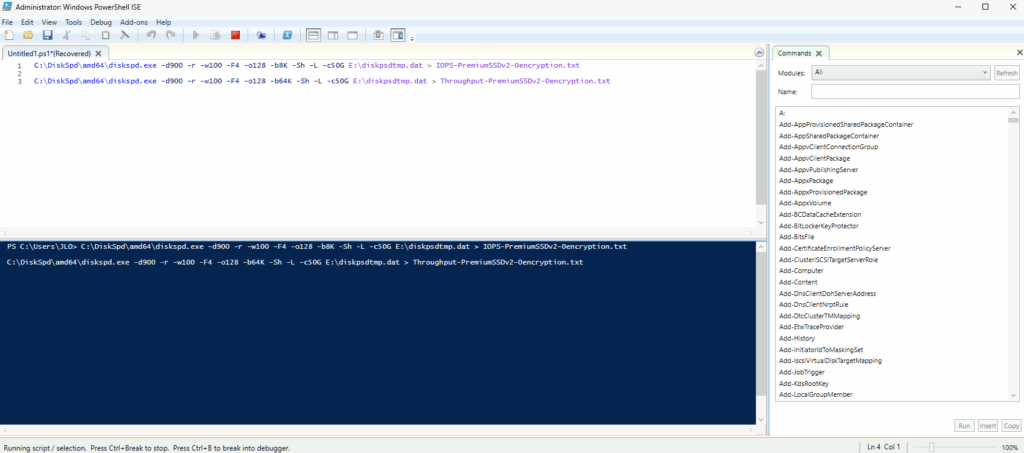

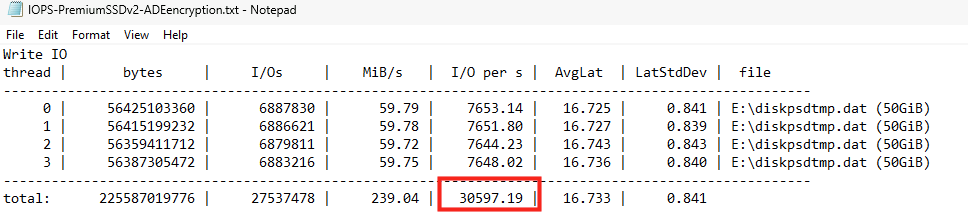

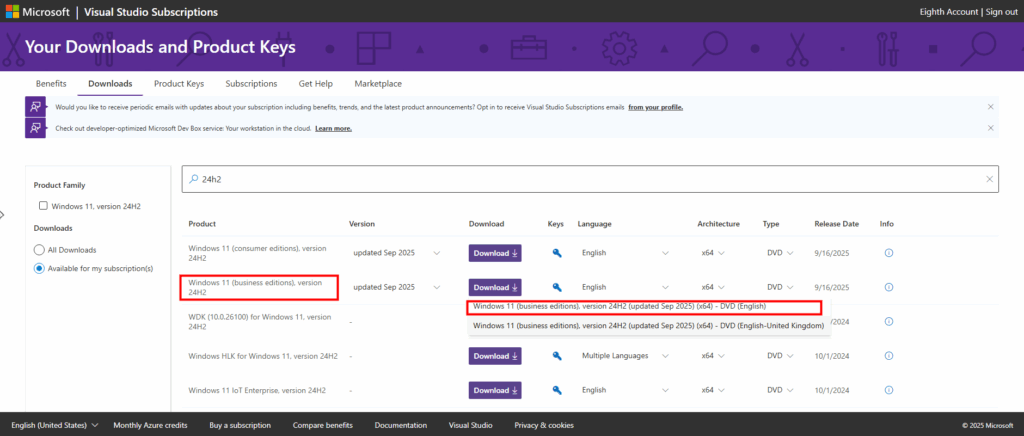

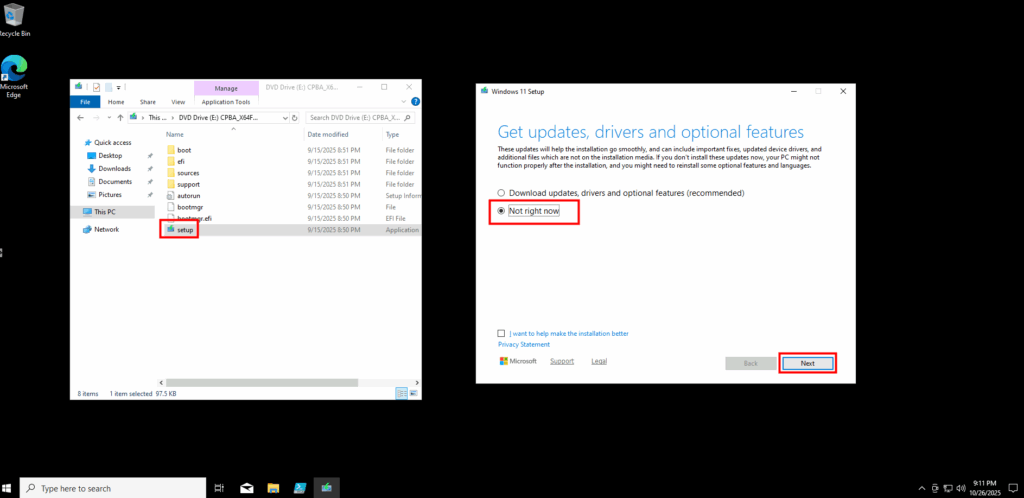

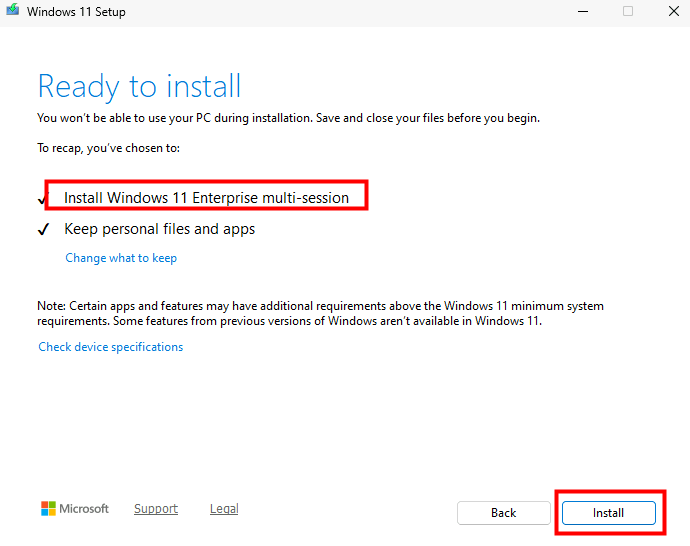

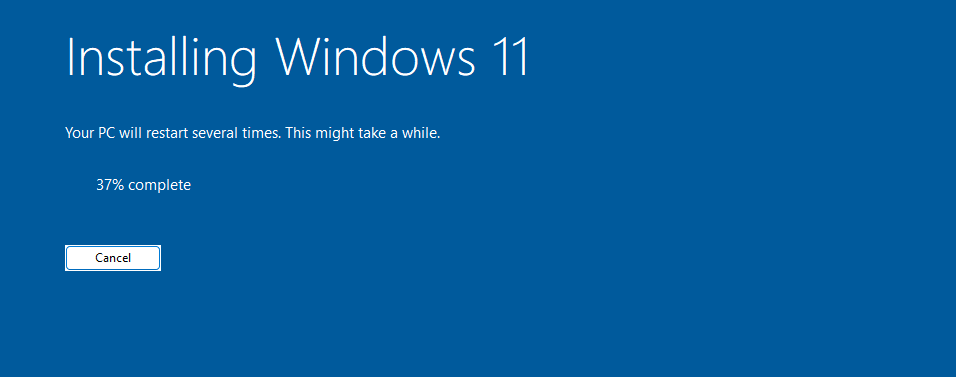

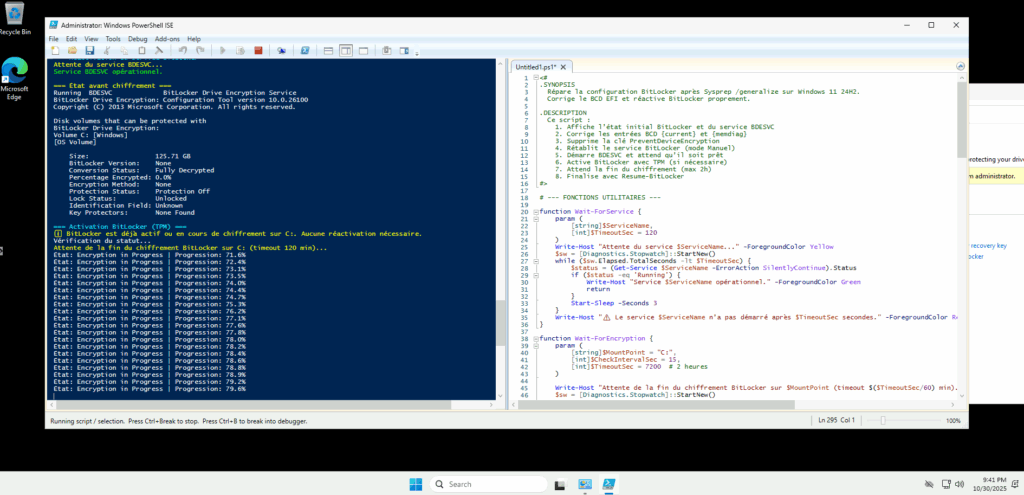

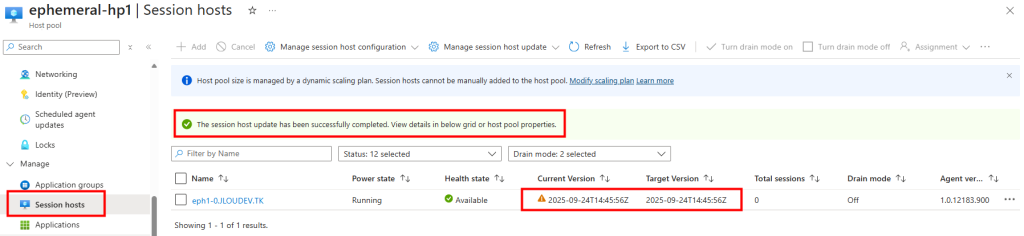

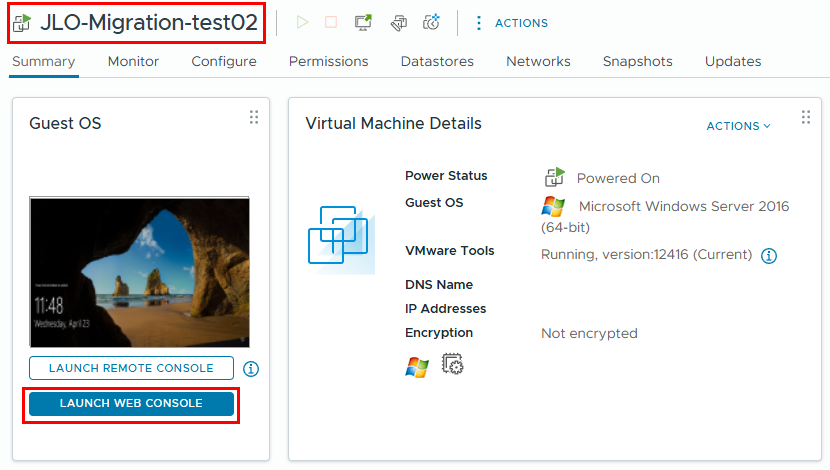

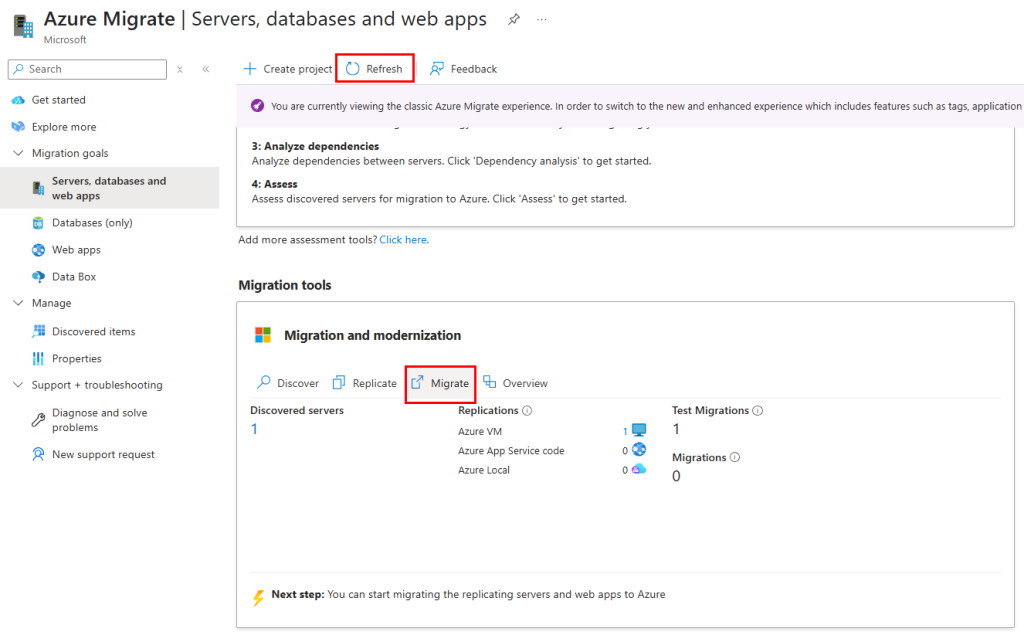

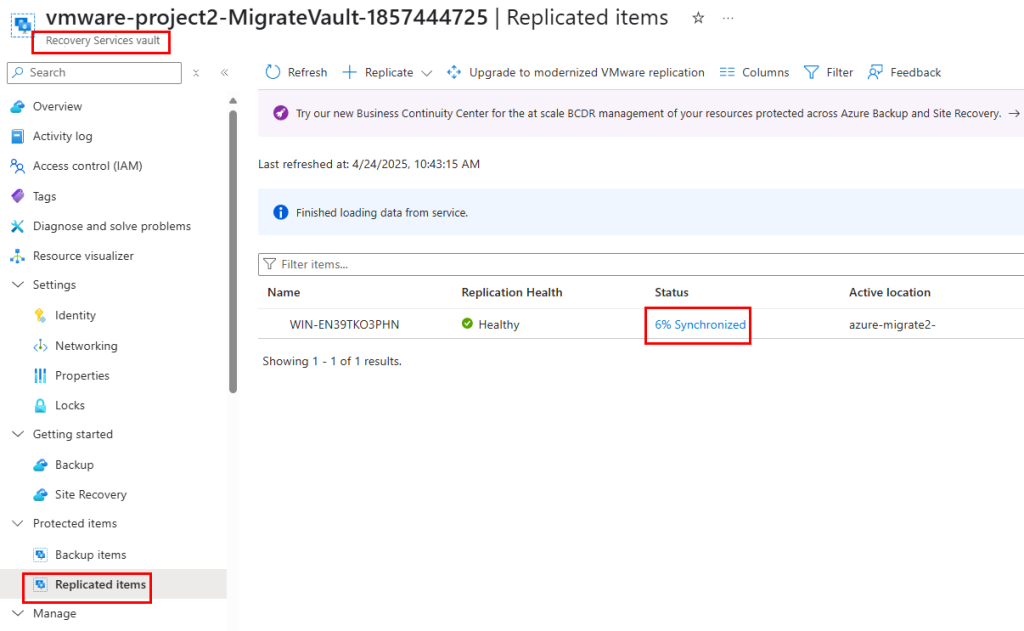

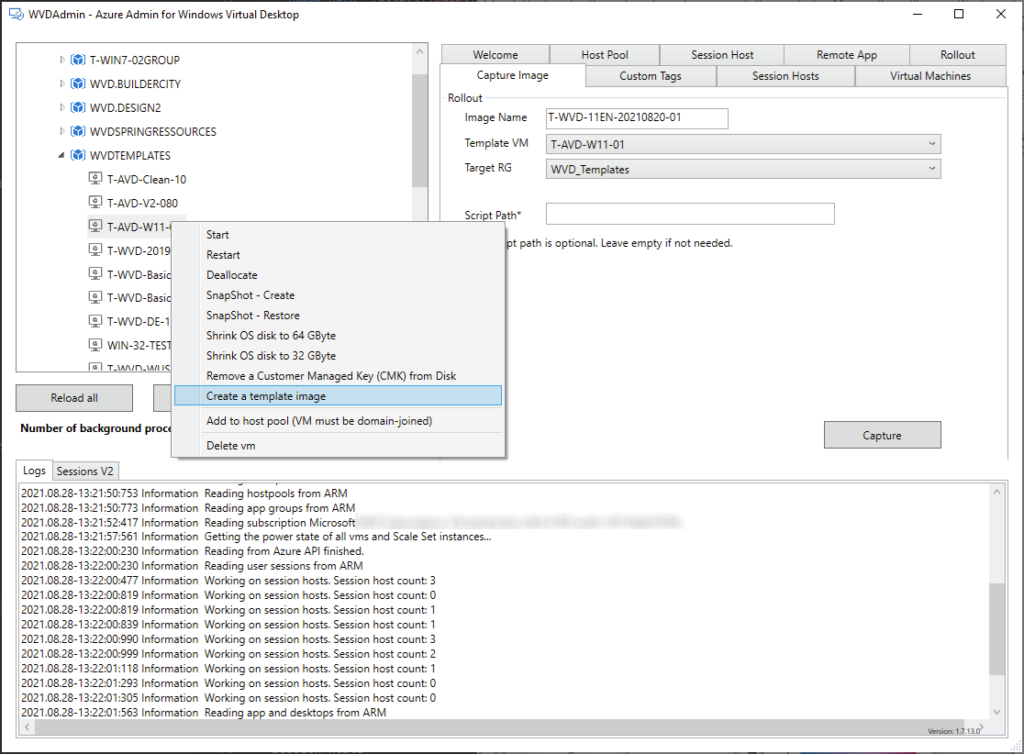

Microsoft recommande que tous les hôtes de session d’un pool soient issus de la même image afin de garantir une expérience utilisateur cohérente. WVDAdmin positionne l’imagerie comme une fonctionnalité centrale : création d’images à partir d’un golden master sans détruire la VM source.

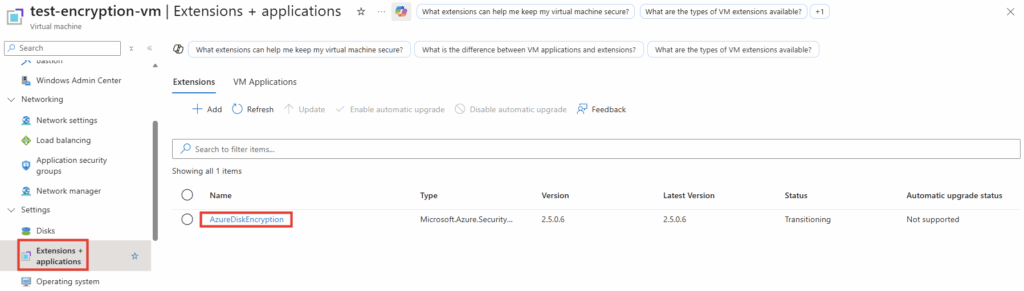

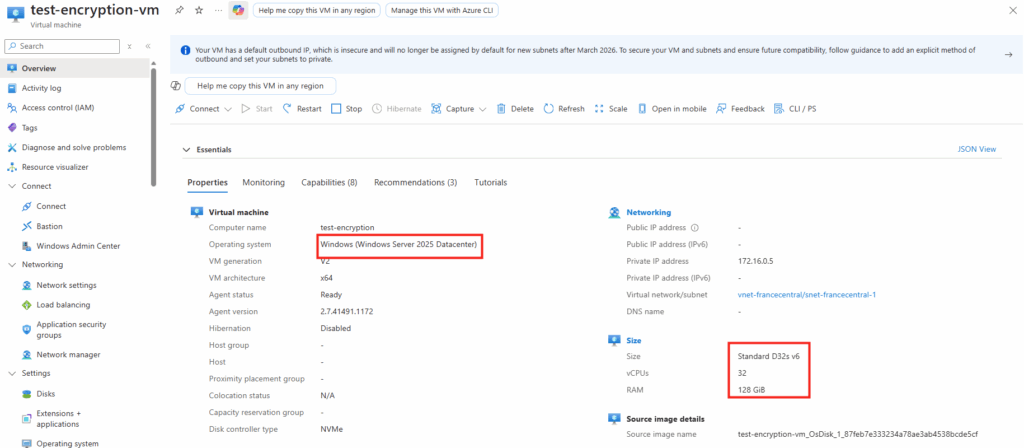

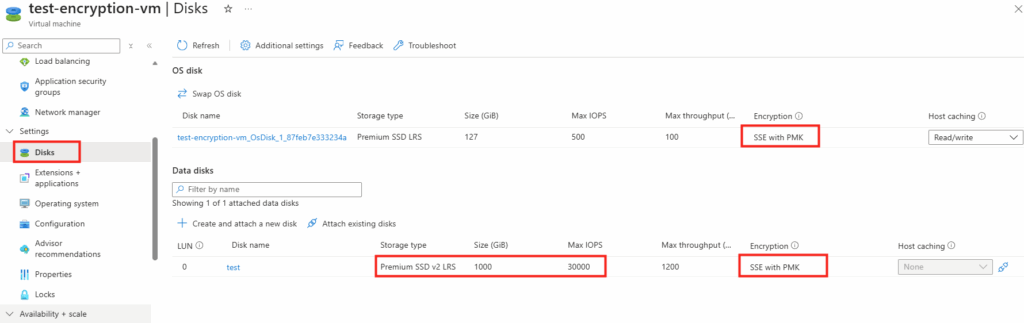

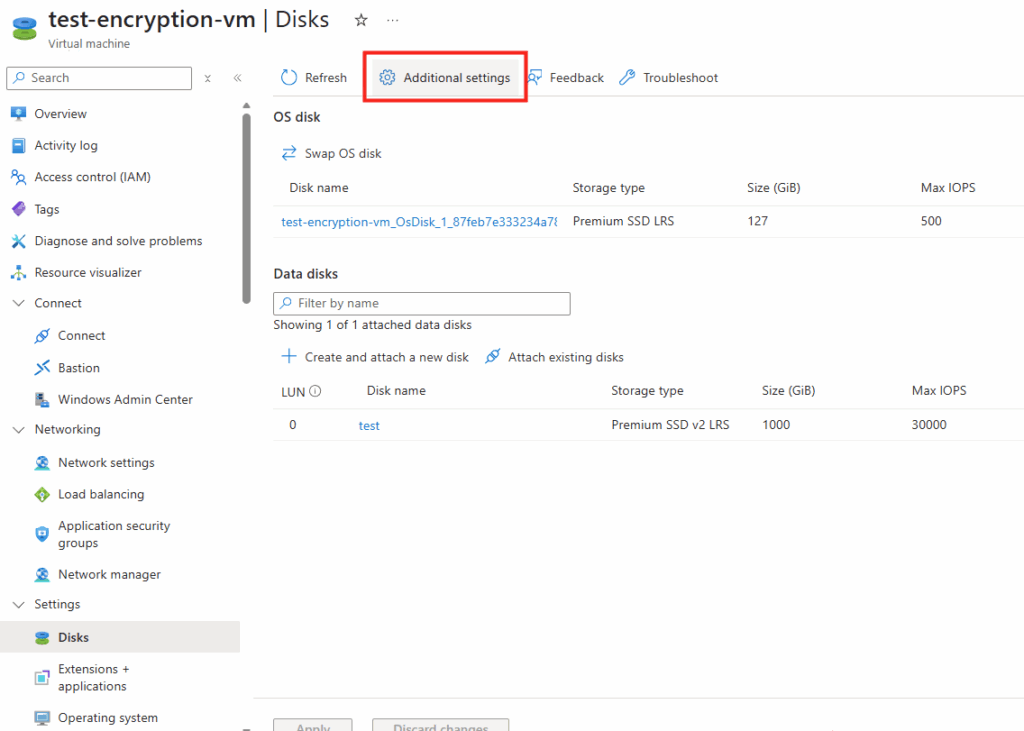

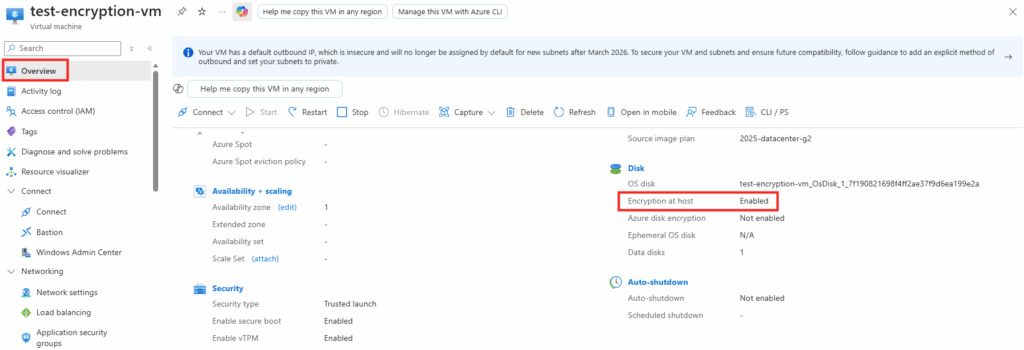

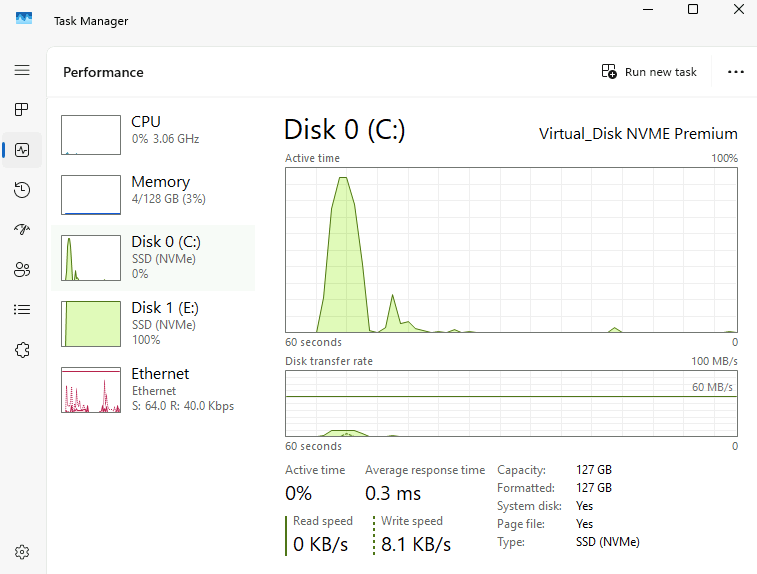

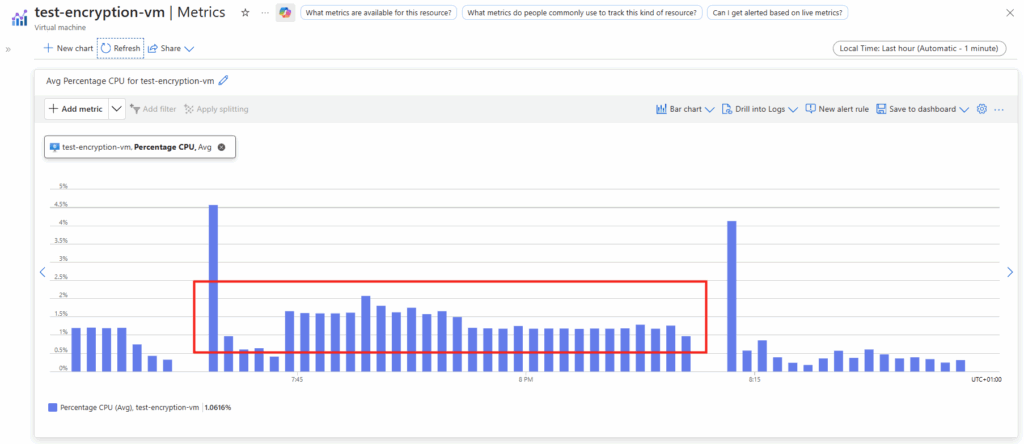

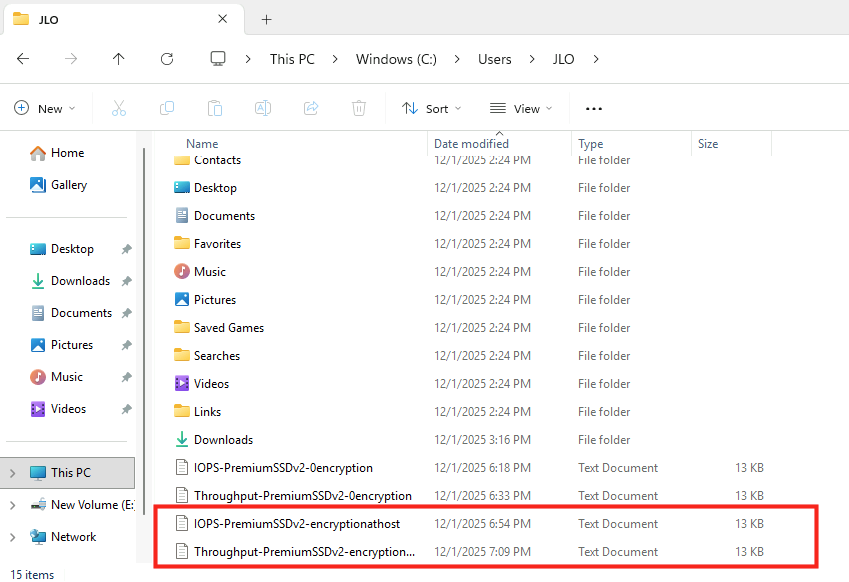

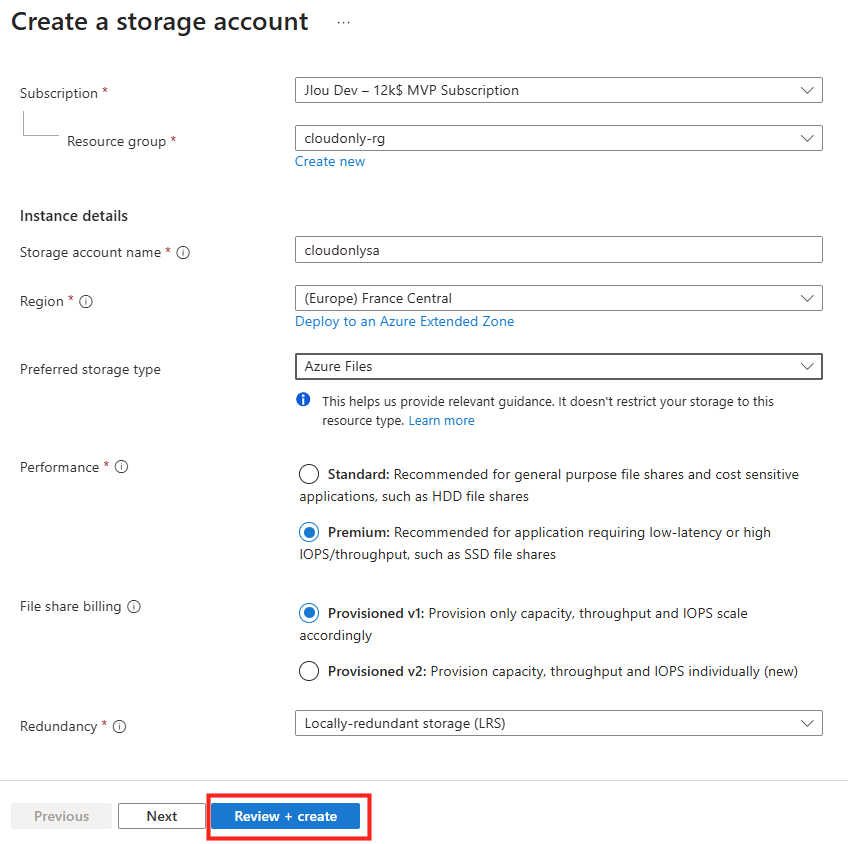

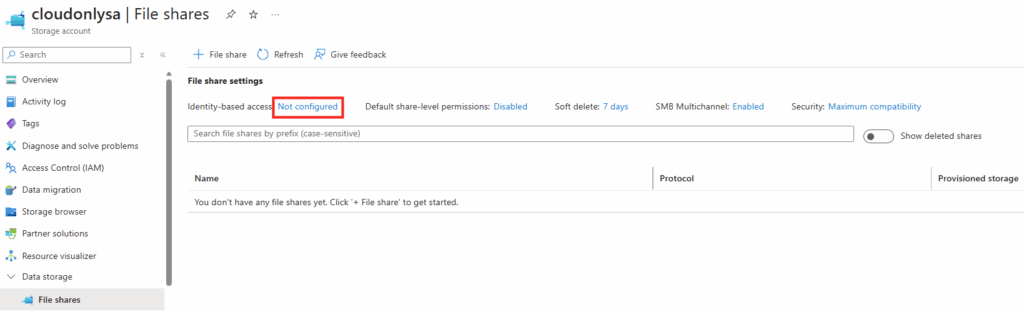

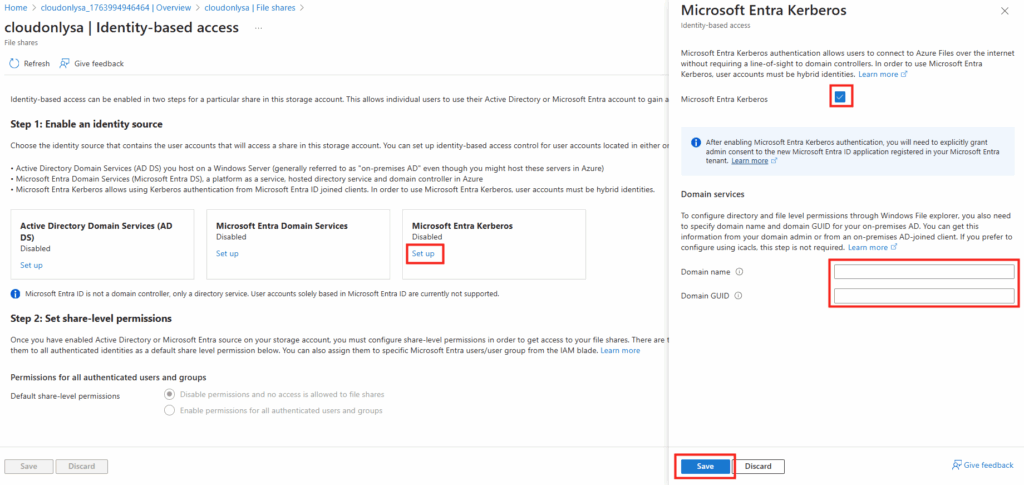

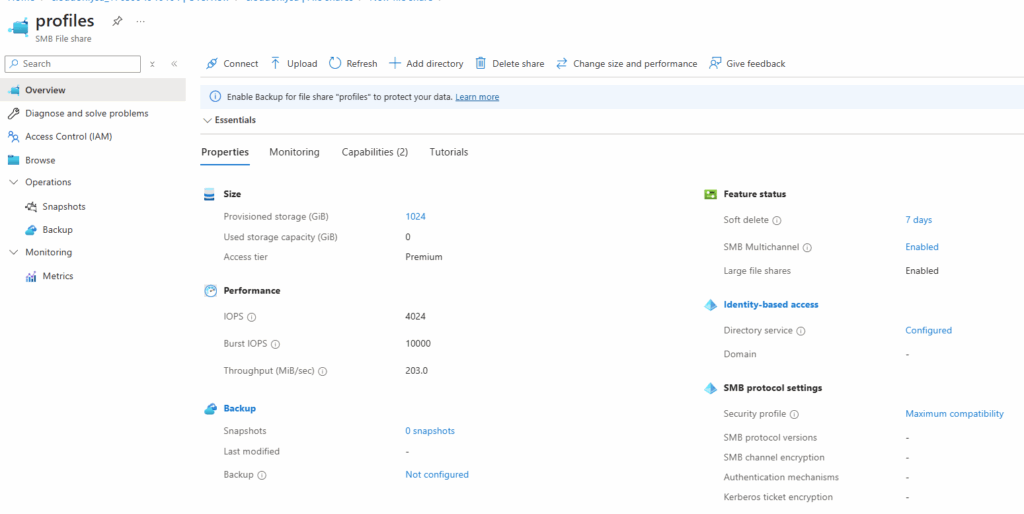

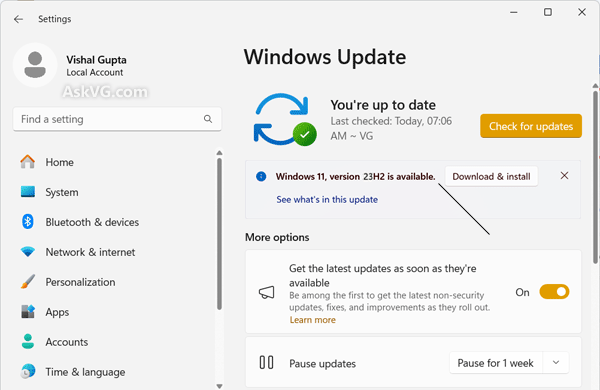

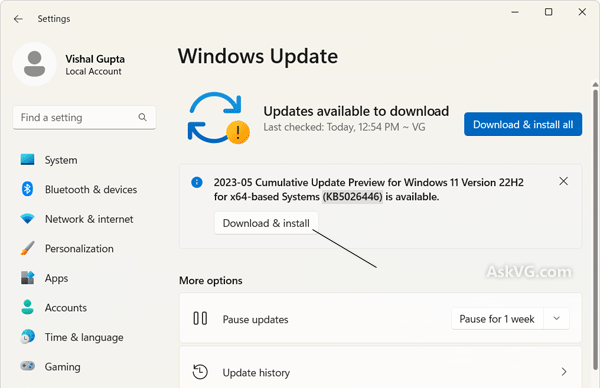

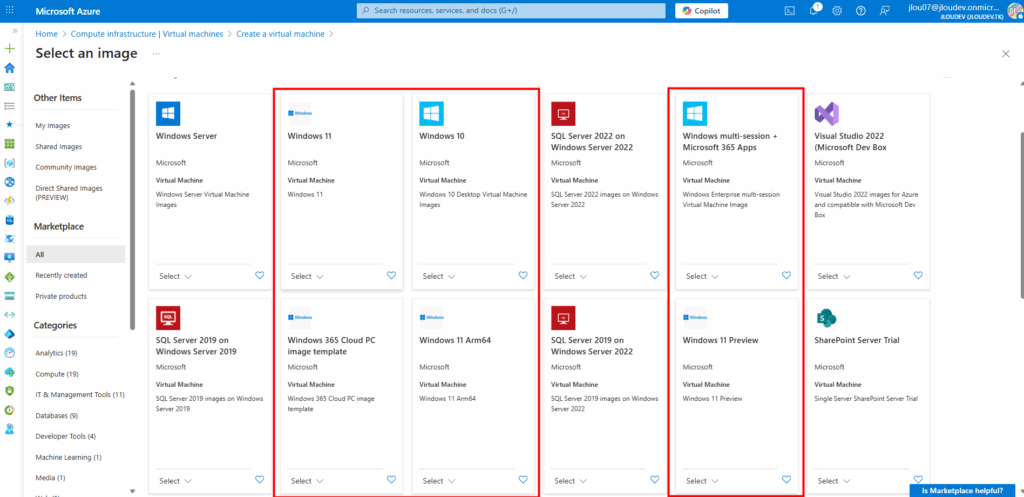

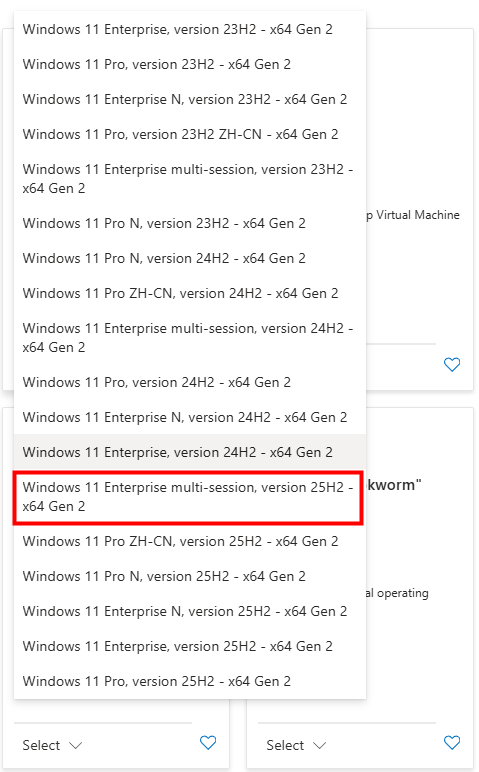

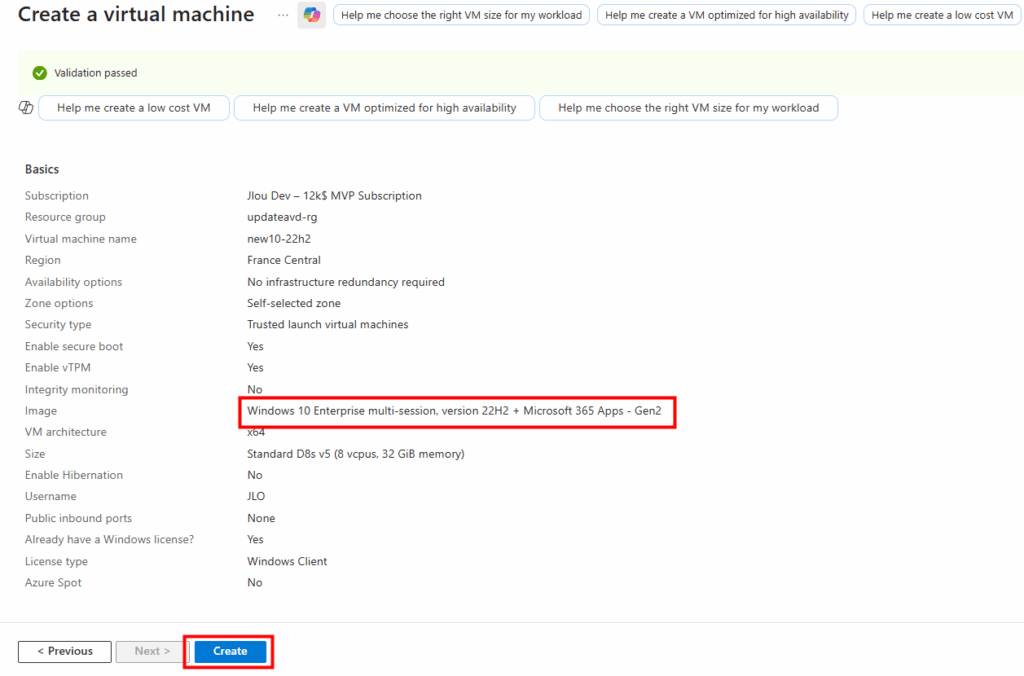

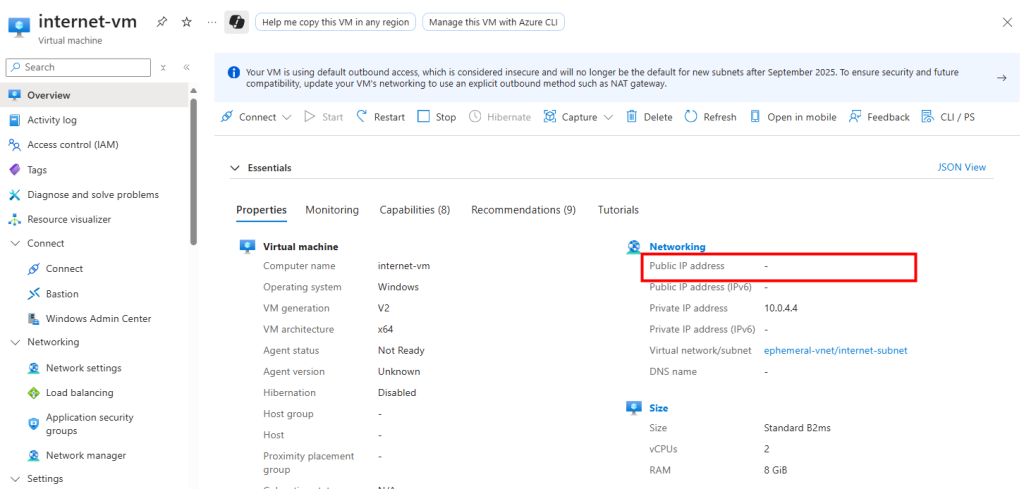

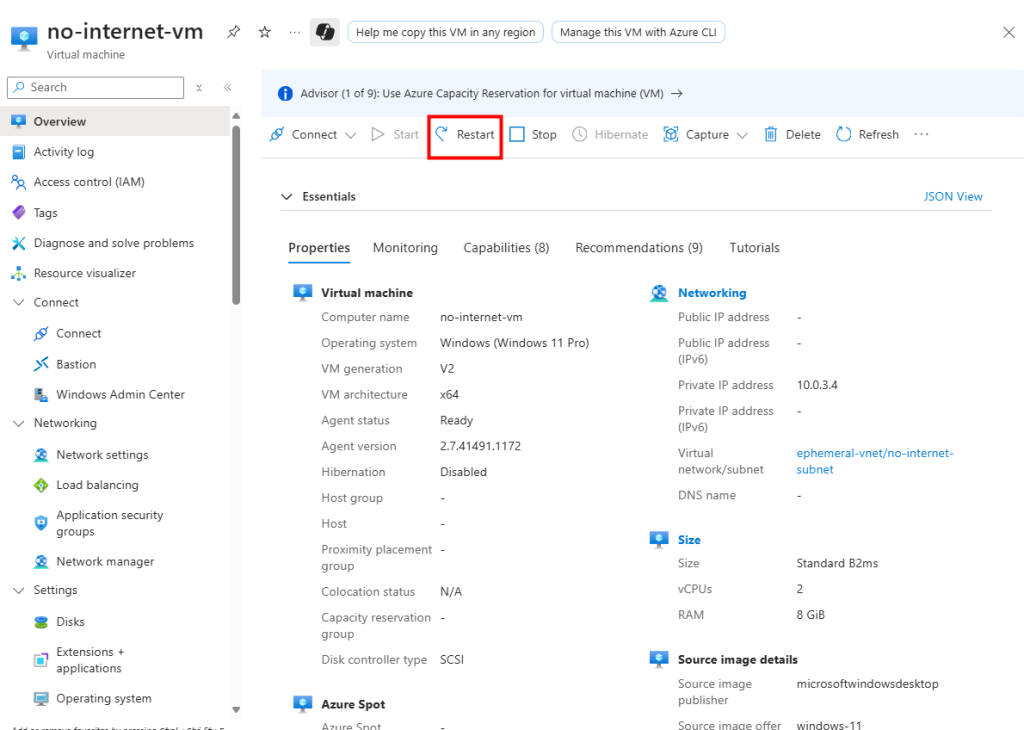

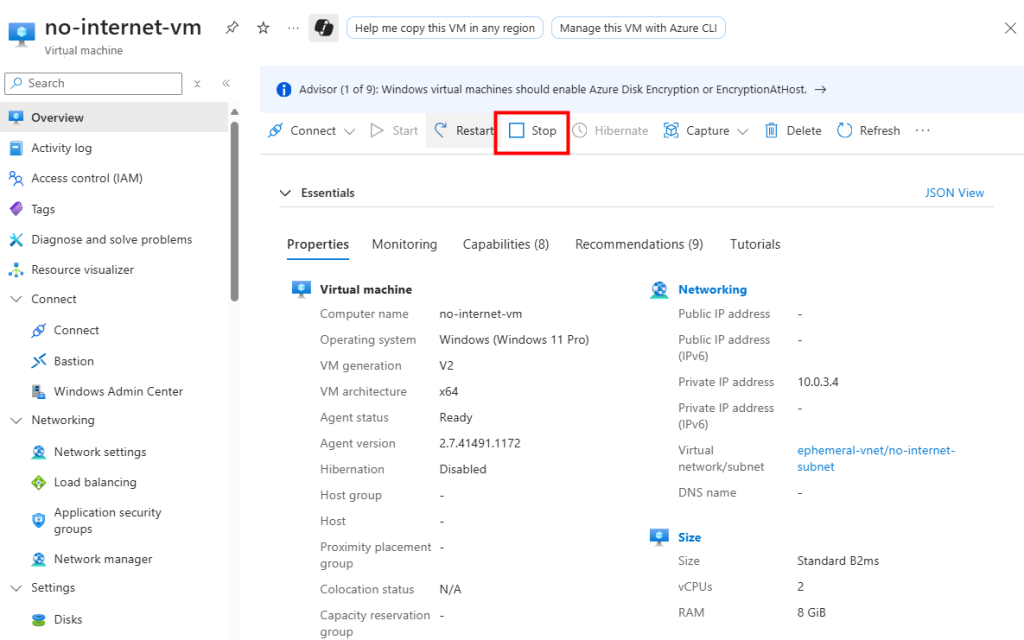

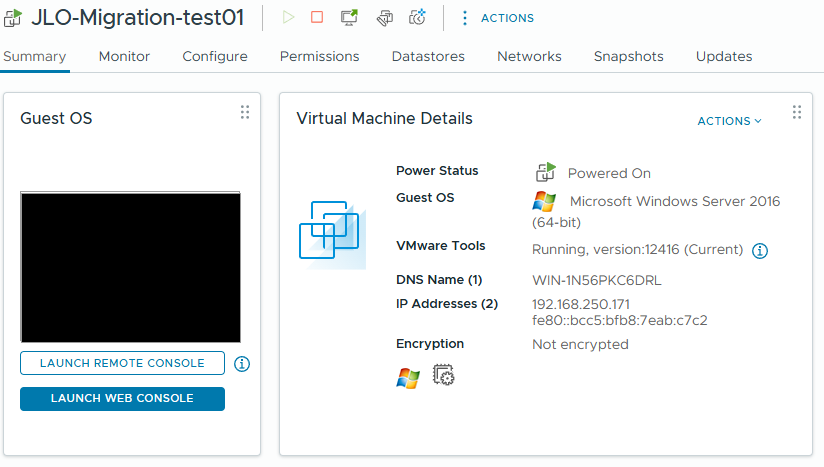

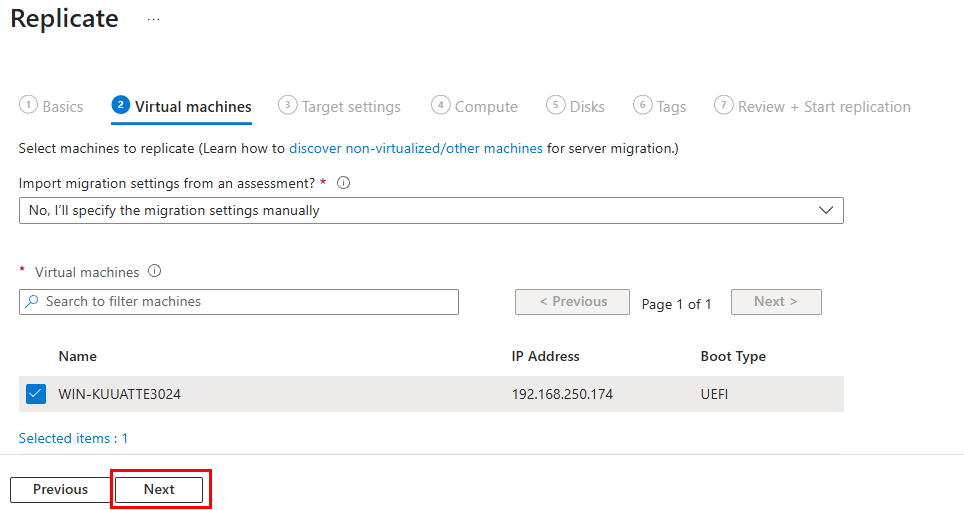

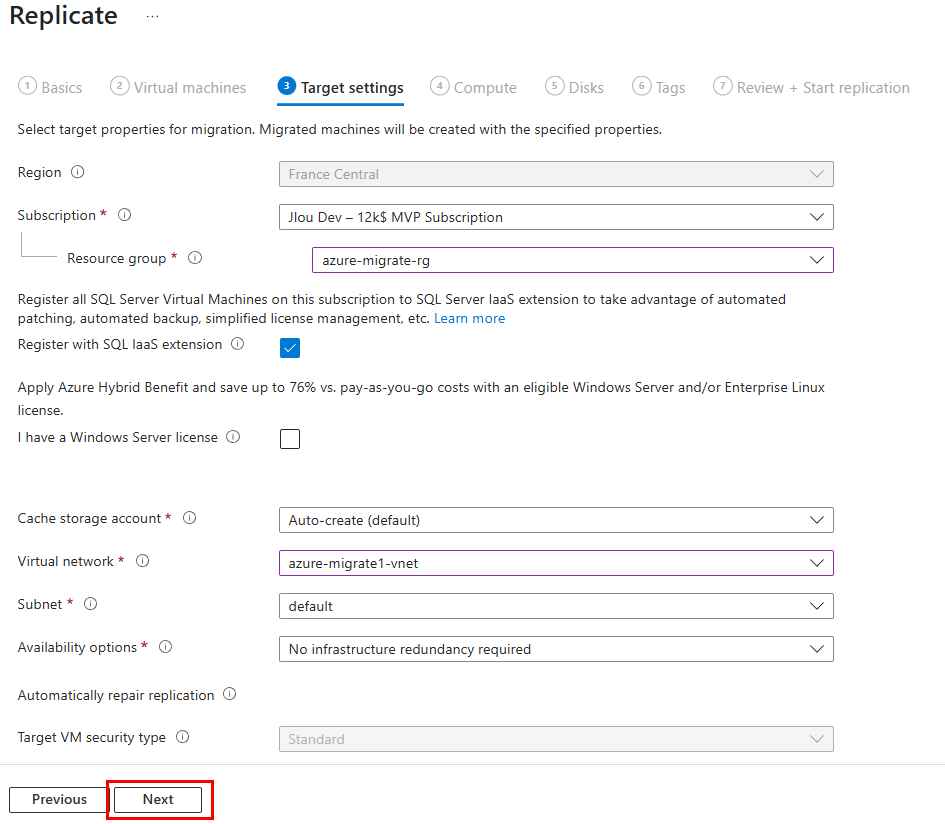

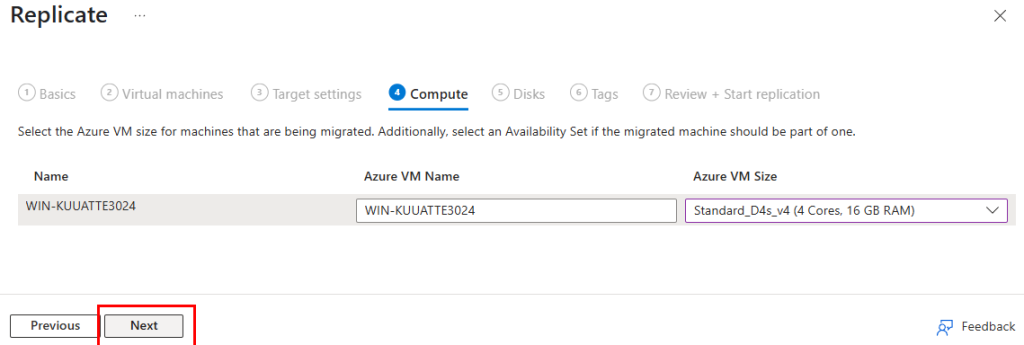

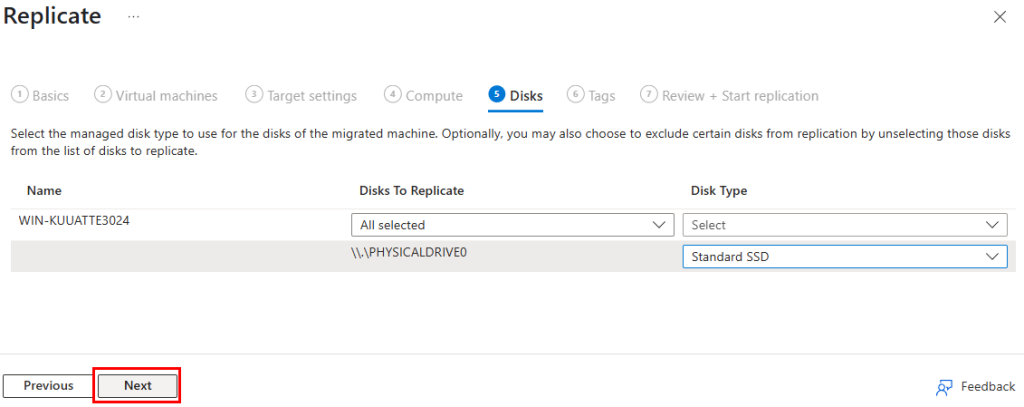

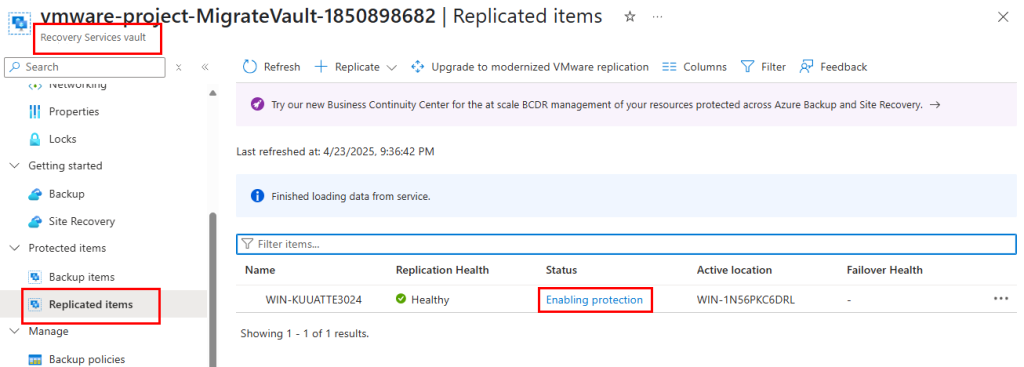

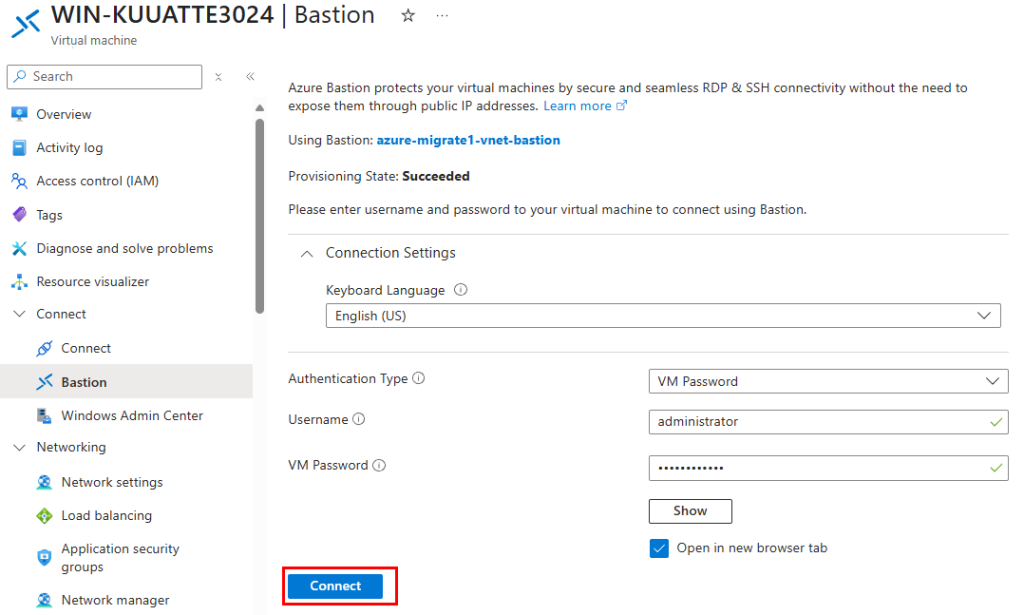

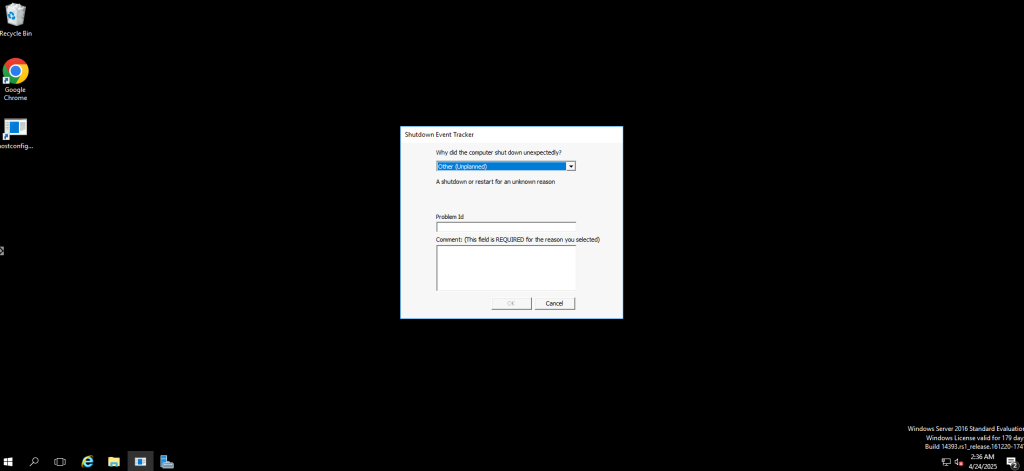

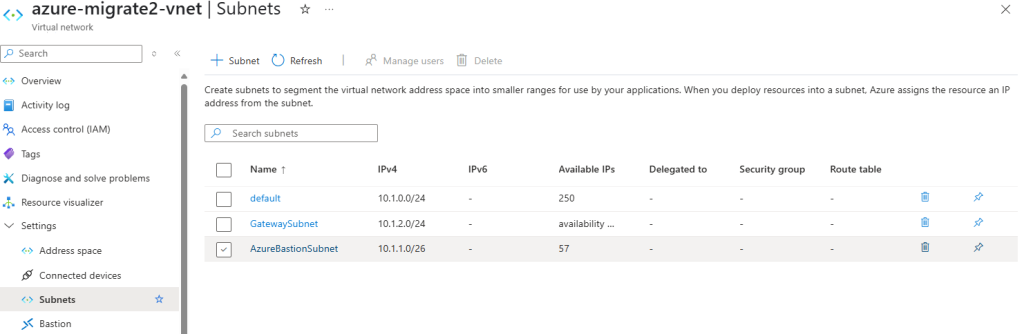

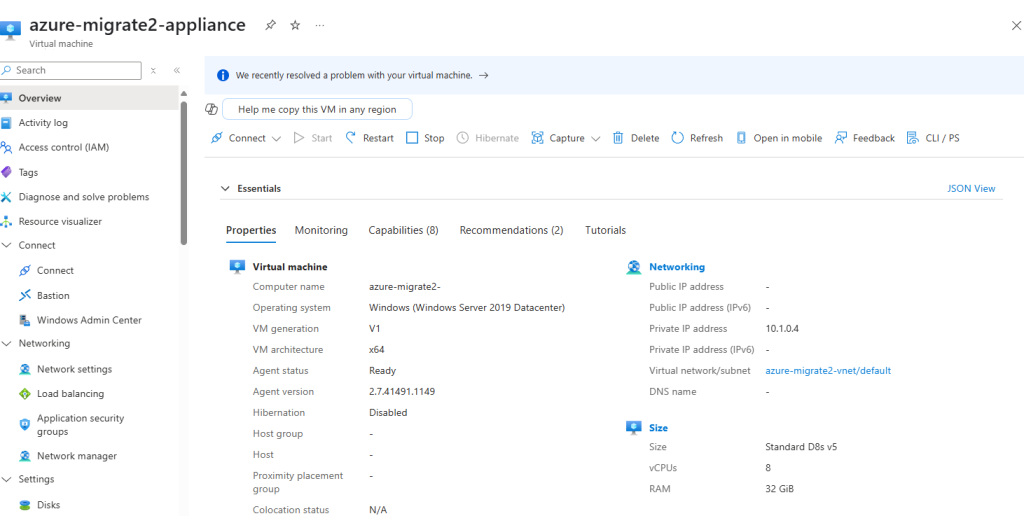

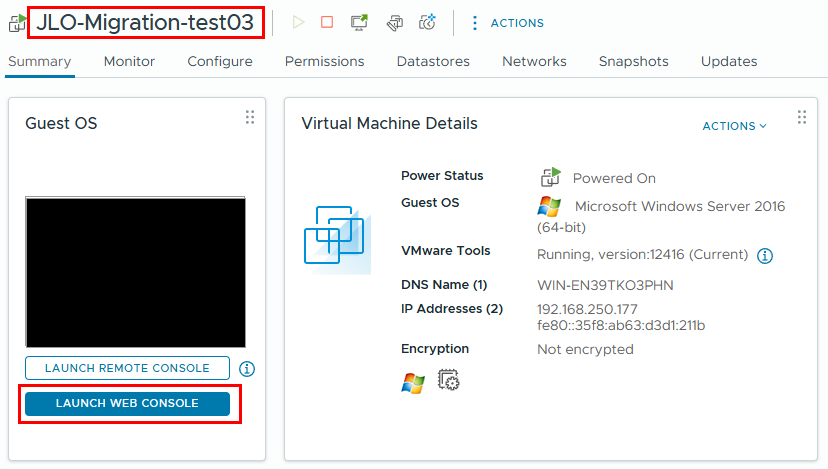

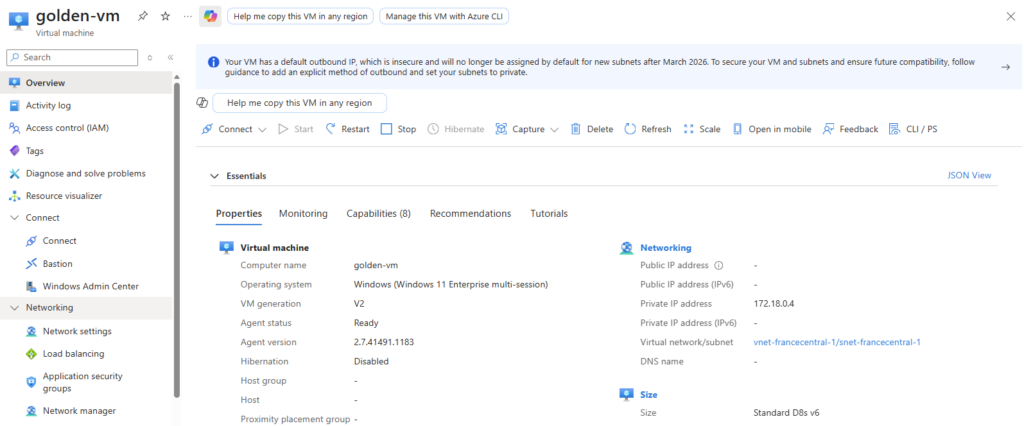

Créez une machine virtuelle Azure :

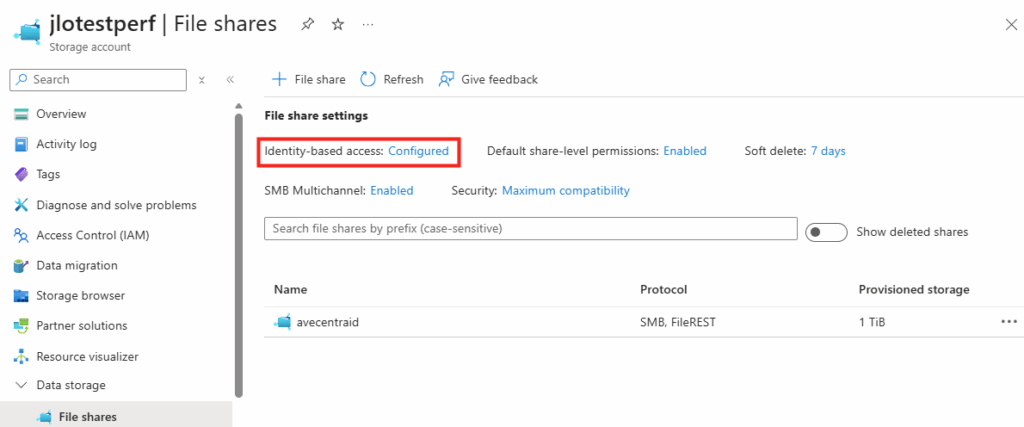

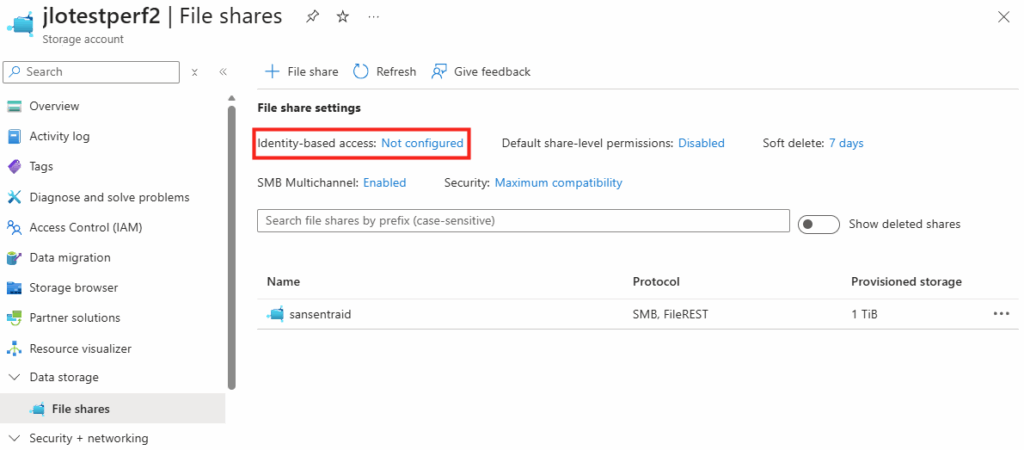

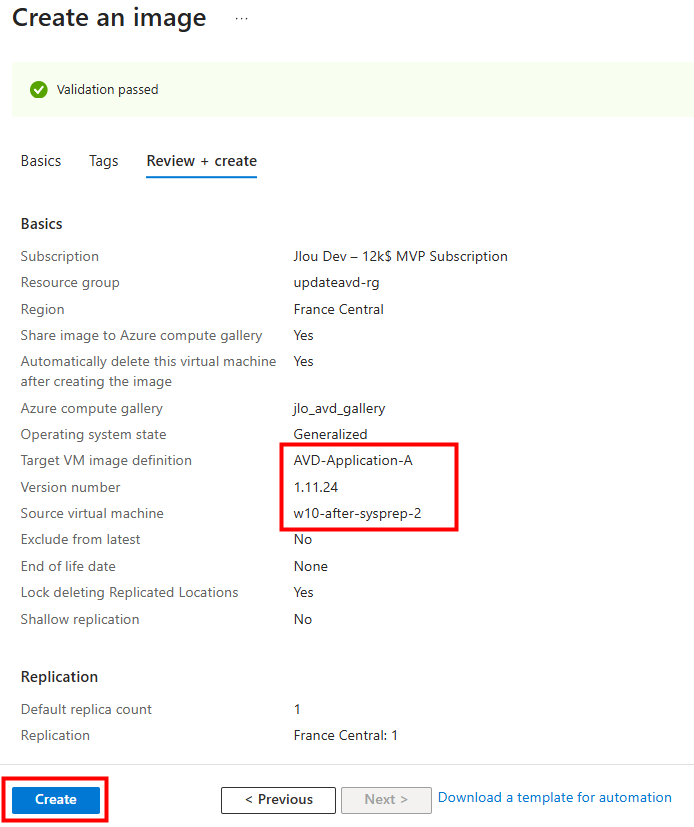

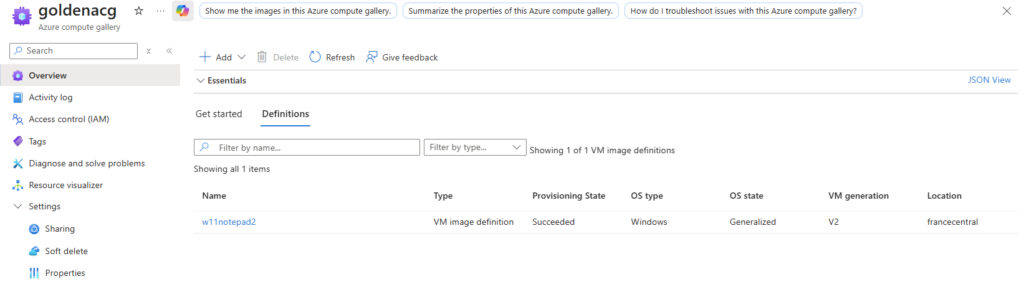

Créez également une galerie d’images :

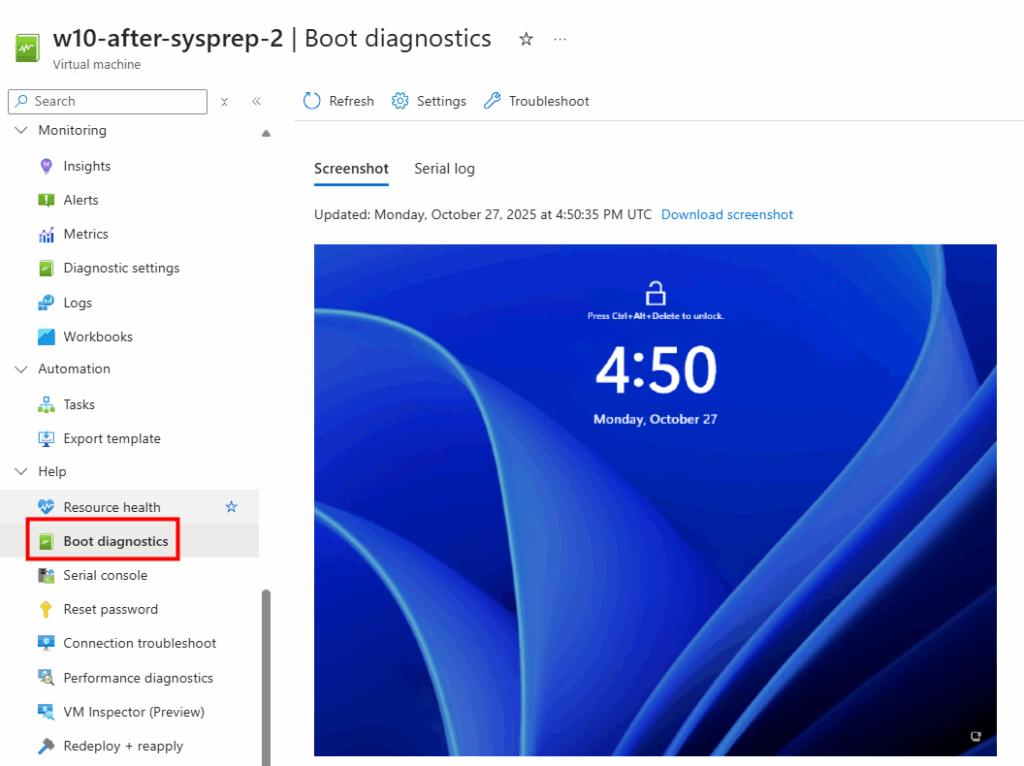

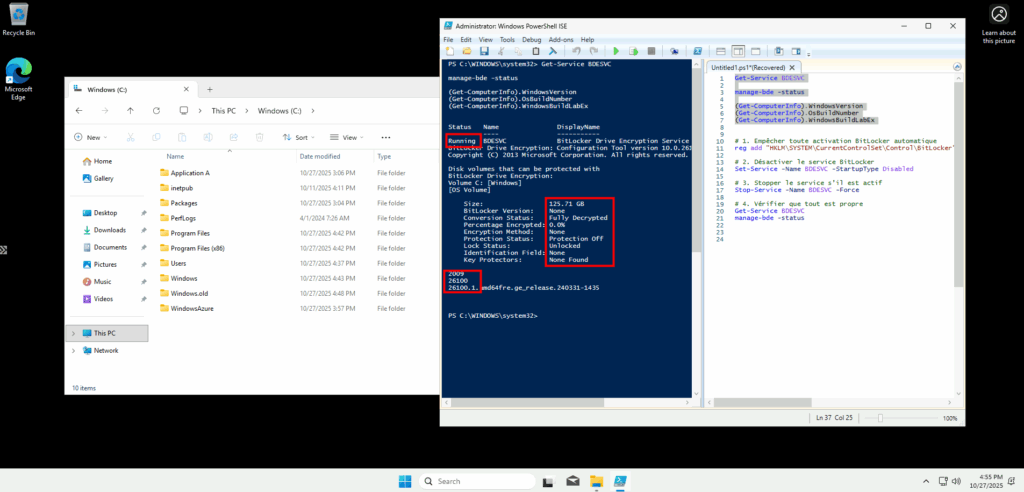

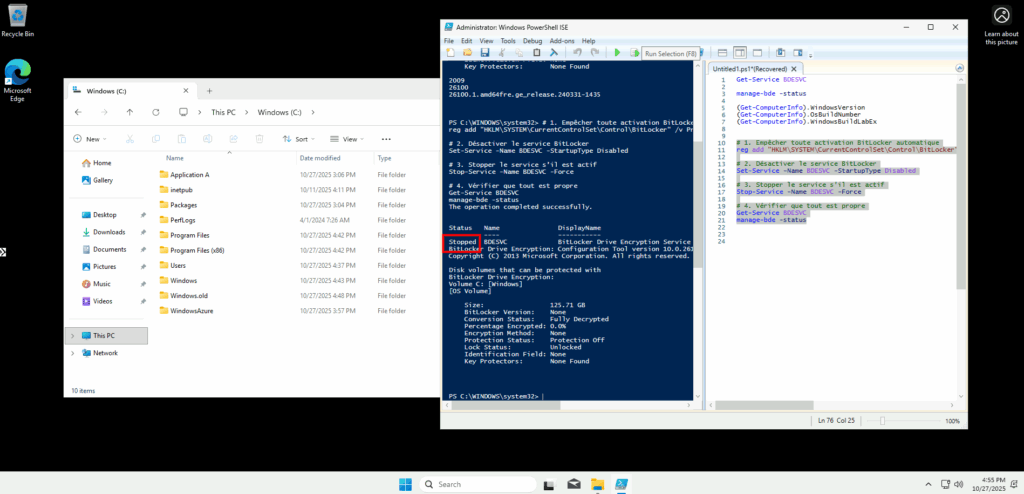

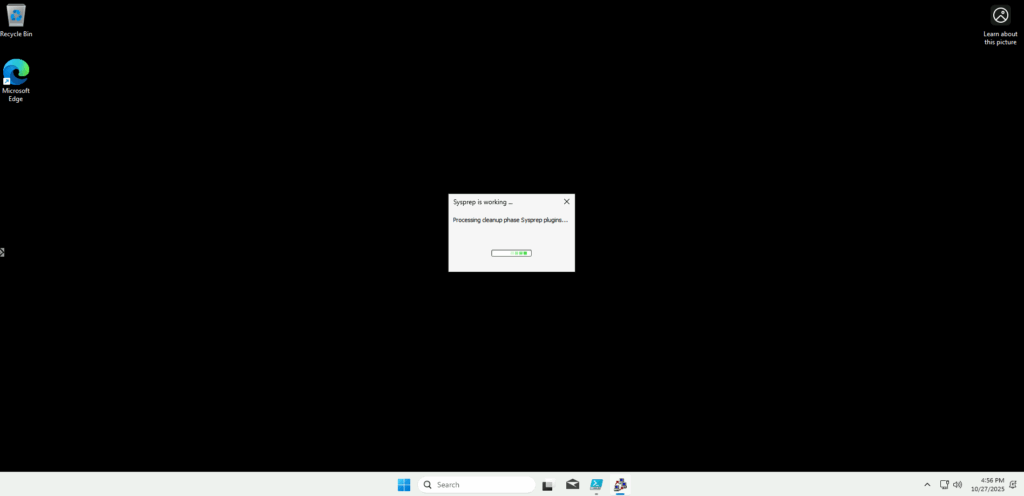

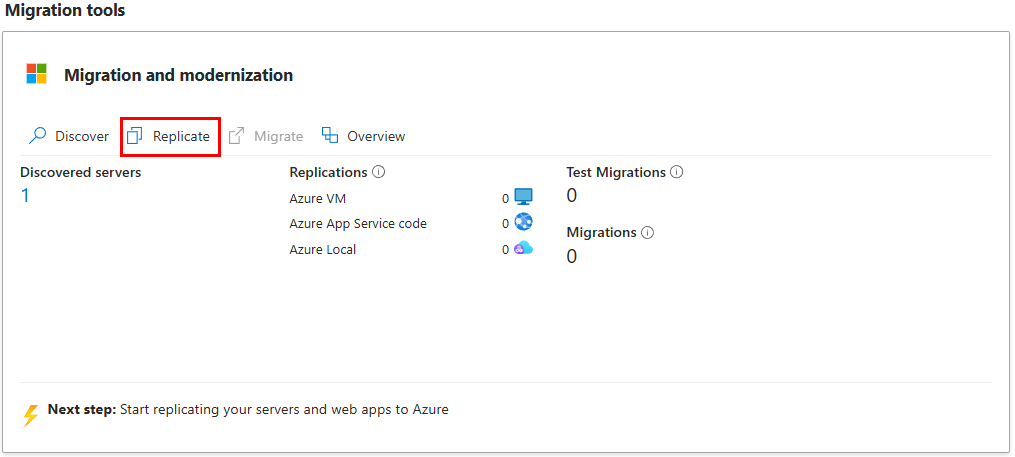

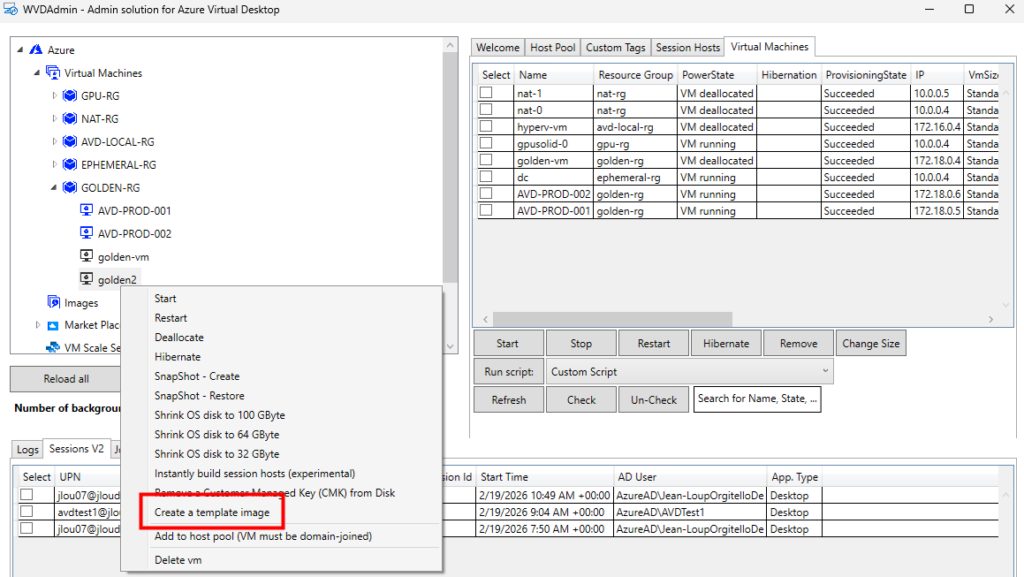

Sur WVDInfra, lancez la création d’image depuis votre machine virtuelle :

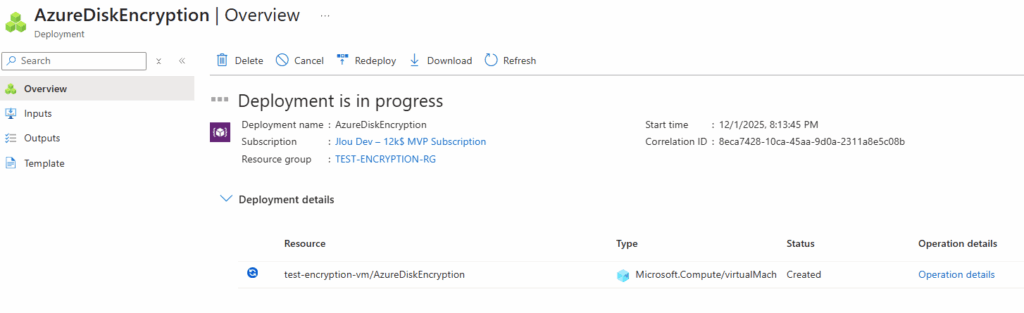

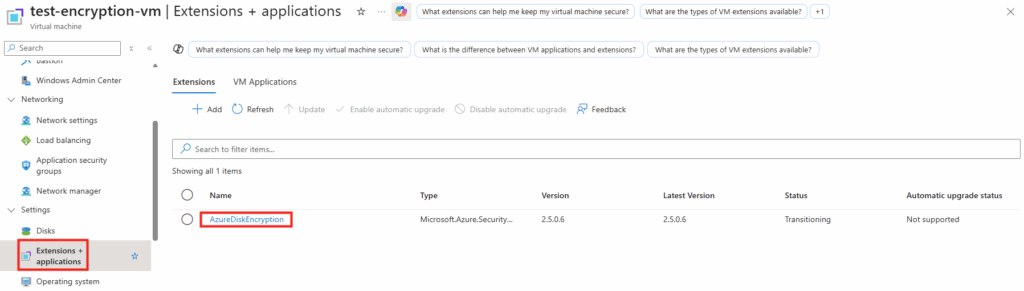

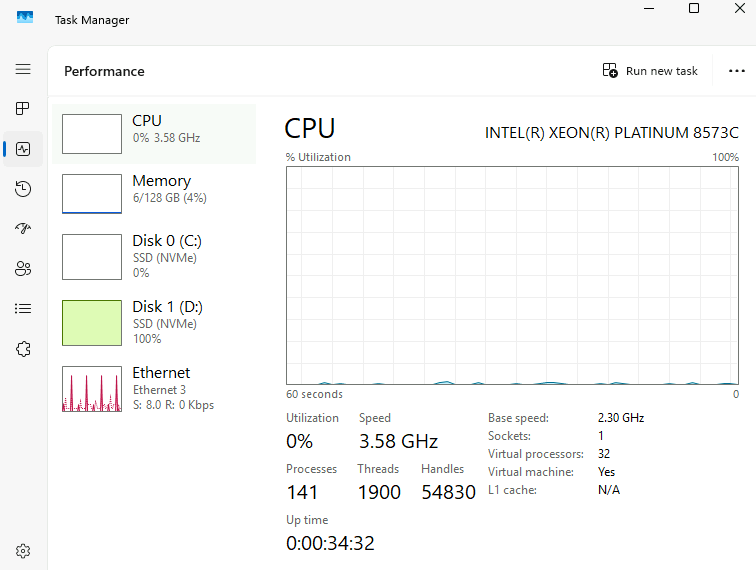

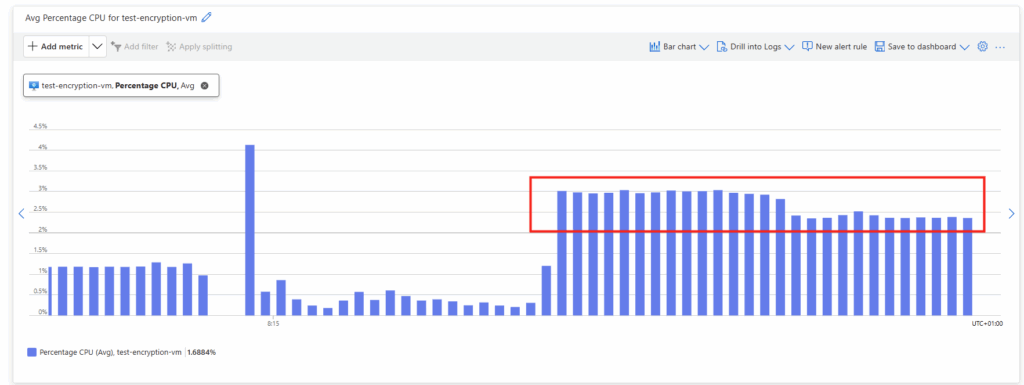

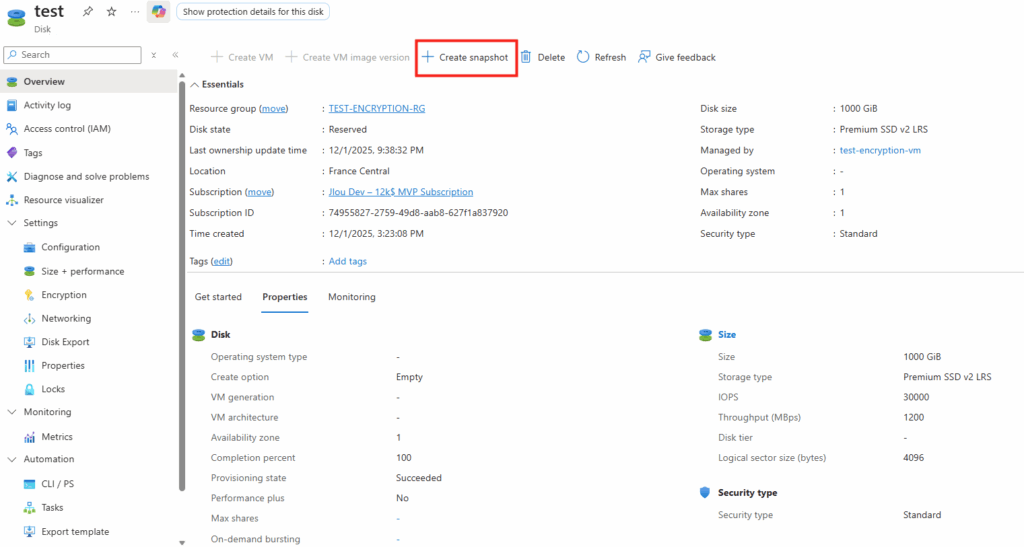

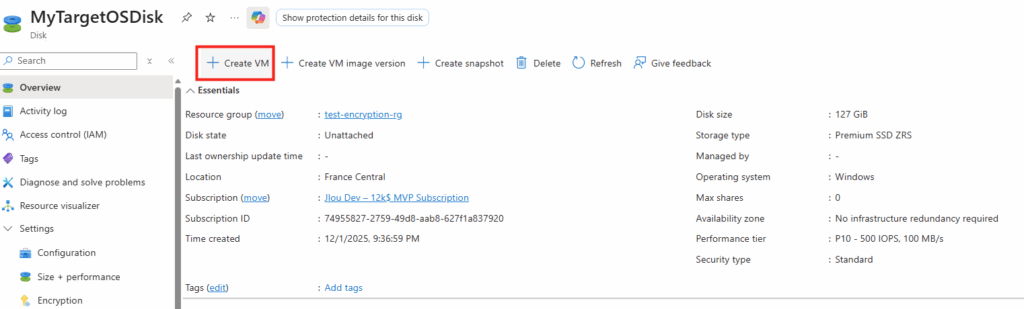

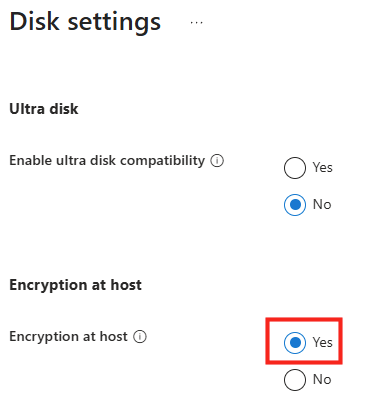

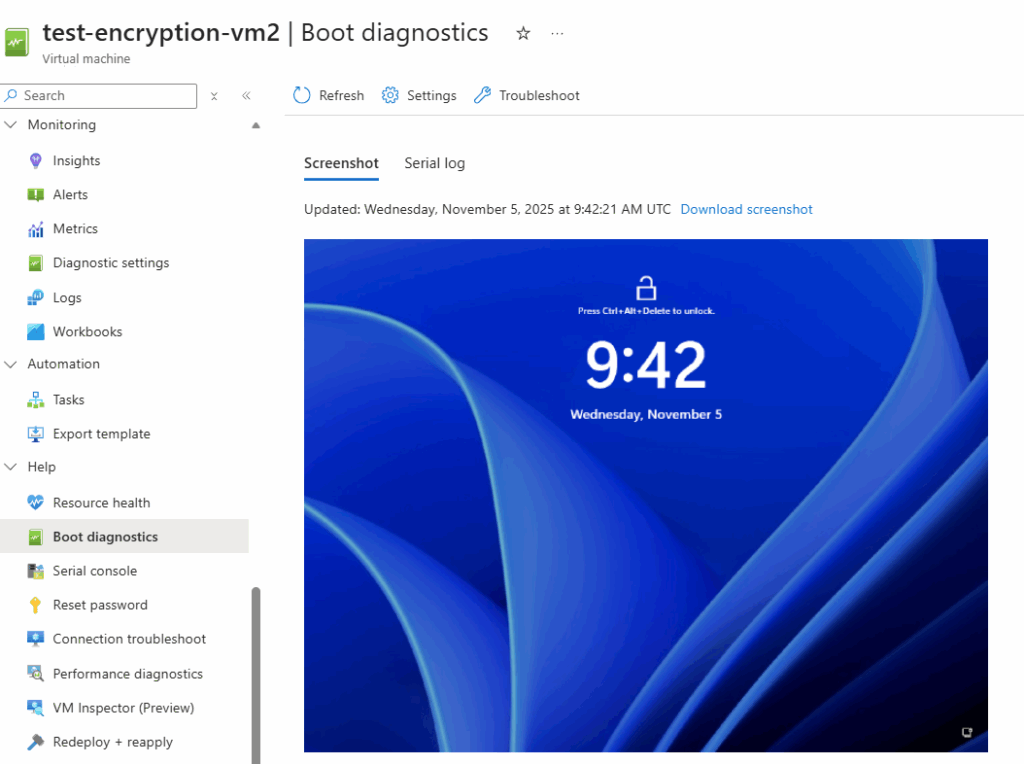

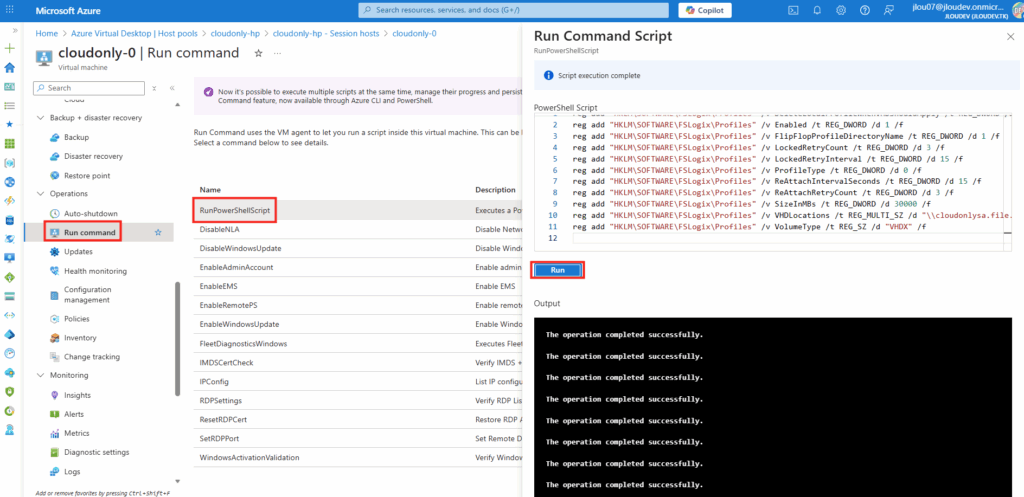

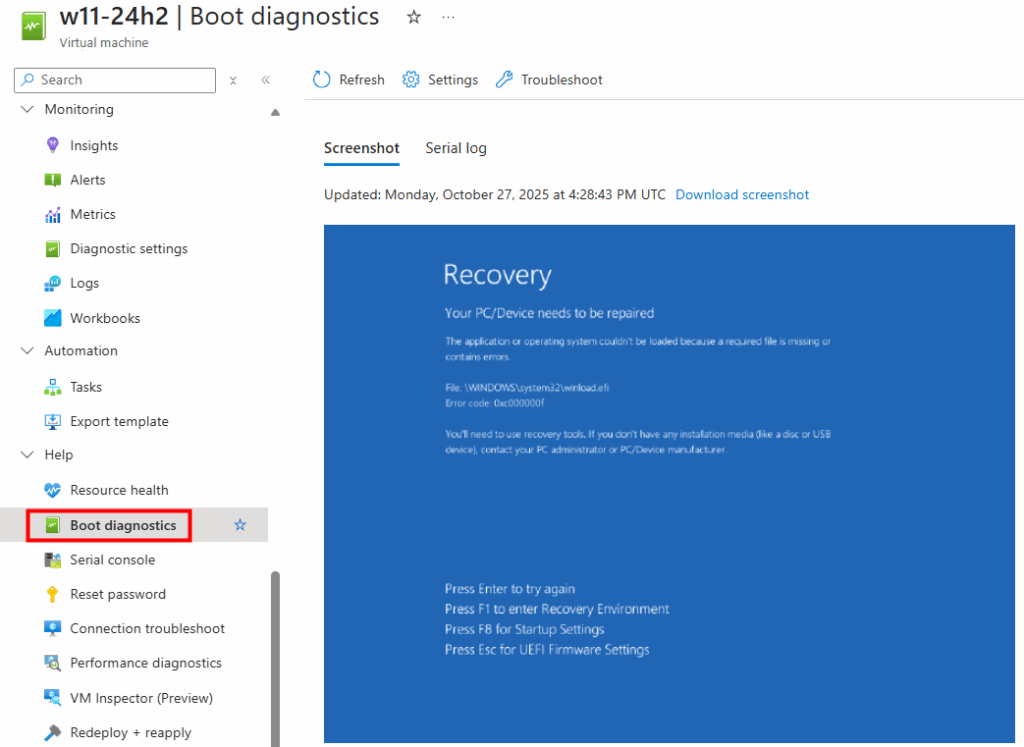

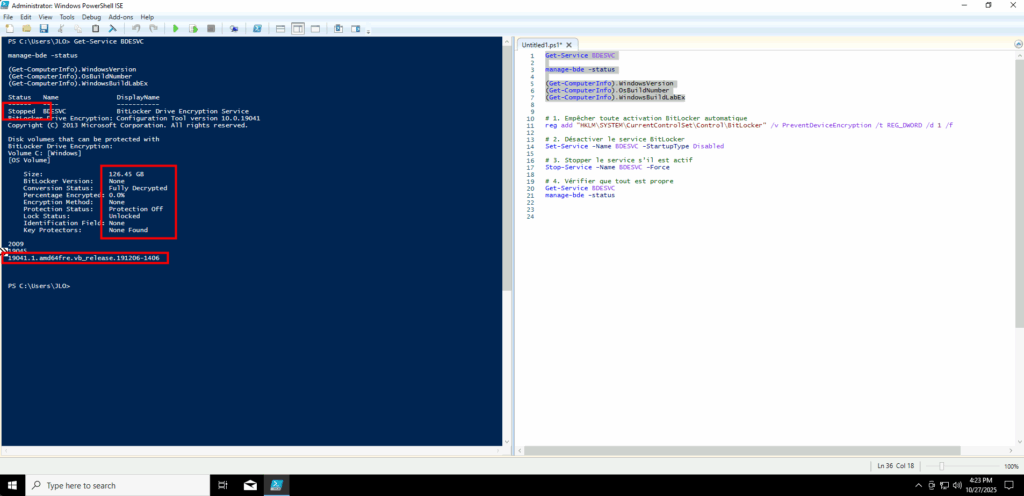

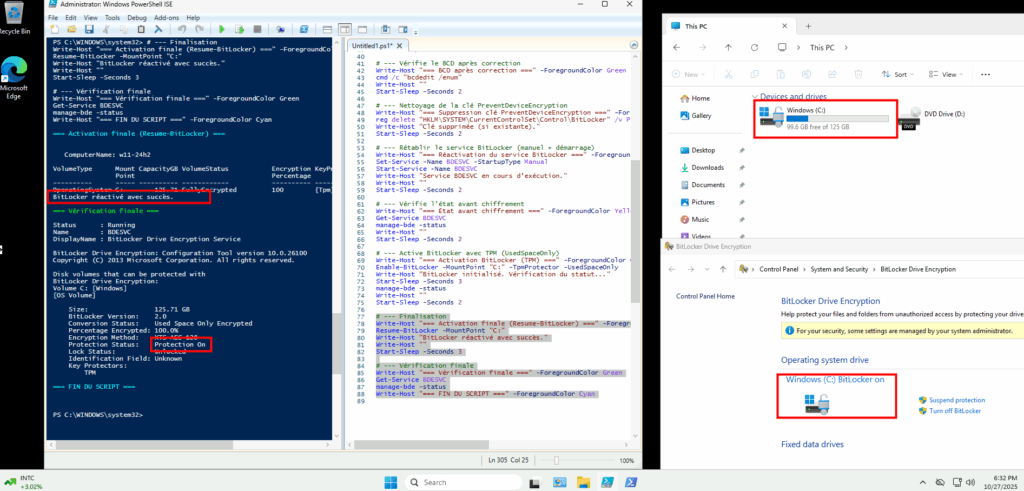

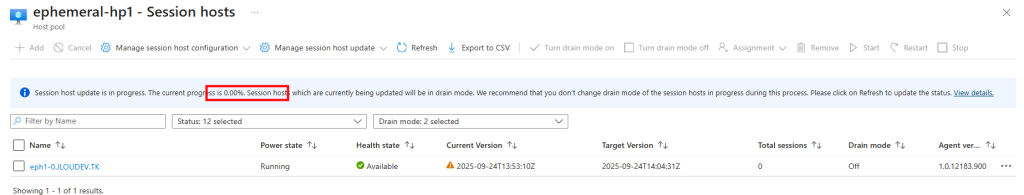

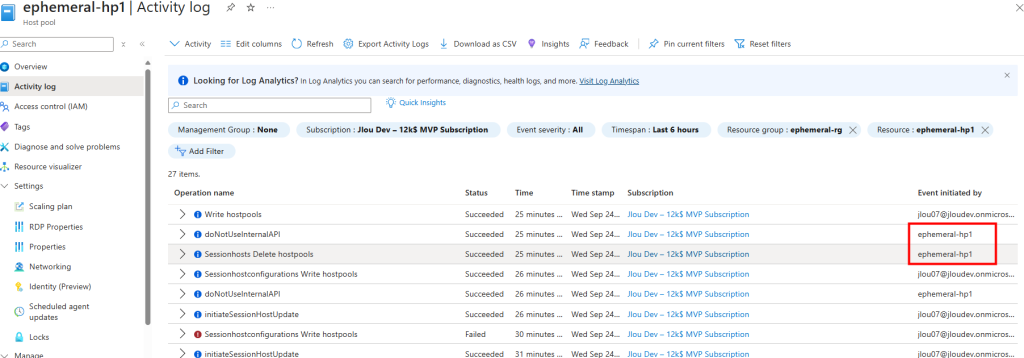

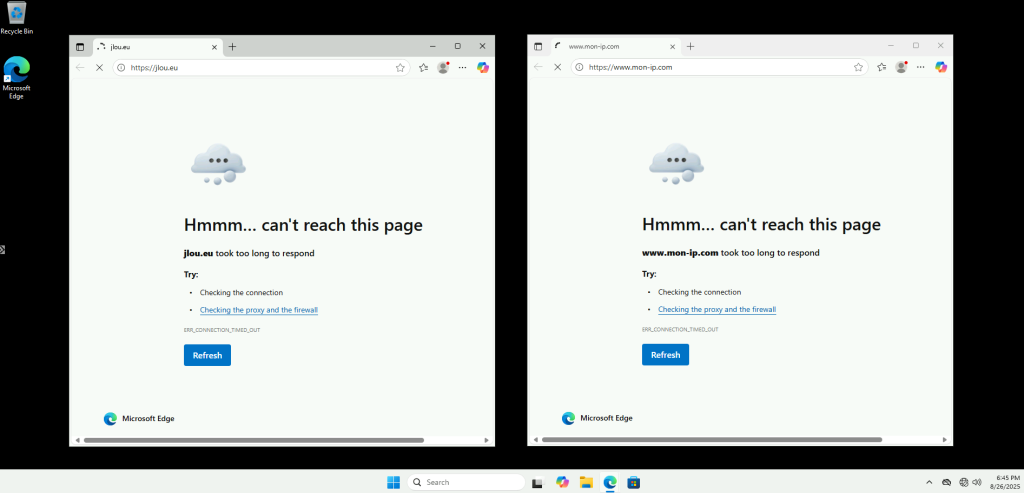

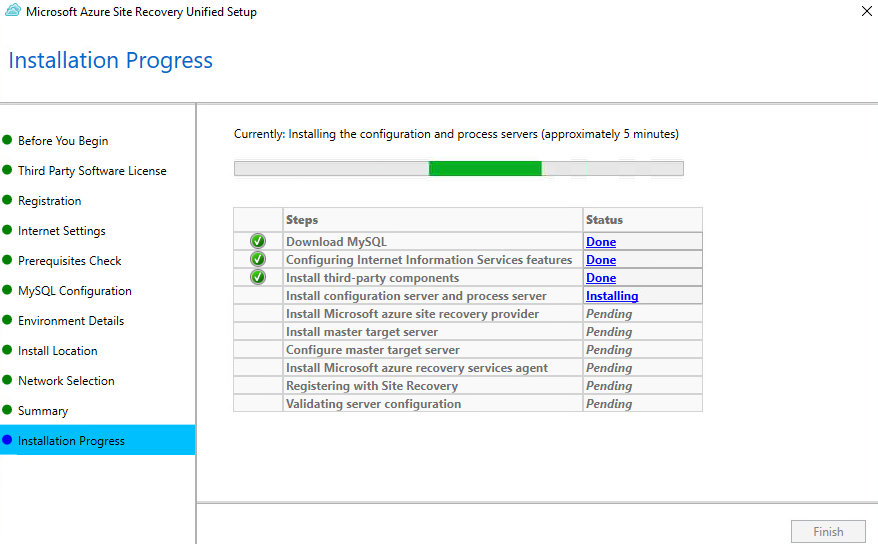

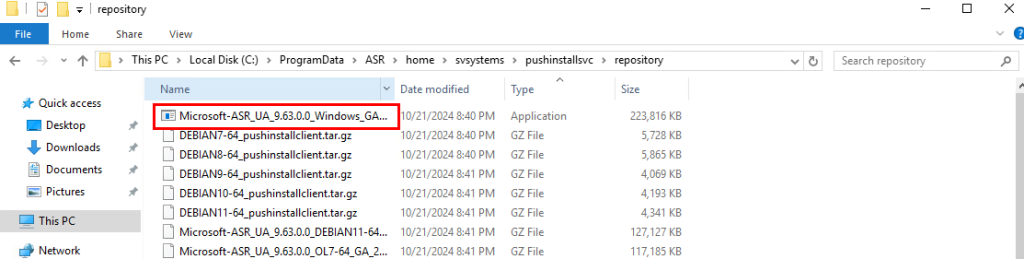

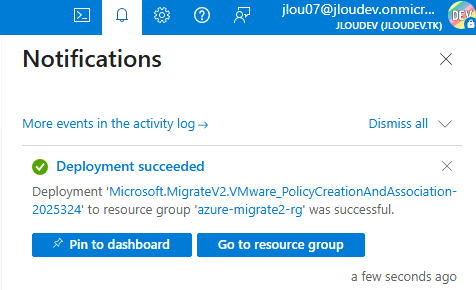

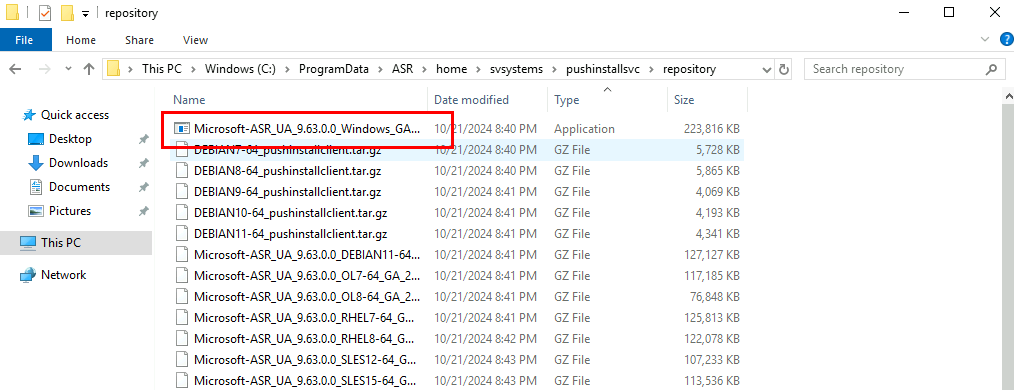

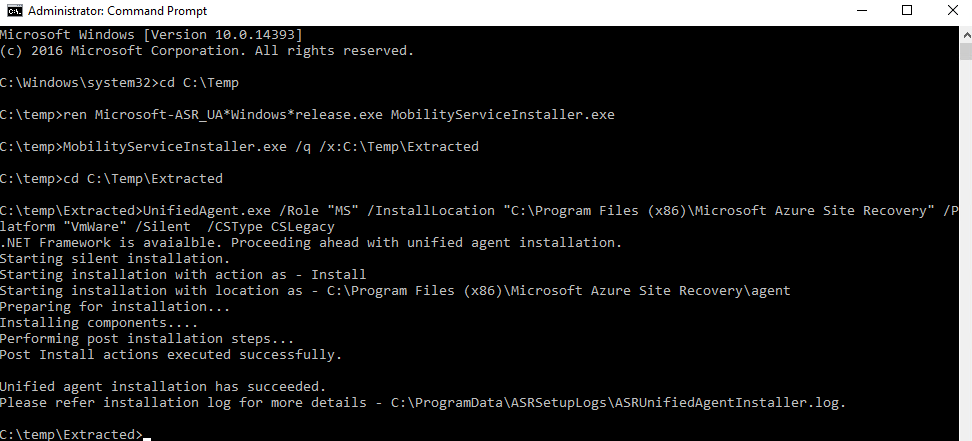

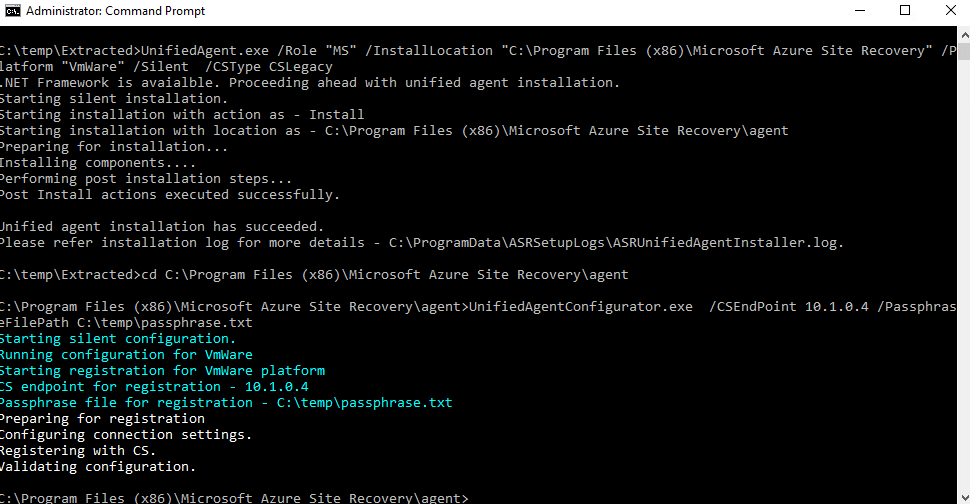

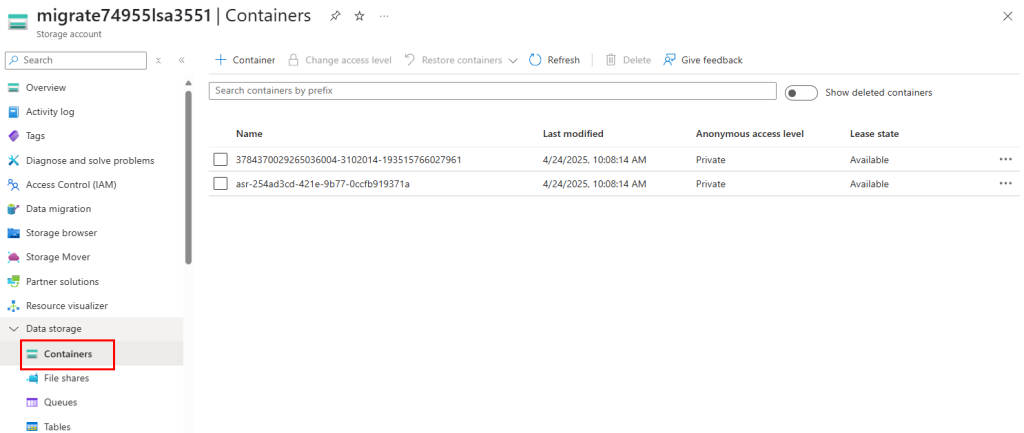

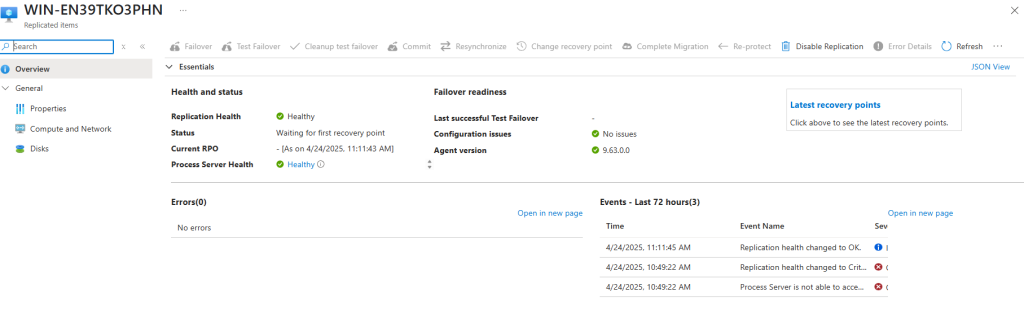

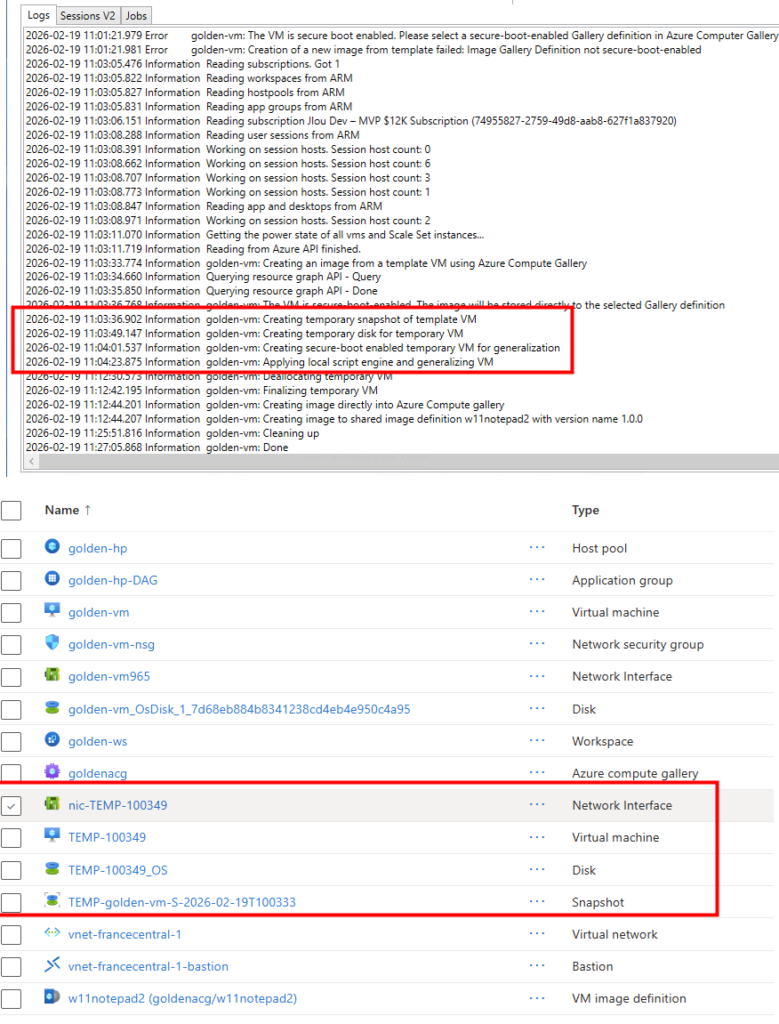

Les journaux de WVDInfra commence par montrer la création de ressources Azure temporaires (snapshot, VM temporaire, disque temporaire) :

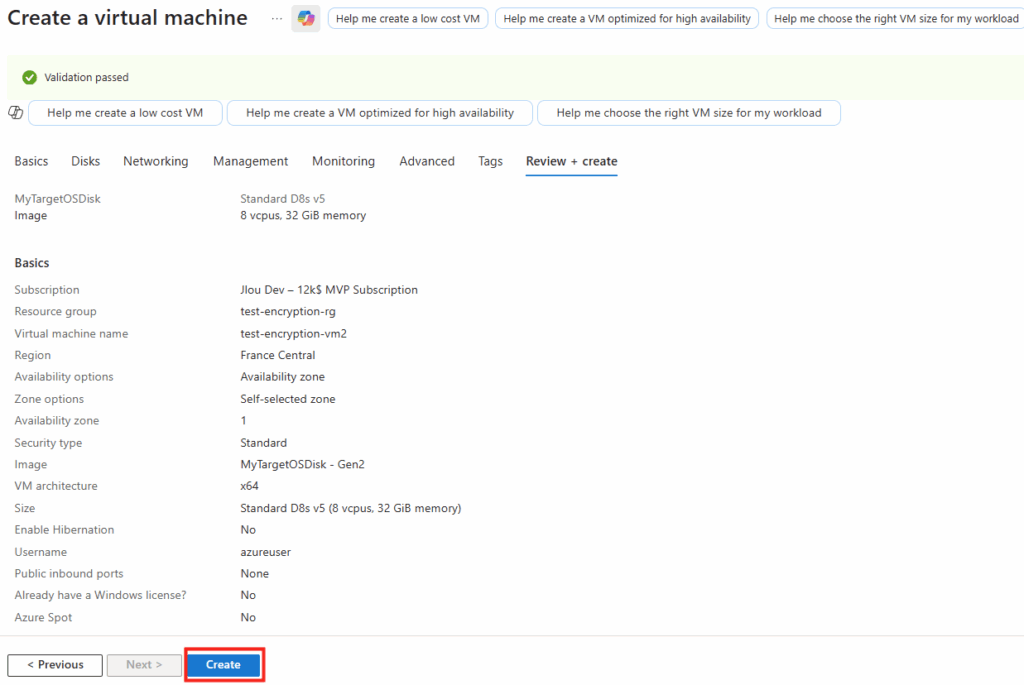

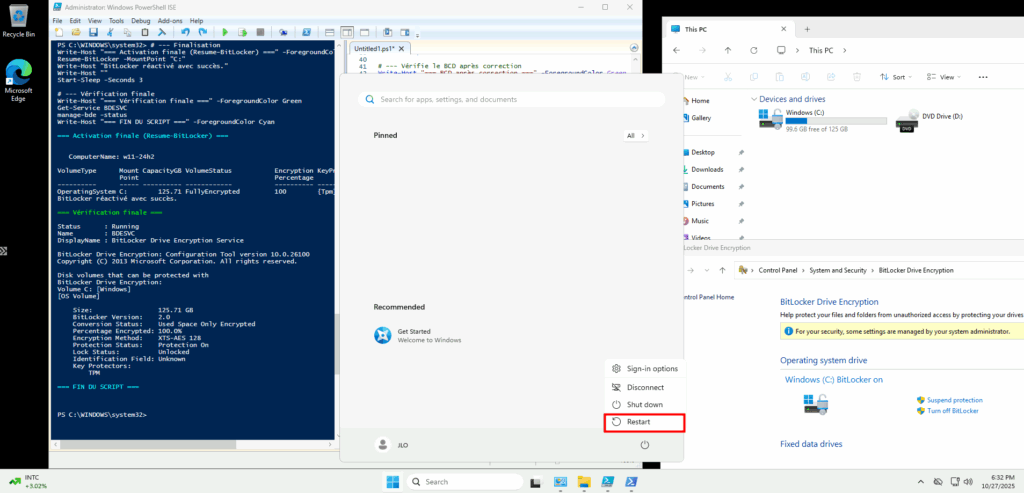

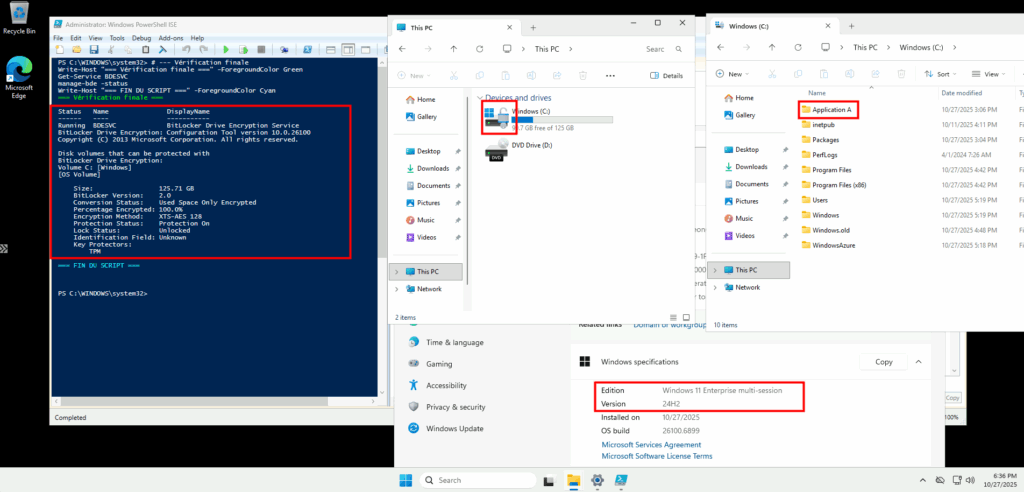

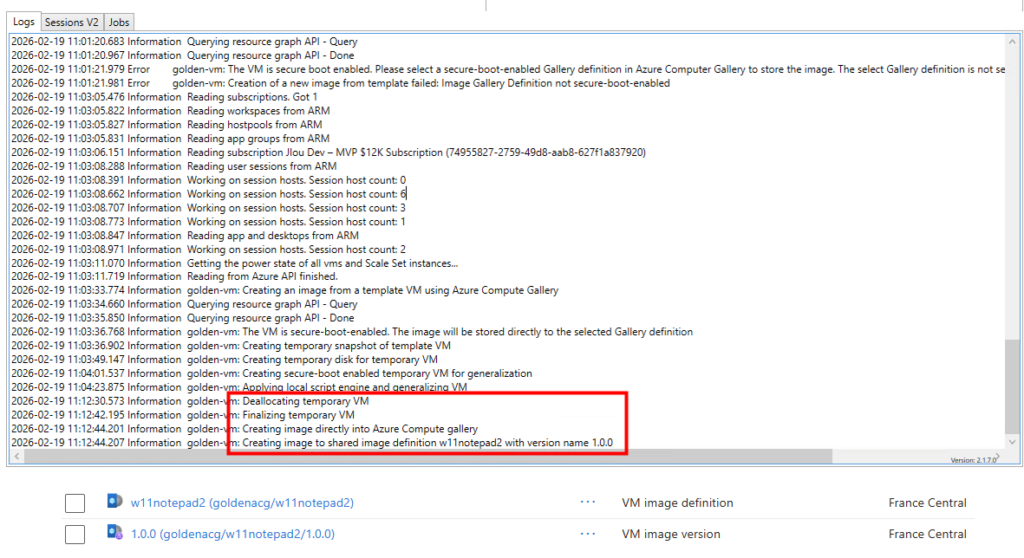

Par la suite, les journaux de WVDInfra montre la généralisation de l’image, la création de la version dans la galerie :

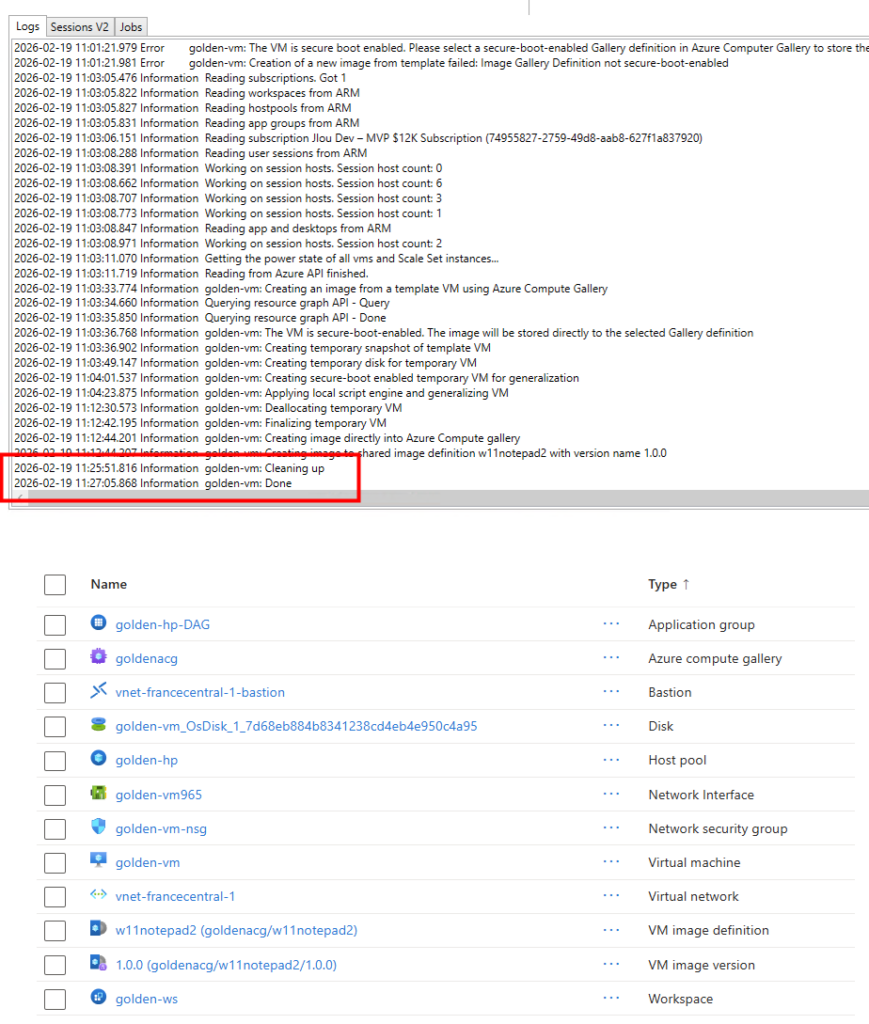

Enfin, les journaux de WVDInfra montre le nettoyage complet des ressources Azure temporaires :

En quelques clics, nous avons une image prête à être déployée sur votre environnement Azure Virtual Desktop. La suite des étapes se fait toujours dans WVDInfra.

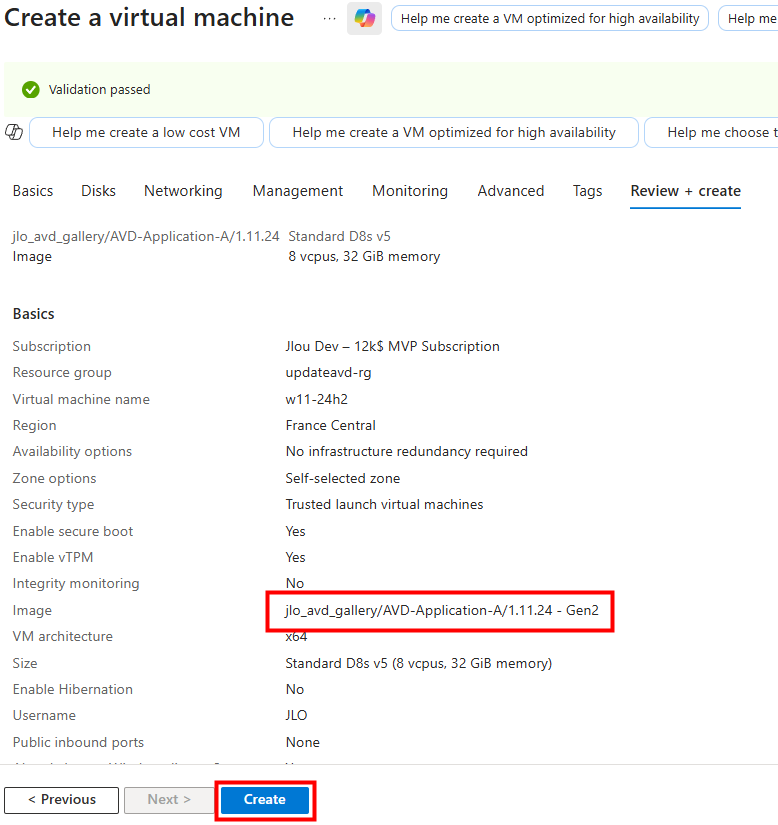

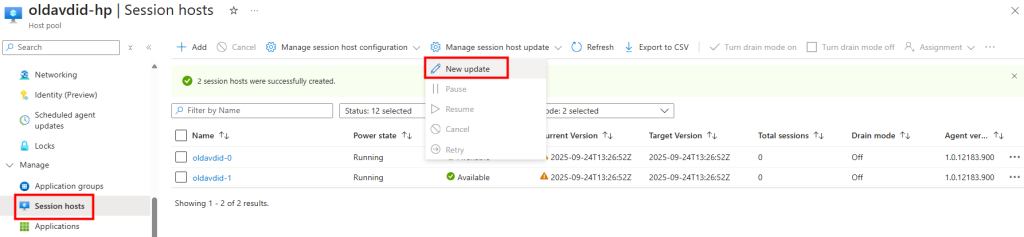

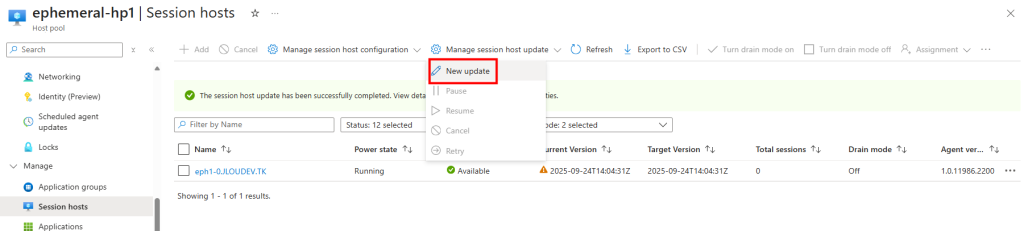

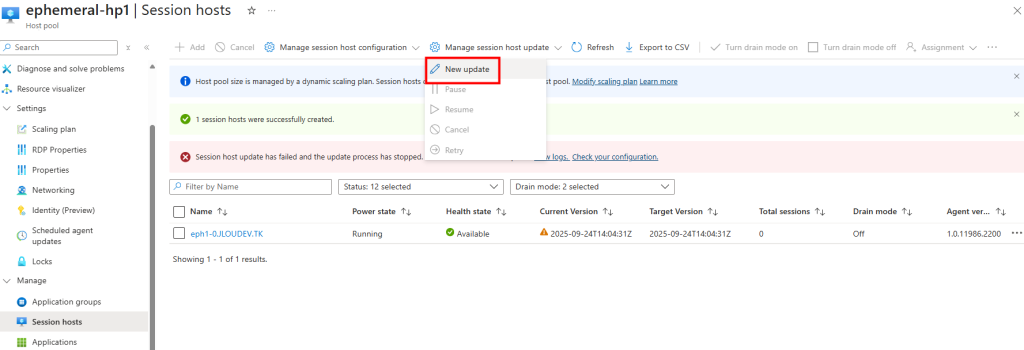

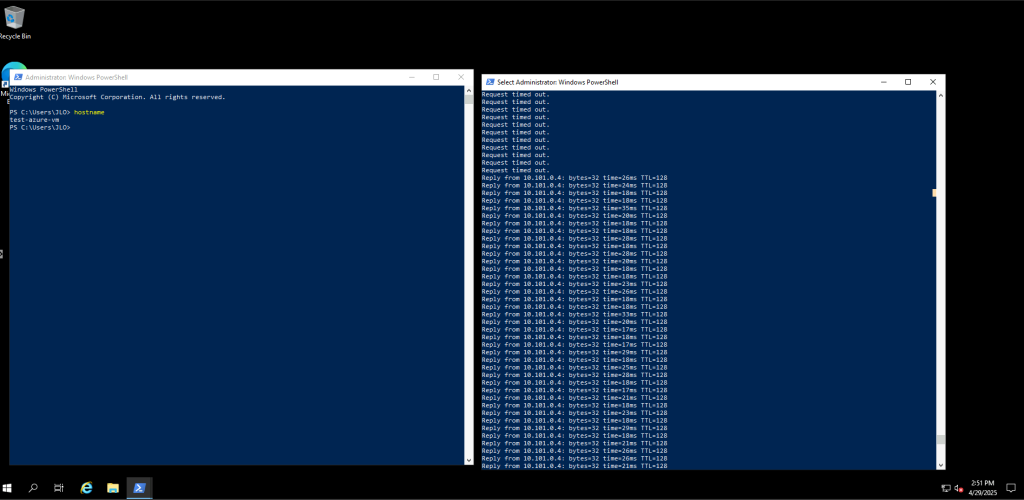

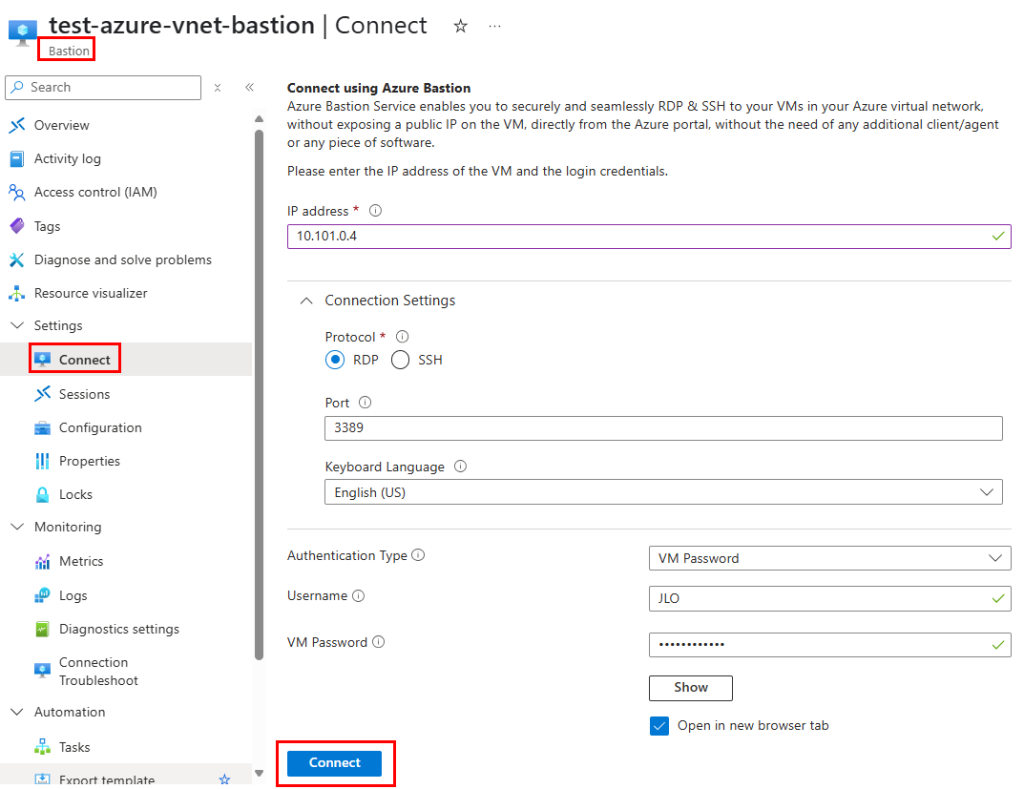

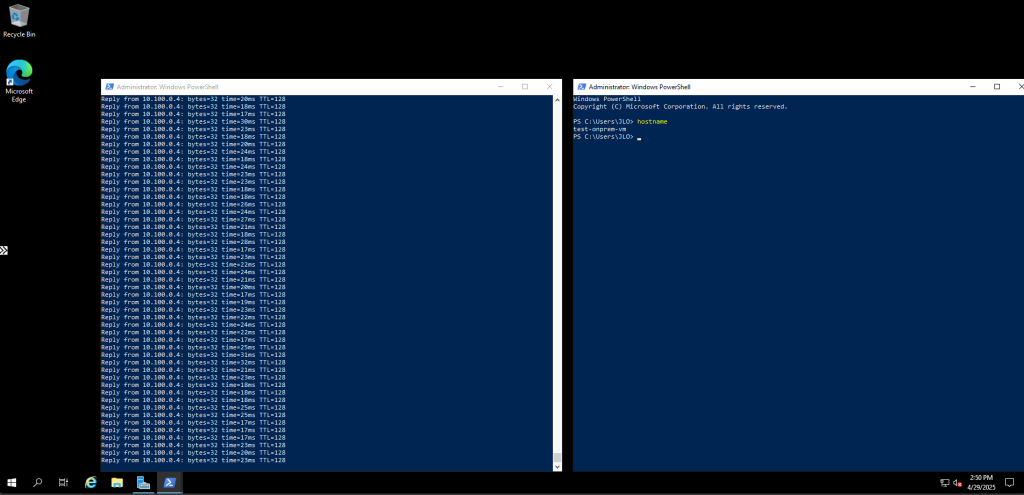

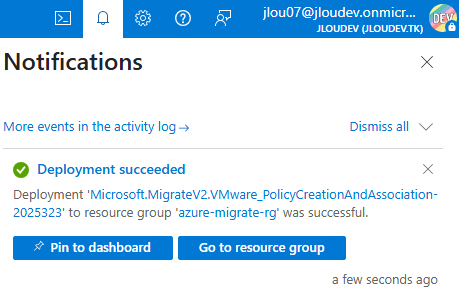

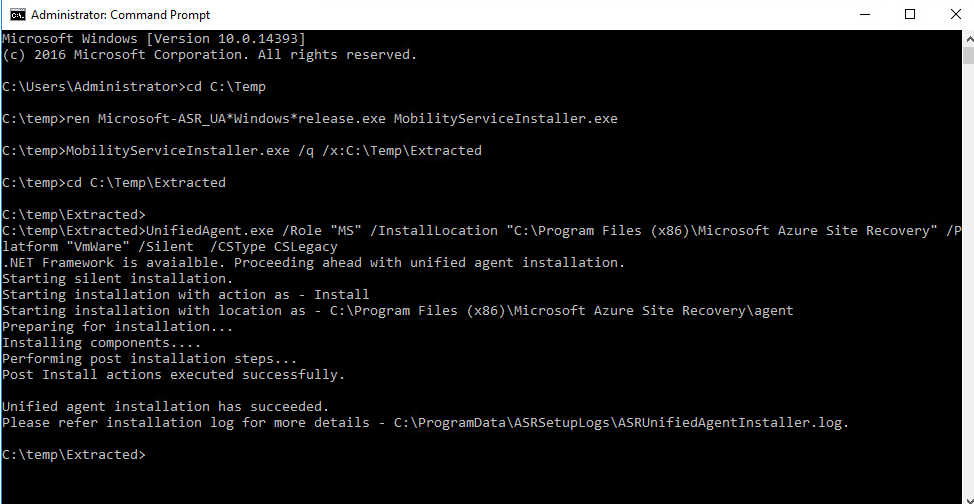

Etape V – Test de création d’un hôte :

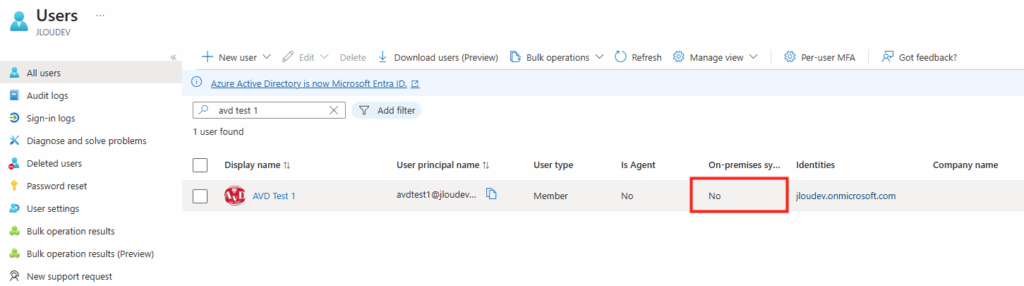

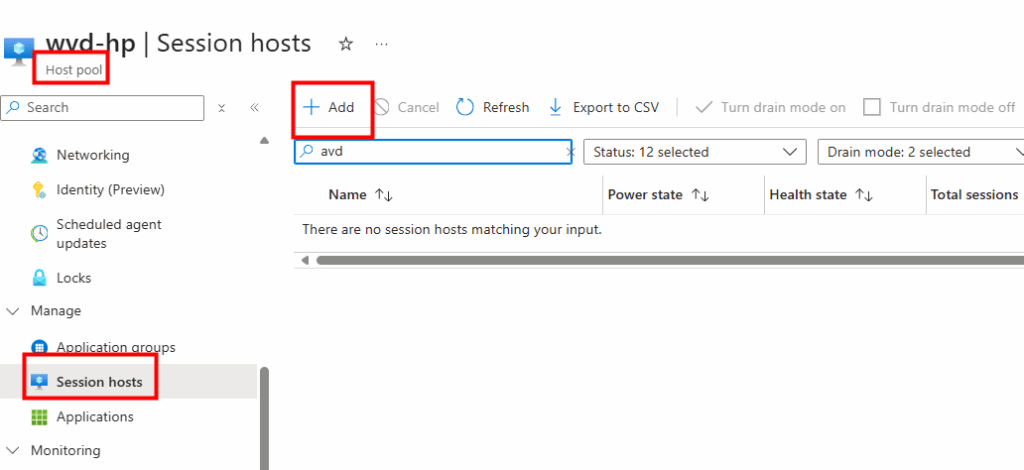

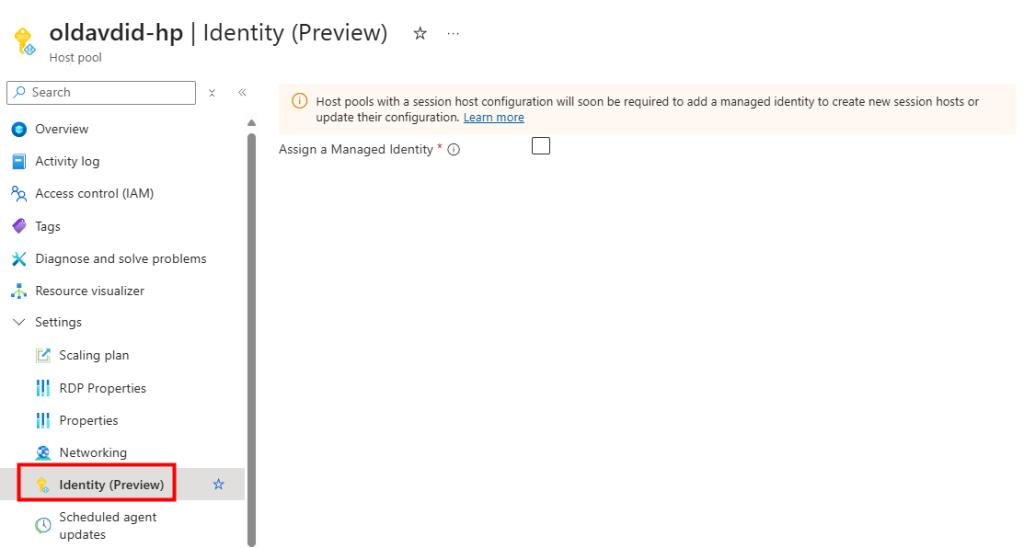

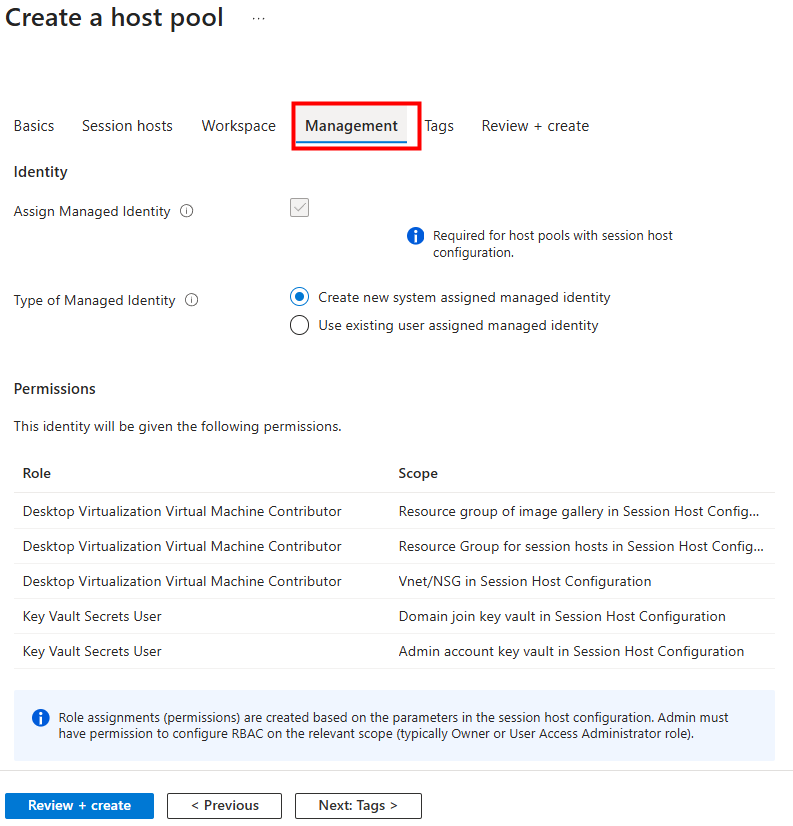

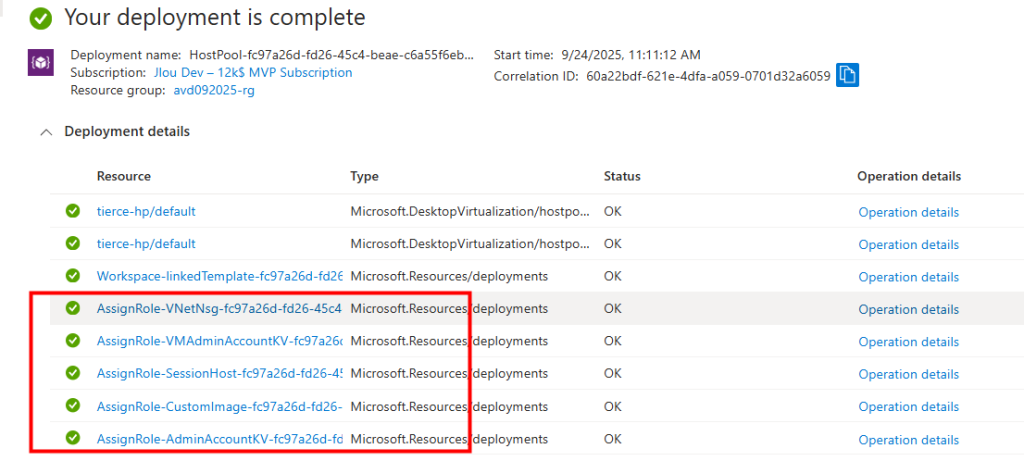

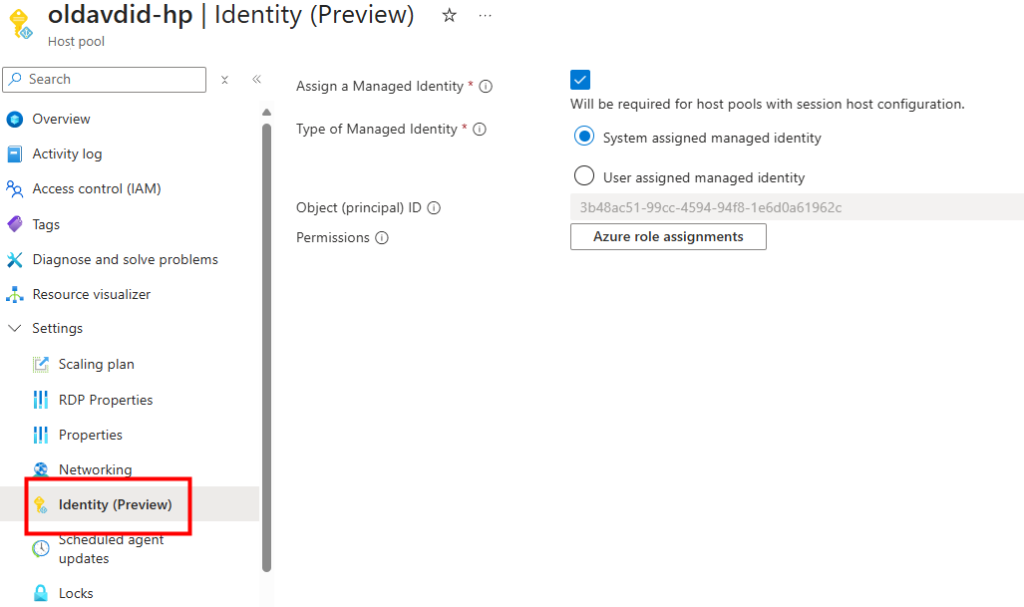

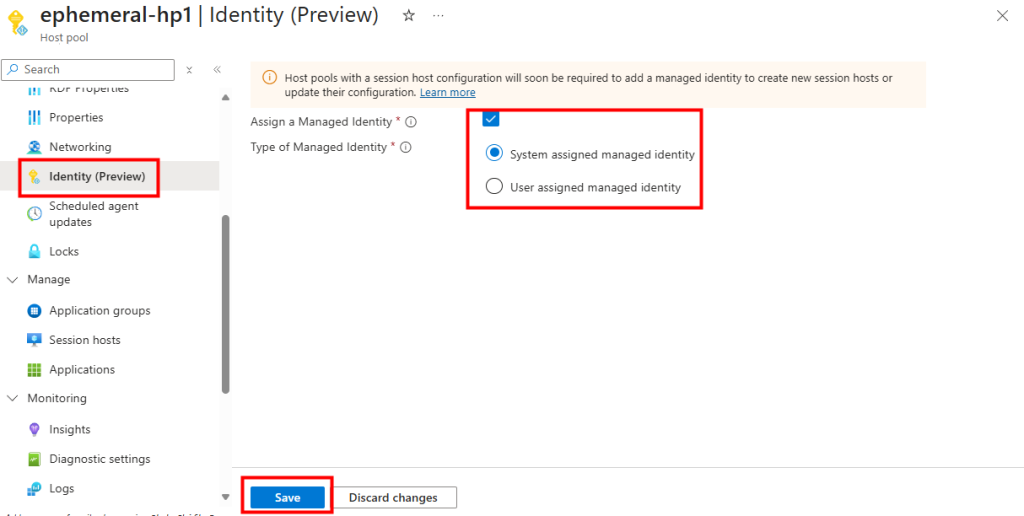

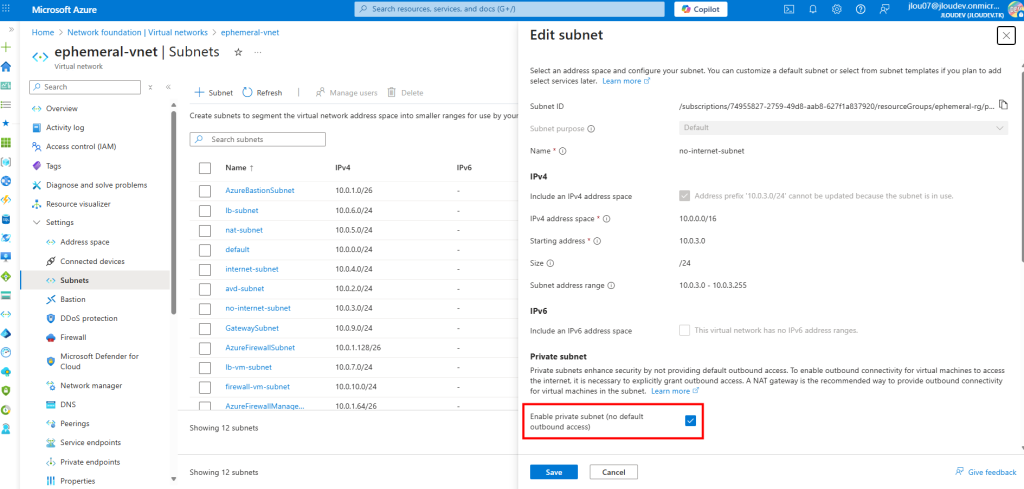

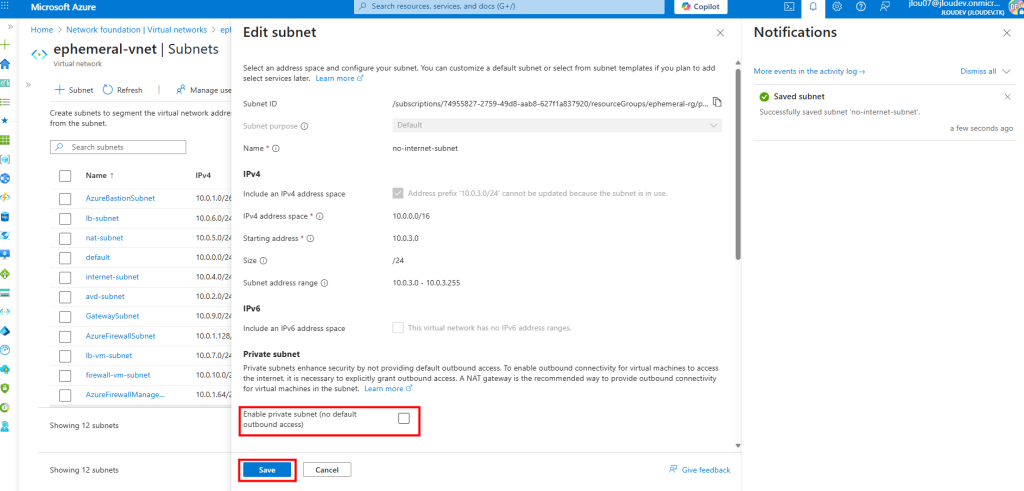

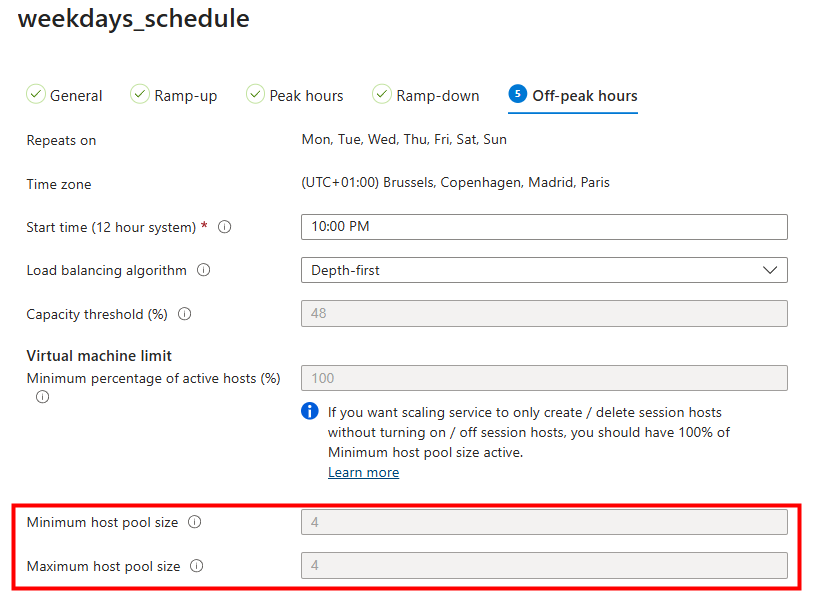

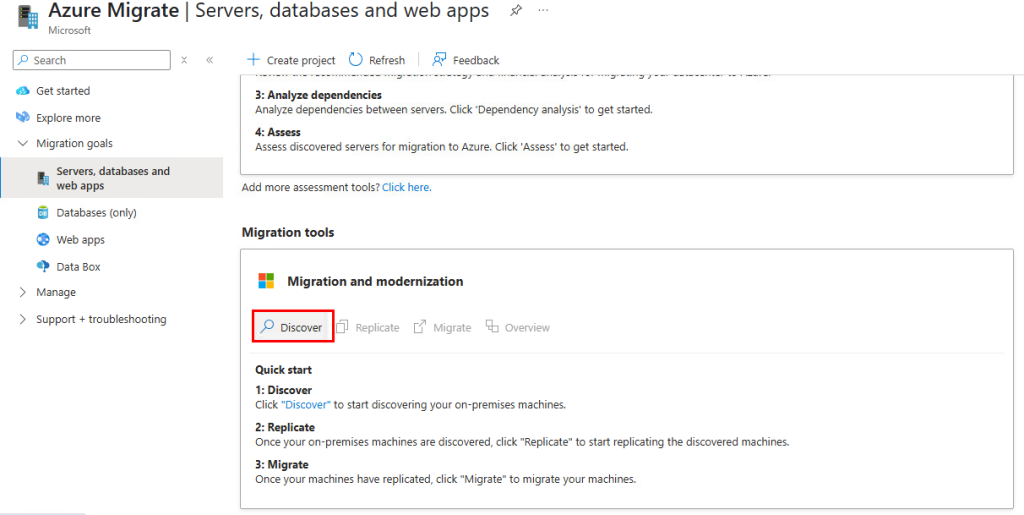

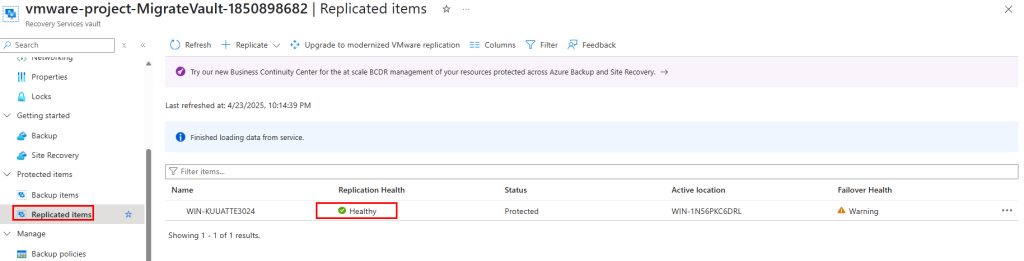

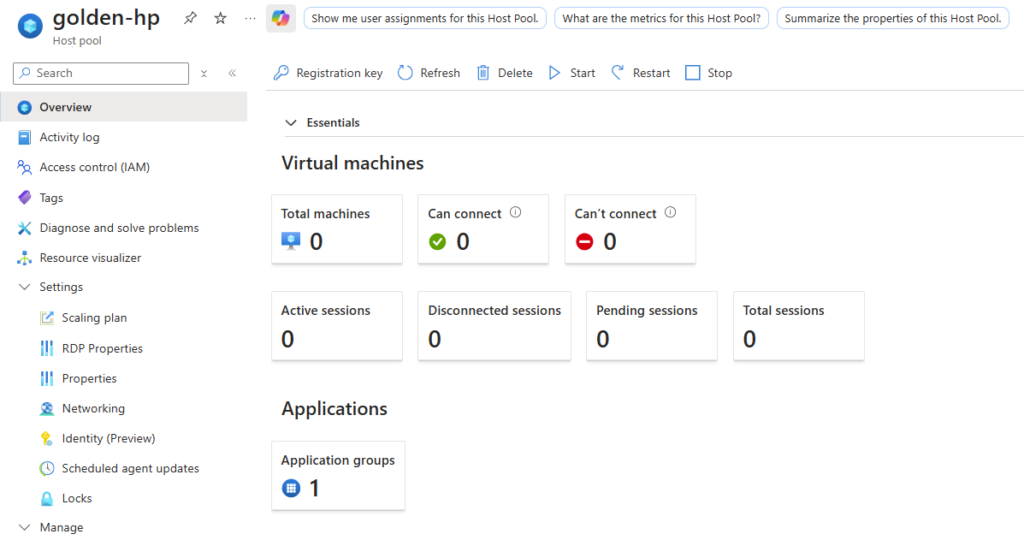

Avant cela, créez les objets AVD de base (pools d’hôtes, groupes d’applications, espaces de travail) :

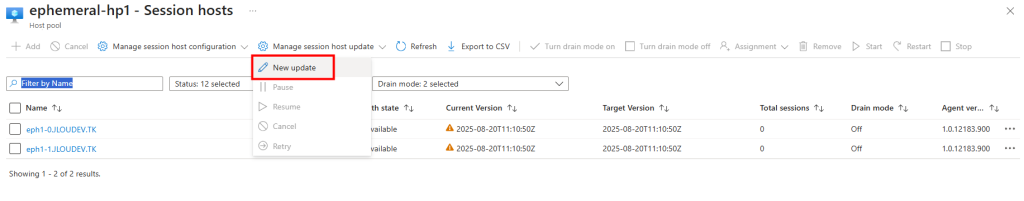

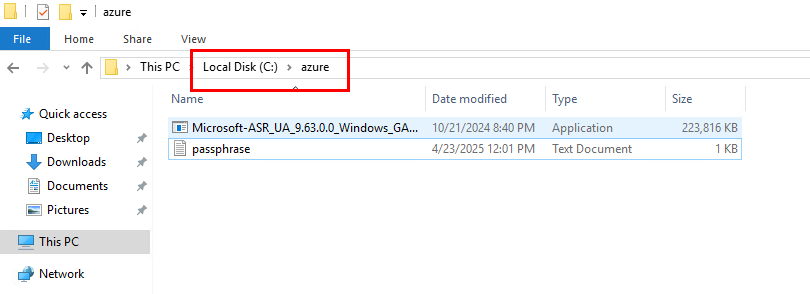

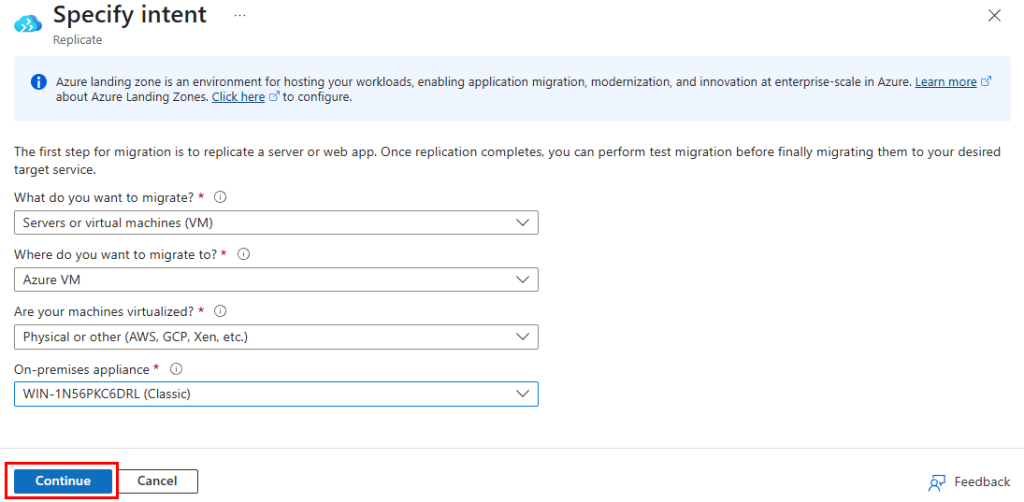

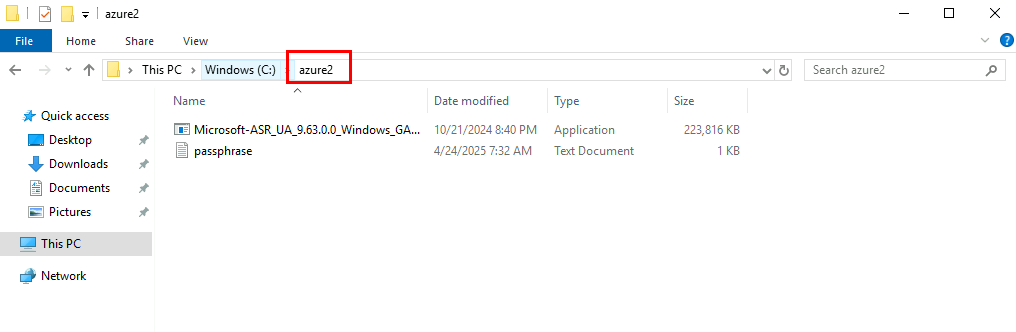

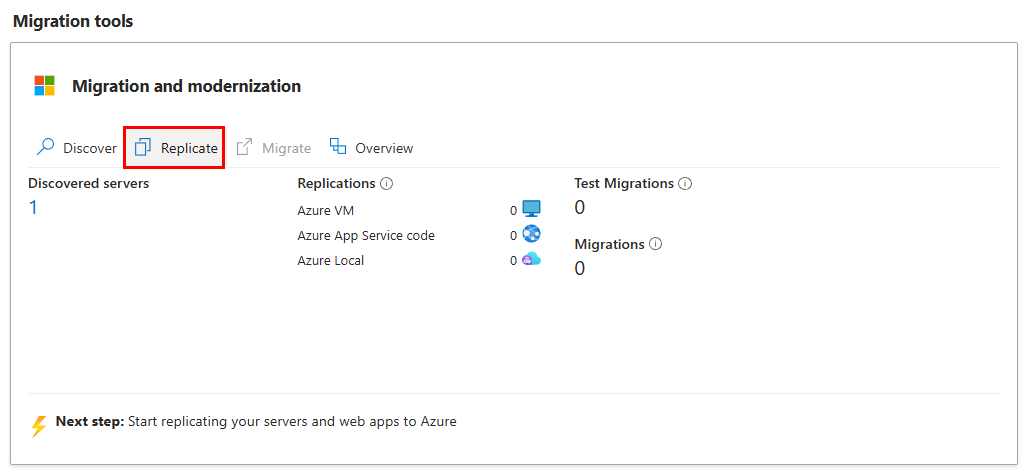

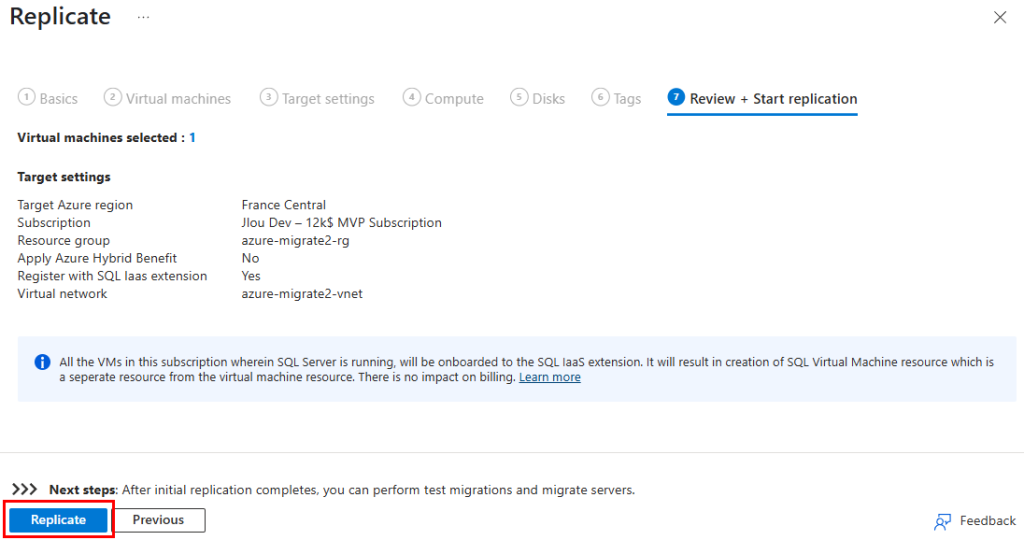

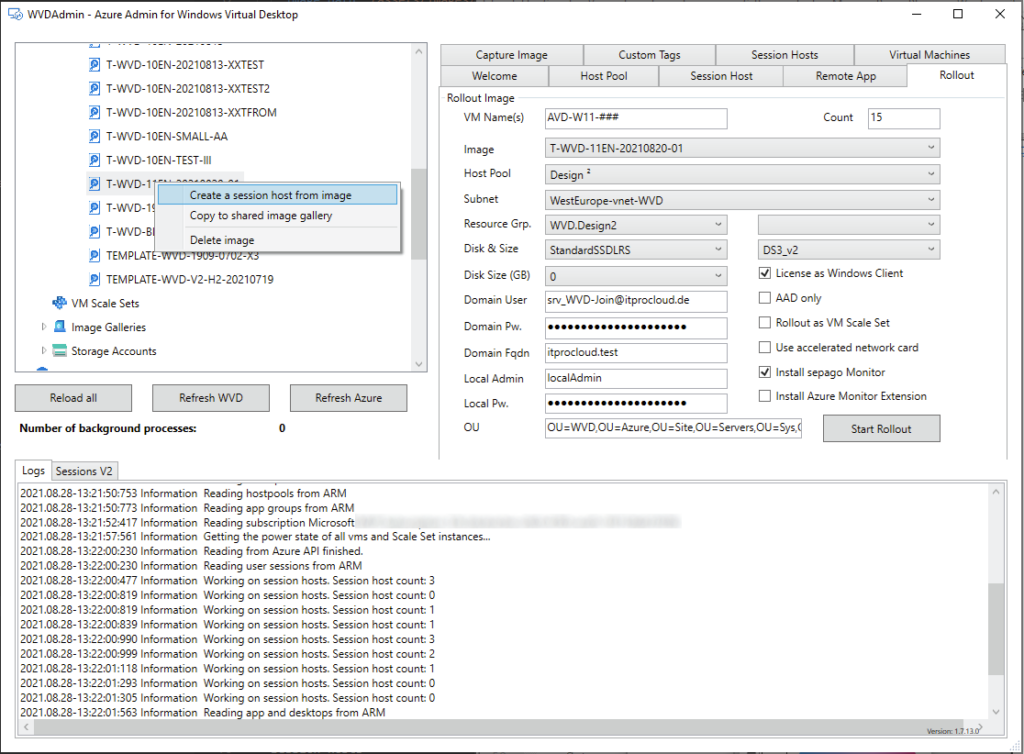

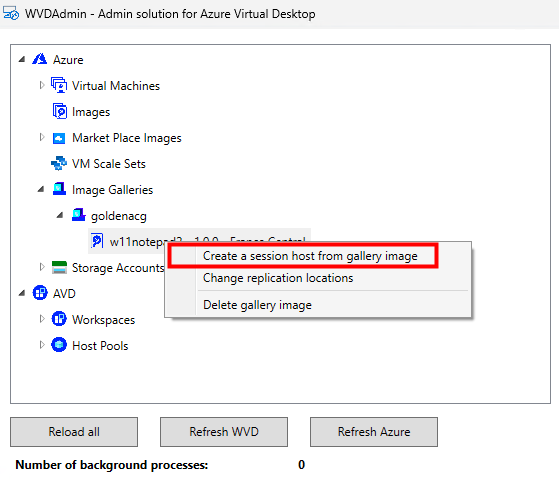

Retournez sur WVDInfra, sélectionnez la version d’image, puis lancez le processus de création d’hôtes AVD :

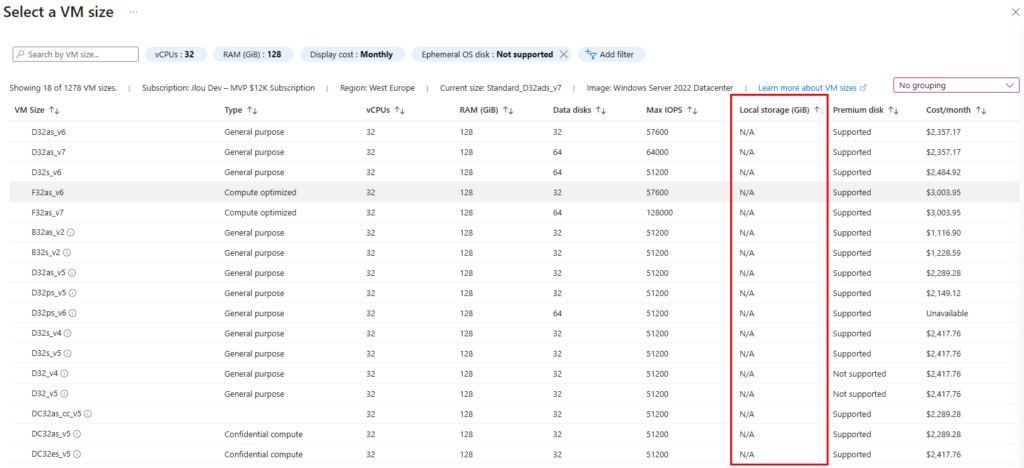

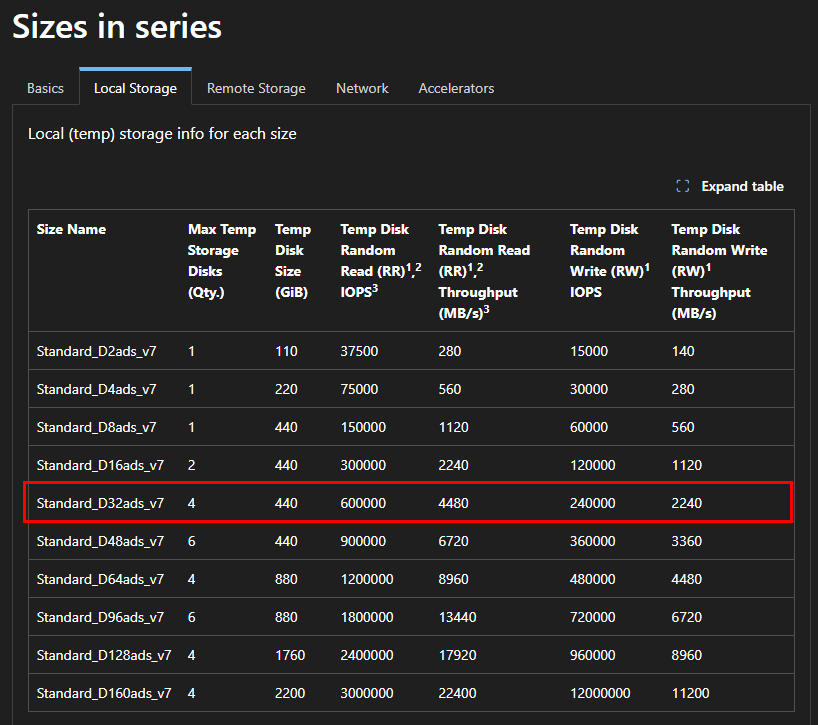

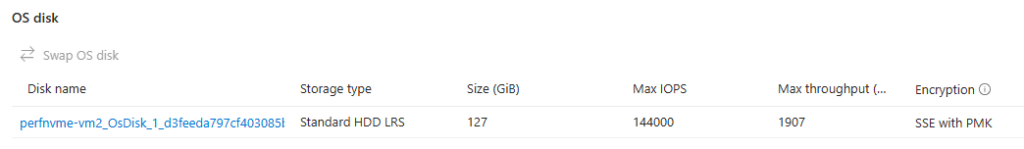

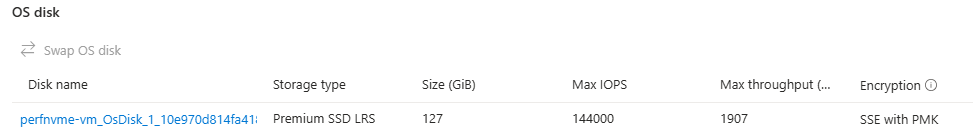

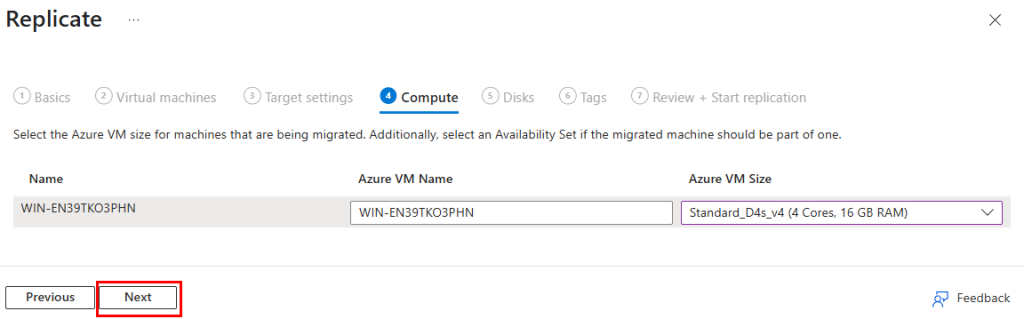

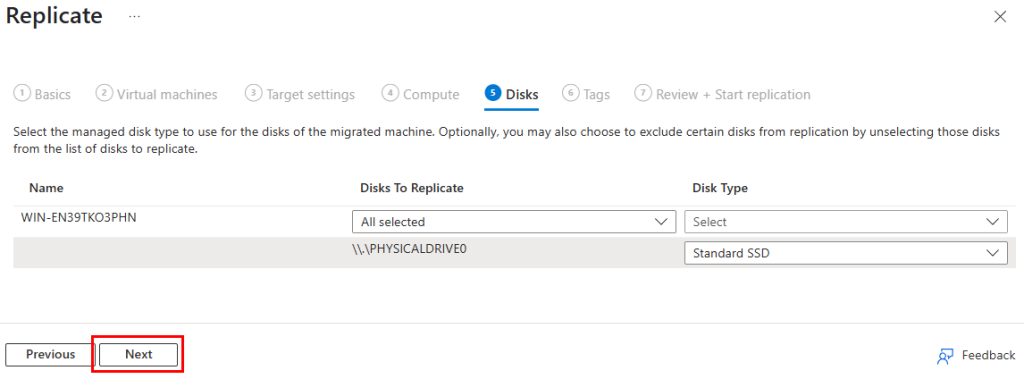

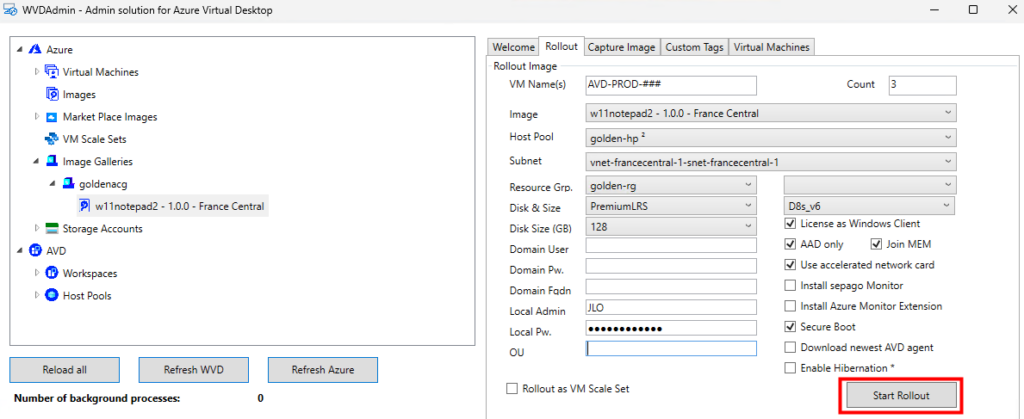

Renseignez le formulaire de déploiement :

- le nommage des VM,

- le nombre d’hôtes,

- la version d’image,

- le pool d’hôtes,

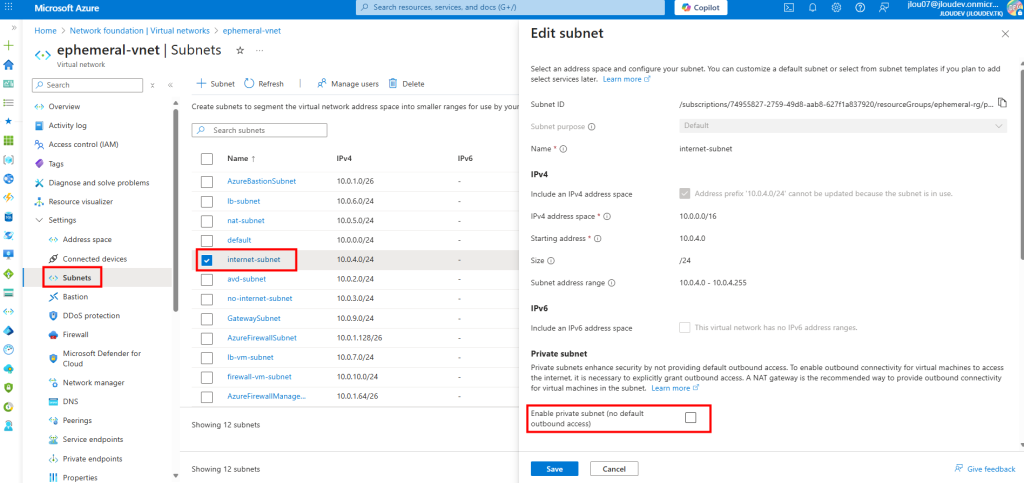

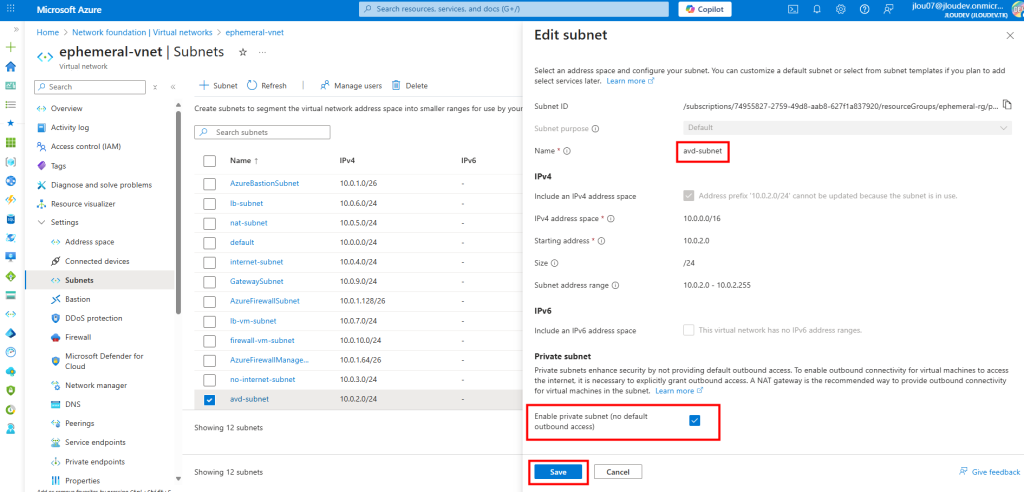

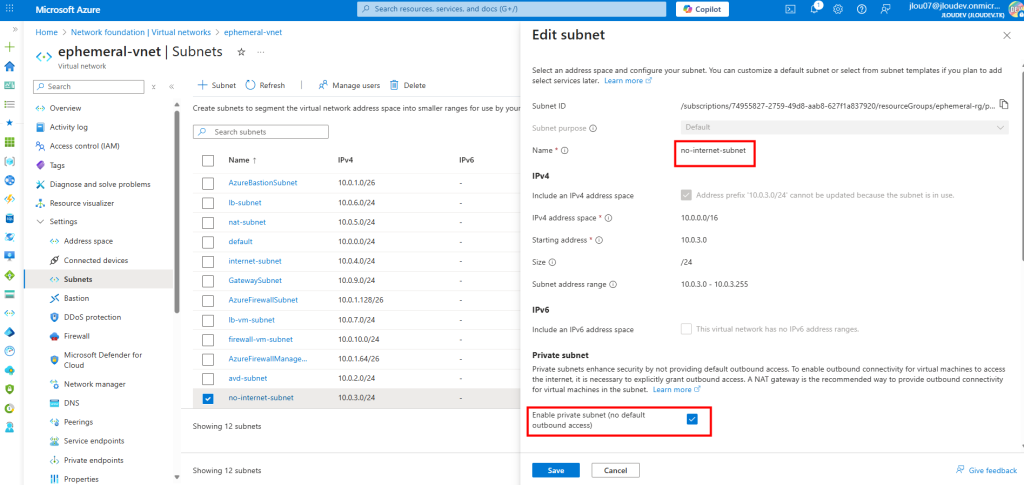

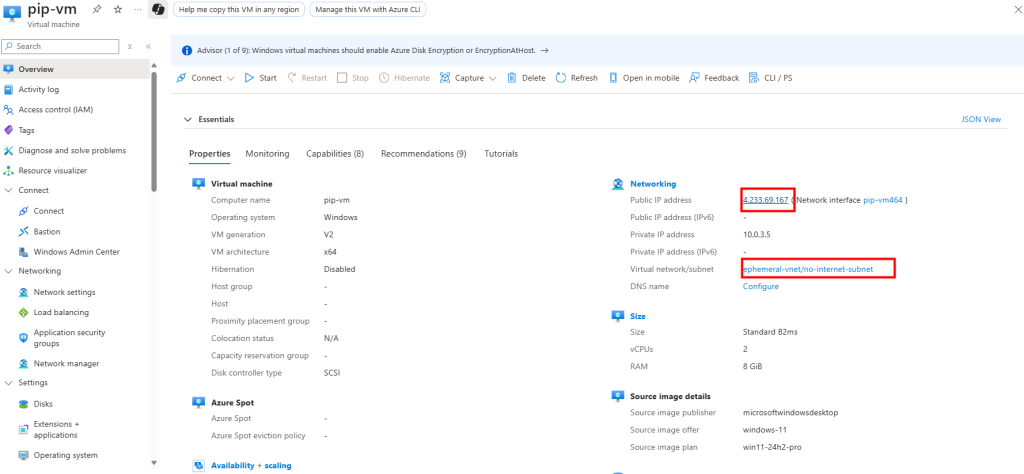

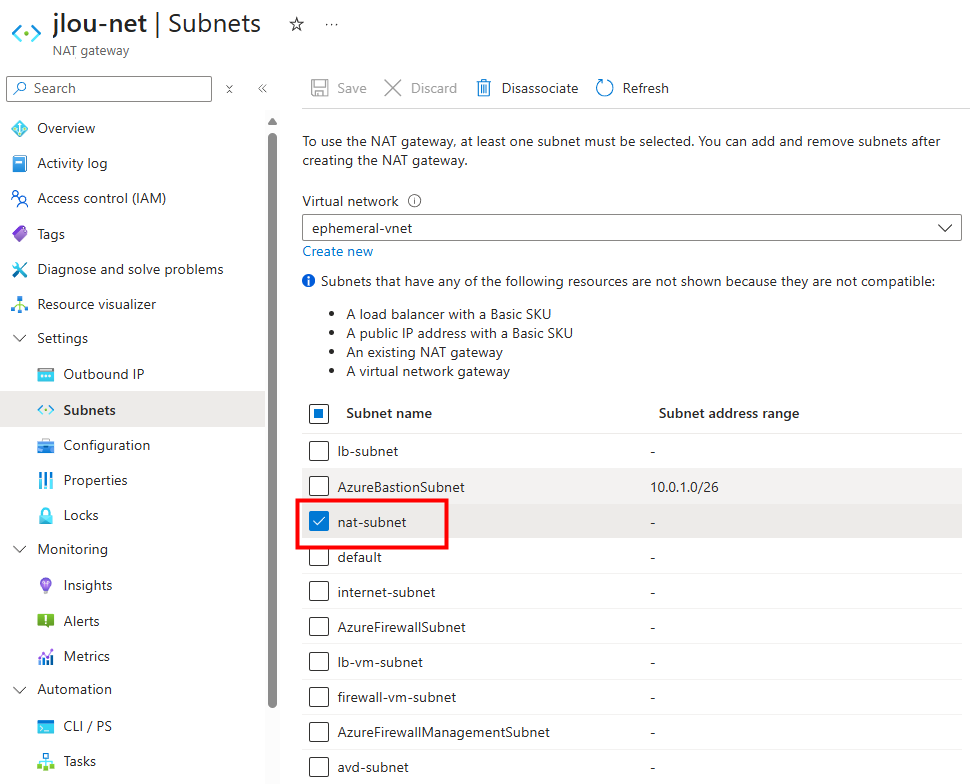

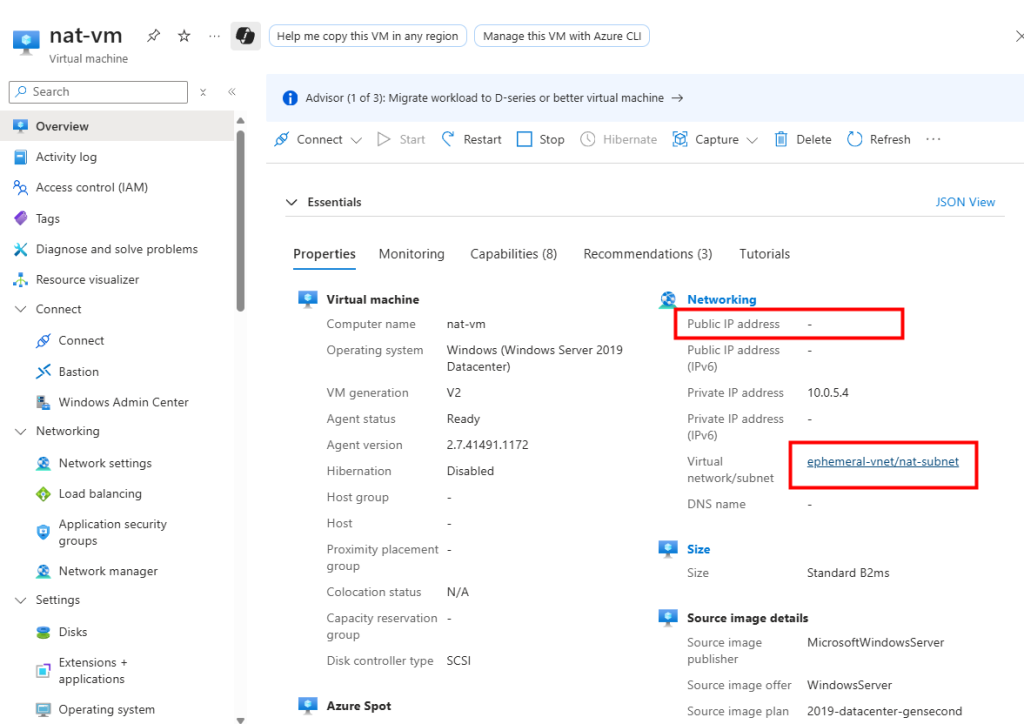

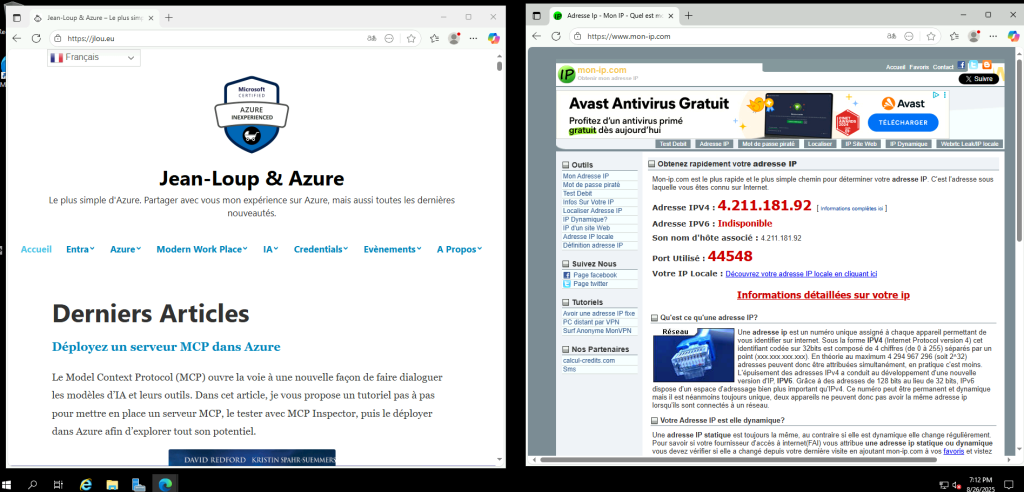

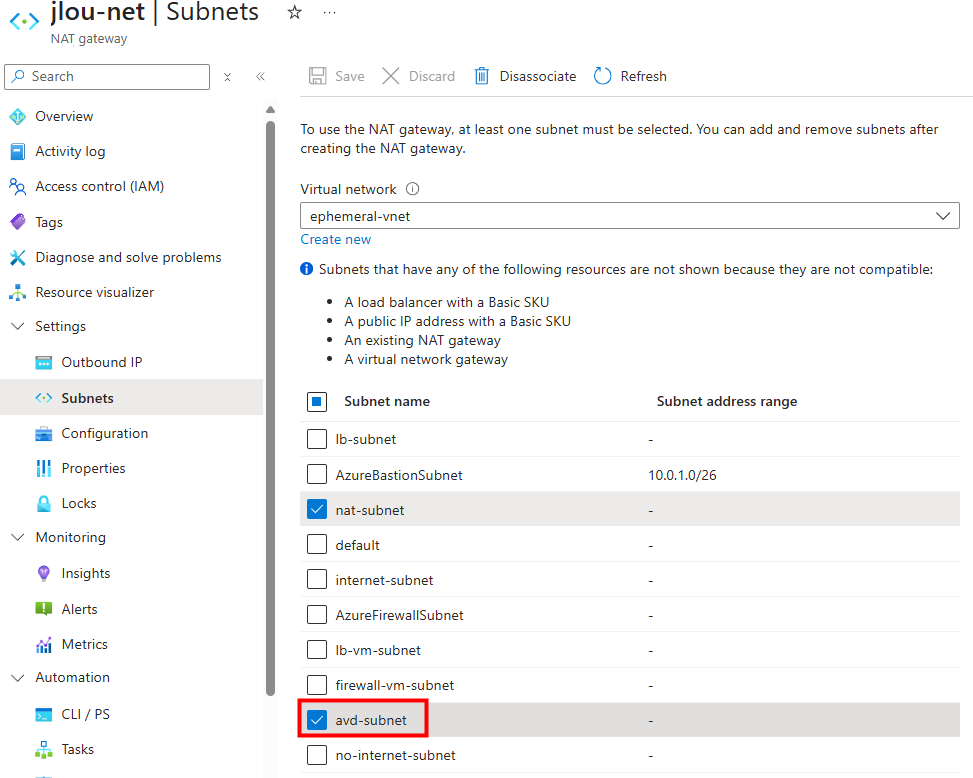

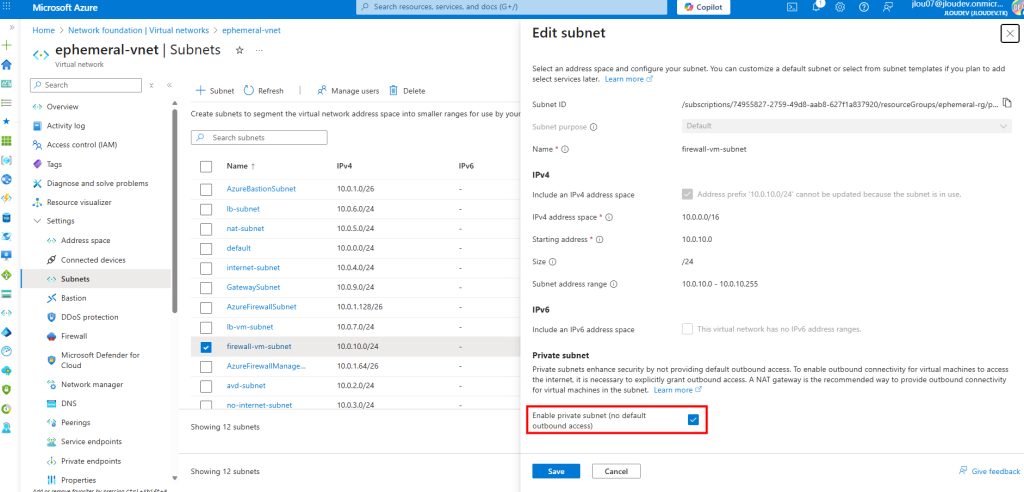

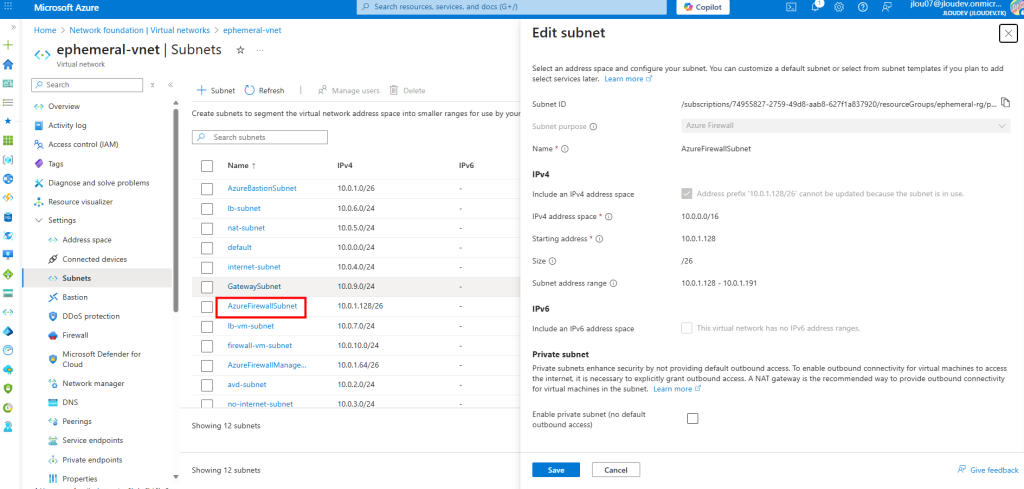

- le sous-réseau,

- les paramètres de disque,

- la taille des VM,

- les options de jointure Entra / Intune.

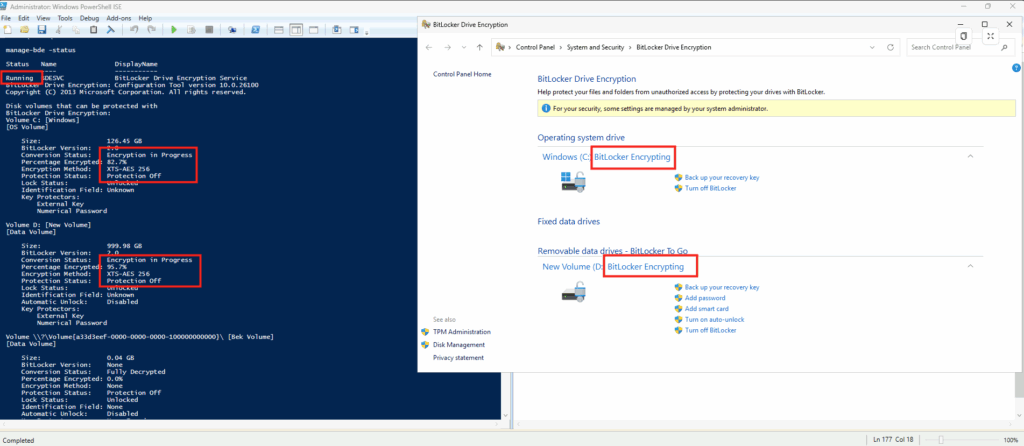

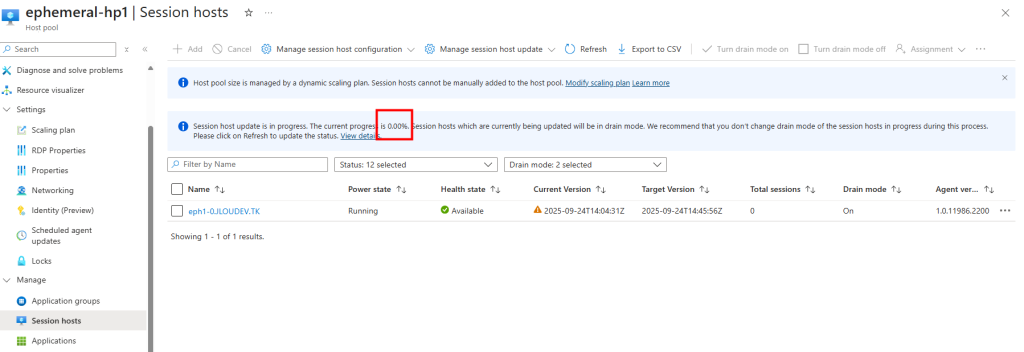

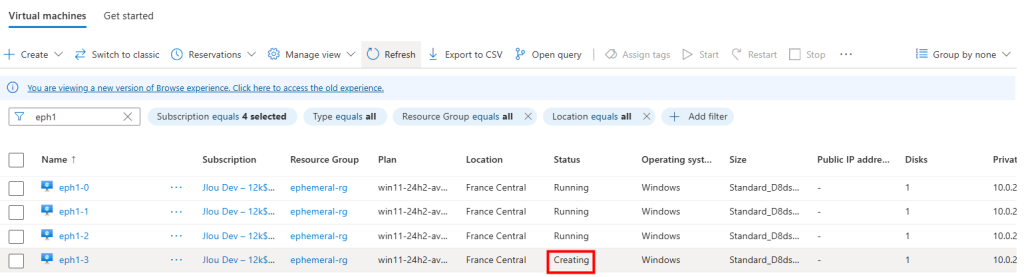

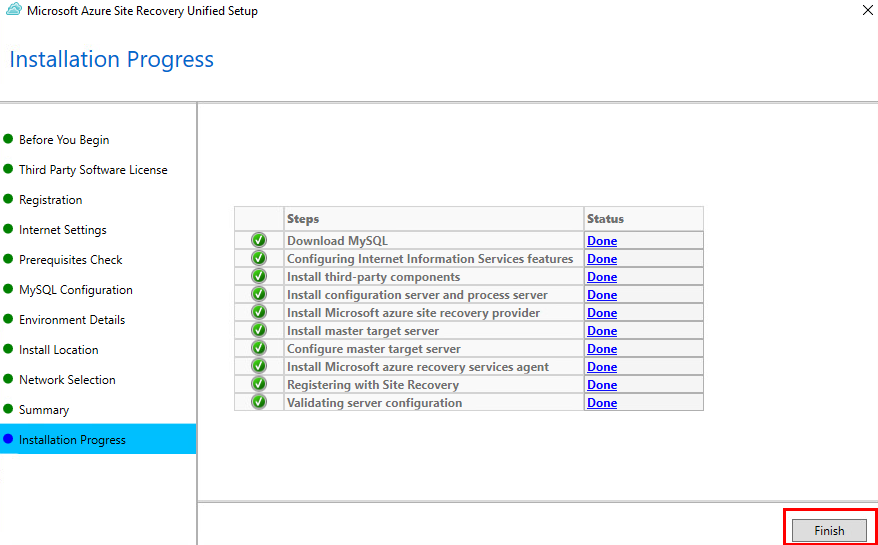

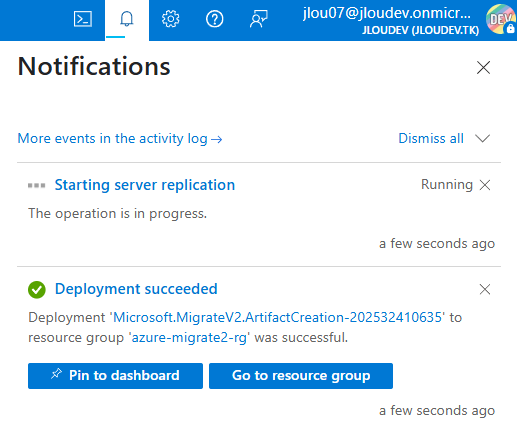

Puis lancez la création des machines virtuelle AVD :

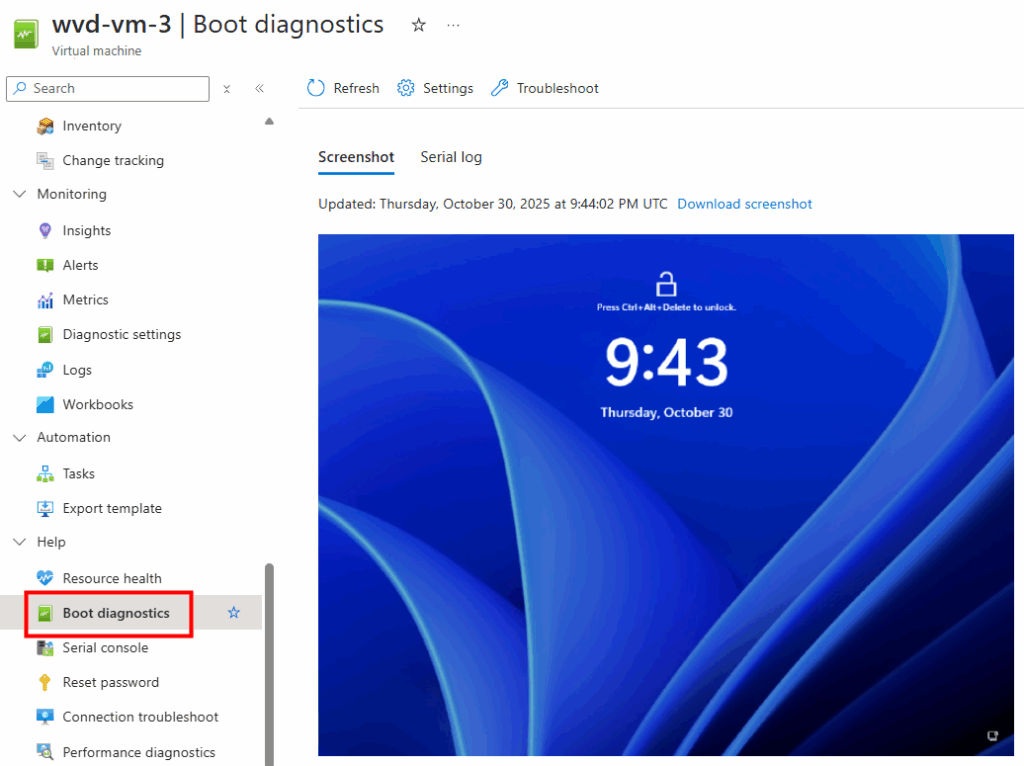

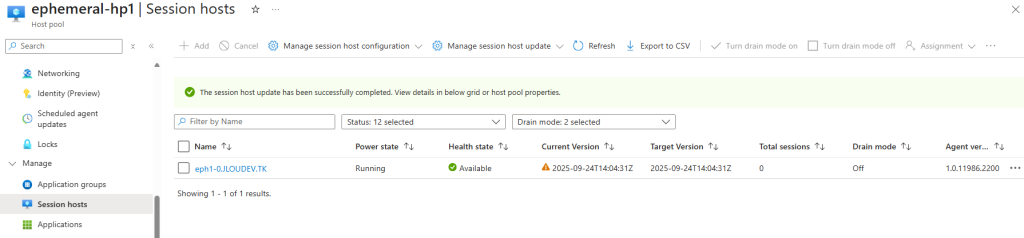

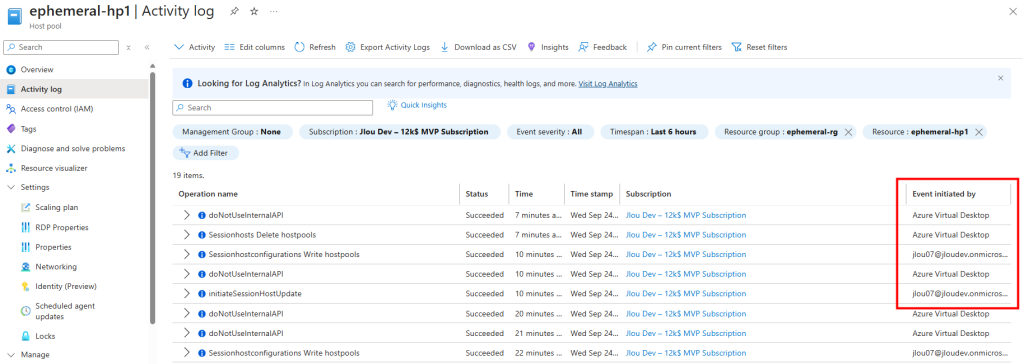

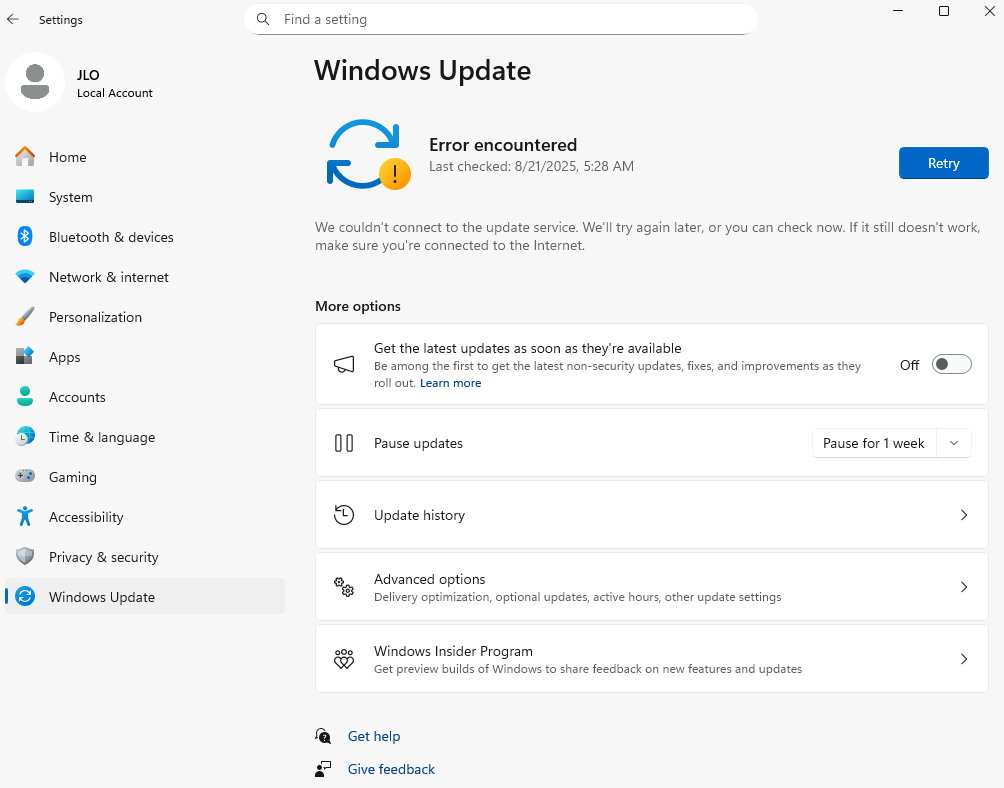

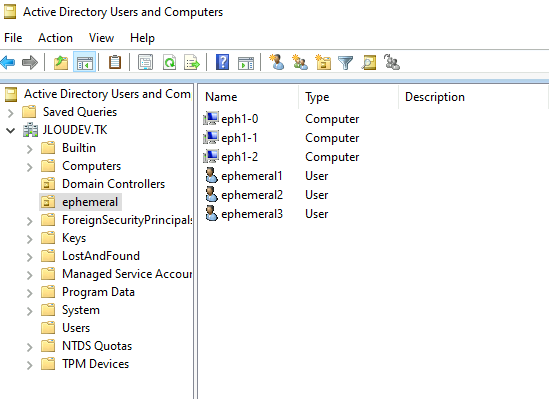

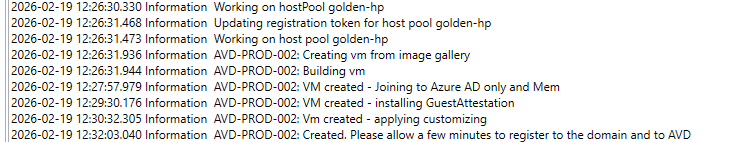

Les journaux confirment la création de la VM et de son intégration au pool d’hôtes :

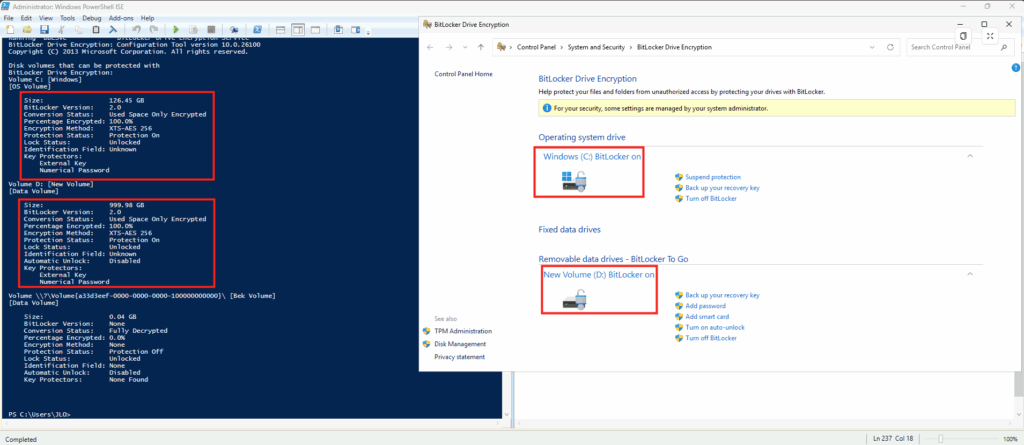

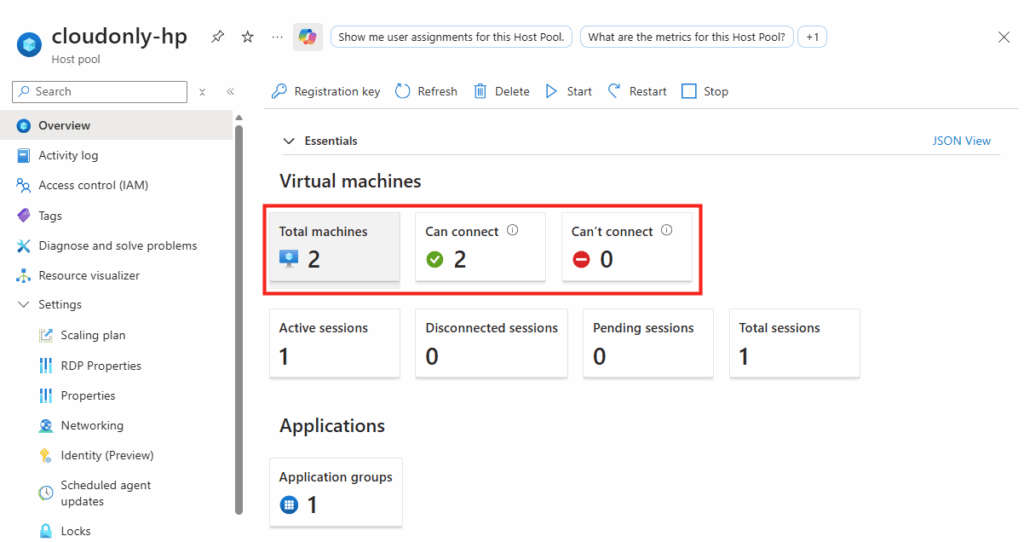

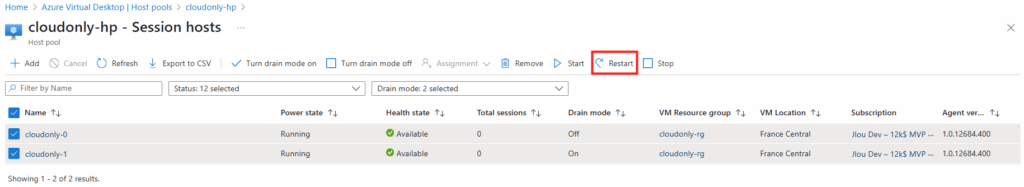

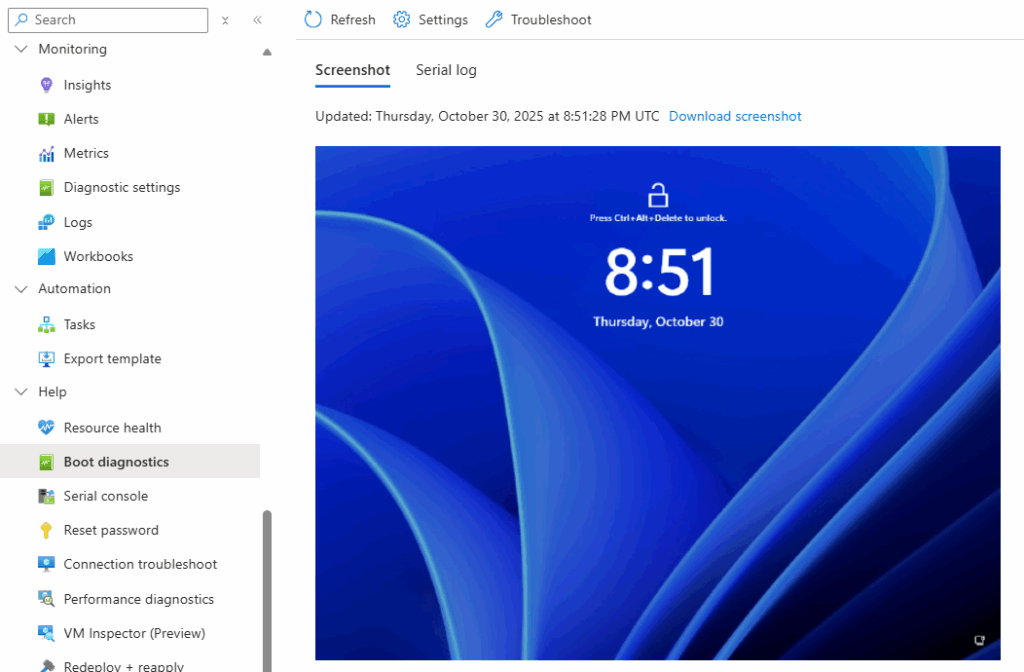

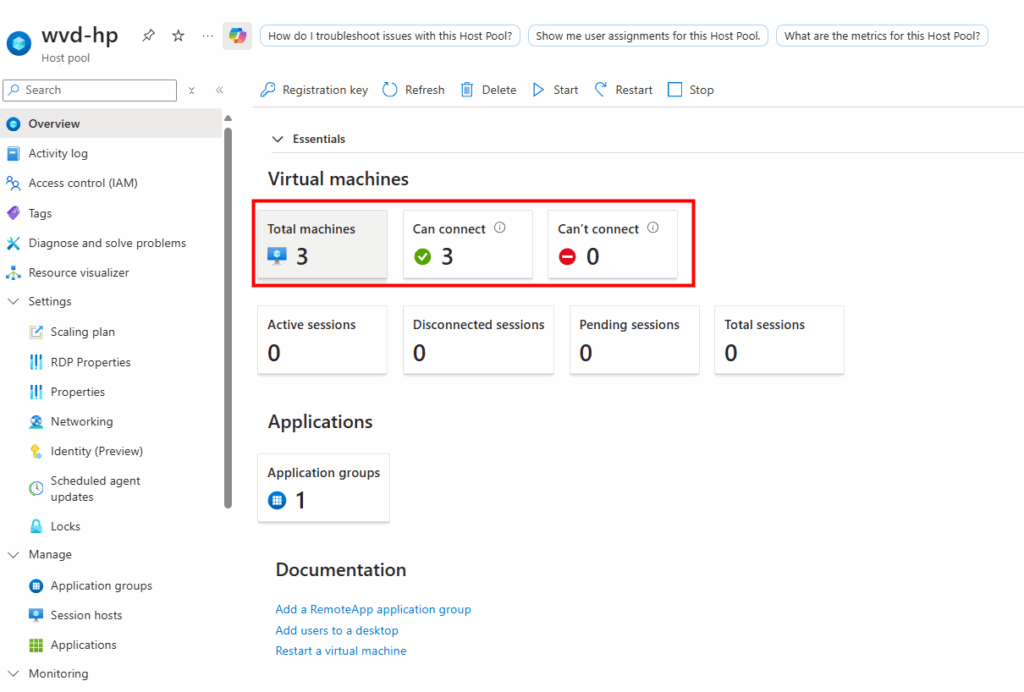

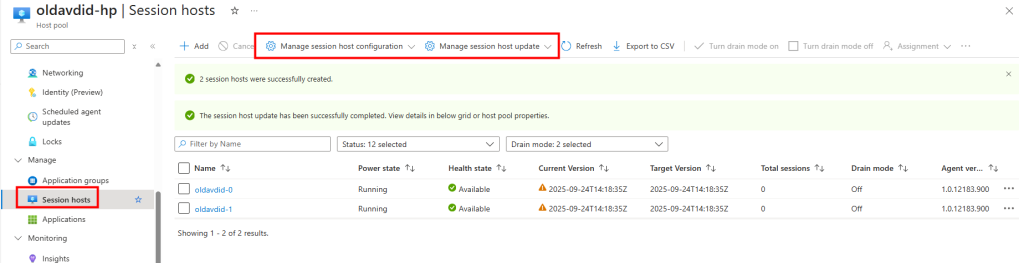

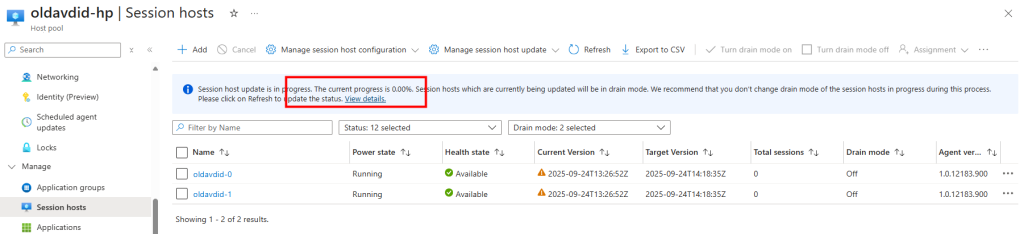

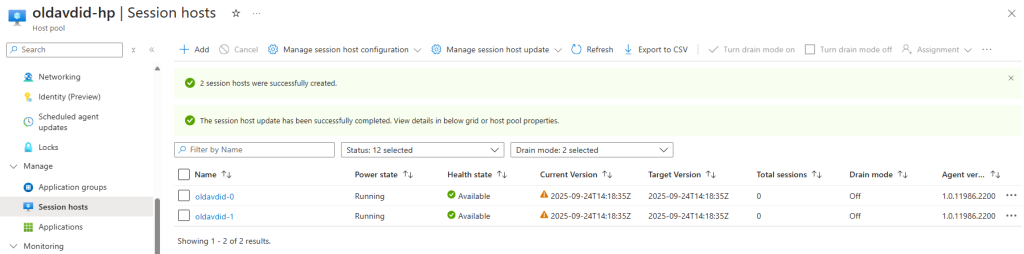

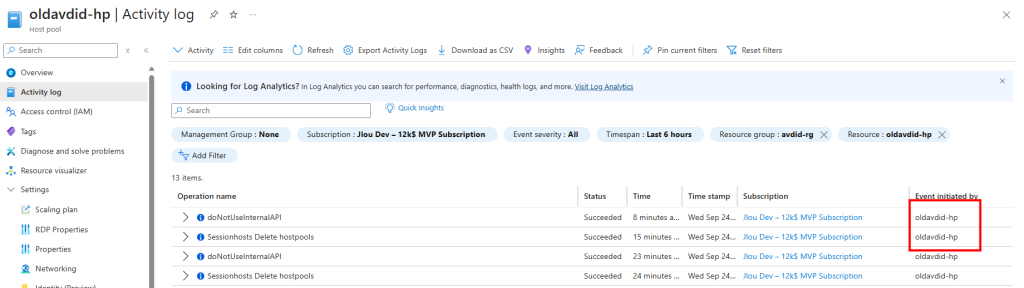

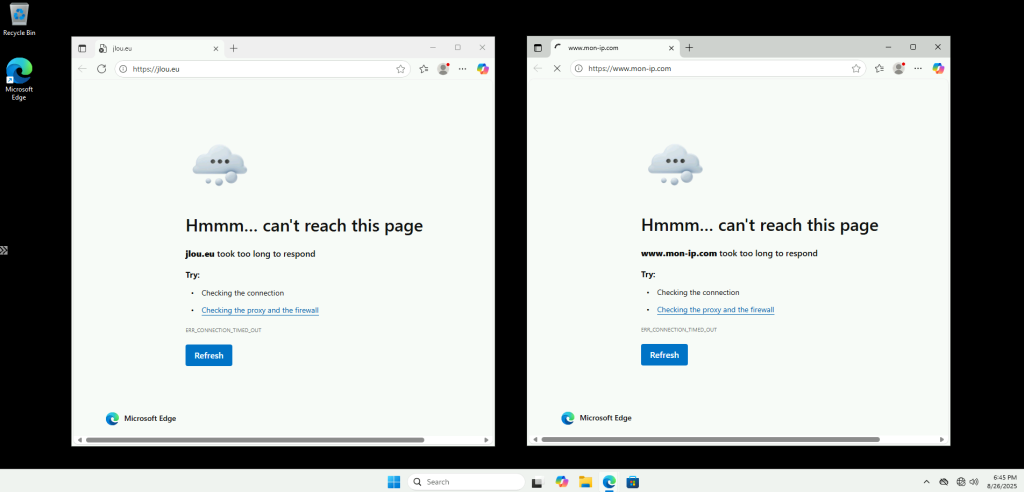

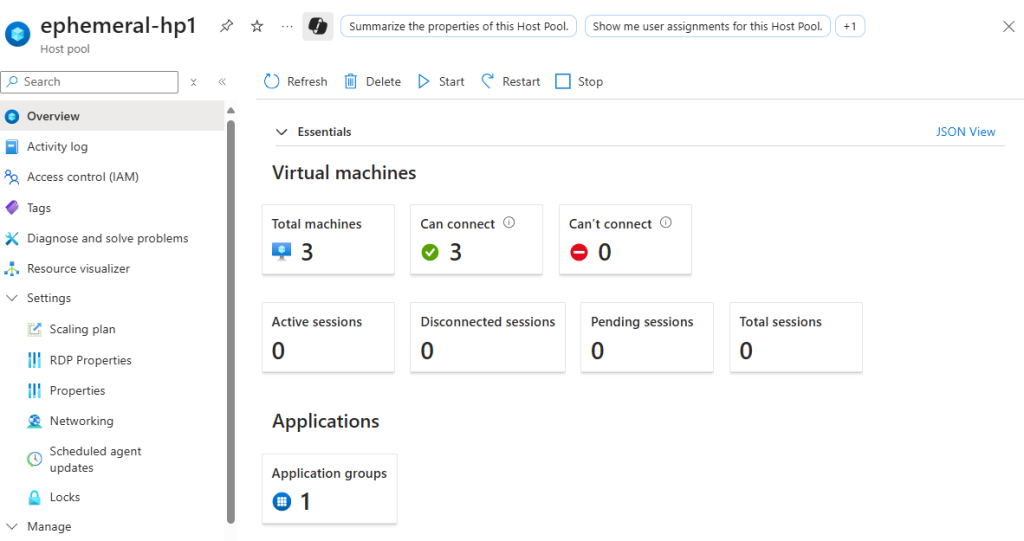

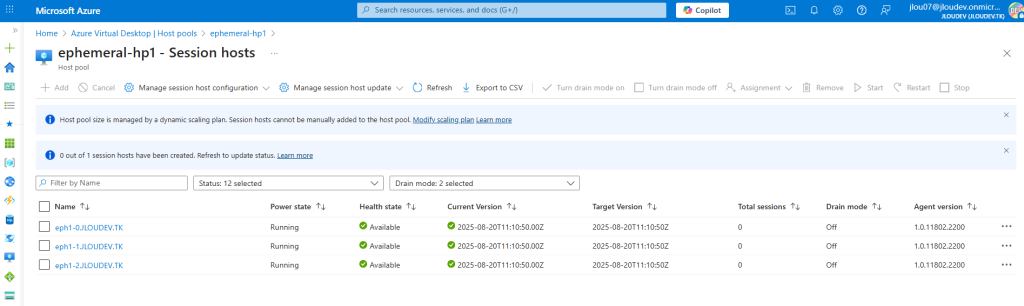

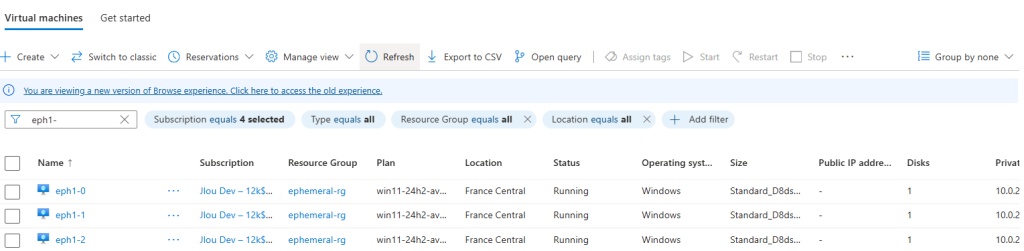

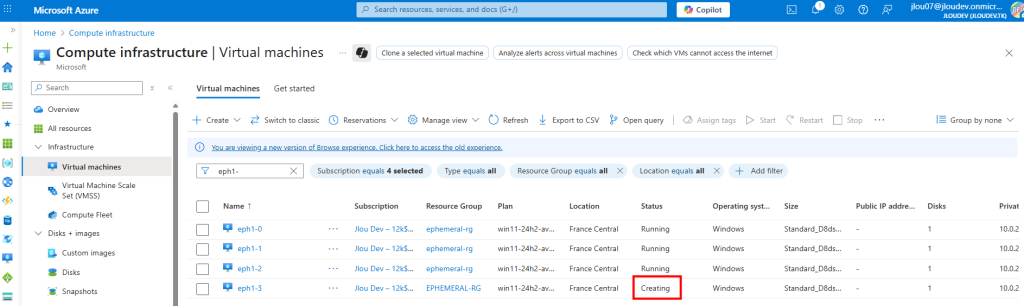

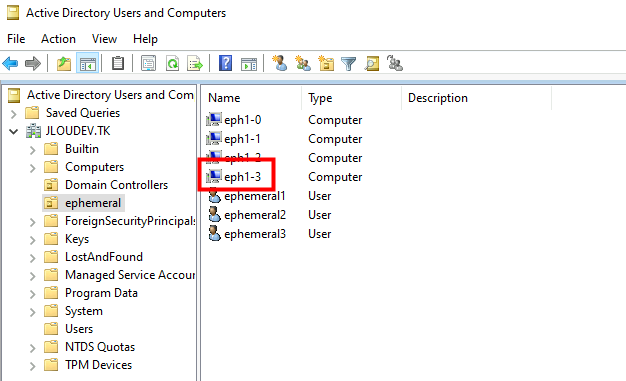

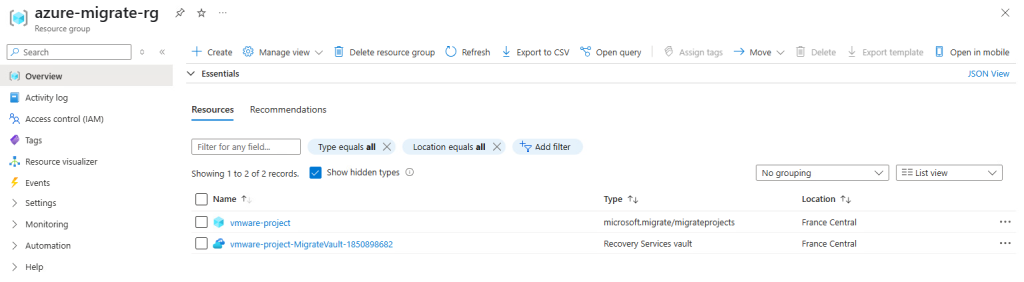

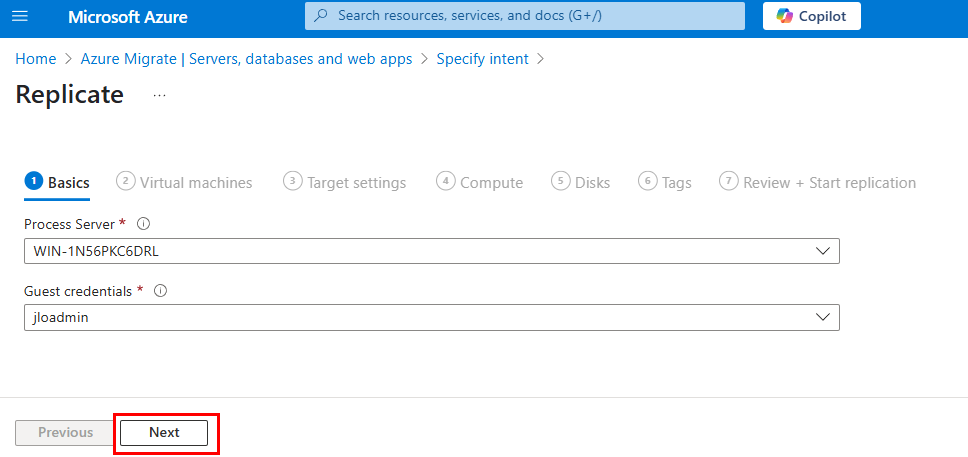

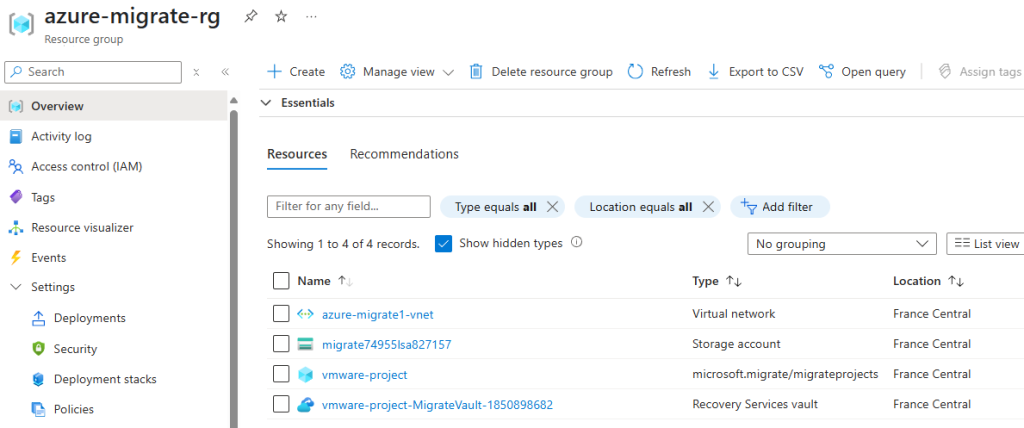

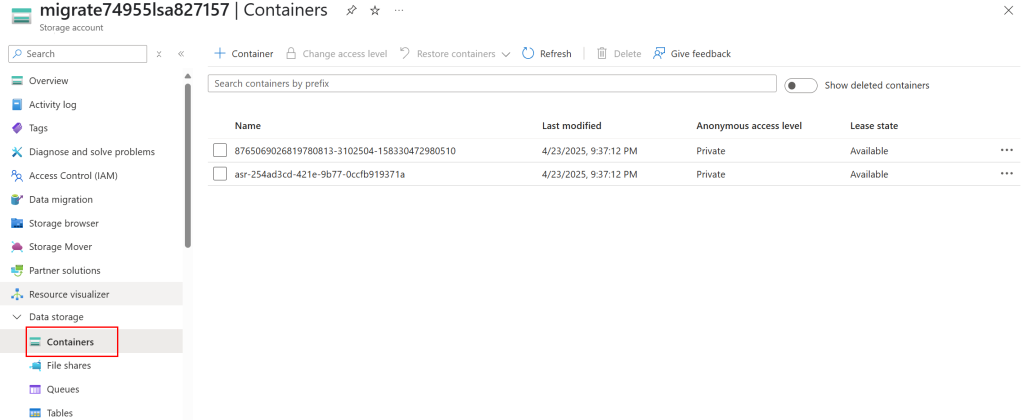

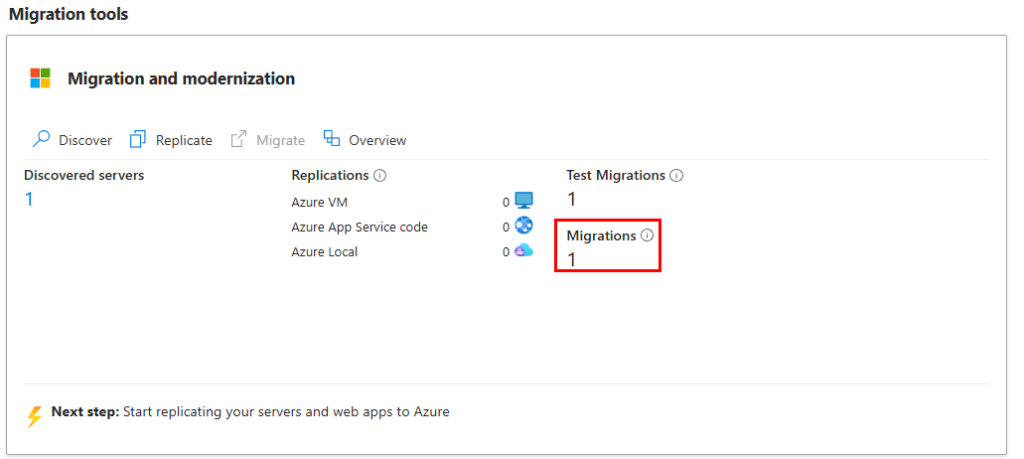

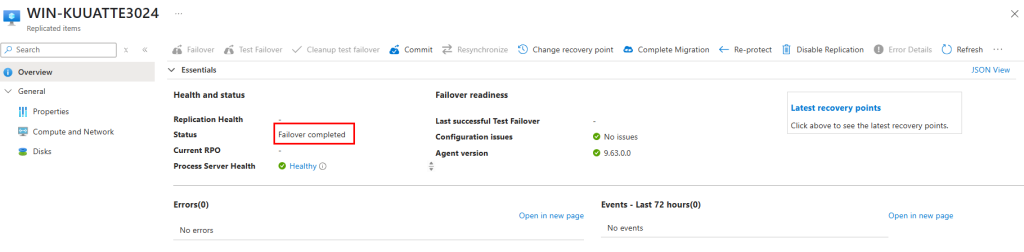

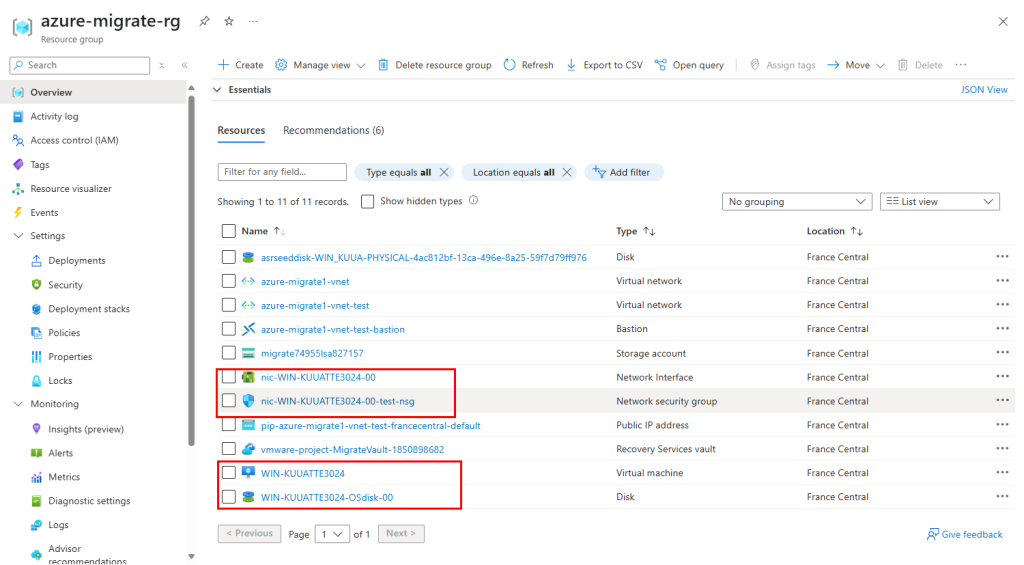

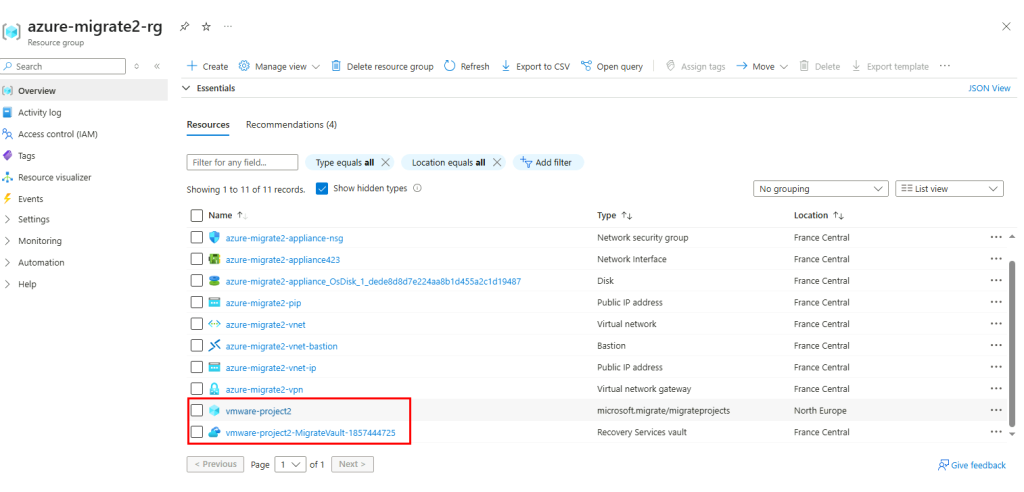

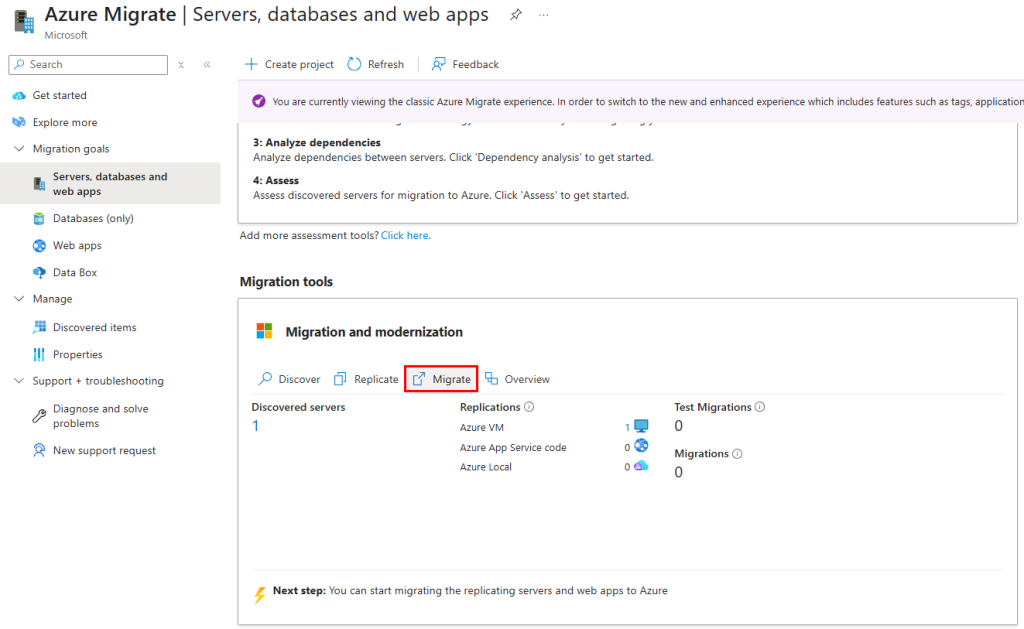

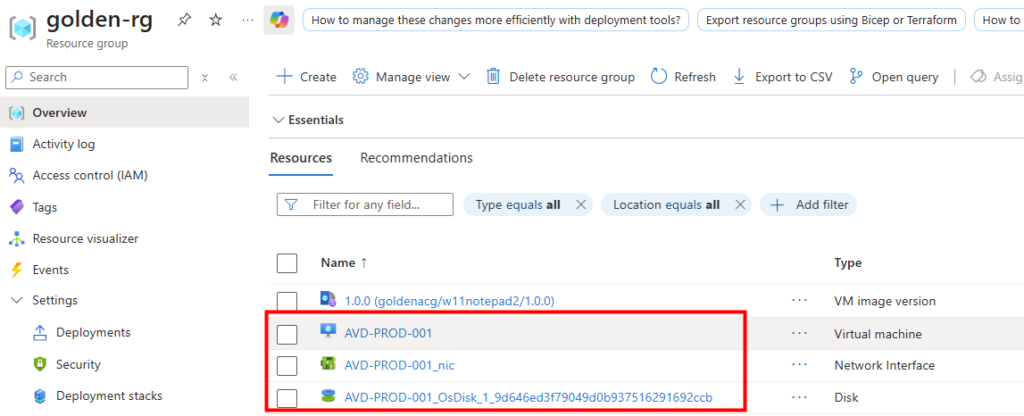

Constatez sur le portail Azure la création de ressources :

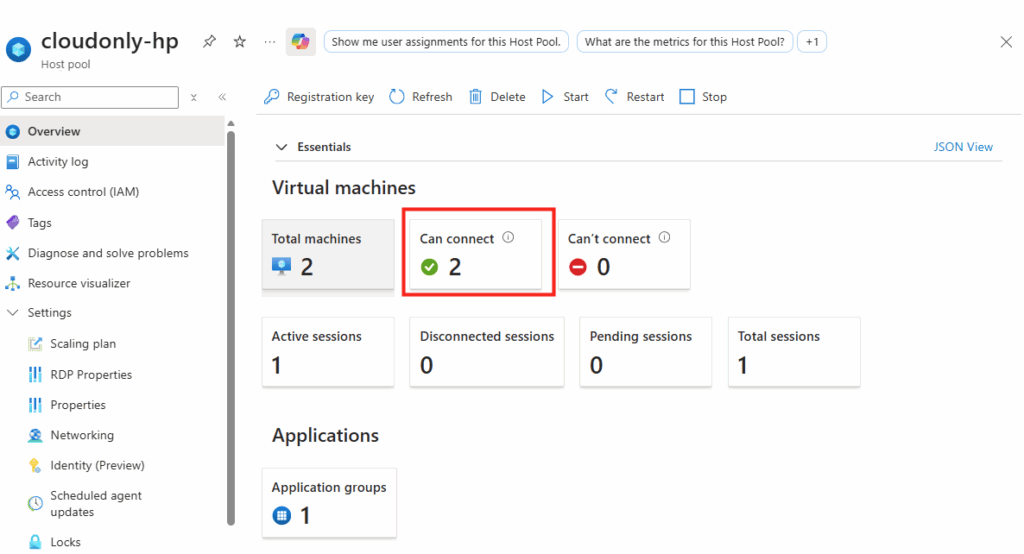

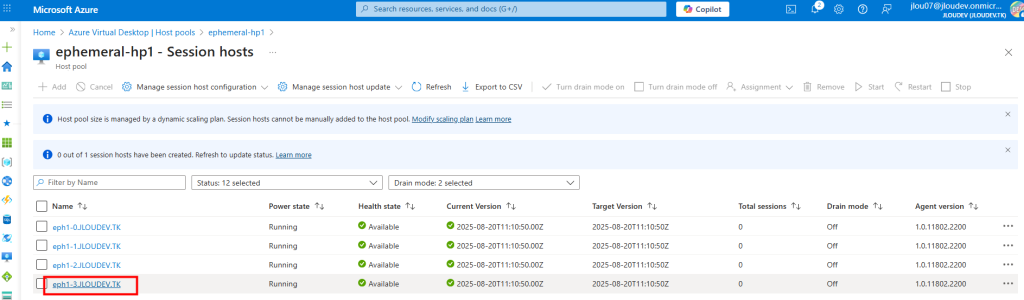

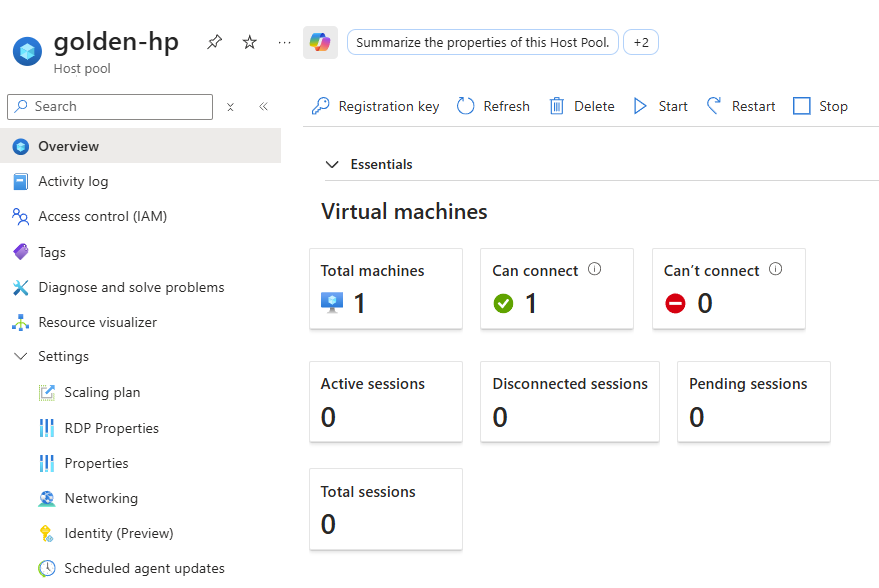

Votre pool d’hôtes affiche la nouvelle capacité disponible :

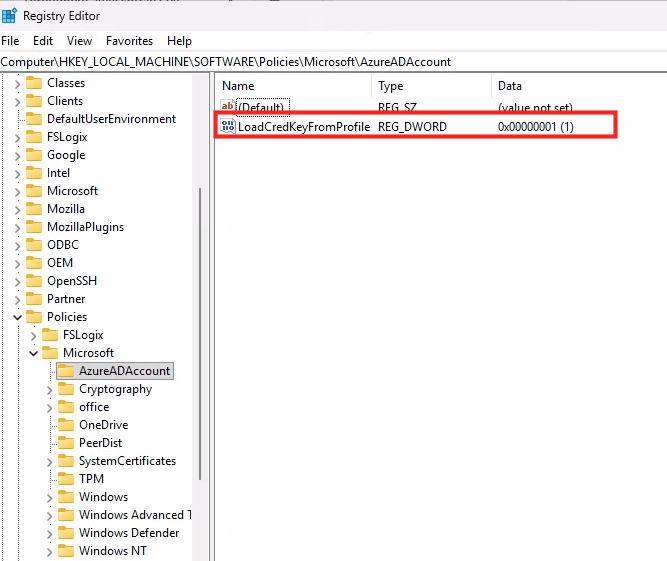

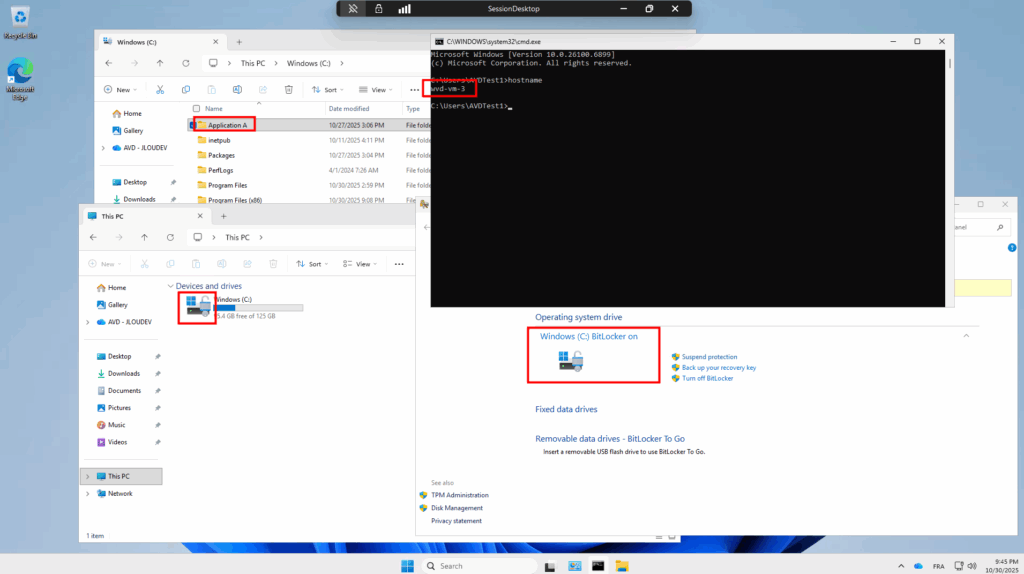

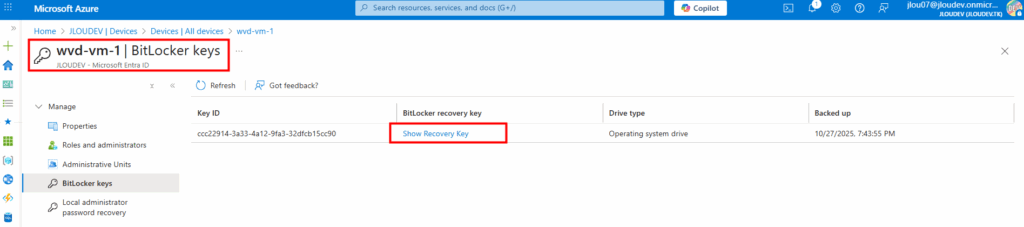

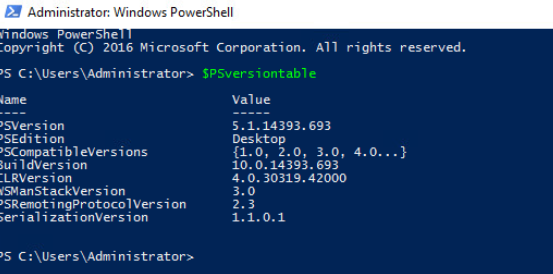

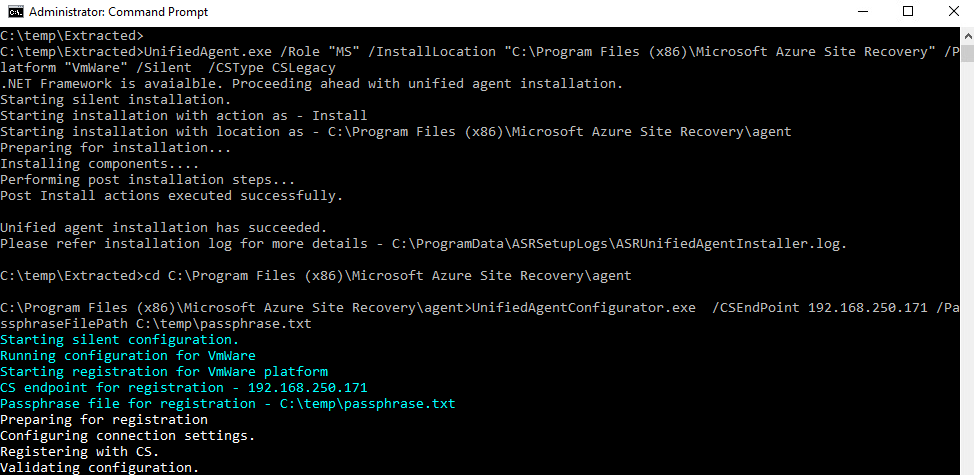

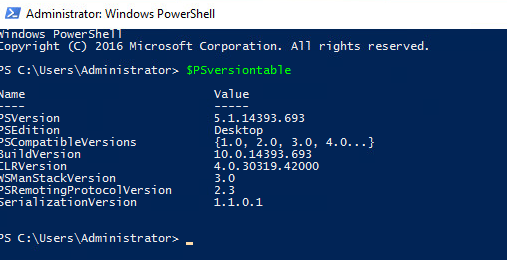

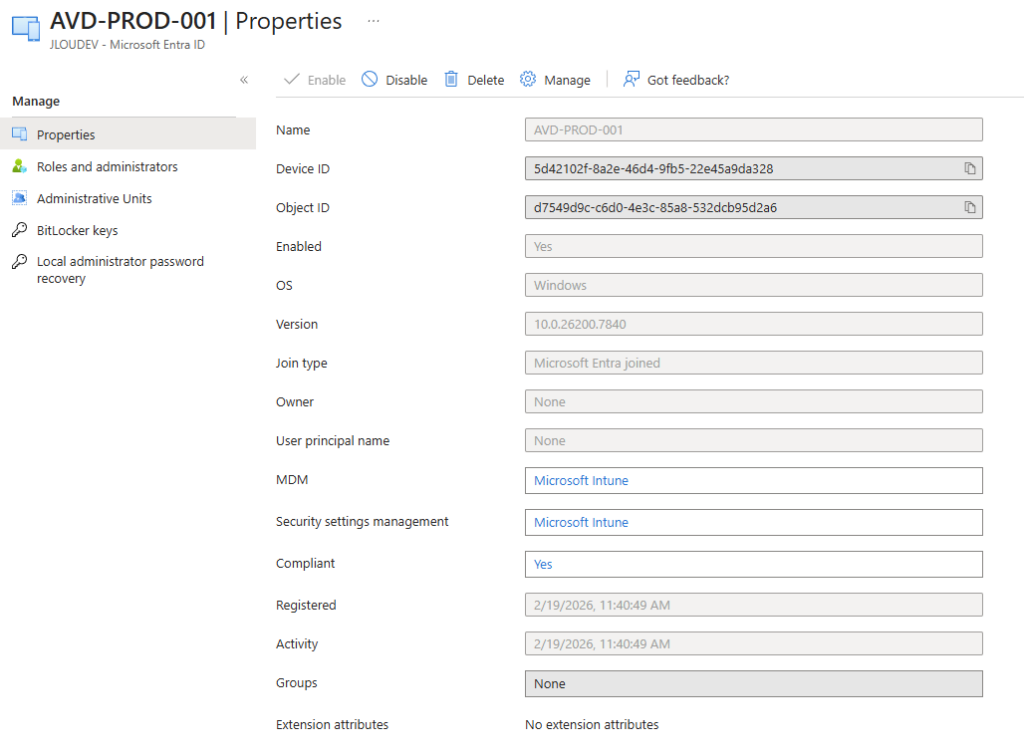

Dams mon cas, l’hôte de session apparait comme appareil joint à Entra ID :

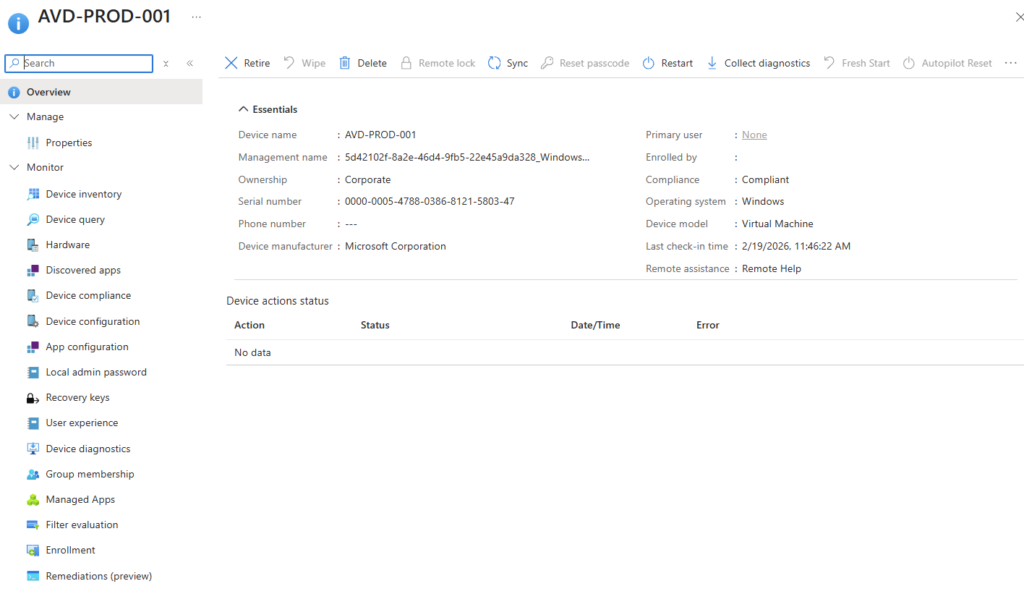

Cette hôte de session est également enrôlés dans Intune :

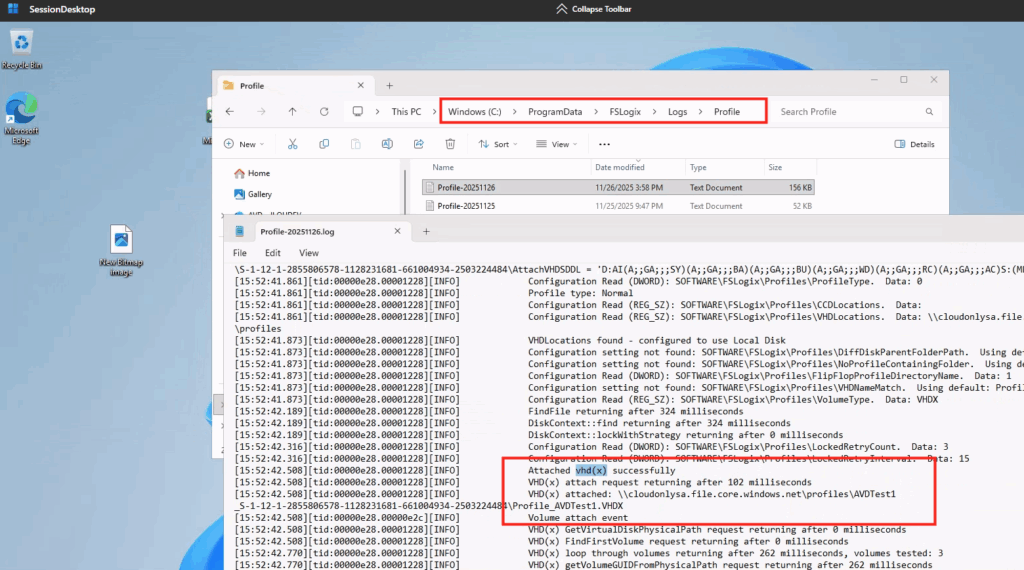

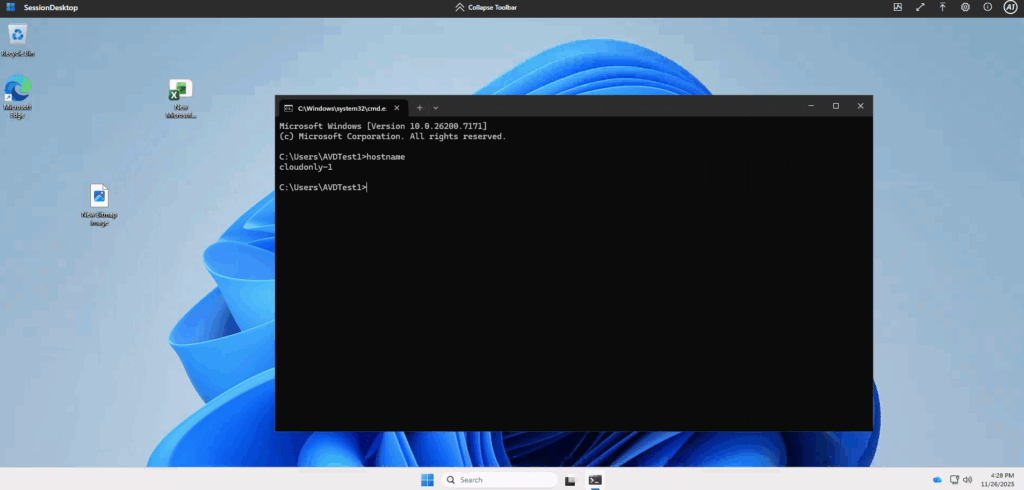

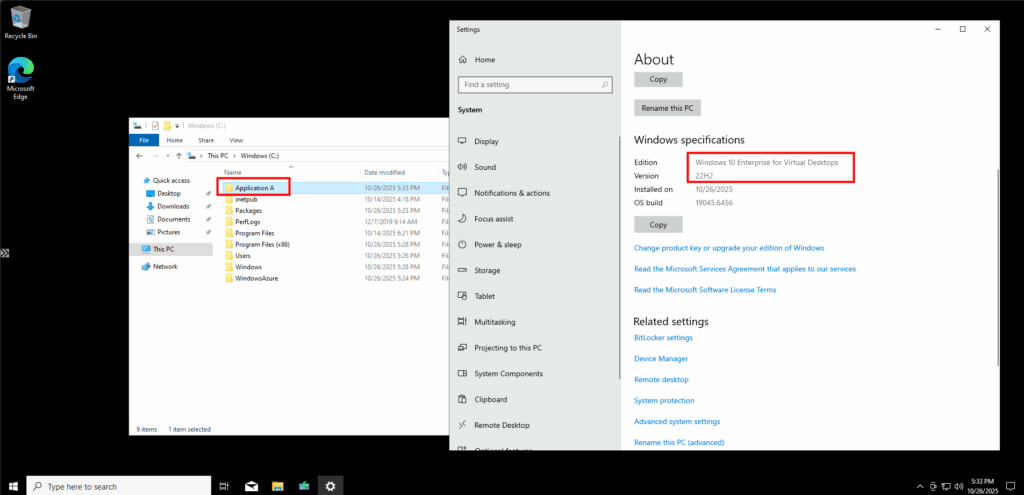

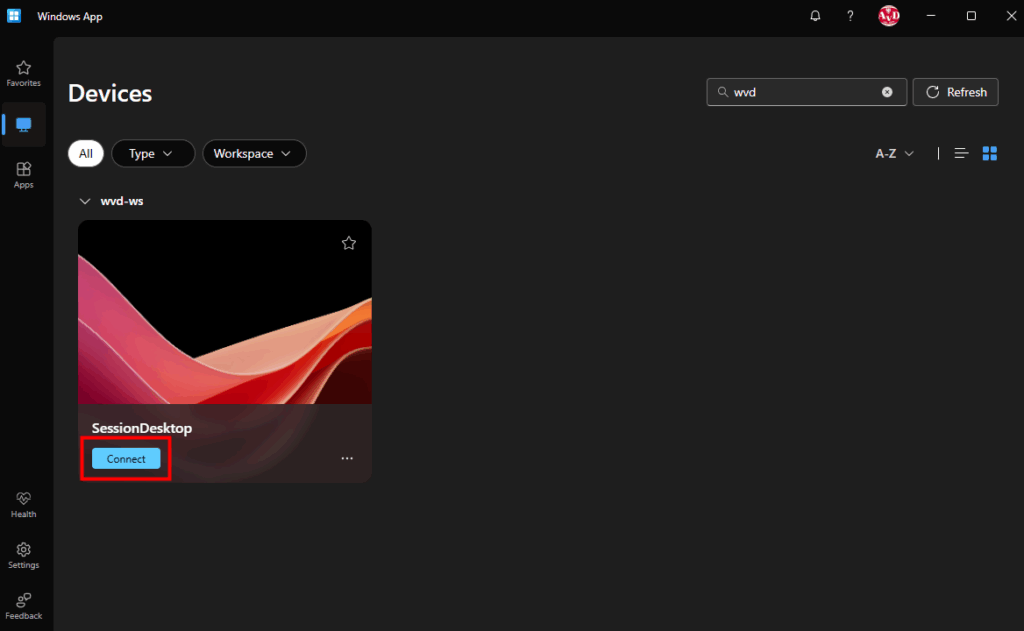

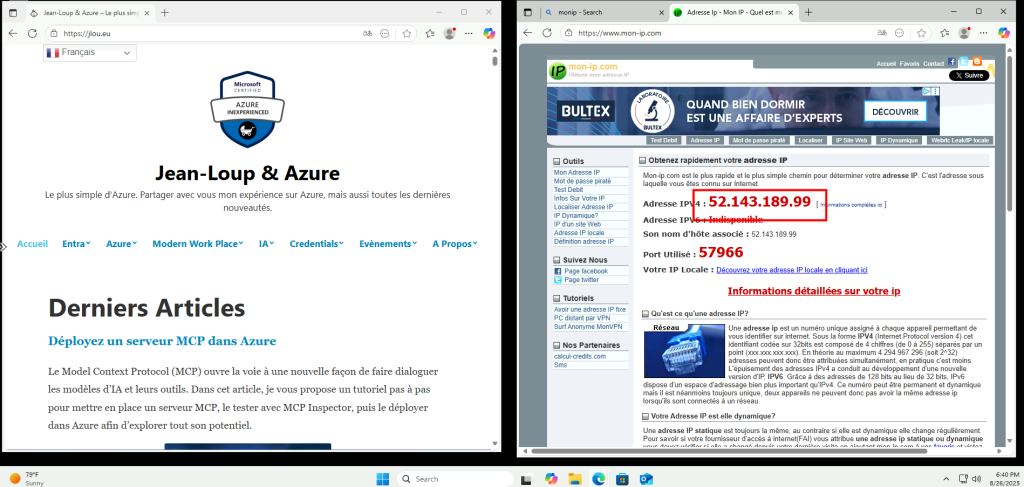

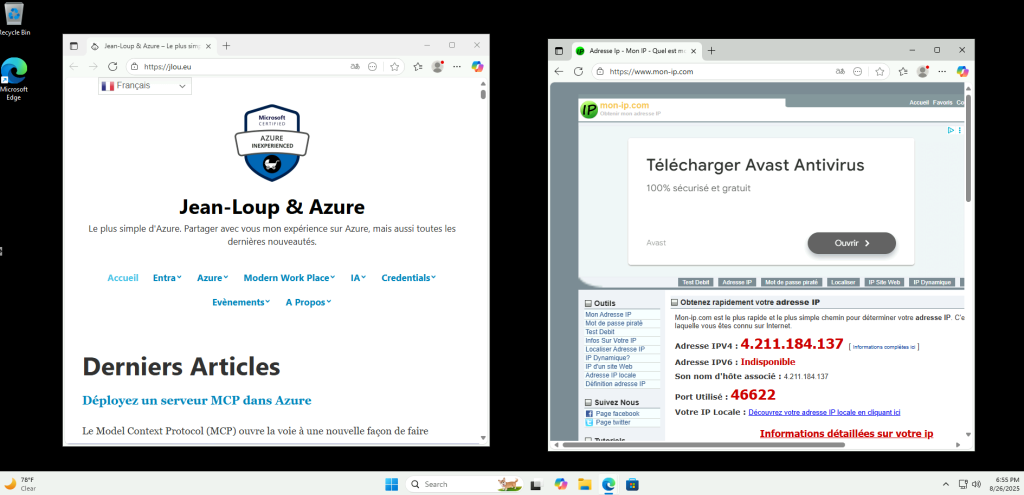

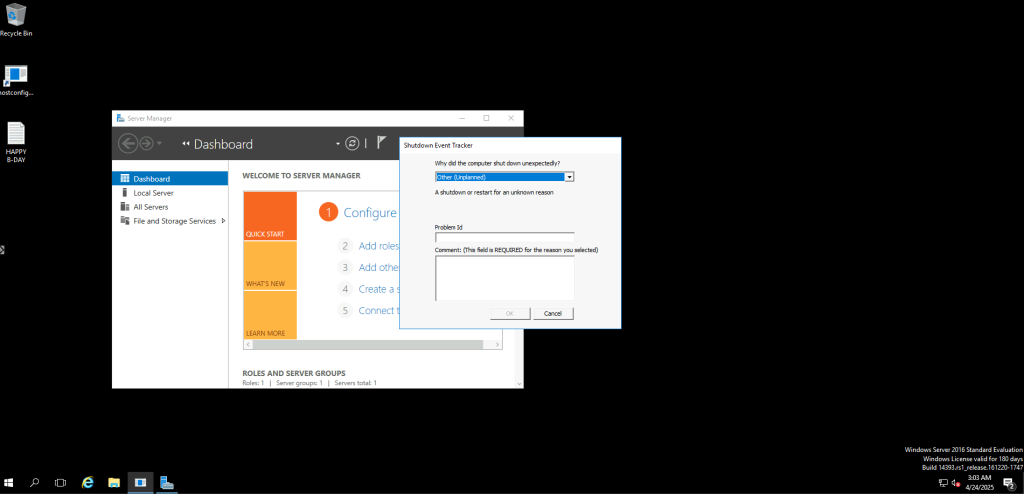

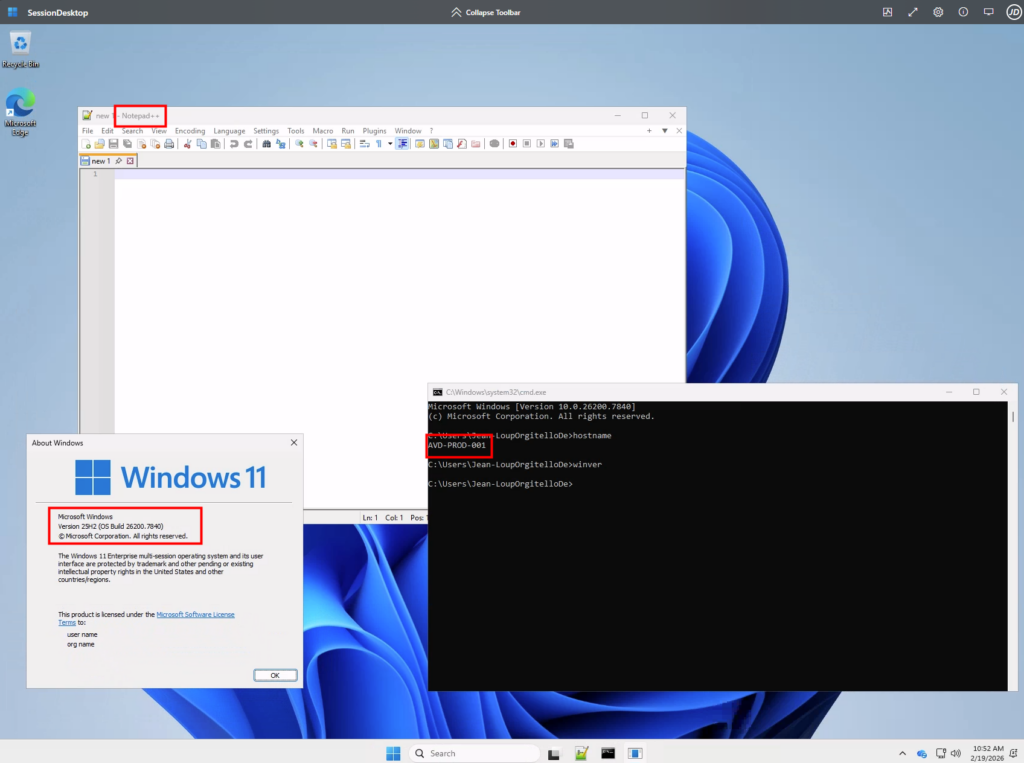

Un test en session (nom de machine, version de l’OS, application installée) valide le bon fonctionnement :

Etape VI – Fonctionnalités annexes :

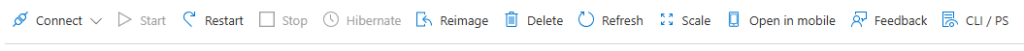

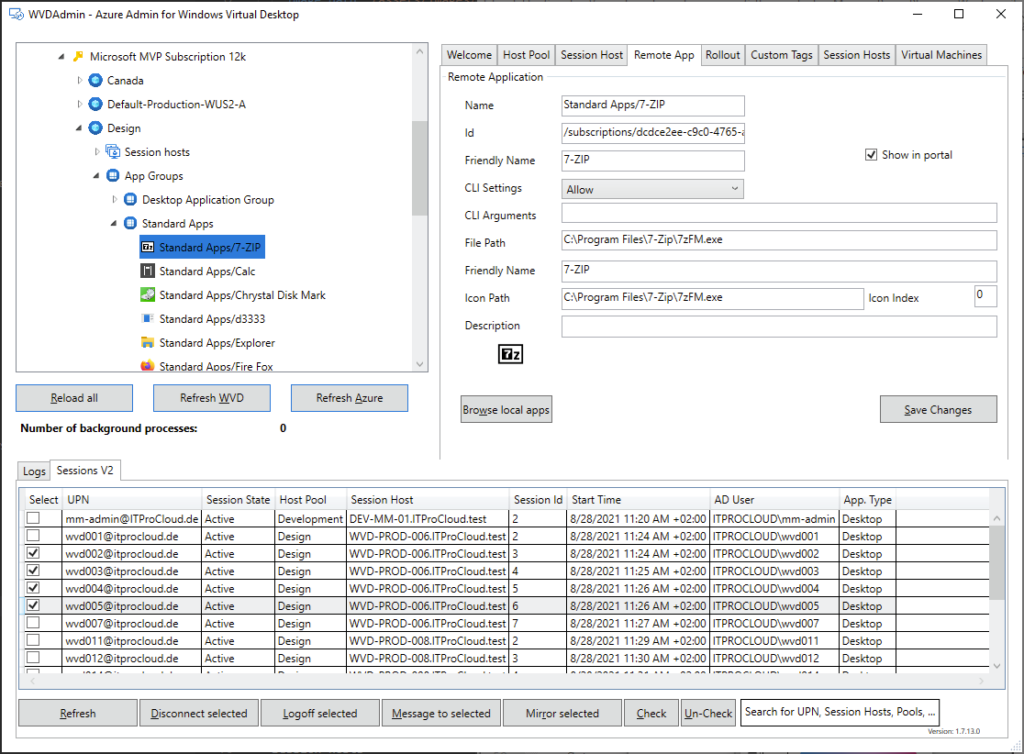

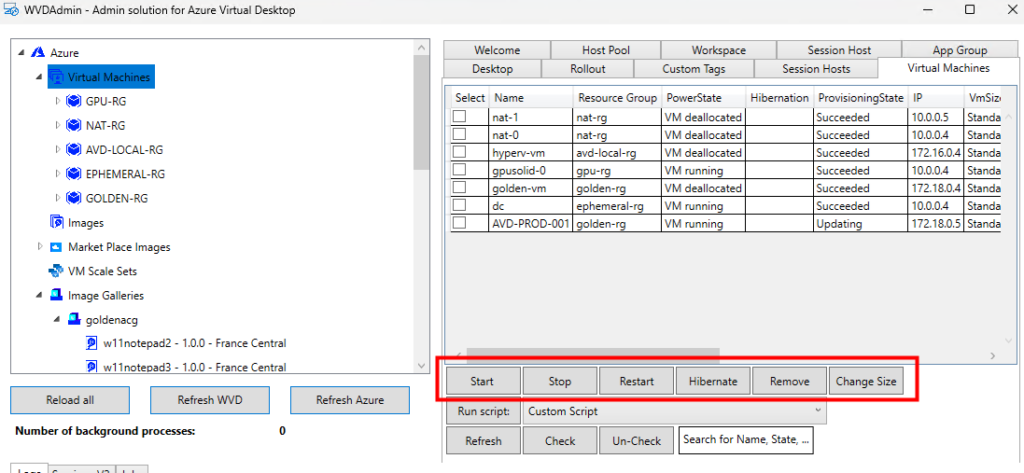

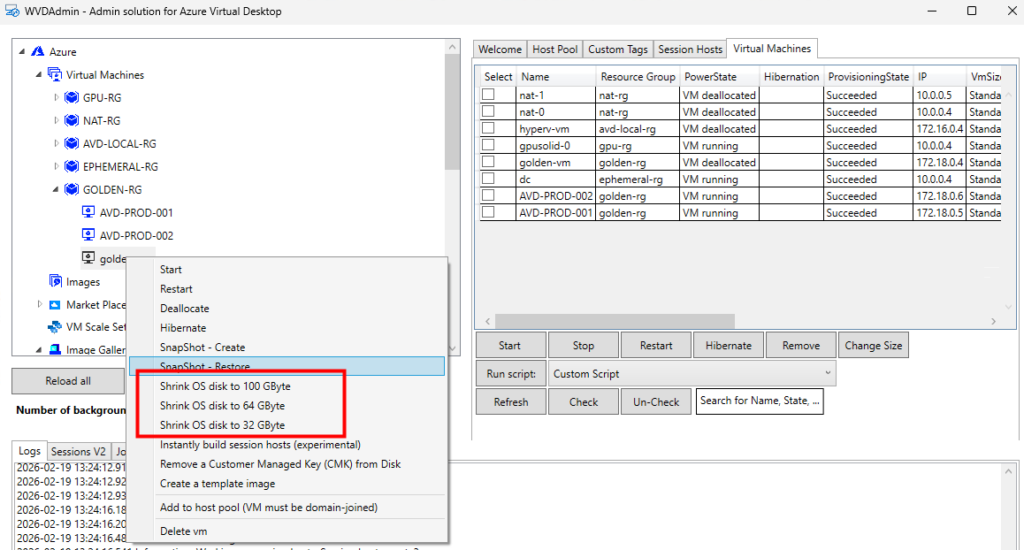

WVDAdmin couvre également beaucoup d’opérations IT sur les machines virtuelles Azure :

- démarrage, arrêt, redémarrage, hibernation

- changement de taille de la VM

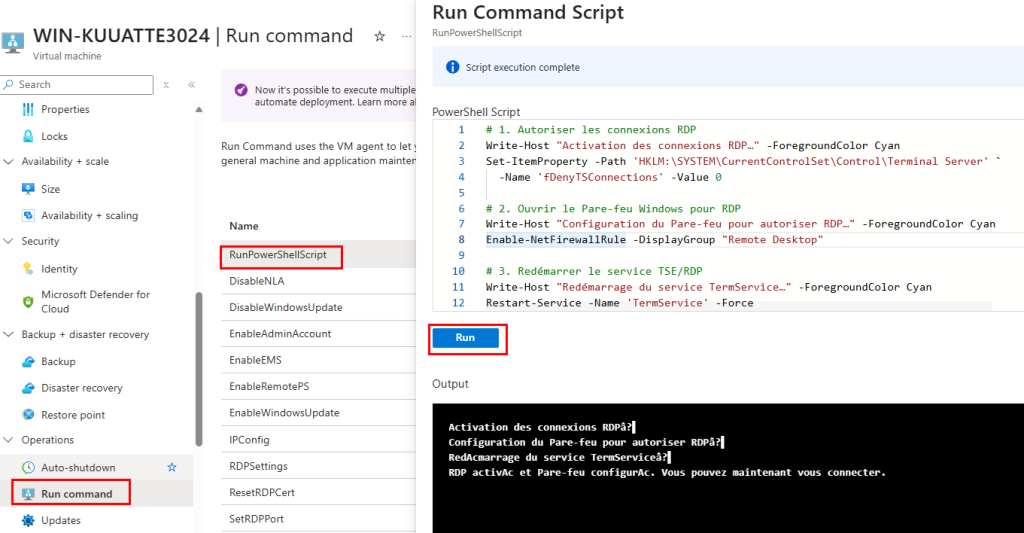

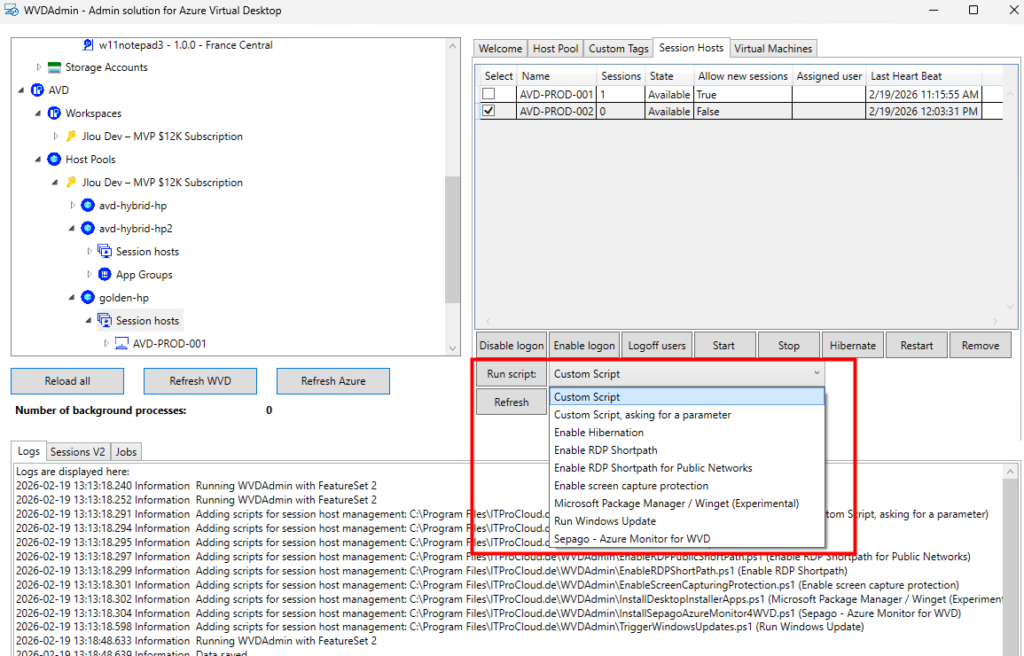

Certains actions particulières, comme l’exécution de scripts, sont possibles :

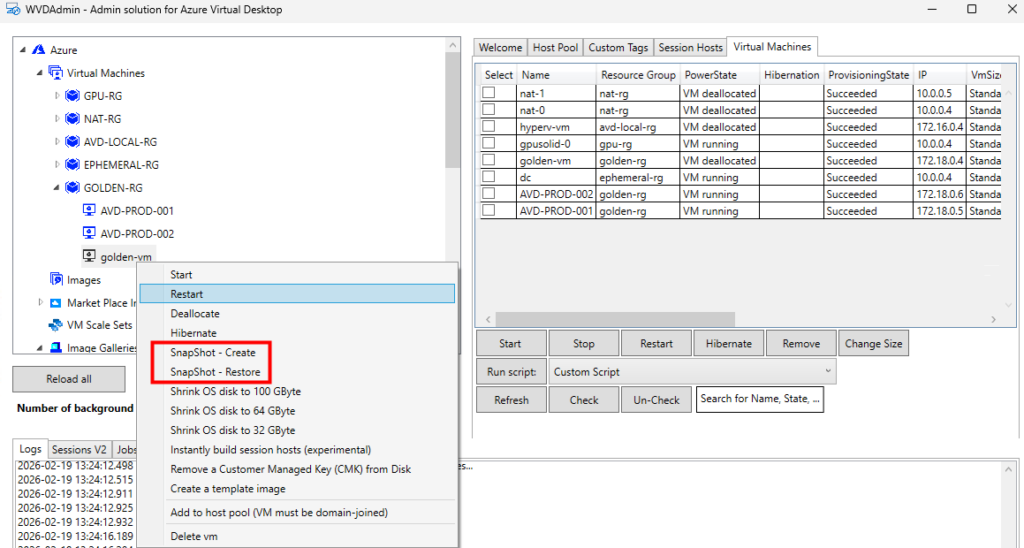

Ou encore la création de snapshot ou le redimensionnement de disque OS :

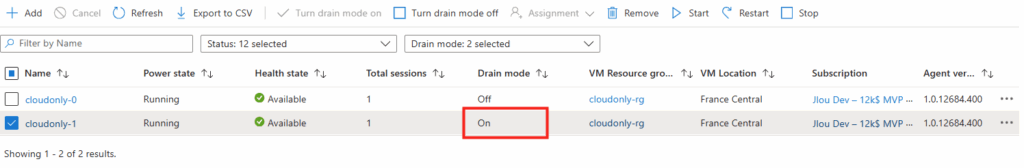

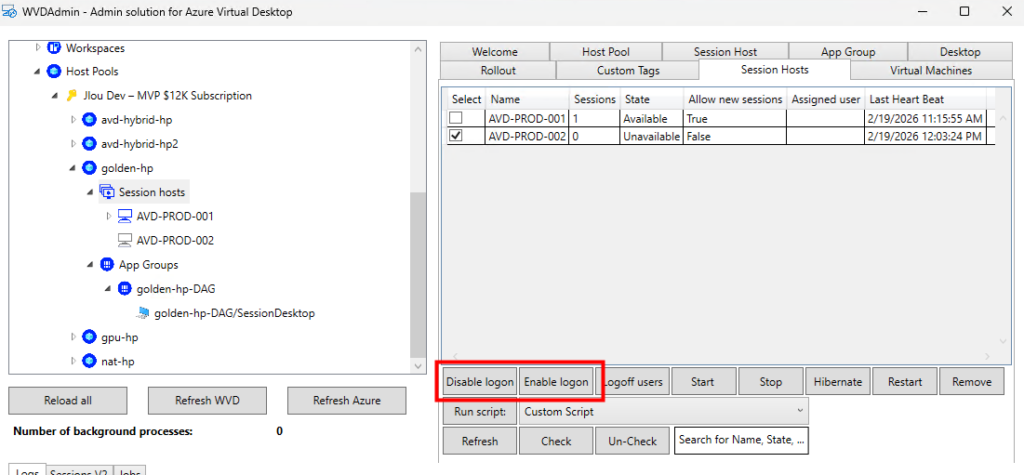

D’autres sont propres aux machines virtuelles AVD :

- gestion du mode drain

- actions sur les sessions

- suppression complète de l’hôte

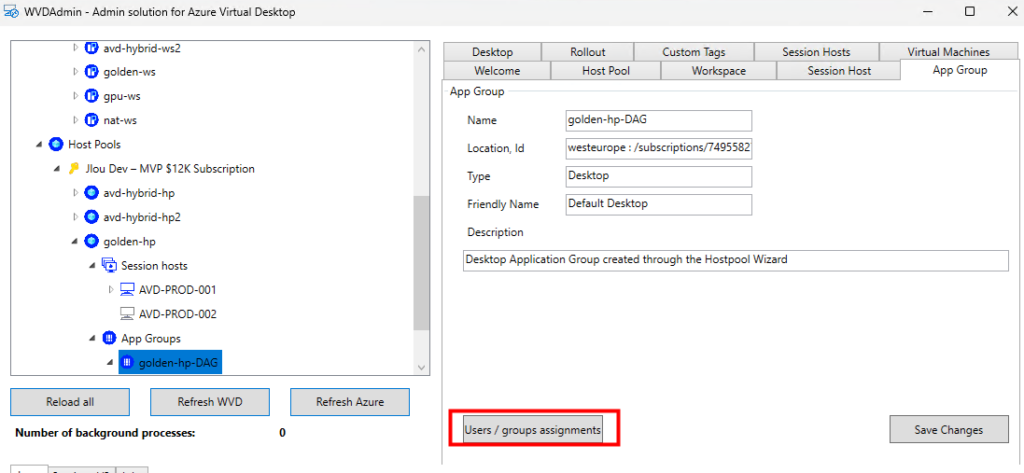

Il permet aussi de modifier les affectations se font au niveau des groupes d’applications :

La gestion des applications publiées aussi possible :

Mon avis personnel

Je vais être clair. WVDAdmin n’est pas un remplacement du portail d’Azure Virtual Desktop.

Ce n’est pas non plus une solution d’architecture d’entreprise complète. C’est un accélérateur opérationnel.

Et dans certains un contextes, WVDAdmin est redoutablement efficace :

- Lab

- PoC

- Environnement SMB

- Client où l’on veut éviter de déployer une surcouche d’automatisation complète

- Équipe IT réduite

La capture d’image est propre, le déploiement est rapide, L’interface centralise ce que le portail disperse. Besoin de plus ? Hydra for AVD sera peut être votre réponse.

Conclusion

Azure Virtual Desktop continue de se moderniser, les outils natifs progressent et l’automatisation devient centrale.

Mais entre la théorie et le terrain, il y a toujours l’opérationnel quotidien. WVDAdmin n’a jamais prétendu pas transformer votre architecture, mais il simplifie votre quotidien. Il évite les allers-retours dans le portail, réduit la friction et accélère les tâches répétitives.

Dans un monde où l’on parle beaucoup d’IA, d’automatisation avancée et de plateforme complexe, parfois un bon outil bien conçu fait simplement gagner du temps.

Et en tant qu’architecte AVD, je préfère toujours une solution claire, maîtrisée et comprise, plutôt qu’une sur-ingénierie inutile.

WVDAdmin ne remplace pas une stratégie, il optimise l’exécution. Et ça, pour un admin AVD, ça a énormément de valeur.